LTX 2.3 LoRA ComfyUI 推論: トレーニング一致の AI Toolkit LoRA 出力を LTX 2.3 パイプラインで#

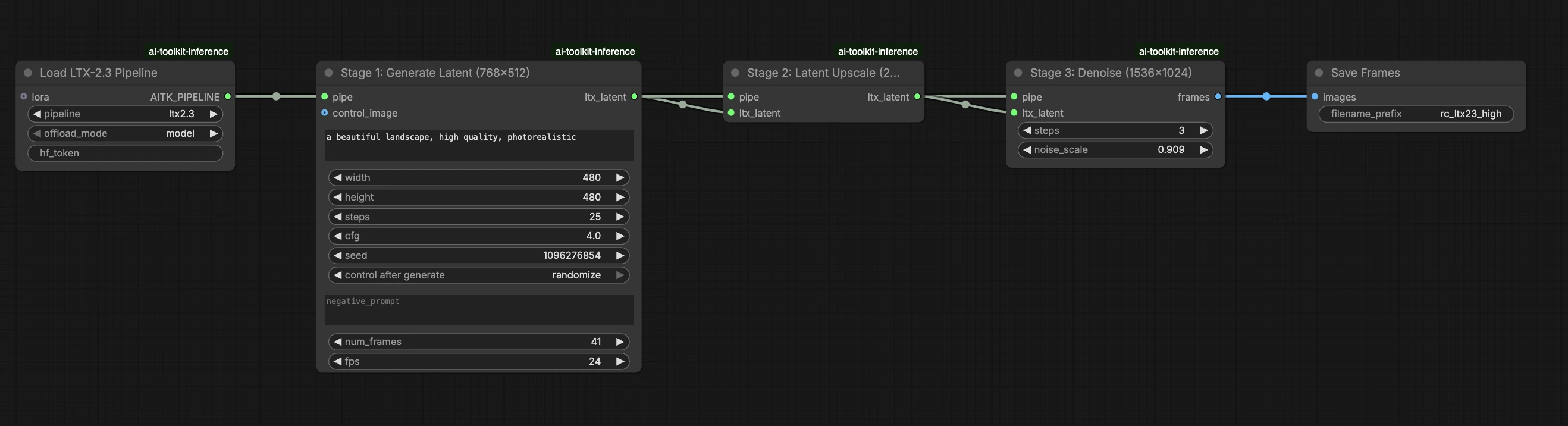

このプロダクションレディな RunComfy ワークフローは、RC LTX 2.3 (LTX2Pipeline) (パイプラインレベルの整合、一般的なサンプラーグラフではありません) を通じて ComfyUI で LTX 2.3 LoRA 推論を実行します。RunComfy はこのカスタムノードを構築し、オープンソース化しました—runcomfy-com repositories を参照してください—アダプターの適用は lora_path と lora_scale で制御します。

注: このワークフローを実行するには、2X Large 以上のマシンが必要です。

ComfyUI で LTX 2.3 LoRA 推論が異なるように見える理由#

AI Toolkit のトレーニングプレビューは、特定のモデルの LTX 2.3 パイプラインを通じてレンダリングされ、テキストエンコーディング、スケジューリング、および LoRA 注入が連携して動作するように設計されています。ComfyUI では、異なるグラフ (または異なる LoRA ローダーパス) で LTX 2.3 を再構築すると、それらの相互作用が変わる可能性があり、同じプロンプト、ステップ、CFG、およびシードをコピーしても、目に見えるドリフトが発生することがあります。RunComfy RC パイプラインノードは、このギャップを埋め、LTX 2.3 をエンドツーエンドで LTX2Pipeline で実行し、そのパイプライン内で LoRA を適用することで、推論をプレビューの動作に整合させます。出典: RunComfy オープンソースリポジトリ。

LTX 2.3 LoRA ComfyUI 推論ワークフローの使用方法#

ステップ 1: LoRA パスを取得してワークフローにロードする (2 つのオプション)#

オプション A — RunComfy トレーニング結果 → ローカル ComfyUI にダウンロード:

- Trainer → LoRA Assets にアクセス

- 使用したい LoRA を見つける

- 右側の ⋮ (三点リーダー) メニューをクリック → Copy LoRA Link を選択

- ComfyUI ワークフローページで、コピーしたリンクを UI の 右上隅 にある Download 入力フィールドに貼り付け

- Download をクリックする前に、ターゲットフォルダが ComfyUI > models > loras に設定されていることを確認 (このフォルダをダウンロードターゲットとして選択する必要があります)

- Download をクリック — これにより、LoRA ファイルが正しい

models/lorasディレクトリに保存されます - ダウンロードが完了したら、ページを更新

- ワークフローの LoRA セレクトドロップダウン に LoRA が表示されるようになる — 選択する

オプション B — 直接 LoRA URL (オプション A を上書き):

- 直接

.safetensorsダウンロード URL を LoRA ノードのpath / url入力フィールドに貼り付け - ここに URL が提供されている場合、オプション A を上書き — ワークフローは実行時に URL から直接 LoRA をロードします

- ローカルダウンロードやファイル配置は必要ありません

ヒント: URL が実際の .safetensors ファイル (ランディングページやリダイレクトではない) に解決することを確認してください。

ステップ 2: 推論パラメータをトレーニングサンプル設定に合わせる#

LoRA ノードで、lora_path (オプション A) にアダプターを選択するか、path / url に直接 .safetensors リンクを貼り付けます (オプション B はドロップダウンを上書きします)。次に、トレーニングプレビュー中に使用したのと同じ強度に lora_scale を設定し、そこから調整します。

残りのパラメータは Generate ノード (およびグラフによっては Load Pipeline ノード) にあります:

prompt: テキストプロンプト (トリガーワードを使用した場合は含める)width/height: 出力解像度; トレーニングプレビューサイズに合わせて、最もクリーンな比較を行う (LTX 2.3 には 32 の倍数が推奨されます)num_frames: 出力ビデオフレームの数sample_steps: 推論ステップ数 (30 は一般的なデフォルト)guidance_scale: CFG/ガイダンス値 (5.5 は一般的なデフォルト; 7 を超えないように)seed: 再現用の固定シード; 変更してバリエーションを探るseed_mode(存在する場合のみ):fixedまたはrandomizeを選択frame_rate: 出力 FPS; トレーニング設定と一致させてモーション整合性を保持

トレーニング整合性のヒント: トレーニング中にサンプリング値 (seed, guidance_scale, sample_steps, トリガーワード, 解像度) をカスタマイズした場合は、ここでそれらの正確な値をミラーリングします。RunComfy 上でトレーニングした場合は、Trainer → LoRA Assets > Config を開いて、解決された YAML を表示し、プレビュー/サンプル設定をワークフローノードにコピーします。

ステップ 3: LTX 2.3 LoRA ComfyUI 推論を実行#

Queue/Run をクリック — SaveVideo ノードが ComfyUI 出力フォルダに結果を書き込みます。

クイックチェックリスト:

- ✓ LoRA は次のいずれかです:

ComfyUI/models/lorasにダウンロード (オプション A)、または直接.safetensorsURL を介してロード (オプション B) - ✓ ローカルダウンロード後にページを更新 (オプション A のみ)

- ✓ 推論パラメータがトレーニング

sampleコンフィグに一致 (カスタマイズした場合)

上記のすべてが正しければ、ここでの推論結果はトレーニングプレビューに近いものになるはずです。

LTX 2.3 LoRA ComfyUI 推論のトラブルシューティング#

ほとんどの LTX 2.3 "トレーニングプレビュー vs ComfyUI 推論" のギャップは、パイプラインレベルの違い (モデルのロード方法、スケジュール、および LoRA の結合方法) によるもので、単一の誤ったノブによるものではありません。 この RunComfy ワークフローは、RC LTX 2.3 (LTX2Pipeline) をエンドツーエンドで実行し、lora_path / lora_scale を通じて LoRA を適用することで、最も近い "トレーニング一致" のベースラインを復元します (一般的なローダー/サンプラーノードを積み重ねるのではなく)。

(1) LoRA の形状の不一致や "key not loaded" 警告#

なぜこれが起こるのか LoRA は異なるモデルファミリーまたは異なる LTX バリアント用にトレーニングされました。多くの lora key not loaded 行と、形状の不一致エラーが発生する可能性があります。

修正方法 (推奨)

- LoRA が AI Toolkit で LTX 2.3 用に特別にトレーニングされたものであることを確認してください (LTX 2.0 / 2.1 / 2.2 LoRA は互換性がありません)。

- LoRA 用のグラフを "シングルパス" に保つ: ワークフローの

lora_path入力を通じてアダプターをロードし、LTX2Pipeline に結合を処理させます。追加の一般的な LoRA ローダーを並行して積み重ねないでください。 - すでに不一致が発生し、ComfyUI がその後に関連性のない CUDA/OOM エラーを生成し始めた場合、ComfyUI プロセスを再起動 して GPU + モデルの状態を完全にリセットし、互換性のある LoRA で再試行してください。

(2) 推論結果がトレーニングプレビューと一致しない#

なぜこれが起こるのか LoRA がロードされても、ComfyUI グラフがトレーニングプレビューパイプラインと一致しない場合 (異なるデフォルト、異なる LoRA 注入パス、異なるスケジューリング)、結果がドリフトすることがあります。

修正方法 (推奨)

- このワークフローを使用し、直接

.safetensorsリンクをlora_pathに貼り付けます。 - AI Toolkit トレーニングコンフィグ (または RunComfy Trainer → LoRA Assets Config) からサンプリング値をコピーします:

width,height,num_frames,sample_steps,guidance_scale,seed,frame_rate。 - "追加の速度スタック" を比較から除外してください。トレーニング/サンプリングでそれらを使用した場合を除きます。

(3) LoRA を使用すると推論時間が大幅に増加する#

なぜこれが起こるのか LoRA は、LoRA パスが追加のパッチング/デクアンタイズ作業を強制したり、ベースモデル単独よりも遅いコードパスでウェイトを適用したりする場合、LTX 2.3 を非常に遅くする可能性があります。

修正方法 (推奨)

- このワークフローの RC LTX 2.3 (LTX2Pipeline) パスを使用し、アダプターを

lora_path/lora_scaleで渡します。このセットアップでは、LoRA は パイプラインのロード中に一度結合 されるので、ステップごとのサンプリングコスト はベースモデルに近いままです。 - プレビュー一致の動作を追求する際には、複数の LoRA ローダーを積み重ねたり、ローダーパスを混在させたりしないでください。1 つの

lora_path+ 1 つのlora_scaleに留め、ベースラインが一致するまで続けます。

(4) 大きな解像度や長いビデオでの OOM エラー#

なぜこれが起こるのか LTX 2.3 は 22B パラメータのモデルで、ビデオ生成は VRAM 集約的です。高解像度や多くのフレームは、特に LoRA のオーバーヘッドがある場合、GPU メモリを超える可能性があります。

修正方法 (推奨)

- 2X Large (80 GB VRAM) 以上のマシンを使用します。このワークフローは Medium, Large, X Large マシンとは互換性がありません。

- 迅速に反復する必要がある場合は、解像度やフレーム数を減らし、最終レンダリングのためにスケールアップします。

- 使用可能であれば VAE タイル化を有効にします — 最小限の品質損失で ~3 GB VRAM を節約できます。

LTX 2.3 LoRA ComfyUI 推論を今すぐ実行#

ワークフローを開き、lora_path を設定し、Queue/Run をクリックして、AI Toolkit トレーニングプレビューに近い LTX 2.3 LoRA 結果を取得します。