FLUX.2 Klein 9B LoRA ComfyUI 推論: プレビューに一致した AI Toolkit LoRA 生成 in ComfyUI#

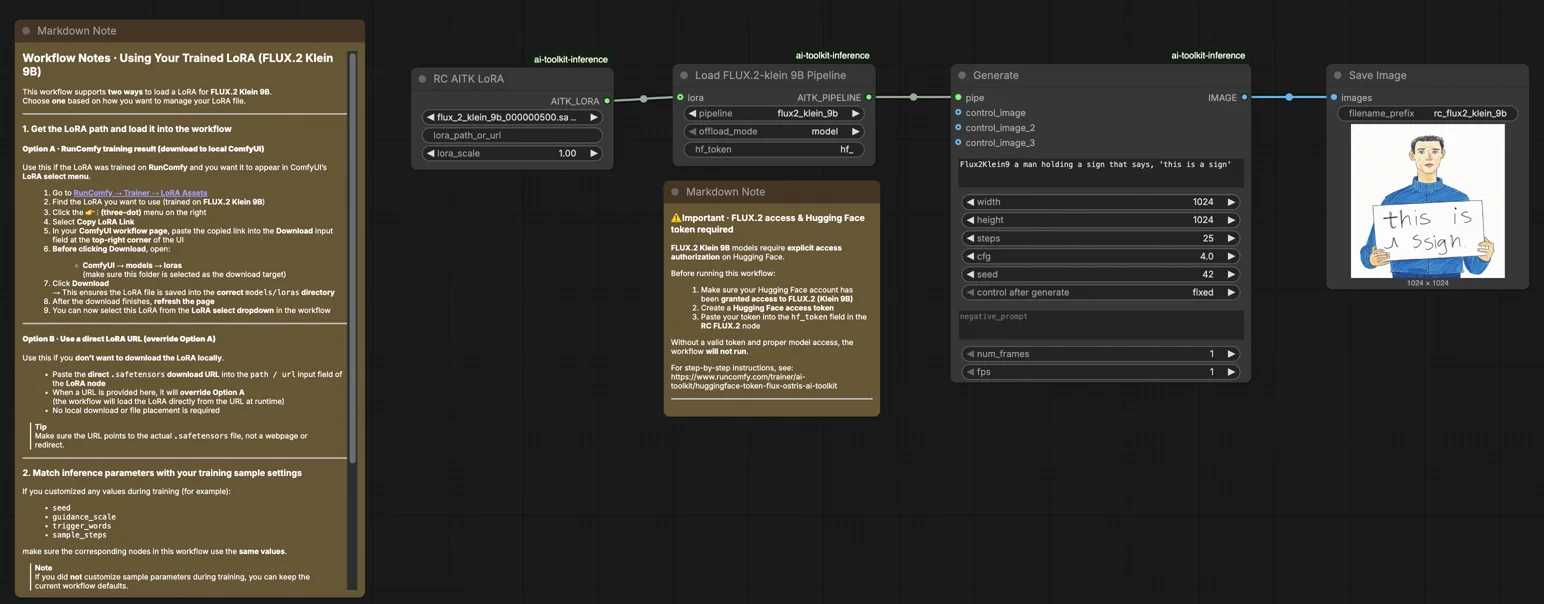

この RunComfy ワークフローを使用して、ComfyUI 推論を AI Toolkit トレーニングプレビューと一致させる必要がある場合に、FLUX.2 Klein 9B LoRA を使用してください。セットアップは、標準のサンプラーグラフではなく、RunComfy によってオープンソース化された モデル固有のパイプラインラッパー Flux2Klein9BPipeline を通じて生成をルーティングします。アダプターは、そのパイプライン内で lora_path と lora_scale を介して適用され、トレーニングに一致した LoRA の動作を手動でパイプラインを再構築することなく提供します。

なぜ FLUX.2 Klein 9B LoRA ComfyUI 推論は ComfyUI で異なって見えることがあるのか#

AI Toolkit がトレーニングプレビューをレンダリングする際、FLUX.2 Klein 9B 推論パイプライン全体が実行され、Qwen3-8B テキストエンコーディング、フローマッチスケジューリング、および内部の LoRA 注入がすべて調整されたユニットとして実行されます。通常の ComfyUI グラフは、これらのコンポーネントを独立して再構成し、コンディショニング、ノイズスケジューリング、およびアダプター適用順序に微妙な違いを生じさせます。その結果、パイプラインレベルのドリフトが生じ、単一の誤設定されたノブではありません。Flux2Klein9BPipeline は、このギャップを埋めるためにモデル独自のパイプラインをエンドツーエンドで実行し、その中に LoRA を注入します。参考: `src/pipelines/flux2_klein.py`。

FLUX.2 Klein 9B LoRA ComfyUI 推論ワークフローの使い方#

ステップ 1: LoRA パスを取得し、ワークフローに読み込む (2 つのオプション)#

オプション A — RunComfy トレーニング結果 > ローカル ComfyUI にダウンロード:

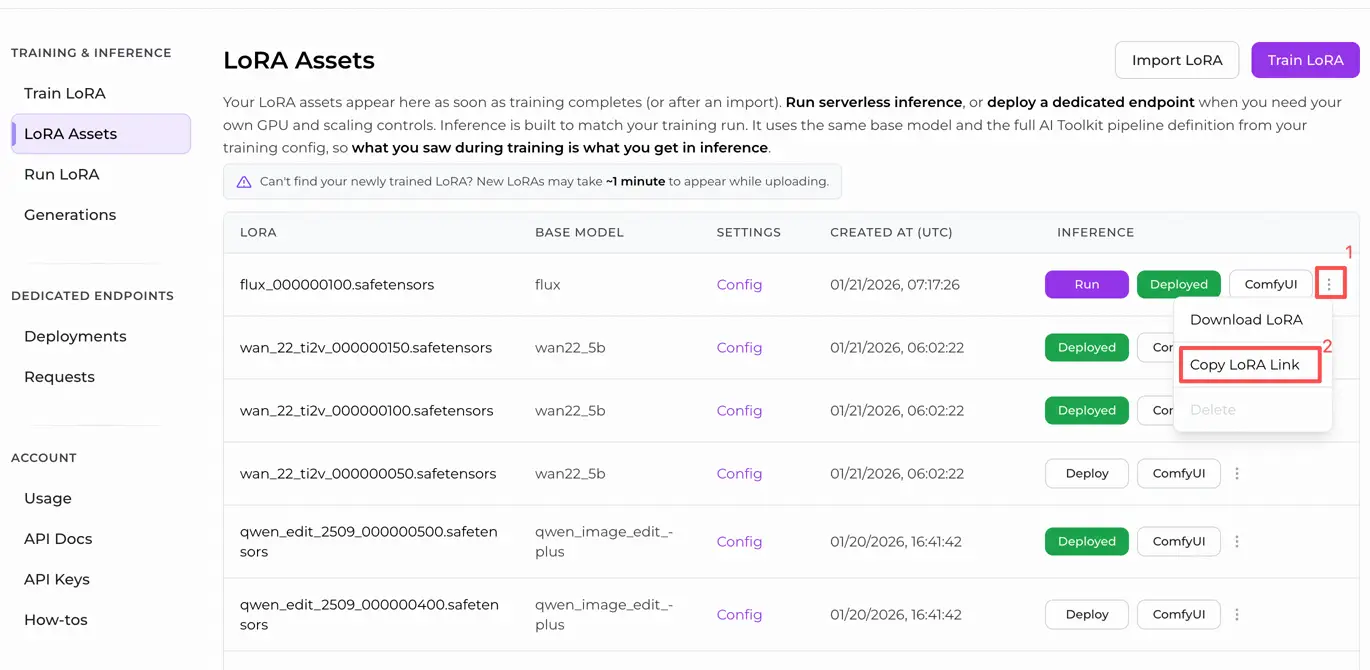

- Trainer > LoRA Assets にアクセス

- 使用したい FLUX.2 Klein 9B LoRA を見つける

- 右側の ... (三点リーダー) メニューをクリック > Copy LoRA Link を選択

- ComfyUI ワークフローページで、コピーしたリンクを トップ右隅 の Download 入力フィールドに貼り付ける

- Download をクリックする前に、対象フォルダーが ComfyUI > models > loras に設定されていることを確認 (このフォルダーをダウンロード対象として選択する必要があります)

- Download をクリック — LoRA ファイルが正しい

models/lorasディレクトリに保存されます - ダウンロードが終了したら、ページを更新

- LoRA が LoRA セレクトドロップダウン に表示される — 選択する

オプション B — 直接 LoRA URL (オプション A を上書き):

- 直接

.safetensorsダウンロード URL を LoRA ノードのpath / url入力フィールドに貼り付ける - ここに URL が提供されると、オプション A を上書き — ワークフローは実行時に URL から直接 LoRA を取得します

- ローカルダウンロードやファイル配置は不要です

ヒント: URL がランディングページやリダイレクトではなく、実際の .safetensors ファイルに解決されることを確認してください。

ステップ 2: 推論パラメータをトレーニングサンプル設定に合わせる#

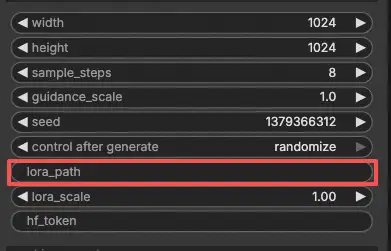

lora_scale を LoRA ノードで設定し、アダプターの強度を制御します。トレーニングプレビュー中に使用した値から開始し、そこから調整します。

残りのパラメータは Generate および Load Pipeline ノードにあります:

prompt— テキストプロンプト; トレーニングからのトリガーワードを含めるwidth/height— 出力解像度; 直接比較のためにトレーニングプレビューサイズに合わせる (16 の倍数)sample_steps— 推論ステップ; FLUX.2 Klein 9B のデフォルトは 25guidance_scale— CFG 強度; デフォルトは 4.0 (Klein 9B はガイダンス蒸留されていないため、この値が直接出力品質を形作ります)seed— 特定の出力を再現するためにシードを固定; 変化を探るために変更seed_mode—fixedまたはrandomizehf_token— FLUX.2 Klein 9B はゲート付きモデルであるため、有効な Hugging Face トークンが必要です; Load Pipeline ノードのhf_tokenフィールドにトークンを貼り付ける

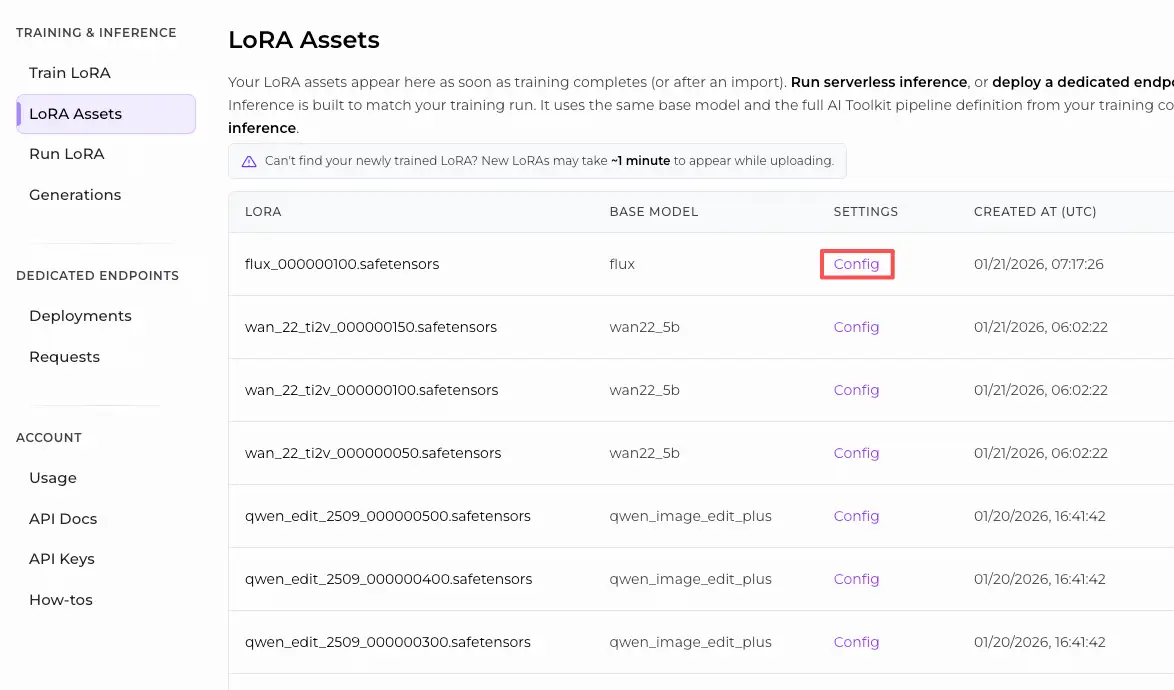

トレーニングアライメントのヒント: トレーニング中にサンプリング値をカスタマイズした場合 (seed, guidance_scale, sample_steps, trigger words)、それらの正確な値を対応するフィールドにコピーします。RunComfy でトレーニングした場合は、Trainer > LoRA Assets > Config を開いて解決された YAML を表示し、プレビュー/サンプル設定を転送します。

ステップ 3: FLUX.2 Klein 9B LoRA ComfyUI 推論を実行する#

Queue/Run をクリック — SaveImage ノードが結果を ComfyUI 出力フォルダーに書き込みます。

⚠️ 重要 · FLUX.2 アクセス & Hugging Face トークンが必要#

FLUX.2 Klein 9B モデルには、Hugging Face での 明示的なアクセス承認 が必要です。

このワークフローを実行する前に:

- Hugging Face アカウントに FLUX.2 (Klein 9B) へのアクセスが付与されていることを確認

- Hugging Face アクセストークンを作成する

- RC FLUX.2 ノードの

hf_tokenフィールドにトークンを貼り付ける

有効なトークンと適切なモデルアクセスがないと、ワークフローは 実行されません。

ステップバイステップの指示については、以下を参照してください: https://www.runcomfy.com/trainer/ai-toolkit/huggingface-token-flux-ostris-ai-toolkit

クイックチェックリスト:

- ✅ Hugging Face アカウントは FLUX.2 Klein 9B アクセスがあり、有効なトークンが

hf_tokenにある - ✅ LoRA は次のいずれか:

ComfyUI/models/lorasにダウンロード済み (オプション A)、または直接.safetensorsURL 経由でロード済み (オプション B) - ✅ ローカルダウンロード後、ページを更新 (オプション A のみ)

- ✅ 推論パラメータがトレーニング

sample設定に一致 (カスタマイズされている場合)

上記のすべてが正しい場合、ここの推論結果はトレーニングプレビューに非常に近いものになるはずです。

FLUX.2 Klein 9B LoRA ComfyUI 推論のトラブルシューティング#

FLUX.2 Klein 9B での「トレーニングプレビュー vs ComfyUI 推論」のギャップのほとんどは、パイプラインレベルの違い (テキストエンコーダーパス、スケジューラ/コンディショニング、およびアダプターの適用方法/場所) に起因します。 RunComfy ワークフローは、生成を Flux2Klein9BPipeline を通じて実行し、そのパイプライン内に LoRA を注入することにより、パイプラインを手動で再構築することを避け、ComfyUI で AI Toolkit プレビューの動作を最も近い形で再現します。

(1) 401 クライアントエラー。#

なぜこれが発生するのか FLUX.2 Klein 9B は ゲート付き Hugging Face モデルです。アカウントにアクセスがない場合、または有効なトークンが提供されていない場合、モデルの重みをダウンロードできず、推論が 401 エラーで失敗します。

修正方法

- Hugging Face アカウントに

black-forest-labs/FLUX.2-klein-base-9Bへの アクセスが付与されていること を確認します。 - Hugging Face アクセストークンを作成し、Load Pipeline ノードの

hf_tokenフィールドに貼り付けます。 - アクセスとトークンが確認されたら、RunComfy AI Toolkit パイプラインノード を通じて推論を実行し、認証とモデルの読み込みを一貫したパイプライン内で行います。

- ステップバイステップの指示については、以下を参照してください: https://www.runcomfy.com/trainer/ai-toolkit/huggingface-token-flux-ostris-ai-toolkit

(2) Flux 2 Klein モデルの CLIPLoader エラー#

なぜこれが発生するのか これらのエラーは、テキストエンコーダーの不一致 によって引き起こされます。たとえば、互換性のないエンコーダーをロードしたり、Klein 4B と Klein 9B のエンコーダーアセットを混ぜたりすると、CLIP/テキストエンコーダーの読み込み中に埋め込みまたは語彙サイズの不一致として現れます。

修正方法

- ComfyUI を最新バージョンに更新して、FLUX.2 Klein のサポートを完全にします。

- Klein 9B 用の正しいテキストエンコーダーが使用されていることを確認します (Klein 9B は Qwen3-8B を必要とします; 4B エンコーダーを使用すると失敗します)。

- プレビューに一致した LoRA 推論には、RunComfy パイプラインラッパーを優先し、正しいエンコーダーをロードし、LoRA を AI Toolkit プレビューに使用された同じパイプラインに適用します。

(3) mat1 と mat2 の形状が掛け算できない (512x2560 と 7680x3072)#

なぜこれが発生するのか このエラーは、コンディショニング次元の不一致を示しており、通常は間違ったエンコーダーの使用や FLUX.2 Klein 9B のクリップ/コンディショニングタイプの誤りによって引き起こされます。モデルが間違った形状の埋め込みを受け取り、サンプリング中に行列の掛け算が失敗します。

修正方法

- グラフを手動で構築する場合、FLUX.2 Klein 固有のテキストエンコーダーが使用され、クリップ/コンディショニングタイプが FLUX.2 Klein の期待に合致していることを確認します。

- 最も信頼性のある修正方法として、推論を RunComfy FLUX.2 Klein 9B パイプラインラッパー (

model_type = flux2_klein_9b) を通じて実行し、lora_pathを介して LoRA を注入します。これにより、エンコーダー、スケジューラ、およびアダプターを含む推論スタック全体が AI Toolkit プレビューにパイプラインアラインドされます。

FLUX.2 Klein 9B LoRA ComfyUI 推論を今すぐ実行#

ワークフローをロードし、lora_path を貼り付け、有効な hf_token を入力し、Flux2Klein9BPipeline が ComfyUI の出力を AI Toolkit トレーニングプレビューに合わせて維持するようにします。