ENTIRE AI WORLDS (Vace Wan 2.1)を生成: 真のカメラトラッキングを使用したシネマティックビデオ・トゥ・ビデオワールドビルディング#

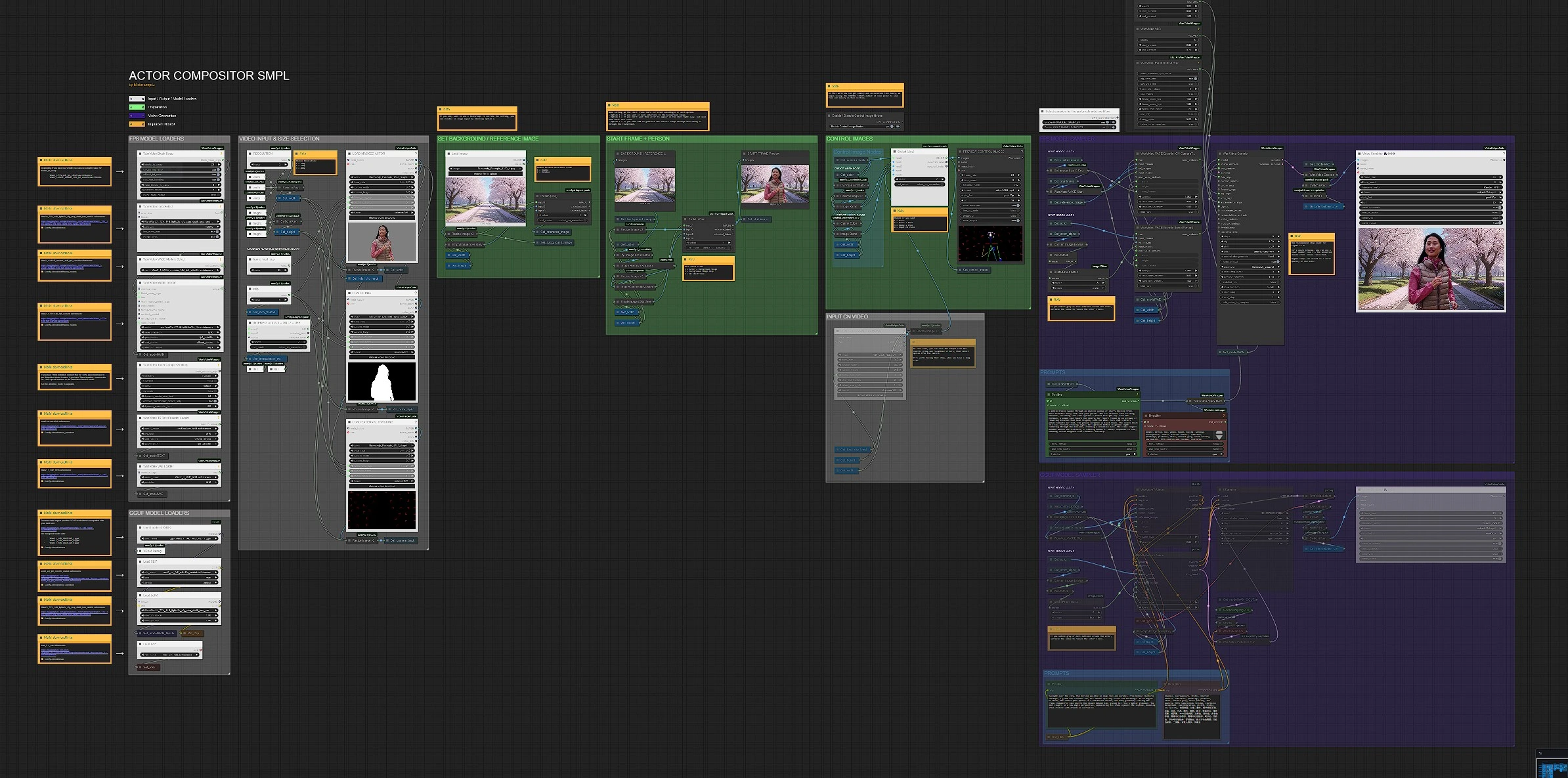

ENTIRE AI WORLDS (Vace Wan 2.1)は、Mickmumpitzによる本番環境対応のComfyUIワークフローで、ライブアクション映像を新しい環境に変換しつつ元のカメラモーションを維持します。背景を交換し、視点とスケールを保持し、マスクされた俳優をテキストと参照画像に基づいて完全に再生成された世界に合成します。

Wan 2.1 VACEスタック上に構築されたこのワークフローは、映画製作者、VFXアーティスト、迅速なプレビズや洗練されたショットを必要とするクリエイターに最適です。プロンプトでシーンを指示し、オプションの参照画像から開始し、高速なFP8パイプラインまたは低VRAM GGUFパイプラインを選択できます。結果はシームレスなワールドビルディングで、日常のプレートから真にENTIRE AI WORLDS (Vace Wan 2.1)を生成できます。

Comfyui Generate ENTIRE AI WORLDS (Vace Wan 2.1)ワークフローの主要モデル#

- Wan 2.1 14Bテキスト・トゥ・ビデオ拡散モデル。新しい世界を時間的一貫性のある方法で合成するために使用されるコアジェネレーター。ComfyUI用に再パッケージされた重みがHugging FaceのComfy‑Orgリリースで利用可能です。 Comfy‑Org/Wan_2.1_ComfyUI_repackaged

- Wan 2.1 VACEモジュール14B。生成をシーン構造に結びつけるVACE埋め込みを提供し、正確な背景置換とカメラトラッキングを可能にします。 Kijai/WanVideo_comfy

- Wan 2.1 VAE。ビデオフレームの潜在的なエンコード/デコードを処理します。 Comfy‑Org/Wan_2.1_ComfyUI_repackaged (VAE split)

- uMT5‑XXLテキストエンコーダー。Wan 2.1のコンディショニングスペース用にプロンプトをエンコードします。このワークフローに互換性のあるパッケージ化されたエンコーダーがWan 2.1スプリットと共に提供されています。 Comfy‑Org/Wan_2.1_ComfyUI_repackaged (text_encoders)

- Wan 2.1 14B VACE GGUF (量子化UNet)。FP8モデル全体を使用せずにGGUFパスを駆動する低VRAM GPU用の量子化代替品。 QuantStack/Wan2.1_14B_VACE‑GGUF

- FILM: 大きな動きのためのフレーム補間。追加のフレームを補間することでモーションスムーズネスを向上させるオプションの後処理。 google‑research/frame‑interpolation

- Wan 2.1用のオプションのLightXステップディストールLoRA。短いステップカウントと構造とアイデンティティを維持しながらうまく組み合わせる速度指向のLoRA。 Kijai/WanVideo_comfy (LoRA)

Comfyui Generate ENTIRE AI WORLDS (Vace Wan 2.1)ワークフローの使用方法#

このワークフローは、二重パスのVACE戦略に従います。最初に、コントロールイメージからシーンの動きをエンコードしてカメラの動きをロックし、次に俳優の挿入をエンコードし、再生成された環境にブレンドします。最大速度を得るためにFP8パスを実行するか、低VRAMのためにGGUFパスを実行できます。以下のセクションはオングラフグループに対応しており、全体のGenerate ENTIRE AI WORLDS (Vace Wan 2.1)パイプラインを自信を持って操作できます。

ビデオ入力とサイズ選択#

入力エリアでは、作業解像度と基本的なクリップコントロールを選択できます。解像度スイッチを使用してプリセットを選択(720p、576p、または480p)、これによりSet_width (#370)とSet_height (#369)がフィードされ、すべてのステージが同期されます。フレーム数を制限してターンアラウンドを速く保ち、インポイントをオフセットしたい場合に小さなスキップを設定できます。安定性とメモリのために、シーケンスを推奨範囲内に保ちます。グラフラベルは、ほとんどのGPUに対して81フレームが合理的な上限であることを示しています。これらの選択は、コントロールイメージ、VACEエンコード、および最終レンダーにグローバルに適用されます。

注意: 入力ビデオは、別のワークフローMASK_AND_TRACKを通じて生成することもできます。そのワークフローファイルをここからダウンロードできます: workflow.json。ダウンロード後、新しいワークフロータブにファイルをドラッグして実行し、入力ビデオを取得します。

背景/参照画像の設定#

背景プレートとオプションの参照画像がビジュアルスタイルをガイドします。背景スチルをロードすると、グラフが作業サイズに合わせてリサイズします。ハードバックプレートの代わりにスタイルアンカーが必要な場合は、セレクターを通じてreference_imageを有効にします。この画像は、ジオメトリを決定することなく、色、構成、トーンをガイドします。特定の外観を反映するGenerate ENTIRE AI WORLDS (Vace Wan 2.1)をモデルに生成させたい場合に参照ルートが役立ちますが、テキストプロンプトが残りを処理します。テキストのみのコントロールを好む場合はオフにします。

スタートフレーム+人物#

生成を開始する方法を決定するためにこのセクションを使用します。準備された俳優スチルで、Image Remove Background Rembg (mtb) (#1433)がクリーンなマスクを引き出し、ImageCompositeMasked (#1441)が選択した背景に俳優を配置してスタートフレームを形成します。Start Frameスイッチ(ImpactSwitch, #1760)は、俳優と背景の合成、背景のみ、スタートフレームなしの3つのモードを提供します。スタートフレームはアイデンティティとレイアウトを固定するのに役立ちます。背景のみではキャラクターが時間をかけて「入る」ことができ、スタートフレームがない場合、モデルはテキストと参照から主題と世界の両方を確立します。ライブプレビューブロックは、コミットする前にそのスタートがどのように見えるかを示します。

コントロールイメージ#

コントロールイメージは、カメラの動きをロックし、視点と視差がリアルに感じられるようにします。カメラトラックビデオをグループに供給します。グラフはOpenPoseとCannyレイヤーを導出し、強い構造シグナルを作成するためにそれらをブレンドします。Control Image Nodesスイッチ(ImpactSwitch, #1032)を使用して、トラックのみ、トラック+ポーズ、Canny+ポーズ、または外部で準備されたコントロールビデオを選択できます。プレビューコンバインでスタックを確認し、シルエットとエッジが明確に読めることを確認します。長いシーケンスの場合、構造を再計算するのを避けるために、後で再ロードするためにこのコントロールビデオを保存できます。これはプロンプトやマスクを反復し続けながらGenerate ENTIRE AI WORLDS (Vace Wan 2.1)を生成する際に特に便利です。

INPUT CN VIDEO#

既に「コントロールイメージ」ビデオをエクスポートしている場合は、ここにドロップして前処理をバイパスします。コントロールイメージスイッチで対応するオプションを選択し、パイプラインの残りがキャッシュされた構造を使用するようにします。これにより、ランごとに一貫したカメラトラッキングが維持され、長いテイクでの反復時間が大幅に短縮されます。

FP8モデルローダー#

FP8ブランチは、Wan 2.1モデルスタック全体をロードします。WanVideoModelLoader (#4)はT2V 14BバックボーンとVACEモジュールを取り込み、オプションのLightX LoRAを使用して高速で一貫したサンプリングを可能にします。WanVideoVAELoader (#26)はVAEを供給し、WanVideoBlockSwap (#5)は必要に応じてブロックをデバイスメモリにスワップすることでVRAMを節約する戦略を公開します。このブランチは、VRAMに余裕がある場合に最速でENTIRE AI WORLDS (Vace Wan 2.1)を生成する方法です。

FP8モデルサンプラー#

プロンプトはWanVideoTextEncodeSingleによって正および負のテキストとしてエンコードされ、WanVideoApplyNAGを通じてフレージングの一貫性が保たれます。最初のパス、WanVideo VACE Encode (CN‑CameraTrack) (#948)は、コントロールイメージを読み取り、モーションアウェアな埋め込みを生成します。第二のパス、WanVideo VACE Encode (InsertPerson) (#1425)は、俳優をクリーンなアルファとマスクを使用して注入し、ハローを避けるためにマスクを少し成長または縮小することができます。WanVideoSampler (#2)はシーケンスをレンダリングし、WanVideoDecode (#1)は潜在をフレームに変換し、シンプルなスイッチで元のフレームレートまたはFILM補間ストリームを選択して最終ビデオを組み合わせます。

GGUFモデルローダー#

GGUFブランチは、低VRAMワークフロー用に設計されています。UnetLoaderGGUF (#1677)は量子化されたWan 2.1 VACE UNetをロードし、CLIPLoader (#1680)はテキストエンコーダーを提供し、LoRAはLoraLoader (#2420)で適用できます。標準のComfyUI VAELoader (#1676)がデコードを処理します。このルートは、スピードを犠牲にしてフットプリントを縮小しながら、同じ二重パスVACEロジックを維持するため、控えめなハードウェアでもENTIRE AI WORLDS (Vace Wan 2.1)を生成できます。

GGUFモデルサンプラー#

量子化パスでは、WanVaceToVideo (#1724)がVACE埋め込み、テキストコンディショニング、および参照をガイドされた潜在に変換します。WanVideoNAGとWanVideoEnhanceAVideoKJはアイデンティティとローカルディテールを維持し、その後KSampler (#1726)が最終潜在シーケンスを生成します。VAEDecode (#1742)はフレームを生成し、オプションのFILMステップが時間的スムーズネスを追加し、ビデオコンバインが結果をディスクに書き込みます。VRAMが厳しい場合や長く安定したショットが必要な場合にこのパスを使用します。

プロンプト#

プロンプトパネルは2つあります。FP8側はWan T5テキストエンコーダーを使用し、GGUF側はCLIPコンディショニングパスを使用します。どちらも正および負のテキストを受け取ります。ポジティブプロンプトは、生成したい世界に対してシネマティックで具体的にし、ネガティブプロンプトは圧縮アーティファクト、過飽和、および不要な前景の乱雑を対象にします。柔らかい参照画像をプロンプトと組み合わせて色と照明を誘導しつつ、モデルが意図に合ったENTIRE AI WORLDS (Vace Wan 2.1)を生成するようにします。

Comfyui Generate ENTIRE AI WORLDS (Vace Wan 2.1)ワークフローの主要ノード#

WanVideo VACE Encode (CN-CameraTrack)(#948) コントロールイメージを分析してカメラモーションをロックする最初のVACEパス。埋め込みが下流のサンプリングと一致するように選択した作業サイズとクリップの長さに合わせて幅、高さ、長さを一致させます。外部コントロールビデオに依存する場合、フレーム数を一貫させてタイミングのずれを避けます。参照実装とノードの動作はWanVideoラッパーに従います。 ソース: kijai/ComfyUI‑WanVideoWrapperWanVideo VACE Encode (InsertPerson)(#1425) アルファマットとクリーンなマスクを使用して俳優を挿入する第二のVACEパス。微かなエッジが見える場合、上流のマスク縮小/拡大(DilateErodeMask, #2391)を調整してマットを少し引き込んでjson

ください。このパスは、挿入をシーンモーションに結びつけるため、スケールと視差が自然に保たれます。 ソース: kijai/ComfyUI‑WanVideoWrapper

WanVaceToVideo(#1724 and #1729) VACEコンディショニングをサンプラーに橋渡しします。出力寸法を同じ作業サイズに設定し、コントロールクリップのフレーム数を使用して後でトリムが不要になるようにします。レイアウトを過度に制約せずにショット全体で一貫した外観が欲しい場合は、単一の参照画像とペアにします。 ソース: kijai/ComfyUI‑WanVideoWrapperWanVideoSampler(#2) FP8サンプラーが、Wan 2.1を使用して最終シーケンスをレンダリングし、テキスト埋め込みとVACEイメージ埋め込みを使用します。VRAM節約のブロックスワップをサポートし、低ステップ数で迅速かつアイデンティティを安全に保つLightXステップディストールLoRAとよく機能します。 ソース: kijai/ComfyUI‑WanVideoWrapper, Kijai/WanVideo_comfy (LoRA)KSampler(#1726) GGUFブランチサンプラー。俳優を保存し、過度のシャープ化を減らすために少ないステップ数から始めます; LightX LoRAはこのレジームに調整されています。詳細が失われた場合は、ステップを控えめに増やすか、モーションをドリフトせずに微細構造を取り戻すためにEnhance A Videoブロックに傾けます。 ソース: ComfyUI coreFILM VFI(#2019 and #1757) 補間スイッチによって制御されるオプションのフレーム補間。高速モーションをスムーズにしたり、再レンダリングせずに期間を延長するために使用します。薄い構造で時間的な揺れが見られる場合、そのショットでは無効にするか、補間係数を減らしてください。 ソース: google‑research/frame‑interpolation

オプションの追加機能#

- クリップの長さを管理可能に保ちます。グラフのガイダンスに従い、ランあたり約81フレームまでが、一般的なGPUでの安定性とメモリのバランスをとります。

- プロンプトを反復している場合、「コントロールイメージ」ビデオを一度保存し、Input CN Videoパスに切り替えて構造を再計算するのを避けます。

- 主題の周囲の微かなエッジを取り除くために、挿入パスの

DilateErodeMaskを使用して俳優マスクを調整し、ハローを消します。 - 低VRAMまたは長いテイクの場合: GGUFブランチを選択; 高VRAMで迅速な反復: FP8ブランチを選択。

- スタートフレーミングでは、主題が後で入ることを望む場合は「背景のみ」を使用するか、テキストと参照から完全にシーンを確立するようにモデルに求める場合は「スタートフレームなし」を使用します。

これらの手順を使用して、ワークフローを自信を持ってエンドツーエンドで実行し、実際のカメラモーションに耐えるENTIRE AI WORLDS (Vace Wan 2.1)を生成できます。

謝辞#

このワークフローは、@mickmumpitzの作品とリソースを実装し、基にしています。Mickmumpitzのワークフローチュートリアルに感謝し、その貢献とメンテナンスに感謝します。権威ある詳細については、以下のリンクされた元のドキュメントとリポジトリを参照してください。

リソース#

- YouTube/ワークフローチュートリアル

- Mickmumpitz Youtubeからのドキュメント/リリースノート: ワークフローチュートリアル

注意: 参照されたモデル、データセット、およびコードの使用は、Mickmumpitzによって提供されたそれぞれのライセンスと条件に従います。