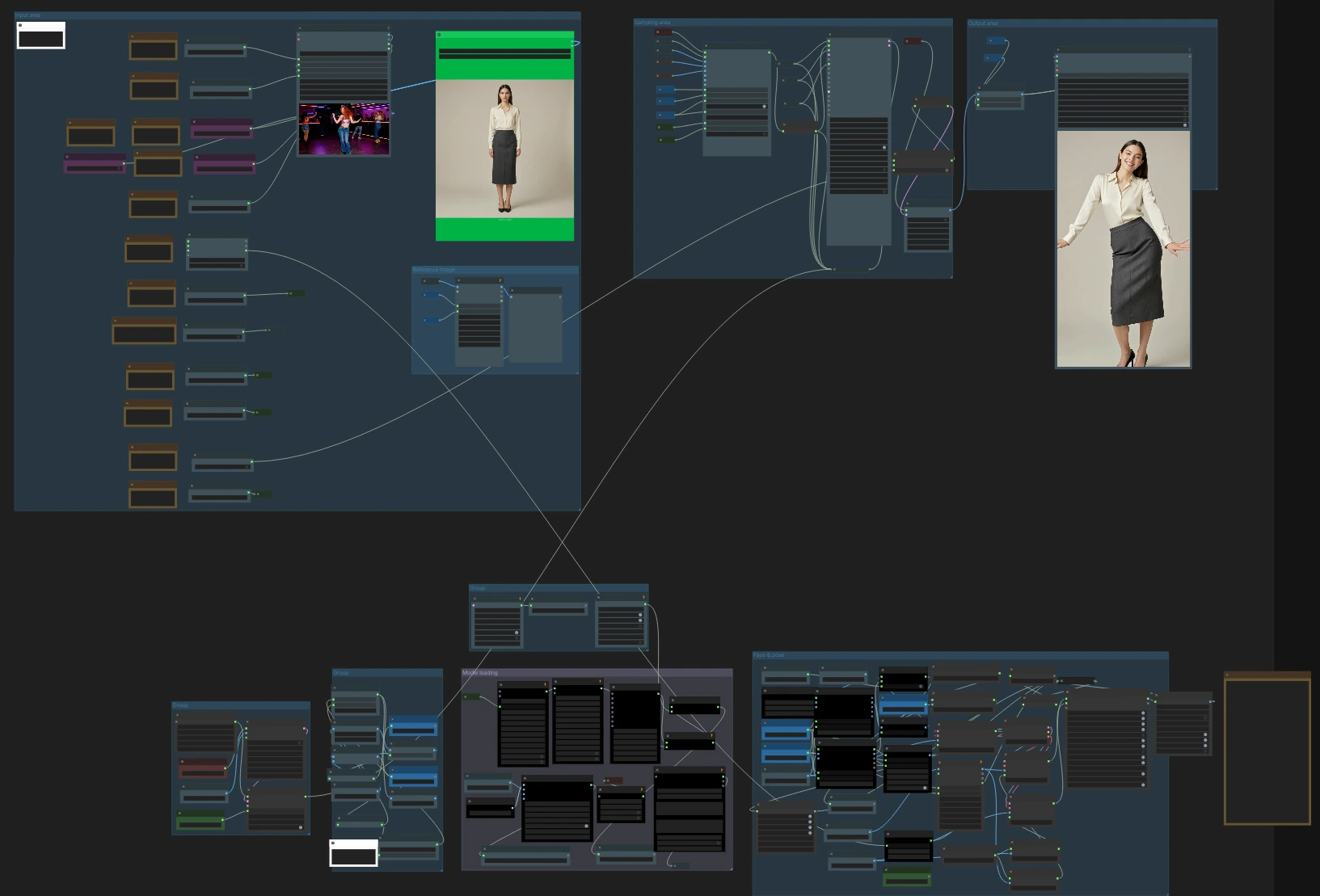

Wan2.2 Trasferimento Azione Animata V7: Flusso di Lavoro Video Motion-to-Character per ComfyUI#

Wan2.2 Trasferimento Azione Animata V7 è un flusso di lavoro video ComfyUI per trasferire il movimento da un video di guida su un personaggio o immagine target mantenendo identità, inquadratura e stile. Costruito attorno a Wan2.2 Animate con pose, facce, visione CLIP, Uni3C ControlNet e guida Wan LoRA impilata, produce un MP4 pronto per l'editing o la pubblicazione.

Questo flusso di lavoro Wan2.2 Trasferimento Azione Animata è ideale per creatori che vogliono una configurazione di trasferimento d'azione pronta per RunComfy con input di esempio e risultati coerenti e ripetibili. Gestisce il condizionamento di pose e facce, guida opzionale della telecamera, utility di inquadratura e aspetto, e passaggio audio in modo che tu possa concentrarti sulla direzione della performance e dell'aspetto.

Modelli chiave nel flusso di lavoro ComfyUI Wan2.2 Trasferimento Azione Animata#

- Wan2.2 Animate 14B. Il modello di diffusione video principale che genera fotogrammi coerenti con il movimento condizionati da identità, pose e incorporamenti di testo. Model card

- Wan Video VAE (Wan 2.1). Codifica/decodifica latente di alta qualità per fotogrammi video che bilancia dettaglio e velocità in ComfyUI. Assets

- Codificatore di visione CLIP (ViT-H/14 via OpenCLIP). Estrae segnali di identità e composizione dall'immagine target per mantenere il soggetto stabile tra i fotogrammi. Repo

- ViTPose Whole-Body. Stima robusta dei punti chiave del corpo, mani e faccia per guidare un trasferimento d'azione accurato. Paper

- Rilevatori YOLOv10. Rilevamento di persone e regioni utilizzato per localizzare i corpi prima dell'estrazione dei punti chiave e mappatura delle proporzioni. Repo

- Estrattore SDPose Whole-Body. Backend alternativo di punti chiave del corpo intero integrato per l'analisi delle pose multi-strategia. Repo

- Uni3C ControlNet per video (via WanVideoWrapper). Guida strutturale opzionale che stabilizza la telecamera e i vincoli della scena durante il rendering. Repo

Come usare il flusso di lavoro ComfyUI Wan2.2 Trasferimento Azione Animata#

A un livello alto, carichi un'immagine del personaggio target e un video di guida, il flusso di lavoro estrae segnali di pose e facce, codifica l'identità con la visione CLIP, applica opzionalmente la guida della telecamera Uni3C e Wan LoRAs, quindi rende con Wan2.2 Animate in fotogrammi ed esporta un MP4 con o senza l'audio sorgente.

Area di input#

Carica il tuo video di guida in VHS_LoadVideo (#275) e la tua immagine del personaggio target in LoadImage (#299). Il caricatore video gestisce i limiti di frame rate, l'estrazione audio opzionale e i controlli di selezione di base; il caricatore di immagini è usato come riferimento di identità e inquadratura. Le utility di aspetto calcolano automaticamente larghezza e altezza dalla tua orientazione scelta in modo che l'output corrisponda a 16:9 o 9:16 senza distorsioni. Se prevedi di mantenere l'audio sorgente, lascialo collegato; l'esportatore lo taglierà o riempirà come configurato.

Immagine di riferimento#

Questo gruppo prepara l'immagine target per la guida dell'identità. ImageResizeKJv2 (#225) allinea l'immagine alla risoluzione di rendering, CLIPVisionLoader (#178) carica lo scheletro di visione, e WanVideoClipVisionEncode (#189) produce incorporamenti di visione CLIP. Usa un'immagine pulita e ben illuminata con l'inquadratura desiderata; la visione CLIP preserva l'identità del soggetto, i segnali di abbigliamento e la composizione in modo che il video generato segua il tuo look.

Calcolo di faccia e pose#

Il flusso di lavoro supporta più pipeline di pose per robustezza. OnnxDetectionModelLoader (#204) con PoseAndFaceDetection (#235, #249) estrae pose del corpo intero più ritagli di facce dal video di guida. In parallelo, il rilevamento basato su YOLO delle regioni (YOLOModelLoader (#327, #387) con BBoxYOLO (#324, #379, #395)) alimenta SDPoseKeypointExtractor (#326, #383, #384) per punti chiave alternativi. Un percorso di ri-targeting delle proporzioni usando BodyRatioMapperProportionTransfer (#388) adatta il movimento tra diverse proporzioni corporee e rende una mappa di pose pulita tramite BodyRatioMapperSDPoseRender (#391). Un interruttore booleano ti permette di bypassare la guida facciale per attori completamente mascherati o con casco in modo da evitare conflitti di espressioni.

Caricamento del modello#

WanVideoVAELoader (#277) e WanVideoModelLoader (#287) portano nel backbone Wan2.2 Animate e VAE. Due nodi WanVideoLoraSelectMulti (#248, #276) ti permettono di impilare LoRAs per guida di stile, velocità, rilighting, o inpainting, e WanVideoSetBlockSwap (#290) configura il block swapping compatibile con la memoria per clip lunghi. WanVideoContextOptions (#270) imposta finestre di contesto temporale e passo in modo che il modello veda abbastanza fotogrammi vicini per rimanere stabile senza eccessivo smussamento dell'azione.

Guida della telecamera e della struttura Uni3C#

Quando hai bisogno di un comportamento della telecamera più stabile o di vincoli di scena, abilita il percorso Uni3C. WanVideoUni3C_ControlnetLoader (#345) carica il modello di controllo, WanVideoEncode (#346) converte i fotogrammi in latenti per il condizionamento, e WanVideoUni3C_embeds (#344) genera incorporamenti Uni3C la cui forza puoi regolare. Questa guida è fusa nella catena di rendering principale per stabilizzare panoramiche, zoom o scene di grande movimento.

Campionamento e rendering#

WanVideoAnimateEmbeds (#295) fonde identità della visione CLIP, mappe di pose e ritagli di facce in incorporamenti di immagini mentre controlli pose_strength e face_strength. Il renderer principale opera in due fasi con WanVideoSampler (#222, #367); un interruttore sceglie il ramo guidato da Uni3C quando abilitato, altrimenti il ramo standard. Dopo il campionamento, WanVideoDecode (#246) trasforma i latenti in immagini e le utility di selezione dei fotogrammi li indirizzano all'esportazione. Il flusso di lavoro bilancia lunghezza del contesto, passo e memoria in modo che tu possa rendere sequenze lunghe in modo affidabile.

Esportazione#

Sono inclusi due esportatori. VideoCombineNode (#330) fornisce un'esportazione MP4 compatta con taglio opzionale all'audio. VHS_VideoCombine (#285) offre un'interfaccia più ricca per frame rate, CRF, pix_fmt e denominazione dell'output; supporta anche il passaggio diretto dell'audio. Un'utilità di compressione può comprimere tutti i fotogrammi se preferisci sequenze di immagini per il lavoro post.

Utility di batch e helper#

Un piccolo cluster gestisce la matematica dei fotogrammi, i ripetuti e i conteggi in modo che i batch di riferimento corrispondano alla lunghezza della sequenza target. Utility come ImageFromBatch (#181), ImageBatch (#304), BatchCount+ (#308, #314), e easy mathInt (#309) mantengono le lunghezze sincronizzate per un condizionamento fluido attraverso il clip. I nodi di igiene VRAM liberano la memoria tra i passaggi pesanti per ridurre gli errori di memoria esaurita durante i rendering lunghi.

Nodi chiave nel flusso di lavoro ComfyUI Wan2.2 Trasferimento Azione Animata#

VHS_LoadVideo(#275). Carica il video di guida ed estrae l'audio. Usa il limite di frame quando testi o iteri; una volta che blocchi l'aspetto e il movimento, rimuovi il limite per rendering a lunghezza intera. Mantieni il FPS originale se vuoi che il movimento sembri identico alla fonte, o forza un nuovo FPS se hai bisogno di una cadenza di consegna specifica.WanVideoAnimateEmbeds(#295). Combina identità (visione CLIP), pose e segnali di faccia in incorporamenti che guidano il modello. Regolapose_strengthper decidere quanto strettamente il movimento segua la fonte eface_strengthper dare priorità alla somiglianza facciale; una forza facciale più bassa può aiutare personaggi stilizzati, anime o animali.WanVideoContextOptions(#270). Configura finestra di contesto temporale, passo e sovrapposizione che controllano quanti fotogrammi vicini il modello considera. Un contesto più grande produce una continuità più fluida; un contesto più breve può preservare cambiamenti nitidi in azioni veloci. Mantieni le impostazioni del contesto coerenti quando cambi FPS o risoluzione.WanVideoUni3C_embeds(#344). Genera guida opzionale della telecamera/struttura. Aumentastrengthquando vedi oscillazione della telecamera o zoom indesiderati; diminuiscila se la guida inizia a contrastare il tuo inquadramento creativo.WanVideoLoraSelectMulti(#276). Impila Wan LoRAs per stile, velocità, rilighting, o inpainting. Inizia con un LoRA a una forza moderata, quindi aggiungi ulteriori solo se necessario; fondere troppi LoRAs forti può destabilizzare l'identità.WanVideoSampler(#367). Il campionatore di diffusione principale per Wan2.2 Animate. Scheduler, forza di denoise e conteggio dei passi interagiscono; aumentare i passi migliora il dettaglio ma richiede tempo, mentre un denoise più alto aumenta la riscrittura del movimento. Se usi Uni3C, regola la sua forza prima di aumentare i passi.PoseAndFaceDetection(#235). Estrae pose del corpo intero e ritagli di facce dal video di guida. Lascia l'interruttore “mask/helmet actor” spento a meno che il volto del performer sia completamente oscurato; abilitarlo su volti visibili può attenuare le espressioni.VHS_VideoCombine(#285). Esportatore MP4 di alta qualità con supporto audio. Usatrim_to_audioper sincronizzare rigidamente il video alla musica o al dialogo e regolacrfper il compromesso dimensione/qualità. Mantienipix_fmta un valore amichevole per la trasmissione se stai consegnando a editor o piattaforme social.

Extra opzionali#

- Prepara input: usa un'immagine target pulita e ben illuminata e un clip di guida con sfocatura del movimento minima per i migliori punti chiave.

- Abbina il rapporto d'aspetto: scegli 16:9 o 9:16 presto; il flusso di lavoro scala automaticamente le immagini in modo che il video finale non abbia letterboxing inaspettato.

- Suggerimenti per la stabilità: se vedi derapate di braccia o gambe, aumenta

pose_strength; se l'identità derapa, aumenta l'influenza della visione CLIP o semplifica l'impilamento LoRA. - Controllo della telecamera: abilita Uni3C solo quando hai bisogno di stabilizzazione della telecamera; tenerlo spento spesso produce il movimento più cinematografico quando la fonte è a mano libera.

- Iterazione: rendi brevi intervalli di fotogrammi prima, quindi esporta l'intera sequenza una volta che il movimento e l'aspetto sono regolati.

Questo flusso di lavoro Wan2.2 Trasferimento Azione Animata porta un trasferimento d'azione affidabile a ComfyUI con predefiniti pratici e spazio per crescere. Carica la tua immagine e video di guida, imposta forza di pose e facce, scegli Uni3C se necessario, ed esporta un MP4 raffinato.

Riconoscimenti#

Questo flusso di lavoro implementa e si basa sui seguenti lavori e risorse. Ringraziamo Wan-AI per il modello ufficiale Wan2.2 Animate, Kijai per i nodi ComfyUI Wan (ComfyUI-WanVideoWrapper e ComfyUI-WanAnimatePreprocess), e i team RunningHub e RunComfy per i flussi di lavoro ComfyUI condivisi per i loro contributi e manutenzione. Per dettagli autorevoli, si prega di fare riferimento alla documentazione originale e ai repository collegati di seguito.

Risorse#

- RunningHub/Workflow source

- Docs / Note di rilascio: RunningHub post

- RunComfy/Cloud Save workflow

- Docs / Note di rilascio: RunComfy shared workflow

- Wan-AI/Wan2.2 Animate official model

- Hugging Face: Wan-AI/Wan2.2-Animate-14B

- kijai/ComfyUI-WanVideoWrapper nodes

- GitHub: kijai/ComfyUI-WanVideoWrapper

- Kijai/Wan2.2 Animate FP8 ComfyUI model assets

- Hugging Face: Kijai/WanVideo_comfy_fp8_scaled

- kijai/ComfyUI-WanAnimatePreprocess nodes

Nota: L'uso dei modelli, set di dati e codice di riferimento è soggetto alle rispettive licenze e termini forniti dai loro autori e manutentori.