1. Flujo de trabajo de ComfyUI AnimateLCM#

El flujo de trabajo de ComfyUI AnimateLCM está diseñado para mejorar las velocidades de animación de IA. Basándose en los fundamentos de ComfyUI-AnimateDiff-Evolved, este flujo de trabajo incorpora AnimateLCM para acelerar específicamente la creación de animaciones de texto a video (t2v). Puedes experimentar con varios prompts y pasos para lograr los resultados deseados.

2. Resumen de AnimateLCM#

La llegada de tecnologías como SDXL, LCM y SDXL Turbo ha impulsado significativamente el ritmo de la generación de imágenes. AnimateLCM impulsa aún más el progreso en la animación de IA. Admite la generación rápida de imagen a video y está dirigido a mejorar la velocidad y eficiencia de producir videos animados a partir de imágenes estáticas o descripciones de texto, lo que lo hace particularmente útil para crear efectos de animación personalizados rápidamente.

2.1. Introducción a AnimateLCM#

AnimateLCM está diseñado para acelerar la animación de modelos de difusión personalizados y adaptadores a través del aprendizaje de consistencia desacoplado. Está inspirado en el Modelo de Consistencia (CM), que destila modelos de difusión de imágenes preentrenados para acelerar el proceso de muestreo, y su extensión, el Modelo de Consistencia Latente (LCM), que se enfoca en la generación de imágenes condicionales. AnimateLCM aprovecha estos fundamentos para permitir la creación de videos con alta fidelidad en pocos pasos, aprovechando el éxito de las técnicas de difusión y generación de imágenes para expandir sus capacidades al dominio del video.

2.2. Cómo usar AnimateLCM en tu flujo de trabajo de ComfyUI#

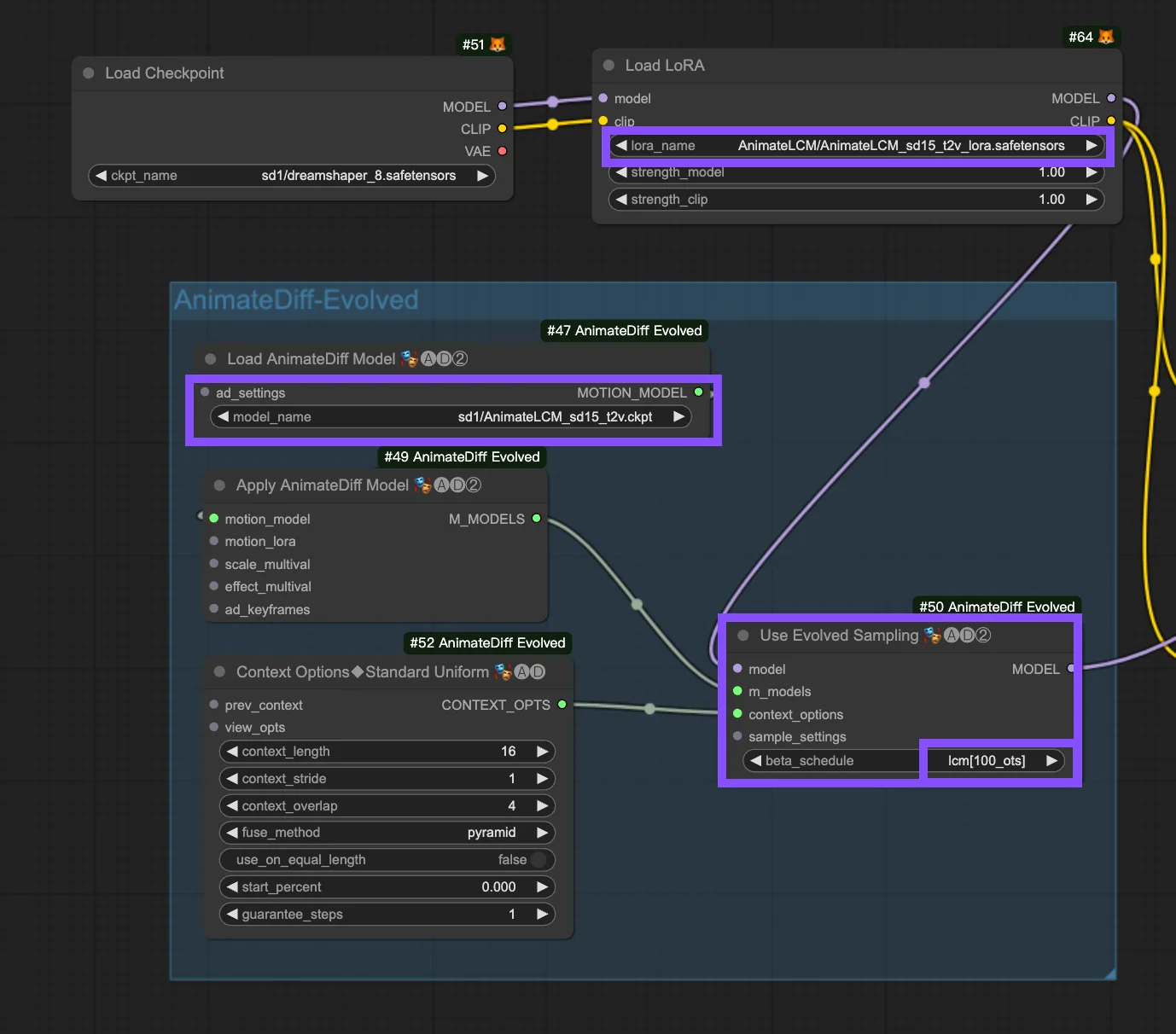

Este flujo de trabajo se basa en el flujo de trabajo ComfyUI-AnimateDiff-Evolved. Los siguientes son los parámetros de configuración en el nodo "Use Evolved Sampling".

Models: Establece el modelo de checkpoint y el modelo LoRA.

- Checkpoint: Esto se refiere a las entradas del modelo StableDiffusion (SD) utilizadas para la creación de animaciones. Dependiendo de los modelos de movimiento elegidos, la compatibilidad puede variar entre las versiones de SD, como SD1.5 o SDXL.

- LoRA: Incorpora el modelo AnimateLCM LoRA para integrar sin problemas los adaptadores existentes para una variedad de funciones, mejorando la eficiencia y la calidad de salida con un enfoque en el aprendizaje de consistencia sin sacrificar la velocidad de muestreo.

Motion Models (M Models): Estas son las salidas del proceso Apply AnimateDiff Model, que permiten el uso del modelo de movimiento AnimateLCM.

Context Options: Estas configuraciones ajustan la operación de AnimateDiff durante la producción de animación, permitiendo animaciones de cualquier duración a través de ventanas de contexto deslizantes en todo el Unet o específicamente dentro del módulo de movimiento. También permiten ajustes de tiempo para secuencias de animación complejas. Consulta aquí una guía completa sobre AnimateDiff

Beta Schedule in Sample Settings: Opta por LCM. Dentro de Sample Settings de AnimateDiff en ComfyUI, la selección de "beta schedule", que incluye opciones como "lcm", "lineart", etc., ajusta los valores beta que regulan los niveles de ruido a lo largo del proceso de difusión. Esta personalización afecta el estilo visual y la fluidez de la animación. Cada configuración se adapta a necesidades específicas de animación o modelos de movimiento.

- LCM (Módulo de consistencia latente): La configuración "lcm" está adaptada para LoRAs LCM, mejorando la uniformidad de la animación y reduciendo el tiempo de creación. Logra una convergencia más rápida con menos pasos, lo que requiere una reducción de pasos (a un mínimo de ~4 pasos) y otros ajustes de parámetros para una retención óptima de detalles.

- Linear (AnimateDiff-SDXL): Recomendado para AnimateDiff con módulos de movimiento SDXL, esta opción logra un equilibrio entre la preservación de detalles y el movimiento suave, lo que indica compatibilidad con versiones específicas de modelos de movimiento.

- Sqrt_lineart (AnimateDiff): Similar a "lineart", esta variante está diseñada para procesos AnimateDiff, especialmente con módulos de movimiento V2, modificando los niveles de ruido para complementar la salida del modelo de movimiento para transiciones o movimientos más fluidos.