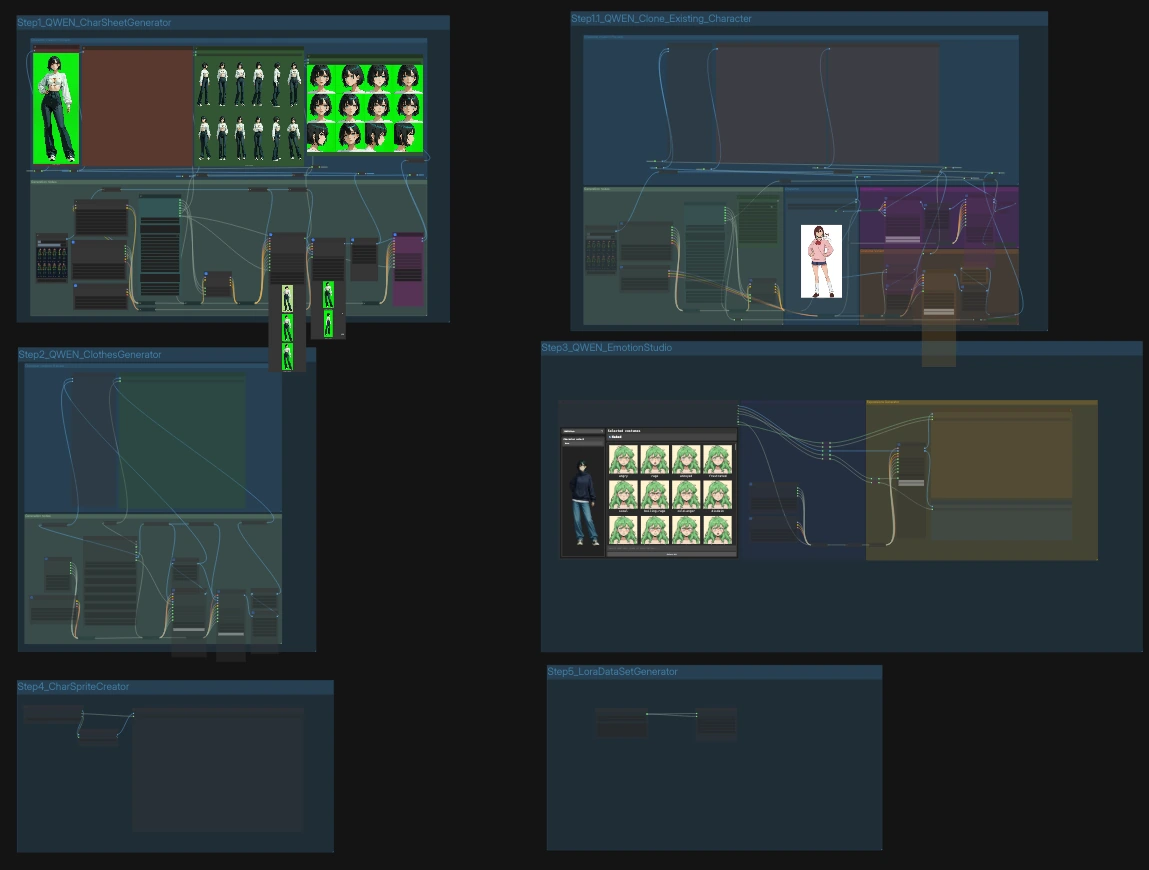

ComfyUI VNCCS Klonen Bestehender Charakter: Qwen-gestützter Visual-Novel-Charakterblatt-Ersteller#

Dieser ComfyUI VNCCS-Workflow verwandelt ein einzelnes Referenzbild in ein konsistentes Visual-Novel-Charakterblatt und ein Gesichtssatz, bereit für Sprites und nachgelagerte Nutzung. Er kombiniert VNCCS-Benutzerdefinierte Nodes mit Qwen Image-Komponenten, um die Identität zu bewahren, wendet RMBG-Bereinigung für saubere Kanten an und verwendet optionales SeedVR2-Hochskalierung, um gestochen scharfe Ausgaben im Blattmaßstab zu liefern.

Entwickelt für Künstler, VN-Teams und Toolschmiede, ermöglicht die ComfyUI VNCCS-Pipeline das Klonen eines bestehenden Charakters, das Generieren von Körperposen und Gesichtsausdrücken, das Erstellen von Kleidungsversionen und das Exportieren von sprite-bereiten PNGs mit Alpha. Sie steuern Eingabeaufforderungen, Seed und Blattlayout, während der Workflow Posenführung, Gesichtsverfeinerung und Hintergrundentfernung übernimmt.

Was Sie aus der Box bekommen

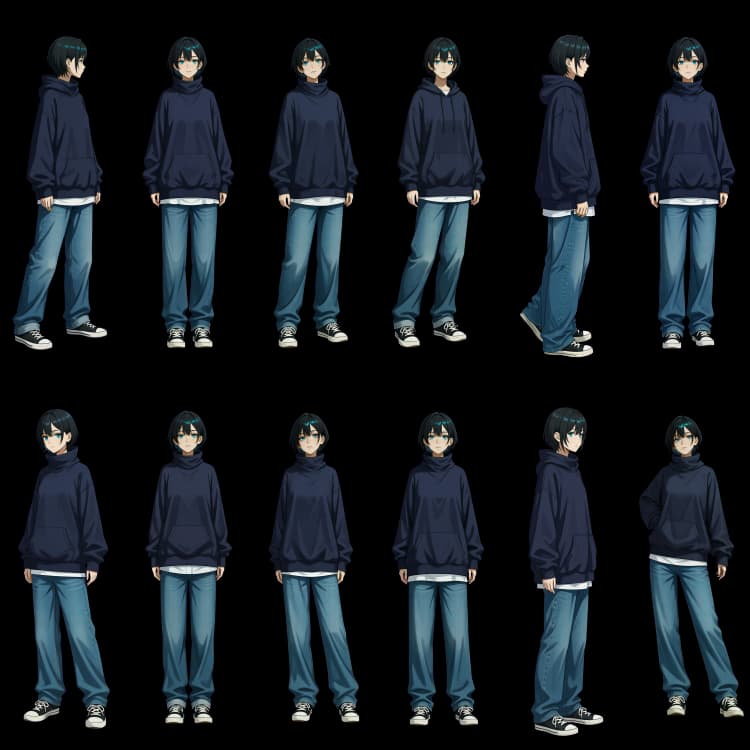

- Konsistentes Körpercharakterblatt plus ein gekachelter Gesichtssatz

- Optionale „Klonen aus Referenz“-Pfad für einen bestehenden Charakter

- Kleiderübertragung und Varianten-Generierung

- Ausdruckspakete für VNCCS-Stilgesichter

- Sprite-Schnitte mit transparenten Hintergründen und Datensatzausgaben für LoRA-Training

Schlüsselmodelle im ComfyUI VNCCS-Workflow#

- Qwen Image für ComfyUI. Verpackte Diffusionskomponenten, die hier verwendet werden, umfassen die Vision-Language-Encoder und den Qwen Image VAE, die identitätsbewahrende Bearbeitungen und Bildgenerierung leiten. Sie bieten starke Befolgung von Anweisungen aus Text, während visuelle Referenzen respektiert werden. Comfy-Org/Qwen-Image_ComfyUI

- Stable Diffusion XL (Basis). Verwendet als robustes Vorwissen für Stilschichtung und posenbedingte Synthese in Hilfsstufen, trägt SDXL zu hochauflösenden Details und Kompatibilität mit ControlNet-Konditionierung bei. stabilityai/stable-diffusion-xl-base-1.0

- ControlNet OpenPose. Der OpenPose-Zweig bietet Keypoint-Führung, die Anatomie über Posen hinweg fixiert, sodass Ihre ComfyUI VNCCS-Blätter konsistent von Bild zu Bild ausgerichtet sind. ControlNet (offizielles Repo)

- Ultralytics YOLOv8 Face. Ein schneller und genauer Detektor, der vom Gesichtverfeinerungspfad verwendet wird, um Gesichter zu lokalisieren, bevor sie verbessert werden, und die Identitätsbeibehaltung im ComfyUI VNCCS-Gesichtssatz zu verbessern. ultralytics/ultralytics

- VNCCS LoRA-Bundle. Zweckgebundene LoRAs (Posenhelfer, Kleiderübertragung, Emotionenkern usw.), die für VN-Charakterblätter abgestimmt sind; diese stabilisieren Proportionen, Kleidungslogik und Ausdrucksstruktur über die Schritte hinweg. MIUProject/VNCCS

- VNCCS-Benutzerdefinierte Nodes. Der Workflow basiert auf der offiziellen VNCCS ComfyUI-Erweiterung für den Encoder, Blattmanager, Maskenwerkzeuge und Dienstprogramme, die die Teile zu einer produktionsreifen Pipeline verbinden. AHEKOT/ComfyUI_VNCCS

Wie man den ComfyUI VNCCS-Workflow verwendet#

Gesamtfluss

- Der Graph hat fünf beschriftete Schritte, die unabhängig oder in Folge ausgeführt werden können. Schritt 1 erstellt ein Charakterblatt; Schritt 1.1 klont aus einer Referenz; Schritt 2 generiert Kleidungsversionen; Schritt 3 erstellt Ausdrücke; Schritt 4 schneidet Sprites; Schritt 5 schreibt Datensatzgerüst für LoRA-Training. Jeder Schritt bietet einige fokussierte Eingaben, während der Rest für Wiederholbarkeit vorverdrahtet ist.

Schritt 1.1 — Vorhandenen Charakter klonen#

Verwenden Sie dies, wenn Sie ein oder mehrere Referenzbilder haben. Legen Sie Ihr Bild in LoadImage (#808) ein und geben Sie bei Bedarf eine kurze Anweisung wie gewünschte Pose oder Rahmen an. Der Kern-Fuser VNCCS_QWEN_Encoder (#724) mischt die Referenz mit Ihrer Eingabeaufforderung und erstellt eine posebewusste Konditionierung, während die Identität erhalten bleibt. VNCCS_RMBG2 (#700) entfernt den Hintergrund und VNCCSSheetManager (#702) komponiert ein sauberes Blatt; Face Detailer verfeinert Gesichter für Konsistenz. Führen Sie die Gruppe aus, um ein Charakterblatt und Gesichtssatz in die vorangestellten Ordner zu speichern.

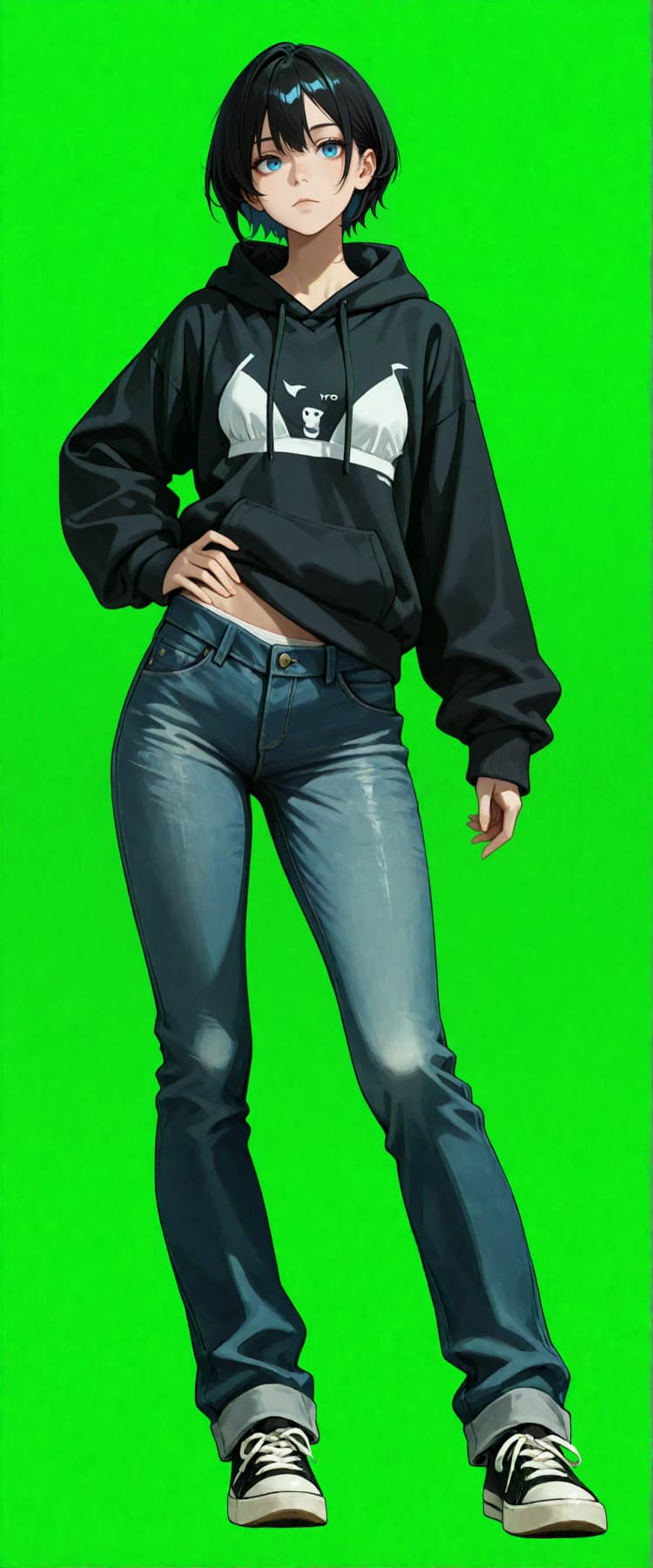

Schritt 1 — Ein Charakterblatt aus Schiebereglern und Eingabeaufforderungen erzeugen#

Wenn Sie einen parametergetriebenen Start bevorzugen, bietet das CharacterCreator (#499) Widget Ihnen Alters-, Körper-, Augen-, Haar- und negative Eingabeaufforderungssteuerungen sowie einen festen Seed für Reproduzierbarkeit. Ein VNCCS_PoseGenerator (#585) erzeugt ein OpenPose-Raster, das Proportionen verankert. Die Pipeline kodiert diese Anleitung durch VNCCS_QWEN_Encoder (#570), entfernt den Hintergrund, komponiert das Blatt und speichert sowohl das vollständige Blatt als auch einen gekachelten Gesichtssatz. Verwenden Sie diesen Pfad, um ein Grundaussehen zu etablieren, dem die restlichen ComfyUI VNCCS-Schritte folgen werden.

Schritt 2 — Kleidungsgenerator und Übertragung#

Zeigen Sie CharacterAssetSelectorQWEN (#865) auf das Blatt, das Sie kleiden möchten, und definieren Sie einen einfachen Kostümtext (zum Beispiel "Wintermantel, Schal, Stiefel"). Der Workflow extrahiert eine saubere Maske mit VNCCS_MaskExtractor (#869/#870), mischt die Kleidungsanweisung mit Ihrem vorherigen Blatt in VNCCS_QWEN_Encoder (#620) und wendet Chroma Key-Bereinigung in VNCCSChromaKey (#874) an. VNCCSSheetManager komponiert das bekleidete Ergebnis in ein konsistentes Blatt. Speichern Sie Ausgaben, die für einfaches Sortieren neben Ihrem Original vorangestellt sind.

Schritt 3 — Ausdrucksstudio#

EmotionGeneratorV2 (#960) erstellt eine Bank von Ausdrücken und gibt sowohl Gesichtsausschnitte als auch pro Emotion Ausgabewege aus. Gesichter werden mit einem YOLOv8-Pfad lokalisiert und über den Face Detailer-Node 803a797b-… (#821) verbessert, um sicherzustellen, dass Identität und Stil zu Ihrem ComfyUI VNCCS-Blatt passen. Die Ergebnisse fließen in VNCCSSheetManager (#820), das ein verfeinertes Gesichtsblatt komponiert, und in einen zweiten Speicher, der pro Emotion PNGs mit Alpha für Sprites und Datensätze exportiert. Verwenden Sie die Emotionsliste, um Ziele hinzuzufügen, zu entfernen oder umzubenennen, bevor Sie ausführen.

Schritt 4 — Sprite-Ersteller#

Speisen Sie Ihre fertigen Blätter in SpriteGenerator (#962) ein, um Sprite-Frames in einheitlichen Zuschnittgrößen zu erstellen. CharacterSheetCropper (#961) segmentiert automatisch die Körper- und Gesichtskacheln in gebrauchsfertige PNGs mit Transparenz. Der Speicher-Node (SaveImage, #963) schreibt das Sprite-Set in einen mit Zeitstempel versehenen Ordner, sodass Sie versionieren und vergleichen können.

Schritt 5 — Datensatz und Notizen#

Wenn Sie feinabstimmen oder archivieren möchten, erstellt DatasetGenerator (#965) eine beschriftete Ordnerstruktur und Save Text File (#964) schreibt eine Begleitnotiz oder Eingabeaufforderungsdatei. Dies hält Ihre ComfyUI VNCCS-Läufe reproduzierbar und portabel zwischen Projekten.

Schlüssel-Nodes im ComfyUI VNCCS-Workflow#

VNCCS_QWEN_Encoder (#570)#

Das Identitäts-Arbeitstier, das Referenzbilder mit Ihrer textlichen Absicht verschmilzt. Es akzeptiert bis zu drei Bilder plus eine Eingabeaufforderung und gibt sowohl positive/negative Konditionierung als auch ein Latent zurück, das nachgeschaltete Sampler verwenden, um Proportionen und Gesichtszüge zu bewahren. Passen Sie prompt an, um Stil oder Pose zu steuern, und justieren Sie target_size, wenn Sie zwischen quadratischen Porträts und hohen, ganzkörperlichen Blättern wechseln, damit das Kacheln über die Schritte hinweg konsistent bleibt.

EmotionGeneratorV2 (#960)#

Ein hochrangiger Controller für Ausdrucksbatches. Er gibt eine Liste von Emotionen, ein Raster von Kandidatengesichtern und passende Ausgabewege aus, sodass die Speicher-Nodes Dateien korrekt markieren. Ändern Sie die Emotionsliste, um den Bedürfnissen Ihres VNs zu entsprechen, halten Sie den Seed stabil für A/B-Tests und kombinieren Sie ihn mit dem Gesichtverfeinerungspfad, um die Identität bei starken Ausdrücken durchzusetzen.

CharacterAssetSelectorQWEN (#865)#

Ein Bequemlichkeitspanel, das den Graph auf Ihre vorhandenen Assets zeigt. Legen Sie den Blattpfad, den Gesichtspfad und optionalen Kostümtext fest, und es verdrahtet diese für Sie in den Kleidungsgenerator und Variantenäste. Halten Sie den seed hier synchron mit dem Schritt, den Sie iterieren, und organisieren Sie Ihre Ordner so, dass der Selektor die neuesten ComfyUI VNCCS-Ausgaben ohne manuelles Neuverdrahten findet.

VNCCSSheetManager (#820)#

Der Blattkompositor, der in mehreren Schritten verwendet wird. Im „split“-Modus schneidet er ein Blatt in Gesichts- oder Körperkacheln für die Verarbeitung; im „compose“-Modus setzt er bereinigte Bilder wieder in ein einheitliches Raster zusammen. Passen Sie den Modus und die Kachelmaße an, um Ihre Ziel-Engine oder Sprite-Pipeline zu entsprechen, und wenden Sie ihn nach RMBG/Gesichtsverfeinerung an, um quadratische Pixel-Ausrichtung im gesamten ComfyUI VNCCS-Projekt zu garantieren.

Face Detailer (#821)#

Ein Verfeinerungspfad, der Gesichter (YOLOv8) erkennt, sie zuschneidet und sie unter Ihrer aktuellen Konditionierung neu generiert. Verwenden Sie ihn, wenn die Identität zwischen den Schritten driftet oder wenn starke Emotionen Artefakte einführen. Halten Sie die „emotion“-Wildcard mit dem Ausdruck, den Sie rendern, übereinstimmend, und führen Sie diesen Node nach Hochskalierung oder Hintergrundänderungen erneut aus, um scharfe, konsistente Gesichtszüge wiederherzustellen.

Optionale Extras#

- Referenzvorbereitung. Zum Klonen verwenden Sie ein einzelnes, gut beleuchtetes Bild auf einem soliden Hintergrund. Grün funktioniert am besten mit

VNCCSChromaKey, aber jede einheitliche Farbe ist in Ordnung. - Halten Sie Seeds stabil. Jeder Schritt bietet einen

seed-Eingang; verwenden Sie ihn über Läufe hinweg, um Kleidung oder Ausdrucksänderungen deterministisch zu vergleichen. - Blattmaßstab. Wenn Sie größere Blätter benötigen, aktivieren Sie die SeedVR2-Hochskaliererzweige vor dem Chromakeying und komponieren Sie dann mit

VNCCSSheetManager, um scharfe Kanten zu erhalten. - Dateihygiene. Der Workflow schreibt in klar benannte Präfixe (zum Beispiel VN_Character/Body_Refined, VN_Character/faces). Halten Sie diese pro Projekt, um das Mischen von Assets zu vermeiden.

- Wann man welchen Pfad verwendet. Schritt 1.1 ist für „Klonen aus Bild“, Schritt 1 ist für parametergetriebene Erstellung, Schritt 2 für Outfits, Schritt 3 für Ausdrücke, Schritt 4 für Sprite-Schnitte, Schritt 5 für Datensatzgerüst.

Ressourcen

- VNCCS-Benutzerdefinierte Nodes und Beispiele: AHEKOT/ComfyUI_VNCCS

- VNCCS LoRA-Bundle: MIUProject/VNCCS

- Qwen Image-Komponenten für ComfyUI: Comfy-Org/Qwen-Image_ComfyUI

- ControlNet OpenPose: ControlNet

- Ultralytics YOLOv8: ultralytics/ultralytics

- SDXL-Basis-Checkpoint: stabilityai/sdxl-base-1.0

Danksagungen#

Dieser Workflow implementiert und baut auf den folgenden Arbeiten und Ressourcen auf. Wir danken AHEKOT für das ComfyUI_VNCCS-Repository und das Workflow-JSON, MIUProject für das VNCCS-Modell-Bundle und Comfy-Org für die Qwen-Image_ComfyUI-Komponenten (CLIP-Encoder und VAE) für ihre Beiträge und Wartung. Für autoritative Details, konsultieren Sie bitte die Originaldokumentation und -repositories, die unten verlinkt sind.

Ressourcen#

- AHEKOT/ComfyUI_VNCCS

- GitHub: AHEKOT/ComfyUI_VNCCS

- AHEKOT/VN_Step1.1_QWEN_Clone_Existing_Character_v1.json

- MIUProject/VNCCS

- Hugging Face: MIUProject/VNCCS/tree/main

- Comfy-Org/Qwen-Image_ComfyUI (CLIP encoder)

- Hugging Face: qwen_2.5_vl_7b_fp8_scaled.safetensors

- Comfy-Org/Qwen-Image_ComfyUI (VAE)

- Hugging Face: qwen_image_vae.safetensors

Hinweis: Die Nutzung der referenzierten Modelle, Datensätze und Codes unterliegt den jeweiligen Lizenzen und Bedingungen der Autoren und Betreuer.