Wan2.2 動作轉移 V7:ComfyUI 的動作到角色影片工作流程#

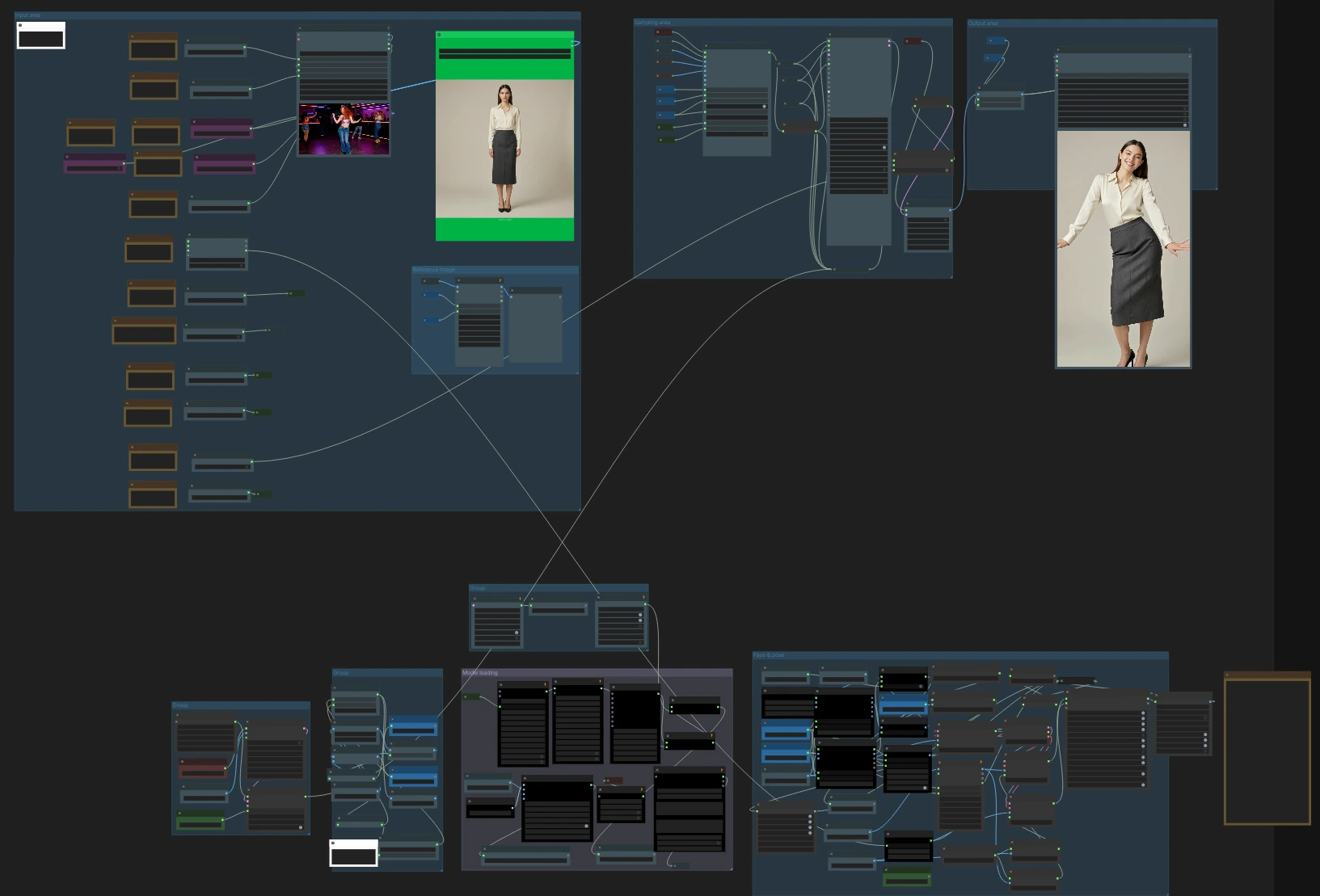

Wan2.2 動作轉移 V7 是一個 ComfyUI 影片工作流程,用於將動作從驅動影片轉移到目標角色或圖像上,同時保持身份、構圖和風格。基於 Wan2.2 動作轉移,結合姿勢、臉部、CLIP 視覺、Uni3C ControlNet 和堆疊的 Wan LoRA 指導,生成可編輯或發佈的 MP4。

此 Wan2.2 動作轉移工作流程非常適合想要 RunComfy 準備好的動作轉移設置的創作者,提供範例輸入和一致、可重複的結果。它處理姿勢和臉部條件、可選的相機指導、框架和比例工具,以及音頻傳遞,讓您可以專注於表演和外觀指導。

ComfyUI Wan2.2 動作轉移工作流程中的關鍵模型#

- Wan2.2 動作 14B。核心影片擴散模型,生成由身份、姿勢和文本嵌入條件化的動作一致框架。模型卡

- Wan Video VAE (Wan 2.1)。高品質的影片框架潛在編碼/解碼,平衡 ComfyUI 中的細節和速度。資產

- CLIP Vision 編碼器 (ViT-H/14 via OpenCLIP)。從目標圖像中提取身份和構圖線索,以保持主題在框架中的穩定性。Repo

- ViTPose Whole-Body。可靠的身體、手和臉部關鍵點估計,以驅動準確的動作轉移。Paper

- YOLOv10 檢測器。用於在關鍵點提取和比例映射之前定位身體的檢測。Repo

- SDPose Whole-Body 提取器。集成的替代全身關鍵點後端,用於多策略姿勢分析。Repo

- Uni3C ControlNet 用於影片 (via WanVideoWrapper)。可選的結構指導,在渲染期間穩定相機和場景約束。Repo

如何使用 ComfyUI Wan2.2 動作轉移工作流程#

從高層次上來看,您需要加載一個目標角色圖像和一個驅動影片,工作流程提取姿勢和臉部信號,使用 CLIP 視覺編碼身份,可選擇應用 Uni3C 相機指導和 Wan LoRAs,然後使用 Wan2.2 動作轉化為框架,並匯出帶或不帶源音頻的 MP4。

輸入區域#

在 VHS_LoadVideo (#275) 中加載您的驅動影片,在 LoadImage (#299) 中加載您的目標角色圖像。影片加載器管理幀速率上限、可選音頻提取和基本選擇控制;圖像加載器用作身份和構圖參考。比例工具會自動計算您選擇的方向的寬度和高度,使輸出匹配 16:9 或 9:16 而不失真。如果您計劃保留源音頻,請保持連接;匯出器將根據配置進行修剪或填充。

參考圖像#

此組準備目標圖像以進行身份指導。ImageResizeKJv2 (#225) 將圖像對齊到渲染分辨率,CLIPVisionLoader (#178) 加載視覺骨幹,WanVideoClipVisionEncode (#189) 生成 CLIP 視覺嵌入。使用乾淨、光線良好的圖像,具有所需的構圖;CLIP 視覺保留主體身份、服裝線索和構圖,因此生成的影片遵循您的外觀。

臉部和姿勢計算#

工作流程支持多個姿勢管道以提高穩健性。OnnxDetectionModelLoader (#204) 與 PoseAndFaceDetection (#235, #249) 提取驅動影片的全身姿勢和臉部裁剪。與此同時,基於 YOLO 的區域檢測(YOLOModelLoader (#327, #387) 與 BBoxYOLO (#324, #379, #395))將 SDPoseKeypointExtractor (#326, #383, #384) 用於替代關鍵點。一個比例重新定向路線使用 BodyRatioMapperProportionTransfer (#388) 在不同的身體比例之間適應運動,並通過 BodyRatioMapperSDPoseRender (#391) 渲染乾淨的姿勢圖。布爾開關讓您可以為完全遮蔽或戴頭盔的演員繞過臉部指導,從而避免表情衝突。

模型加載#

WanVideoVAELoader (#277) 和 WanVideoModelLoader (#287) 引入 Wan2.2 動作骨幹和 VAE。兩個 WanVideoLoraSelectMulti 節點 (#248, #276) 允許您堆疊 LoRAs 以進行風格、速度、重新照明或修補指導,WanVideoSetBlockSwap (#290) 配置記憶體友好的塊交換以處理長片段。WanVideoContextOptions (#270) 設置時間上下文窗口和步幅,以便模型看到足夠的相鄰幀以保持穩定,而不會過度平滑動作。

Uni3C 相機和結構指導#

當您需要更穩定的相機行為或場景約束時,啟用 Uni3C 路徑。WanVideoUni3C_ControlnetLoader (#345) 加載控制模型,WanVideoEncode (#346) 將框架轉換為潛在條件,WanVideoUni3C_embeds (#344) 生成可調強度的 Uni3C 嵌入。此指導與主渲染鏈合併,以穩定平移、縮放或大動作場景。

取樣和渲染#

WanVideoAnimateEmbeds (#295) 將 CLIP 視覺身份、姿勢圖和臉部裁剪融合為圖像嵌入,同時您可以控制 pose_strength 和 face_strength。主渲染器在兩個階段運行,使用 WanVideoSampler (#222, #367);一個開關選擇啟用時的 Uni3C 指導分支,否則為標準分支。取樣後,WanVideoDecode (#246) 將潛在轉換為圖像,幀選擇工具將其路由到匯出。工作流程平衡上下文長度、步幅和記憶體,因此您可以可靠地渲染長序列。

匯出#

包含兩個匯出器。VideoCombineNode (#330) 提供緊湊的 MP4 匯出,帶有可選的音頻修剪。VHS_VideoCombine (#285) 提供豐富的界面,用於幀速率、CRF、pix_fmt 和輸出命名;它還支持直接的音頻傳遞。壓縮工具可以壓縮所有幀,如果您更喜歡用於後期工作的圖像序列。

批處理工具和助手#

一個小集群管理幀數、重複和計數,以便參考批次與目標序列長度匹配。工具如 ImageFromBatch (#181)、ImageBatch (#304)、BatchCount+ (#308, #314) 和 easy mathInt (#309) 保持長度同步,以便在整個片段中平滑條件。VRAM 清理節點在繁重步驟之間清除記憶體,以減少長時間渲染期間的內存不足錯誤。

ComfyUI Wan2.2 動作轉移工作流程中的關鍵節點#

VHS_LoadVideo(#275)。加載驅動影片並提取音頻。測試或迭代時使用幀上限;一旦您鎖定外觀和動作,移除上限以進行完整長度渲染。如果您希望運動感覺與源相同,請保持原始 FPS;如果您需要特定的交付節奏,則強制新的 FPS。WanVideoAnimateEmbeds(#295)。將身份(CLIP 視覺)、姿勢和臉部信號結合為驅動模型的嵌入。調整pose_strength以決定運動如何緊密地跟隨源,調整face_strength以優先考慮臉部相似性;降低臉部強度可以幫助風格化的動漫或動物角色。WanVideoContextOptions(#270)。配置時間上下文窗口、步幅和重疊,控制模型考慮多少相鄰幀。更大的上下文產生更平滑的連續性;較短的上下文可以保持快速動作中的清晰變化。當您更改 FPS 或分辨率時,請保持上下文設置一致。WanVideoUni3C_embeds(#344)。生成可選的相機/結構指導。當您看到相機抖動或非預期縮放時增加strength;如果指導開始與您的創意構圖相衝突,則減少它。WanVideoLoraSelectMulti(#276)。堆疊 Wan LoRAs 以進行風格、速度、重新照明或修補。以中等強度開始一個 LoRA,然後僅在需要時堆疊額外的;合併過多強大的 LoRA 可能會破壞身份。WanVideoSampler(#367)。Wan2.2 動作的主要擴散取樣器。調度器、去噪強度和步數相互作用;增加步數提高細節但需要更多時間,而更高的去噪增加運動重寫。如果使用 Uni3C,請在提高步數之前調整其強度。PoseAndFaceDetection(#235)。從驅動影片中提取全身姿勢和臉部裁剪。除非表演者的臉部完全被遮擋,否則請保持“面具/頭盔演員”開關關閉;在可見臉部上啟用它可能會靜音表情。VHS_VideoCombine(#285)。支持音頻的高品質 MP4 匯出器。使用trim_to_audio將影片與音樂或對話進行硬同步,調整crf以平衡大小/質量。如果您要交付給編輯或社交平台,請保持pix_fmt在廣播友好的值。

可選額外功能#

- 準備輸入:使用乾淨、光線均勻的目標圖像和運動模糊最小的驅動片段以獲得最佳關鍵點。

- 匹配比例:早期選擇 16:9 或 9:16;工作流程自動縮放圖像,以便最終影片不會意外地出現信箱。

- 穩定性提示:如果您的手臂或腿漂移,增加

pose_strength;如果身份漂移,提高 CLIP 視覺影響或簡化 LoRA 堆疊。 - 相機控制:僅在需要相機穩定時啟用 Uni3C;當源為手持時,保持關閉通常會產生最具電影感的運動。

- 迭代:先渲染短幀範圍,然後在運動和外觀調整到位後匯出完整序列。

這個 Wan2.2 動作轉移工作流程為 ComfyUI 帶來了可靠的動作轉移,具有實用的預設和成長空間。加載您的圖像和驅動影片,設置姿勢和臉部強度,選擇是否需要 Uni3C,並匯出一個精緻的 MP4。

致謝#

此工作流程實施並建立在以下作品和資源之上。我們對 Wan-AI 的 Wan2.2 動作官方模型表示感謝,對 Kijai 的 ComfyUI Wan 節點(ComfyUI-WanVideoWrapper 和 ComfyUI-WanAnimatePreprocess)表示感謝,對 RunningHub 和 RunComfy 團隊對其貢獻和維護表示感謝。欲了解權威詳細信息,請參考下面鏈接的原始文檔和存儲庫。

資源#

- RunningHub/Workflow source

- Docs / Release Notes: RunningHub post

- RunComfy/Cloud Save workflow

- Docs / Release Notes: RunComfy shared workflow

- Wan-AI/Wan2.2 Animate official model

- Hugging Face: Wan-AI/Wan2.2-Animate-14B

- kijai/ComfyUI-WanVideoWrapper nodes

- GitHub: kijai/ComfyUI-WanVideoWrapper

- Kijai/Wan2.2 Animate FP8 ComfyUI model assets

- Hugging Face: Kijai/WanVideo_comfy_fp8_scaled

- kijai/ComfyUI-WanAnimatePreprocess nodes

Note: 使用所引用的模型、數據集和代碼須遵守其作者和維護者提供的各自許可和條款。