Qwen Image 2512 LoRA 推理:管道對齊、訓練匹配的 AI Toolkit 生成於 ComfyUI#

這個準備投入生產的 RunComfy 工作流程將 AI Toolkit 訓練的 LoRA 應用於 Qwen Image 2512 在 ComfyUI 中,重點是 訓練匹配 的行為。它以 RC Qwen Image 2512 (RCQwenImage2512) 為中心——這是一個由 RunComfy 構建的開源自定義節點(source)運行一個 Qwen 原生推理管道(而不是通用的採樣器圖),並通過 lora_path 和 lora_scale 加載您的適配器。

為什麼 Qwen Image 2512 LoRA 推理在 ComfyUI 中通常看起來不同#

AI Toolkit 的 Qwen Image 2512 預覽是由特定於模型的管道生成的,包括 Qwen 的“真實 CFG”指導行為以及該管道用於條件和採樣的默認設置。如果您將相同的工作重建為標準的 ComfyUI 採樣器圖,指導語義和 LoRA 補丁點可能會發生變化,因此“相同的提示 + 相同的種子 + 相同的步驟”仍可能導致不同的結果。實際上,許多“我的 LoRA 與訓練不匹配”的報告是管道不匹配,而不是缺少一個參數。

RCQwenImage2512 通過將 Qwen Image 2512 管道包裝在節點內並通過 lora_path 和 lora_scale 在該管道中應用 LoRA,保持推理對齊。管道來源:`src/pipelines/qwen_image.py`。

如何使用 Qwen Image 2512 LoRA 推理工作流程#

步驟1:打開工作流程#

在 ComfyUI 中啟動雲工作流程。

步驟2:導入您的 LoRA(2 種選擇)#

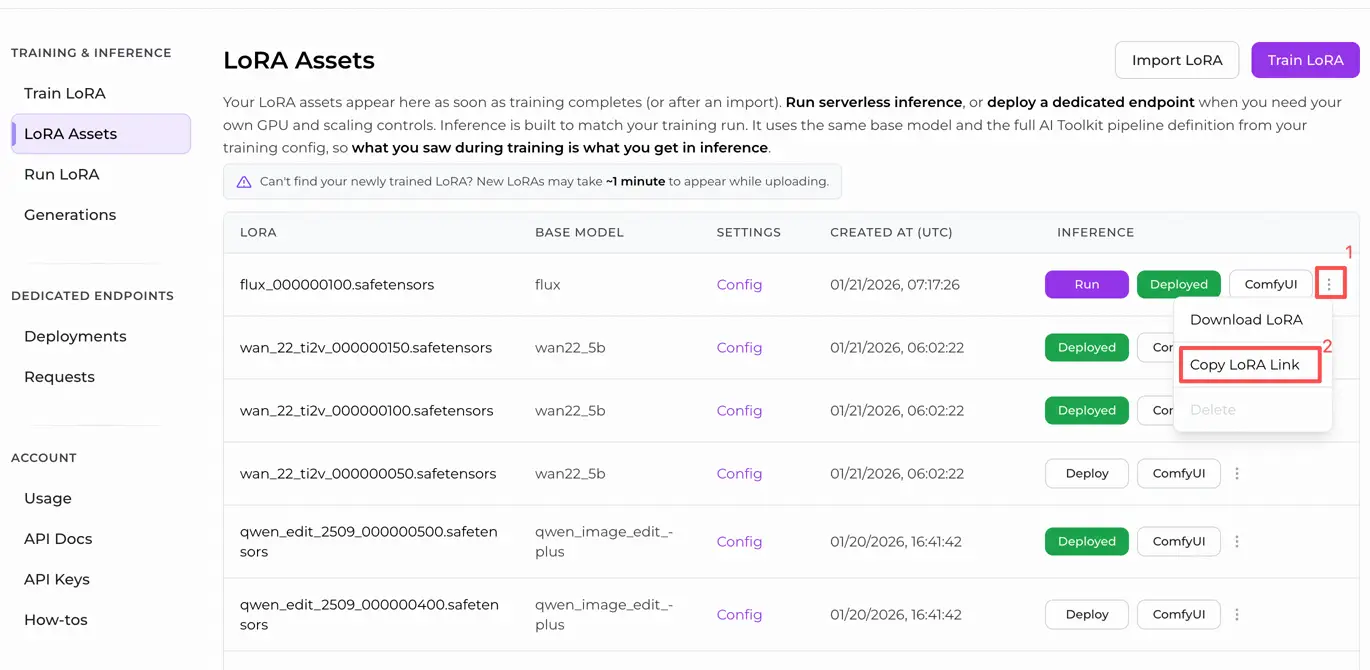

- 選項 A(RunComfy 訓練結果): RunComfy → Trainer → LoRA 資產 → 找到您的 LoRA → ⋮ → 複製 LoRA 鏈接

- 選項 B(AI Toolkit LoRA 在 RunComfy 外訓練): 複製一個直接的

.safetensors下載鏈接給您的 LoRA 並將該 URL 粘貼到lora_path中(無需下載到ComfyUI/models/loras)

步驟3:配置 RCQwenImage2512 自定義節點以進行 Qwen Image 2512 LoRA 推理#

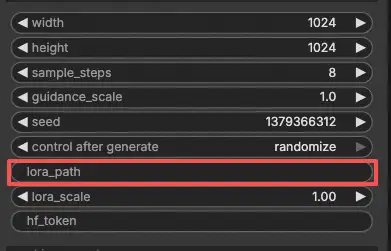

將您的 LoRA 鏈接粘貼到 RC Qwen Image 2512 (RCQwenImage2512) 的 lora_path 中。

然後設置剩餘的節點參數(首先匹配您在訓練期間用於預覽/樣本生成的值):

prompt:您的正面提示(包括您的 LoRA 期望的任何觸發詞)negative_prompt:可選;如果您在預覽中未使用負面,則保持空白width/height:輸出分辨率(建議此管道系列的 32 的倍數)sample_steps:推理步驟;調整前請鏡像您的預覽步數(25 是一個常見的基準)guidance_scale:指導強度(Qwen 使用“真實 CFG”比例,因此請首先重用您的預覽值)seed:在驗證對齊時鎖定種子,將 control_after_generate 設置為 'fixed',然後變更它以獲得新樣本lora_scale:LoRA 強度;從接近您的預覽值開始,然後小幅調整

這是一個文本到圖像的工作流程,因此您不需要提供輸入圖像。

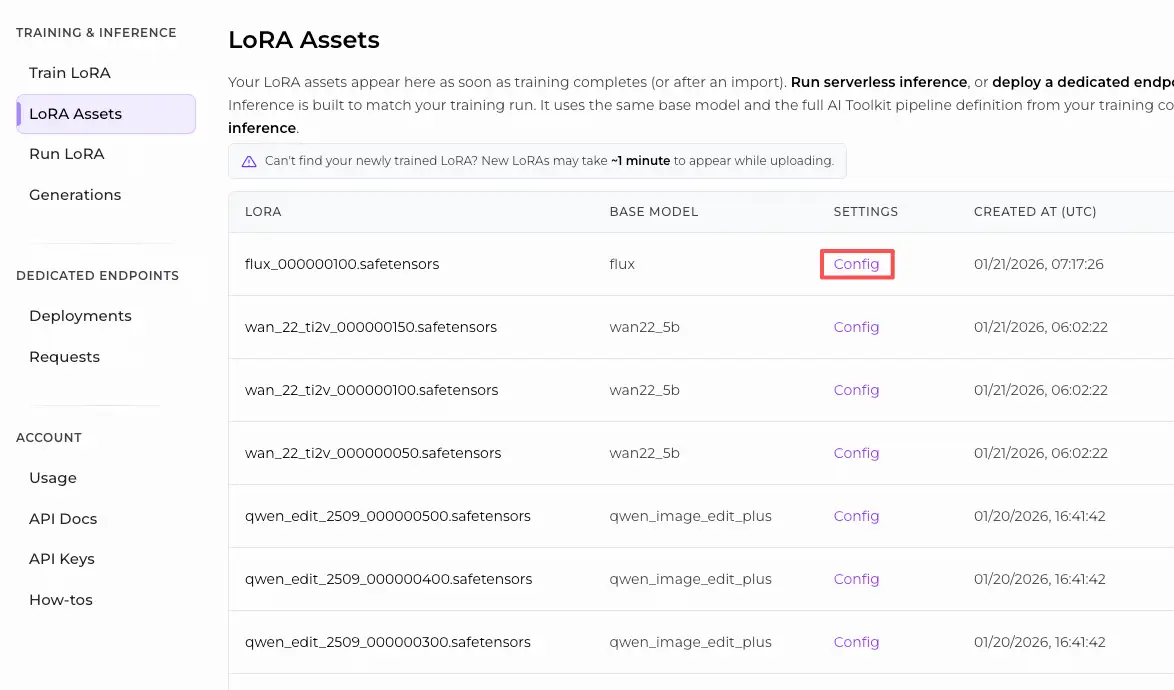

訓練對齊註釋:如果您在訓練期間自定義了採樣,請打開您的 AI Toolkit 訓練 YAML 並鏡像 width、height、sample_steps、guidance_scale、seed 和 lora_scale。如果您是在 RunComfy 上訓練的,請打開 Trainer → LoRA 資產 → 配置並將預覽/樣本值複製到 RCQwenImage2512 中,然後進行迭代。

步驟4:運行 Qwen Image 2512 LoRA 推理#

點擊 Queue/Run。SaveImage 節點將生成的圖像保存到您的標準 ComfyUI 輸出文件夾。

Qwen Image 2512 LoRA 推理的故障排除#

RunComfy 的 RC Qwen Image 2512 (RCQwenImage2512) 自定義節點旨在保持推理 管道對齊 與 Qwen Image 2512 預覽樣式的採樣,通過:

- 在節點內執行 Qwen 原生推理管道(而不是通用的採樣器圖),並

- 通過

lora_path+lora_scale在該管道內 注入 LoRA(一致的補丁點)。

(1)Qwen-Image Loras 在 comfyui 中不起作用#

為什麼這會發生

用戶報告說,AI Toolkit 訓練的 Qwen-Image LoRAs 在 ComfyUI 中可能無法應用,因為 LoRA 狀態字典鍵前綴與 ComfyUI 端加載器/推理路徑預期的不匹配(因此適配器“靜默”加載但實際上沒有補丁 Qwen 變壓器模組)。

如何修復(用戶驗證選項)

- 使用 RCQwenImage2512 進行管道級 LoRA 注入: 僅通過 RCQwenImage2512 上的

lora_path+lora_scale加載適配器(在調試時避免在上面堆疊額外的 LoRA 加載器節點)。這保持了 LoRA 補丁點與由預覽樣式採樣使用的 Qwen 管道對齊。 - 如果您必須使用非 RC 推理提供商/加載器路徑: 用戶報告的修復是將 LoRA 鍵的第一段前綴從

diffusion_model更改為transformer,以便權重映射到預期的 Qwen 變壓器模組(參見問題的具體背景和為什麼需要這樣做)。

(2)使用 inference_lora_path 與 qwen image 會導致崩潰的修補程序(允許使用 turbo lora 生成樣本)#

為什麼這會發生

一些用戶在嘗試通過 AI Toolkit 的 inference_lora_path 流加載 Qwen(包括 Qwen-Image-2512)的推理 LoRA 時遇到了崩潰。這不是“提示/CFG/種子”問題——這是一個推理加載路徑問題。

如何修復(用戶驗證)

- 應用修補程序/更新到包含問題中描述的修補程序的版本。 問題作者報告說,修補程序修復了在加載 Qwen 推理 LoRA 時的崩潰(請參見問題的具體更改和配置背景)。

- 針對 ComfyUI 推理具體: 優先選擇 RCQwenImage2512 並在 RC 節點內通過

lora_path/lora_scale加載適配器。這避免依賴外部推理 LoRA 加載路徑,並保持管道與預覽樣式採樣一致。

(3)使用 sageattention 2 qwen-image 在 comfyui 中顯示黑色圖像(即黑色圖像)#

為什麼這會發生

用戶報告說,在 ComfyUI 中運行 Qwen Image 與 SageAttention 可以產生 NaNs,這會轉化為 黑色圖像。這可能看起來像“我的 LoRA 壞了”,但實際上是注意力後端產生了無效值——管道執行在您能夠有效評估 LoRA 行為之前失敗。

如何修復(用戶驗證)

- 不要對 Qwen Image 使用

--use-sage-attention當它導致 NaNs/黑色輸出時。 首先驗證一個乾淨的基線(非黑色輸出),然後評估 LoRA 的影響。 - 如果您需要 SageAttention 提速: 通過強制 CUDA 後端路徑來修復 Qwen 黑色輸出。實際上,這通常意味著使用工作流程級別的修補(例如,“修補 Sage Attention”節點)並選擇一個 CUDA 後端變體,以避免受影響的 GPU/架構的損壞 Triton 路徑。

- 在您擁有穩定的(非黑色)基線輸出後,通過 RCQwenImage2512 運行 Qwen Image 2512 推理,以便在您匹配

width/height/sample_steps/guidance_scale/seed/lora_scale時保持管道 + LoRA 注入點預覽對齊。

現在運行 Qwen Image 2512 LoRA 推理#

打開共享工作流程,將您的 LoRA URL 粘貼到 lora_path 中,匹配您的預覽採樣值,然後運行 RCQwenImage2512 以獲得訓練匹配的 Qwen Image 2512 在 ComfyUI 中的生成。