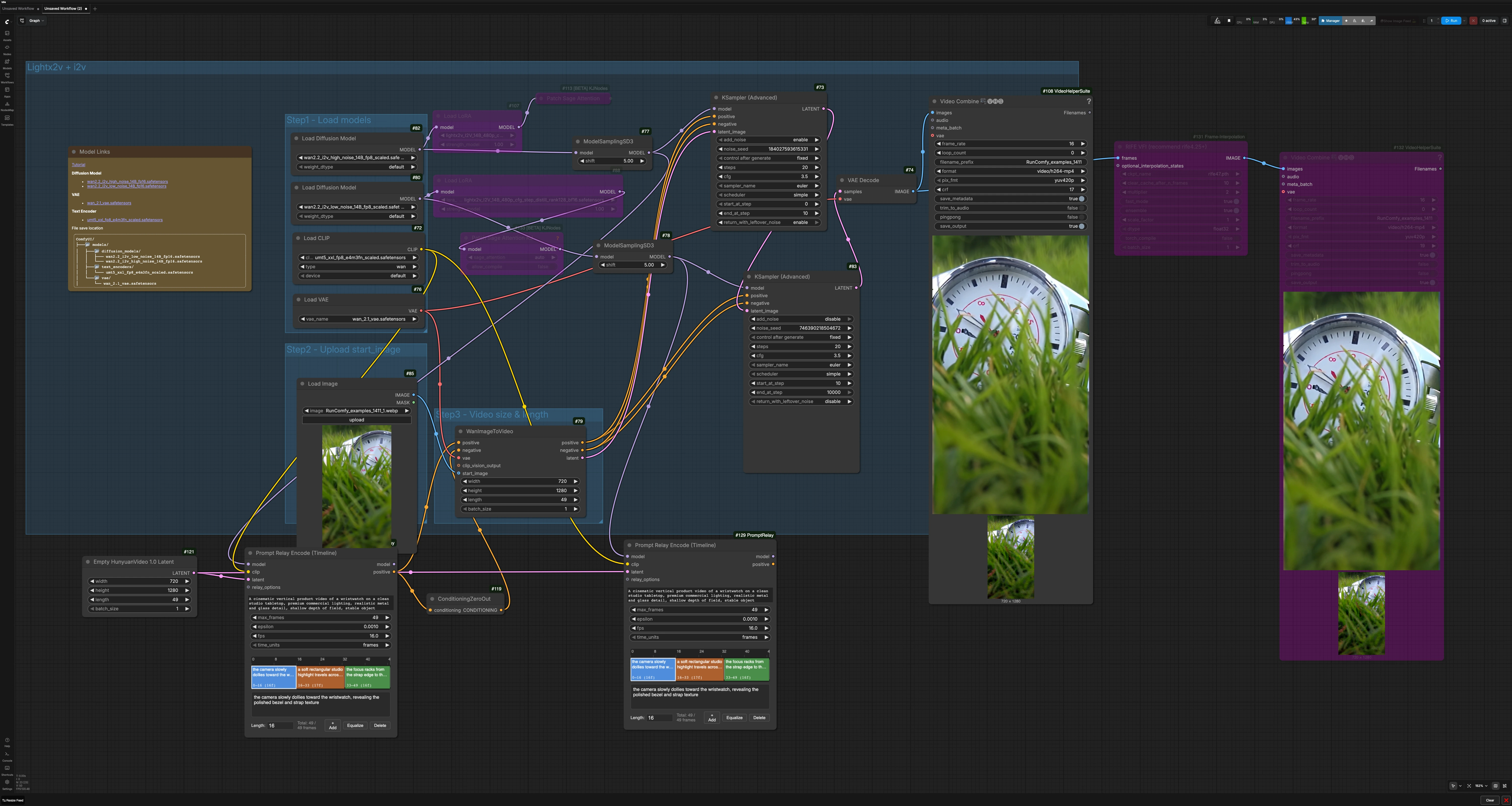

Wan 2.2 提示中继:在 ComfyUI 中通过时间线控制从图像到视频的转换#

此工作流将片段级场景方向带到 Wan 2.2 图像到视频。它使用 Wan 2.2 进行生成,并使用提示中继方法在单一时间线上路由不同的提示,因此您可以在不切割渲染的情况下将控制从一个场景交给下一个。结果是一个平滑的多事件视频,每个片段都遵循其自己的提示,而对象身份和风格保持一致。

Wan 2.2 提示中继是一种推理时路由技术,不是独立模型或 LoRA。图表设计用于 RunComfy 云,包含一个两阶段采样器链和可选的 RIFE 帧插值。使用它时,您只需提供一个起始图像,定义全局提示和每段提示,设置视频长度并渲染,即可实现紧密的时间场景控制,设置最小。

Comfyui Wan 2.2 提示中继工作流中的关键模型#

- Wan 2.2 图像到视频扩散模型 14B。高噪声和低噪声变体组合在一起,以在两阶段过程中平衡运动和细节。模型可在 Hugging Face 上的 Comfy-Org 重打包集中找到。 Comfy-Org/Wan_2.2_ComfyUI_Repackaged

- UMT5‑XXL 文本编码器用于 Wan。此编码器将您的全局和本地提示翻译为 Wan 2.2 使用的条件。 Comfy-Org/Wan_2.1_ComfyUI_repackaged

- Wan 2.1 VAE。用于在采样后将潜在内容解码回帧。 Comfy-Org/Wan_2.2_ComfyUI_Repackaged/vae

- RIFE 帧插值模型(可选)。增加生成后的时间平滑度或目标帧率。 hzwer/Practical‑RIFE

如何使用 Comfyui Wan 2.2 提示中继工作流#

该工作流在时间上路由文本提示,从起始图像生成潜在视频,然后在可选插值和编码之前进行精细化和解码帧。它被组织成几个清晰的组,合作生成最终的 MP4。

- 第一步 - 加载模型 本节初始化 Wan 2.2、文本编码器和 VAE。高噪声和低噪声 Wan 模型都已准备好,因此管道可以首先建立运动,然后增强细节。如果存在 LoRA,则在采样前将其应用于基础模型。除非您想更换检查点,否则无需更改此处的任何内容。

- 第二步 - 上传 start_image 导入单个参考图像,使用

LoadImage(#85) 定义构图、主题身份和第一帧的光照。起始图像锚定视频的外观,并有助于在片段间保持连续性。使用干净、符合模型的参考以获得最佳效果。每当您想要不同的主题或布局时,请更换它。 - 第三步 - 视频尺寸和长度 在潜在视频初始化程序 (

EmptyHunyuanLatentVideo(#121)) 中设置目标分辨率和总帧数,并保持与您的片段计划一致。您的片段长度之和应等于总帧数。将您打算导出的帧率与提示中继设置和图表中的视频写入器匹配。 - Lightx2v + i2v 核心渲染路径使用两阶段采样器链。第一阶段使用高噪声模型建立运动和场景过渡。第二阶段使用低噪声模型细化细节和纹理,同时保留第一阶段的运动路径。这种组合使 Wan 2.2 提示中继在场景到场景交接中既可控又稳定。

- 提示路由 在

PromptRelayEncodeTimeline(#117) 中输入适用于整个剪辑的强global_prompt。然后定义片段提示,可以是 JSON 时间线数据,也可以是以管道分隔的列表。提示中继对每帧条件进行编码,仅在片段边界处更改,选择性地缓解过渡以实现自然交接。节点馈送 Wan 的条件,确保每个片段遵循其预定方向。 - 采样和解码 管道通过

WanImageToVideo(#79),然后是粗略的KSamplerAdvanced(#73) 和精细的KSamplerAdvanced(#83)。帧通过VAEDecode(#74) 解码,并使用VHS_VideoCombine(#108) 写入视频。可选地,在第二次VHS_VideoCombine(#132) 之前使用RIFE VFI(#131),如果您想要更平滑的运动或更高的输出帧率。

Comfyui Wan 2.2 提示中继工作流中的关键节点#

PromptRelayEncodeTimeline(#117) Wan 2.2 提示中继的核心,此节点将您的global_prompt和每段提示转换为时间感知的正条件流。您可以在timeline_dataJSON 中或在local_prompts中使用管道语法来创作片段。使用max_frames匹配视频长度,选择与您的计划一致的time_units,并调整epsilon来软化或加硬段间提示交接。保持fps与最终导出一致。WanImageToVideo(#79) 将起始图像加上条件转换为 Wan 2.2 的初始潜在时间线。将您的起始参考连接到start_image,并保持宽度、高度和长度与潜在初始化程序对齐。此图表中的负条件有意为零,以减少过度约束并保持稳定的身份;仅在您看到反复出现的伪影需要抑制时引入明确的负提示。KSamplerAdvanced(#73) 强调运动和布局的第一次采样器。它与通过ModelSamplingSD3配置的高噪声 Wan 模型一起工作,以在尊重提示中继条件的同时探索轨迹。调整steps和cfg以获得指导的强度,并在您希望跨编辑迭代的可重复运动时保持固定的noise_seed。KSamplerAdvanced(#83) 使用低噪声 Wan 模型增强细节和时间一致性的第二次采样器。它在不对抗第一次通过的粗略轨迹的情况下细化纹理、边缘和微观运动。如果在此处提高保真度,请考虑平衡指导以避免过度锐化可能会破坏运动稳定性。EmptyHunyuanLatentVideo(#121) 创建定义空间分辨率、帧预算和批量大小的空白潜在视频。将总帧数设置为所有片段长度之和,以便提示中继可以干净地映射提示。更改分辨率会影响内存和运动节奏的外观,因此请谨慎缩放。VHS_VideoCombine(#108, #132) 将帧编码为 MP4。当您不使用插值时,将frame_rate与提示中继fps匹配。如果使用RIFE VFI,请将写入器的帧率设置为新的有效 fps。调整crf以在大小和质量之间进行权衡。

可选附加功能#

- 编写

global_prompt以锁定音调、相机语言和质量标签,然后保持片段提示简短且以动作为中心。 - 确保您的片段长度总和等于视频长度,以避免提示不对齐。

- 在提示迭代时保持种子固定,然后仅在您想要新的视角时随机化种子。

- 使用更高或更宽的起始图像来暗示宽高比偏好,但始终设置明确的宽度和高度以获得可预测性。

- 如果您看到跨片段的身份漂移,请加强

global_prompt,使用显著的对象描述符并简化本地提示。

探索此处使用的组件的资源:

- kijai 为 ComfyUI 提供的提示中继节点 GitHub

- Wan 2.2 重打包模型 Hugging Face

- 为 Wan 2.x 重打包的 UMT5‑XXL 文本编码器 Hugging Face

致谢#

此工作流实现并构建在以下作品和资源之上。我们感谢 kijai 为 ComfyUI-PromptRelay 节点的贡献,gordonchen19 为 Prompt-Relay 项目的贡献,以及 Comfy-Org 为 Wan_2.2_ComfyUI_Repackaged 模型的贡献和维护。有关权威细节,请参考下列链接的原始文档和存储库。

资源#

- YouTube/Workflow @Ai Verse 源教程

- 文档 / 发布说明: @Ai Verse Workflow 源教程

- AI Verse/AI Verse 工作流页面

- 文档 / 发布说明: AI Verse 工作流页面

- kijai/ComfyUI-PromptRelay 节点仓库

- GitHub: kijai/ComfyUI-PromptRelay

- gordonchen19/Prompt Relay 项目页面

- GitHub: gordonchen19/Prompt-Relay

- 文档 / 发布说明: Prompt Relay 项目页面

- Comfy-Org/Wan 2.2 ComfyUI 重打包模型

- Hugging Face: Comfy-Org/Wan_2.2_ComfyUI_Repackaged (split_files)

注意:使用所引用的模型、数据集和代码需遵循其作者和维护者提供的各自许可证和条款。