Qwen Edit 2511 LoRA Inferência: edições consistentes com treinamento do AI Toolkit no ComfyUI#

Qwen Edit 2511 LoRA Inferência é um fluxo de trabalho RunComfy pronto para uso para aplicar um AI Toolkit–treinado LoRA no Qwen Image Edit Plus 2511 dentro do ComfyUI com comportamento consistente com o treinamento. É construído em torno do RC Qwen Image Edit Plus 2511 (RCQwenImageEditPlus2511)—um nó personalizado de código aberto construído por RunComfy (source) que direciona a edição através de um pipeline de inferência específico do Qwen (em vez de um gráfico de amostragem genérico), enquanto carrega seu adaptador através de lora_path e lora_scale.

Por que Qwen Edit 2511 LoRA Inferência muitas vezes parece diferente no ComfyUI#

As imagens de pré-visualização do AI Toolkit vêm de um pipeline de edição específico do Qwen Image Edit Plus 2511, incluindo como o prompt é codificado em relação à imagem de controle e como a orientação é aplicada. Se você reconstruir a mesma tarefa como um gráfico de amostragem genérico do ComfyUI, os padrões podem mudar e o LoRA pode acabar corrigindo uma parte diferente do stack—então combinar prompt/passos/seed ainda não garante edições correspondentes. Quando os resultados divergem, geralmente é um desajuste de nível de pipeline em vez de um único parâmetro que você perdeu.

O que o nó personalizado RCQwenImageEditPlus2511 faz#

RCQwenImageEditPlus2511 direciona a edição do Qwen Image Edit Plus 2511 através de um pipeline de inferência alinhado à pré-visualização e aplica seu adaptador AI Toolkit via lora_path / lora_scale dentro desse pipeline para manter a inferência consistente com as pré-visualizações de treinamento. Implementação de referência: `src/pipelines/qwen_image.py`.

Como usar o fluxo de trabalho Qwen Edit 2511 LoRA Inferência#

Passo 1: Importe seu LoRA (2 opções)#

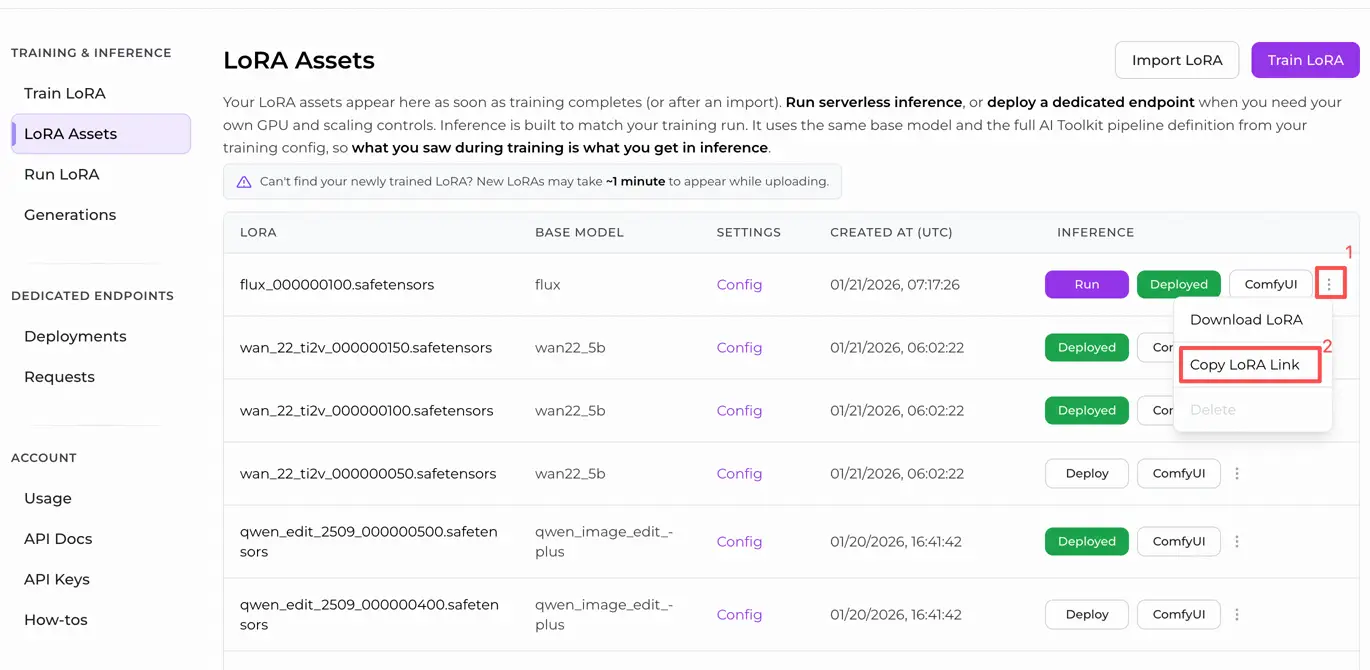

- Opção A (resultado de treinamento RunComfy): RunComfy → Treinador → Ativos LoRA → encontre seu LoRA → ⋮ → Copiar Link do LoRA

- Opção B (LoRA do AI Toolkit treinado fora do RunComfy): Copie um link de download direto

.safetensorspara seu LoRA e cole esse URL emlora_path(não é necessário baixar paraComfyUI/models/loras).

Passo 2: Configure o nó personalizado RCQwenImageEditPlus2511 para Qwen Edit 2511 LoRA Inferência#

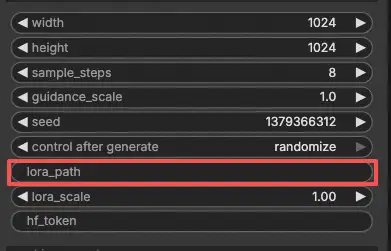

Cole seu link do LoRA em lora_path no RCQwenImageEditPlus2511 (seja o link do LoRA do RunComfy da Opção A, ou um URL direto .safetensors da Opção B).

Em seguida, configure o restante dos parâmetros do nó (combine seus valores de amostra/pré-visualização do AI Toolkit quando estiver comparando resultados):

prompt: a instrução de edição (inclua seus tokens de gatilho de treinamento se seu LoRA os usar)negative_prompt: opcional; mantenha vazio se você não usou negativos nas pré-visualizaçõeswidth/height: tamanho de saída (múltiplos de 32 são recomendados para este pipeline)sample_steps: passos de inferência (comece espelhando sua contagem de passos de pré-visualização; 25 é uma base comum)guidance_scale: força da orientação (Qwen usa uma escala “true CFG”; valide o valor correspondente à pré-visualização antes de ajustar)seed: seed fixo para edições repetíveis enquanto você diagnostica o alinhamento configurando control_after_generate para 'fixed'lora_scale: força do LoRA (comece na força de sua pré-visualização, depois ajuste gradualmente)

Este fluxo de trabalho é uma configuração de edição de imagens, por isso também requer uma imagem de entrada:

control_image(entrada obrigatória): conecte um nó LoadImage acontrol_image, e substitua a imagem de amostra pela foto que você deseja editar.

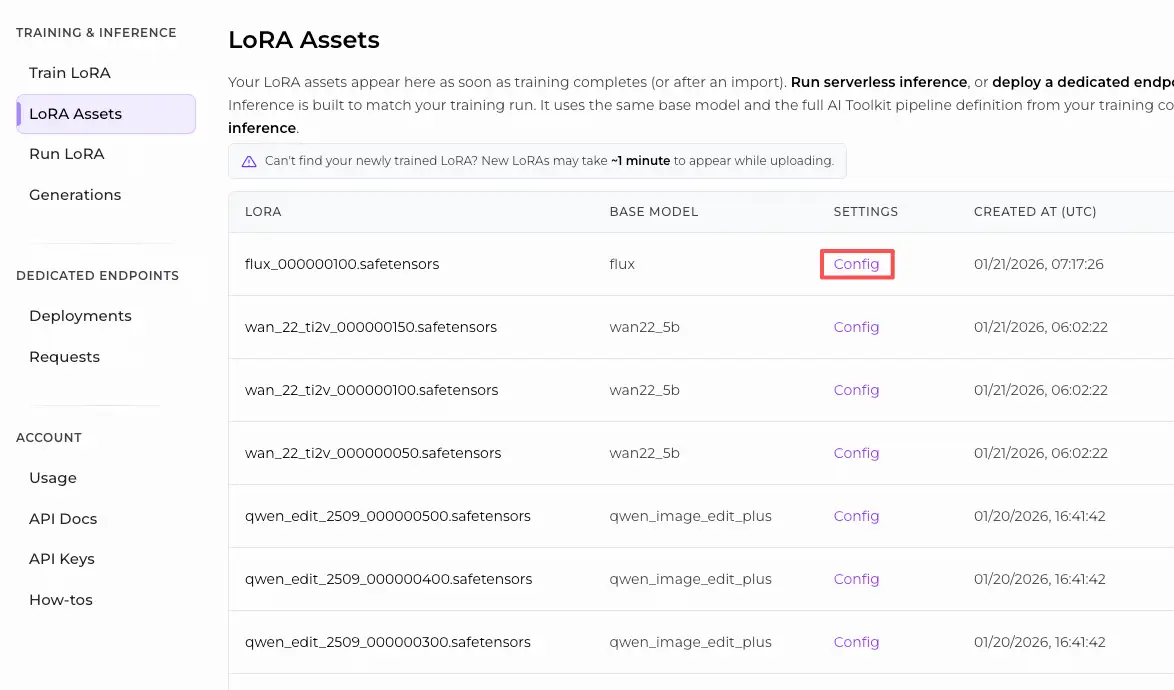

Nota de alinhamento de treinamento: se você alterou as configurações de amostragem durante o treinamento, abra seu YAML de treinamento do AI Toolkit e espelhe width, height, sample_steps, guidance_scale, seed e lora_scale. Se você treinou no RunComfy, vá para Treinador → Ativos LoRA → Config e copie os valores de pré-visualização no RCQwenImageEditPlus2511.

Passo 3: Execute o Qwen Edit 2511 LoRA Inferência#

Clique em Queue/Run. O nó SaveImage grava o resultado editado no seu diretório de saída padrão do ComfyUI.

Solução de Problemas Qwen Edit 2511 LoRA Inferência#

A maioria dos problemas que as pessoas encontram após treinar um Qwen-Image-Edit-2511 LoRA no Ostris AI Toolkit aparece no momento da inferência devido a desajuste de pipeline—o sampler de pré-visualização do AI Toolkit é específico do modelo/pipeline, enquanto muitos gráficos ComfyUI (ou backends acelerados) não são.

O nó personalizado RC Qwen Image Edit Plus 2511 (RCQwenImageEditPlus2511) do RunComfy é construído para manter a inferência alinhada ao pipeline com a amostragem de pré-visualização no estilo AI Toolkit.

(1)qwen image edit não suporta carregamento de LoRA#

Por que isso acontece

Alguns caminhos acelerados do Qwen Image Edit (por exemplo, a rota Qwen Image Edit do Nunchaku) atualmente não corrigem os pesos do LoRA da mesma forma que o pipeline oficial de edição Qwen espera. O sintoma usual é carregamento de peso falhou / chave do lora não carregada e o adaptador tendo pouco ou nenhum efeito visível.

Como corrigir (abordagem consistente com o treinamento)

- Se você estiver executando o Qwen Image Edit através do Nunchaku, mude para um fluxo de trabalho não-Nunchaku do Qwen Image Edit 2511 para validação do LoRA (isso foi relatado como não suportado para carregamento de LoRA na questão).

- No RunComfy, valide seu adaptador através do RCQwenImageEditPlus2511 primeiro e injete o LoRA somente via

lora_path+lora_scale(evite empilhar um caminho de carregador de LoRA adicional sobre o nó RC). - Mantenha a mesma imagem de controle,

seed,sample_steps,guidance_scaleewidth/heightfixos enquanto você compara com as pré-visualizações do AI Toolkit.

(2)Pergunta sobre aviso de carregamento do qwen-image-edit-2511#

Por que isso acontece

Qwen-Image-Edit-2511 introduz novos campos de configuração (notadamente zero_cond_t). Se o seu runtime local estiver atrás do suporte de biblioteca esperado pelo modelo, você pode ver avisos como: config attribute zero_cond_t was passed ... but is ignored Isso é um forte sinal de que seus padrões de pipeline podem não corresponder ao sampler de pré-visualização com o qual você treinou/validou.

Como corrigir (caminho de atualização conhecido)

- Atualize para uma compilação Diffusers/stack que inclua suporte para Qwen-Image-Edit-2511. Uma correção comumente compartilhada no ecossistema do AI Toolkit é instalar Diffusers do GitHub main para compatibilidade com Qwen Edit 2511 (veja o PR de suporte): https://github.com/ostris/ai-toolkit/pull/611

- Em seguida, re-teste através do RCQwenImageEditPlus2511 (alinhado ao pipeline) enquanto espelha seus valores de pré-visualização (

sample_steps,guidance_scale,seed,lora_scale,width/height).

(3)--zero_cond_t # Este é um parâmetro especial introduzido pelo Qwen-Image-Edit-2511. Por favor, habilite-o para este modelo.#

Por que isso acontece

Alguns stacks de treinamento/inferência do Qwen Edit 2511 requerem que zero_cond_t seja habilitado para corresponder ao comportamento de condicionamento/orientação pretendido. Se suas pré-visualizações de treinamento foram produzidas com uma configuração e sua inferência ComfyUI rodar com outra, as edições podem parecer “desligadas” mesmo que prompt/seed/passos coincidam.

Como corrigir (comportamento correspondente ao treinamento)

- Certifique-se de que seu sampler de pré-visualização de treinamento e seu pipeline de inferência estejam usando a mesma configuração do Qwen Edit 2511 (incluindo

zero_cond_tquando seu stack o expõe). - Para inferência ComfyUI, prefira RCQwenImageEditPlus2511 para que o pipeline de edição permaneça alinhado ao pipeline, e o LoRA seja injetado onde o pipeline no estilo de pré-visualização espera (via

lora_path/lora_scale).

(4)Qwen Image Edit 2511 - Degradação de saída quadrada em edição de imagem única#

Por que isso acontece

Usuários relatam que Qwen-Image-Edit-2511 pode perder coerência em saídas quadradas (por exemplo, 1024×1024) para certas edições, enquanto proporções não quadradas produzem resultados visivelmente mais limpos e fiéis—mesmo com o mesmo seed/prompt/configurações.

Como corrigir (solução alternativa relatada pelo usuário)

- Ao validar seu LoRA, teste uma saída não-quadrada (por exemplo, 832×1216 ou 1216×832) enquanto mantém o mesmo

seed,sample_steps,guidance_scalee imagem de controle. - Uma vez que você encontre uma proporção que corresponda às suas expectativas de pré-visualização, mantenha essa proporção fixa e só então comece a ajustar

lora_scale.

Execute Qwen Edit 2511 LoRA Inferência agora#

Abra o fluxo de trabalho, defina lora_path, conecte sua control_image, e execute RCQwenImageEditPlus2511 para manter as edições do ComfyUI alinhadas com suas pré-visualizações de treinamento do AI Toolkit.