ComfyUI용 LTX-2.3-Video-Face-Swap#

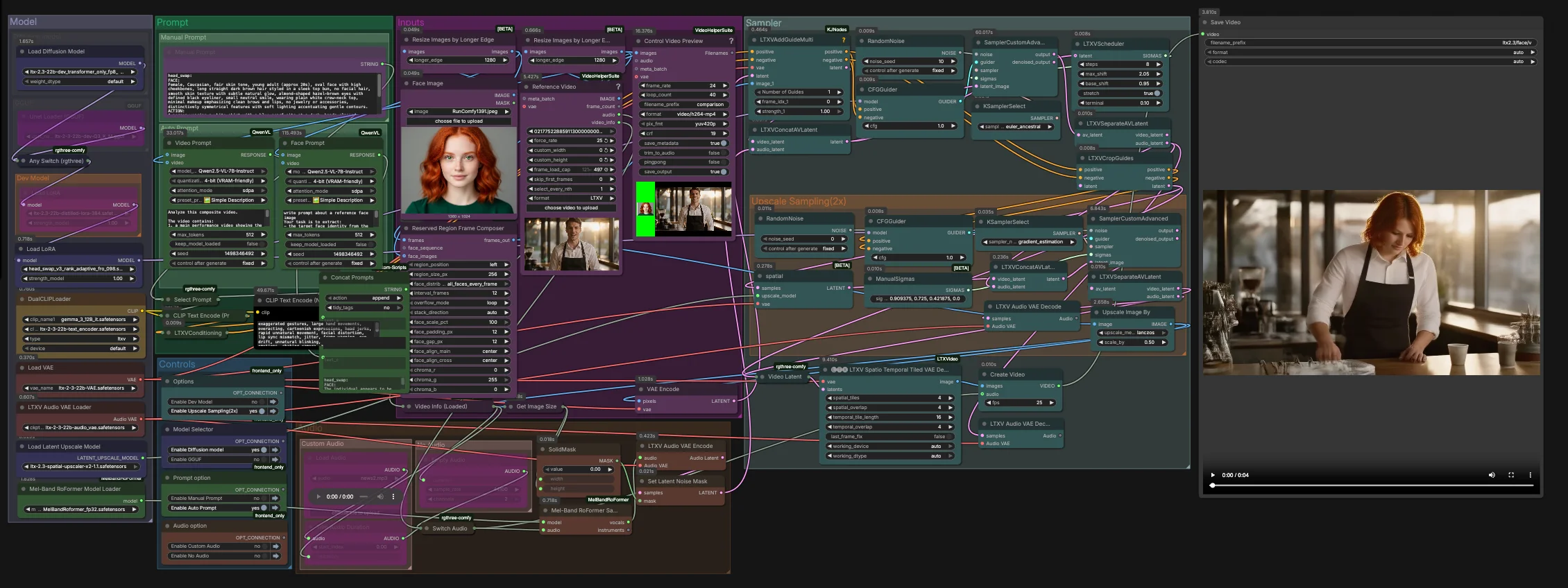

이 워크플로우는 LTX 2.3 계열을 사용하여 고품질, 시간적으로 안정적인 비디오 얼굴 교체를 제공합니다. RunComfy와 ComfyUI를 위해 구축되었으며, 프레임 전체에서 표정, 조명, 움직임을 보존하기 위해 신원 가이드 이미지를 대상 비디오와 선택적 오디오 가이드와 결합합니다. 결과는 클로즈업과 중간 샷에서 견딜 수 있는 현실적이고 깜박임 없는 교체입니다.

창작자, VFX 아티스트, AI 영화 제작자는 LTX-2.3-Video-Face-Swap을 사용하여 완전한 창의적 제어를 유지할 수 있습니다: 수동으로 프롬프트를 생성하거나 입력에서 구조화된 프롬프트를 생성하고, dev, distilled, FP8 또는 GGUF 변형 중에서 선택하고, 2x 잠재 업스케일링 옵션과 함께 공간-시간 디코드로 마무리할 수 있습니다.

ComfyUI LTX-2.3-Video-Face-Swap 워크플로우의 주요 모델#

- LTX 2.3 22B Video Diffusion Transformer. 신원 보존과 시간적 일관성을 주도하는 핵심 비디오 생성 및 편집 모델입니다. 공식 모델 계열은 Lightricks/LTX-2.3에서 확인하세요.

- LTX 2.3 Text Encoders. LTX 2.3 텍스트 인코더와 Gemma 3 12B 지시 인코더를 결합하여 비디오 편집 프롬프트 정렬을 개선합니다. 예시 아티팩트: ltx-2-3-22b-text_encoder.safetensors 및 gemma_3_12B_it.safetensors.

- LTX 2.3 VAE 및 Audio VAE. 세부 사항과 동기화를 보존하면서 시각적 프레임과 오디오 트랙을 압축하고 재구성하는 인코더/디코더입니다. Lightricks/LTX-2.3 VAE files 및 분할 저장소의 오디오 VAE 변형은 vantagewithai/LTX-2.3-Split에서 확인하세요.

- LTX 2.3 Spatial Upscaler x2. 최종 디코딩 전에 공간 충실도를 높이는 잠재 공간 2x 업스케일러로, 얼굴 디테일에 이상적입니다. ltx-2.3-spatial-upscaler-x2-1.1.safetensors.

- Head-swap LoRA. 편집을 주도할 때 유사성과 안정성을 향상시키는 신원 전송에 특화된 순위 적응형 LoRA입니다. 예시: head_swap_v3_rank_adaptive_fro_098.safetensors.

- MelBandRoFormer. 여기에서 입 모양 지침을 강화하기 위해 보컬을 분리하는 데 사용되는 선택적 음악 소스 분리 모델입니다. Kijai/MelBandRoFormer_comfy.

- 선택적 배포 변형. 지원되는 GPU에서 속도를 위한 FP8 변환기 전용 가중치 Kijai/LTX2.3_comfy 및 CPU 또는 저 VRAM 시나리오를 위한 경량 UNet GGUF 빌드 vantagewithai/LTX-2.3-GGUF.

ComfyUI LTX-2.3-Video-Face-Swap 워크플로우 사용 방법#

이 그래프는 두 단계로 실행됩니다. 1단계는 오디오 인식 가이드를 사용하여 기본 잠재 해상도에서 핵심 교체를 수행합니다. 2단계는 잠재 공간에서 업샘플링하고, 공간-시간 디코드와 최종 비디오로의 다중화 전에 얼굴 영역을 정제합니다.

입력#

Face Image(LoadImage(#255))에 신원 이미지를 로드합니다. 가장 신뢰할 수 있는 신원 추출을 위해 잘 조명된 정면 또는 삼분의 이 샷을 사용하세요.Reference Video(VHS_LoadVideo(#393))에 대상 영상을 로드합니다. 프레임은ResizeImagesByLongerEdge및Control Video Preview(VHS_VideoCombine(#396))를 통해 샘플링 전 빠른 확인을 위해 정규화되고 미리보기됩니다.ReservedRegionFrameComposer(#395)는 신원 이미지를 장면 레이아웃에 맞추는 가이드 프레임을 준비하여 모델이 조건화 중 교체 영역에 집중할 수 있도록 돕습니다.

프롬프트#

Manual Prompt에서 수동으로 원하는 외모와 동작을 설명하거나 그래프가 구조화된 프롬프트를 자동으로 작성하게 할 수 있습니다.Video Prompt(AILab_QwenVL(#400))는 비디오에서 신체 움직임과 장면을 추출하고Face Prompt(AILab_QwenVL(#401))는 얼굴 이미지에서 신원 세부 정보를 추출합니다.Concat Prompts는 신원과 동작을 하나의 간결한 지침으로 통합한 후Select Prompt가 수동 텍스트 또는 자동 프롬프트를CLIP Text Encode로 라우팅합니다. 부정적 프롬프트 텍스트는 일반적인 비디오 아티팩트를 억제하기 위해 별도로 인코딩됩니다.

모델#

Model그룹은 LTX 2.3 UNet 또는 그 GGUF 변형을 로드하고, 증류된 LoRA와 헤드-스왑 LoRA를 적용하며, LTX VAE와 이중 텍스트 인코더를 불러옵니다. 이중 인코더 설정은 구어 콘텐츠 및 카메라 블로킹에 대한 정렬을 개선하여 신원을 과도하게 제한하지 않습니다.- 속도 또는 메모리 최적화를 원하는 경우, 제공된 모델 선택기에서 dev, distilled, FP8 변환기 전용, 또는 GGUF를 전환하세요. RunComfy에서 추가 설정이 필요하지 않습니다.

샘플러#

- 1단계는

LTXVConcatAVLatent(#321)에서 비디오 및 오디오 잠재를 결합한 후CFGGuider(#326),LTXVScheduler(#324),SamplerCustomAdvanced(#257)로 노이즈를 제거합니다.LTXVAddGuideMulti(#392)는 신원 가이드를 주입하여 얼굴이 초기부터 확립되고 시간이 지나도 안정적으로 유지됩니다. - 첫 번째 패스 후,

LTXVSeparateAVLatent(#323)는 스트림을 분리하여LTXVCropGuides(#282)가 얼굴 주위의 편집에 집중할 수 있도록 합니다. 이는 중요한 곳에 계산을 집중시켜 시간적 일관성을 개선합니다.

업스케일 샘플링 (2x)#

LTXVLatentUpsampler(#279)는 잠재 공간에서 LTX 2.3 x2 공간 업스케일러를 적용합니다. 업샘플링된 비디오 잠재는LTXVConcatAVLatent(#287)에서 오디오 잠재와 다시 결합되고CFGGuider(#284)에 의해 안내되는 두 번째SamplerCustomAdvanced(#288) 패스로 정제됩니다.- 이 2단계 전략은 피부, 눈, 머리카락을 더 날카롭게 만들면서 교체가 의도된 신원에 고정되도록 유지합니다.

오디오#

Audio그룹은 원본 오디오, 무음, 또는 잘라낸 세그먼트를Switch Audio를 통해 라우팅합니다. 입 모양 단서를 강화하기 위해 선택한 트랙은MelBandRoFormerSampler(#355)로 보컬을 분리한 후LTXVAudioVAEEncode(#364)로 인코딩됩니다.- 견고한 노이즈 마스크 (

SetLatentNoiseMask(#365))는 입 영역 외부의 원치 않는 오디오 기반 변경을 방지하면서도 발화 타이밍을 활용해 표정을 안내합니다.

디코딩 및 내보내기#

- 최종 프레임은

LTXVSpatioTemporalTiledVAEDecode(#377)로 재구성되며, 시간 인식 타일링으로 디코딩하여 이음새를 피하고 움직임 연속성을 유지합니다.CreateVideo(#292)는 선택한 오디오와 이미지를 다중화하고,SaveVideo가 완성된 클립을 저장합니다.

ComfyUI LTX-2.3-Video-Face-Swap 워크플로우의 주요 노드#

LTXVAddGuideMulti(#392). 정렬된 얼굴 가이드를 조건화 스트림에 피드하여 모델이 초기 단계부터 대상 신원에 고정되도록 합니다. 빠른 움직임에서 유사성이 드리프트하면 전역 가이던스를 높이기보다는 가이드 프레임의 수나 빈도를 늘리세요.LTXVCropGuides(#282). 1단계 잠재 및 프롬프트에서 도출된 얼굴 영역에 2차 패스를 자동으로 집중시킵니다. 배경이나 손이 주의를 분산시킬 때 편집 영역을 조정하는 데 사용하세요.SamplerCustomAdvanced(#257). 신원, 조명, 대강의 움직임을 확립하는 주요 노이즈 제거 패스입니다. 스텝 셰이핑을 위한LTXVScheduler와 함께 사용하고, 실험 간 비교를 의미 있게 하기 위해 샘플러 선택을 안정적으로 유지하세요.LTXVLatentUpsampler(#279). 정제 전에 LTX 공간 업스케일러를 사용하여 2x 잠재 업스케일을 수행합니다. 포어, 속눈썹, 모자 이음새를 더 선명하게 만들 필요가 있을 때, 디코딩 후 픽셀 업스케일러로 인한 깜박임을 도입하지 않고 사용하세요.SamplerCustomAdvanced(#288). 업스케일링 후 정제 패스입니다. 첫 번째 패스에서 설정한 신원을 보존하면서 특징을 선명하게 하도록 가이던스를 적절히 조정하세요.LTXVSpatioTemporalTiledVAEDecode(#377). 프레임 간 타일 이음새를 줄이는 시간 인식 디코더입니다. 긴 클립에서 VRAM 한계에 도달하면 해상도를 낮추기보다는 타일 레이아웃을 조정하세요.MelBandRoFormerSampler(#355). 가이던스를 위해서만 사용되는 보컬 분리입니다. 원본 오디오가 노이즈가 많은 경우 입 모양 움직임에 아티팩트가 전파되지 않도록 원본 또는 무음 오디오로 전환하세요.

선택적 추가 기능#

- 얼굴 이미지 품질이 중요합니다. 중립적이고 잘 조명된 정면 또는 약간의 삼분의 이 사진을 사용하여 연기와 나이 및 표정이 유사한 이미지를 사용하세요.

- 참조 비디오를 안정적으로 유지하세요. 특히 중간 및 클로즈 샷에서 LTX-2.3-Video-Face-Swap 결과가 가장 안정적인 정지 또는 삼각대 샷을 만듭니다.

- 프롬프트는 간결해야 합니다. 장면과 동작을 한 단락으로 설명하고, 신원 형용사는 얼굴 프롬프트에, 동작 프롬프트에는 사용하지 마세요.

- 오디오 가이드는 선택 사항입니다. 명확한 발음이 입 모양을 개선합니다. 음악만 있는 트랙은 거의 이점이 없으므로 시각에 집중하도록 무음을 선택하세요.

- 저 VRAM 또는 CPU 전용 실행의 경우, GGUF UNet 빌드를 선호하세요; 최신 GPU에서 높은 처리량을 위해서는 FP8 변환기 전용 가중치가 좋은 기본값입니다.

- 책임감 있게 사용하세요. 교체하려는 신원의 동의를 얻고, 적용 가능한 법률 및 플랫폼 정책을 준수하세요.

감사의 말#

이 워크플로우는 다음 작업 및 리소스를 구현하고 기반으로 구축되었습니다. 우리는 LTX-2.3 모델과 EyeForAILabs의 YouTube 튜토리얼에 대한 기여와 유지 관리에 대해 깊이 감사드립니다. 권위 있는 세부 사항은 아래에 링크된 원본 문서 및 저장소를 참조하세요.

리소스#

- LTX-2.3/LTX-2.3 모델

- Hugging Face: Hugging Face Model

- EyeForAILabs/YouTube 튜토리얼

- 문서 / 릴리스 노트: EyeForAILabs YouTube Tutorial

참고: 참조된 모델, 데이터셋 및 코드의 사용은 저자 및 유지 관리자가 제공한 해당 라이선스 및 조건에 따릅니다.