ComfyUI-MochiEditノードとその関連ワークフローは、logtdとKijaiによって完全に開発されました。この革新的な作品に対して、logtdとKijaiに全ての功績を与えます。RunComfyプラットフォームでは、彼らの貢献をコミュニティに紹介するだけです。logtdとKijaiの作品には深く感謝しています!

Mochi Editワークフローは、テキストベースのプロンプトを使用してビデオコンテンツを修正するためのツールです。キャラクターに帽子を置くなどの要素の追加や変更、全体的なスタイルの調整、映像内の被写体の置き換えなどをサポートしています。

1. Mochi Edit Unsampling#

Mochi Editの中心にはアンプリング技術があります。Mochi Editのアンプリング技術は、追加の前処理ステップや外部ネットワークモジュールを必要とせずに、マルチモーダルプロンプトを通じて変換を可能にする簡素化されたアプローチを活用しています。Mochi Editのアンプリングの核心は、複雑な操作(顔検出やポーズ推定など)を行うのではなく、ビデオの潜在表現を直接操作することです。この方法は、より柔軟で合理化された画像生成プロセスを作成するという広範な目標と一致しており、任意の入力プロンプトからテキストを生成するGPTの能力に似ています。Mochi Editのアンプリング技術を使用すると、ユーザーはマルチモーダルな説明から直接さまざまなスタイルや変更を生成でき、プロセスがはるかに直感的で効率的になります。

要するに、Mochi Editはアップロードしたビデオの小さなバリエーションを作成することができます。被写体の動きを別の被写体にコピーして翻訳したり、背景設定を変更したり、被写体の特性を変更したりできます。

2. Mochi Edit Workflowの使用方法#

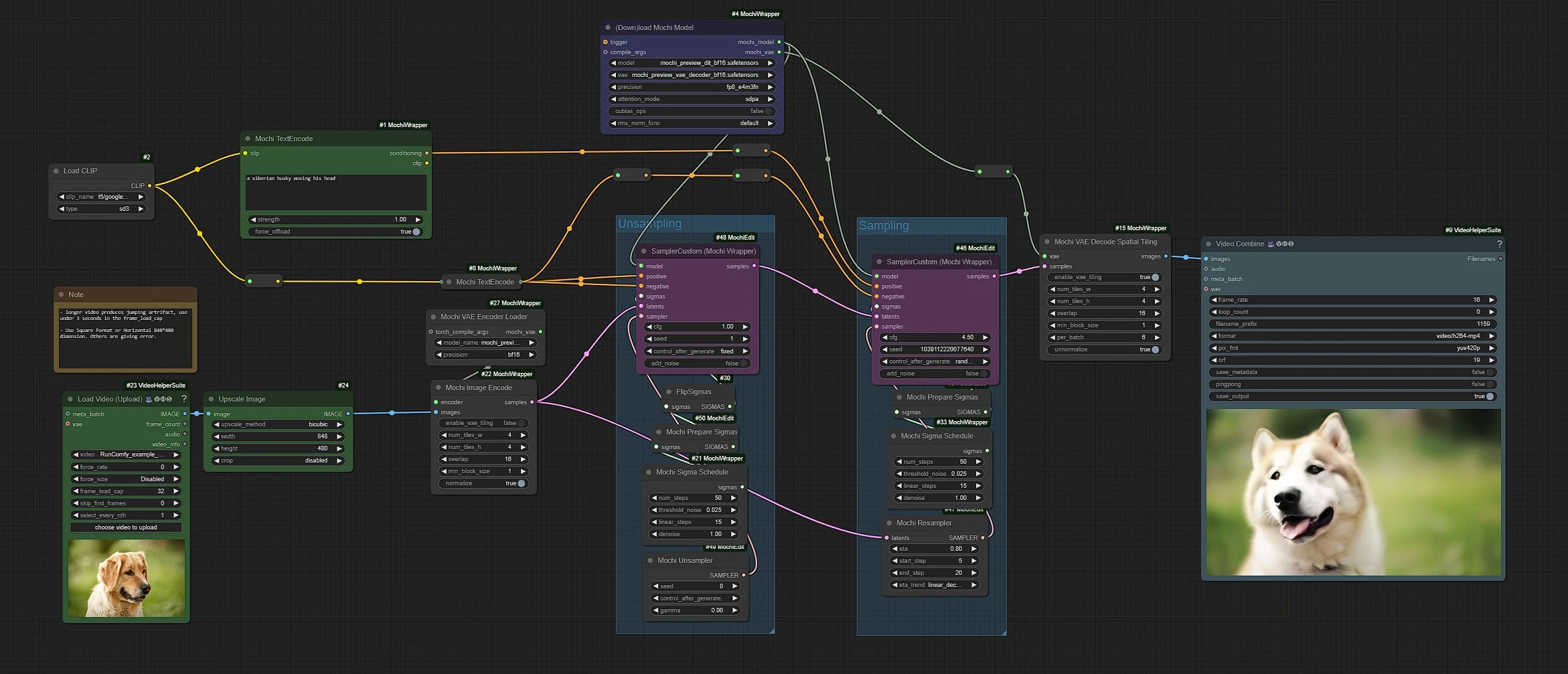

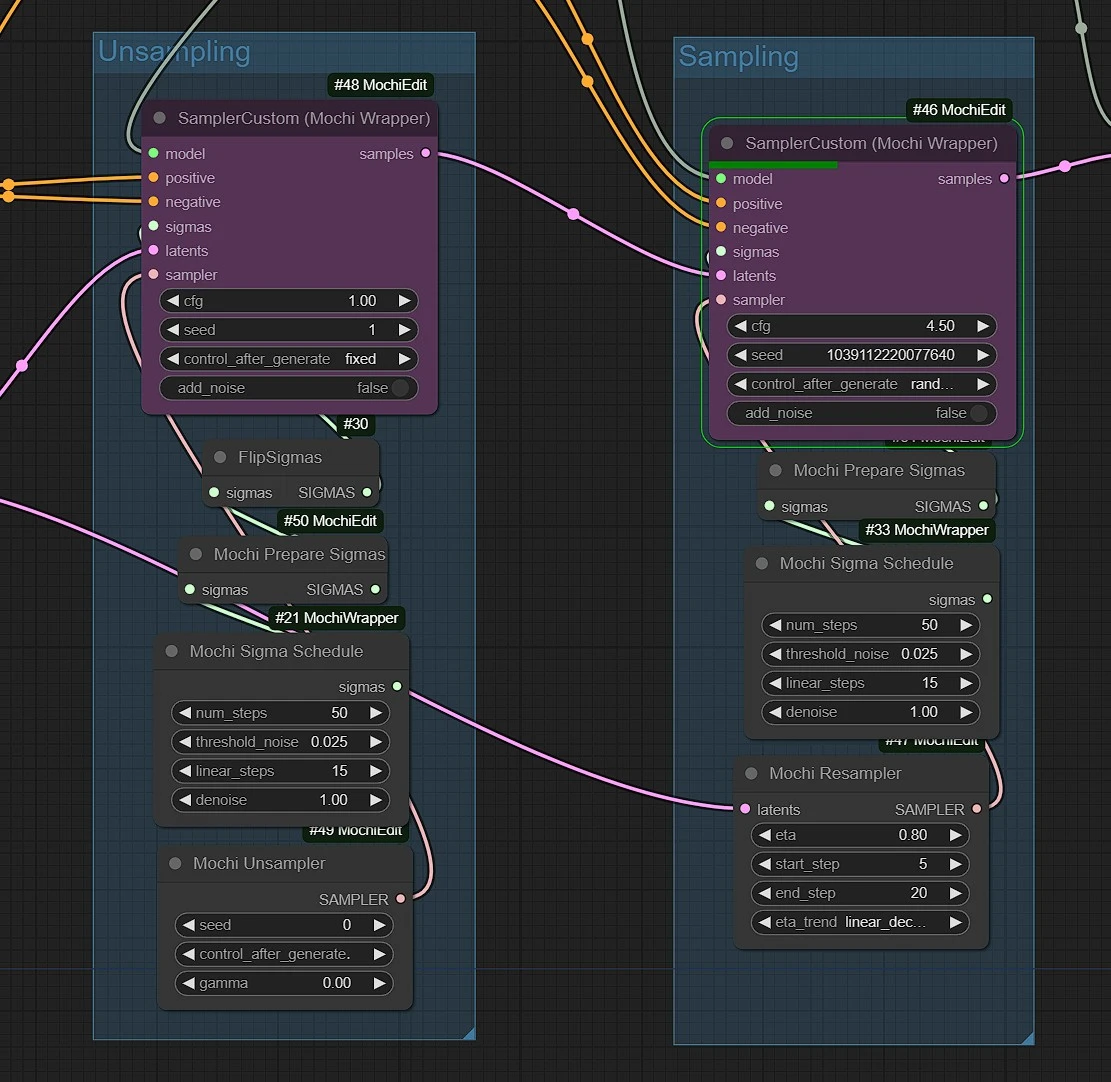

このワークフローでは、左の緑のノードがビデオとテキストの入力、中央の紫のノードがmochi unsamplerとsamplerノード、右の青がビデオ出力ノードです。

2.1 ビデオノードの読み込み#

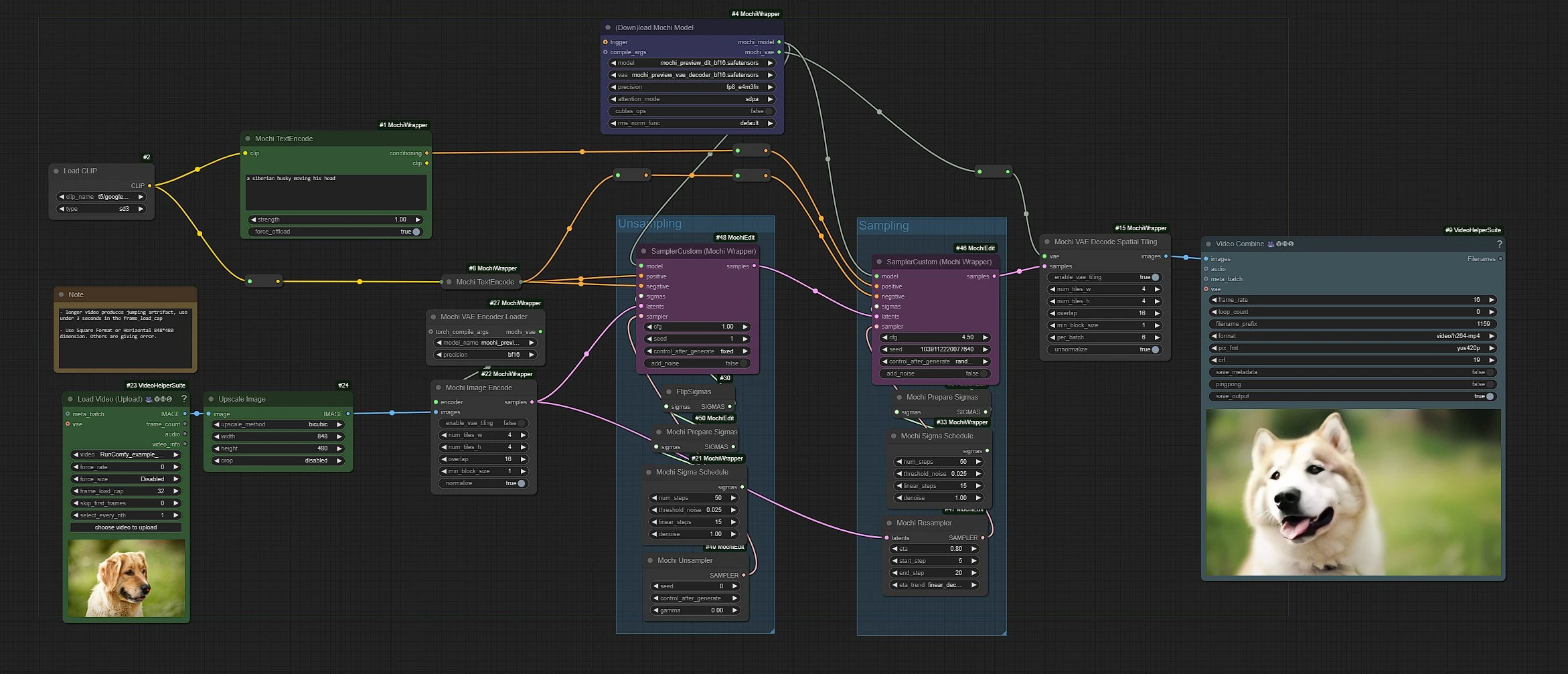

- ビデオノードにクリックしてビデオをアップロードしてください

frame_load_cap: デフォルトで32フレームです。32フレームを超えると、アーティファクトが観察されます。最良の結果を得るために3秒(32フレーム)以内にしてください。skip_frames: 特定のフレームから開始したい場合はフレームをスキップします

アップスケールノードでは、スクエアフォーマット(512 x 512)または横(848 x 480)の寸法を使用してください。他のものはエラーを引き起こします。

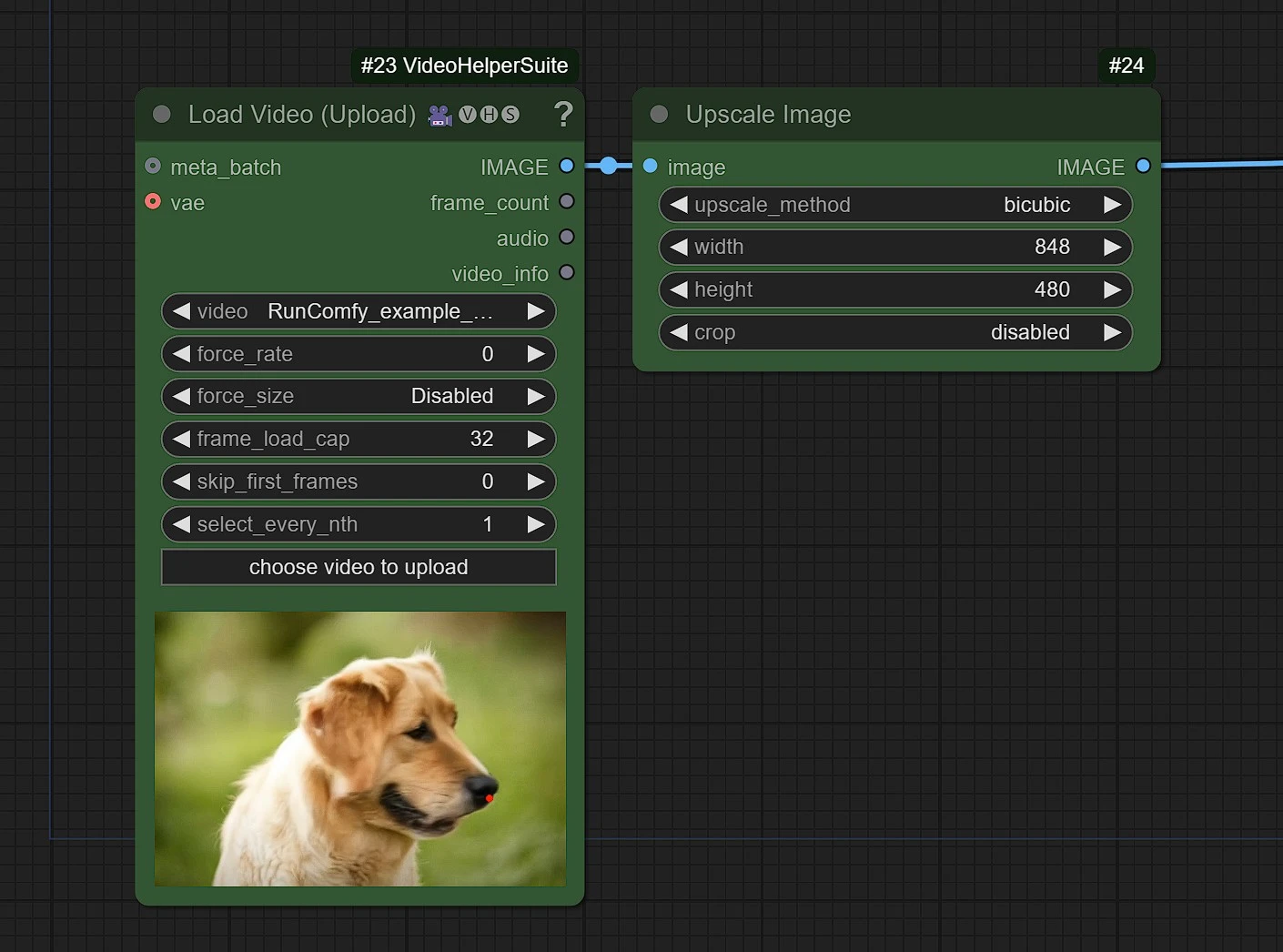

2.2 プロンプト#

これは実験的な使用であり、うまくいくこともあれば、うまくいかないこともあり、元のビデオが完全に変わることもあります。

- プロンプトとして被写体の小さな変化を使用します。

- 強い変化は画像を完全に歪める可能性があります。

- 適切な結果が得られない場合は、異なるシードを試してください。

2.3 サンプリングとアンプリングノードグループ#

サンプリングとアンプリングのKsamplerは、著者によって最適な設定にされています。設定を曖昧に編集すると、奇妙で望ましくない結果になる可能性があります。自由に試してみてください:

- サンプラーの

Seedでバリエーションを num_stepsとlinear_stepでレンダリング品質や速度を変更eta、start_step、end_Stepでアンプリングの強さ、開始と終了の割合を変更

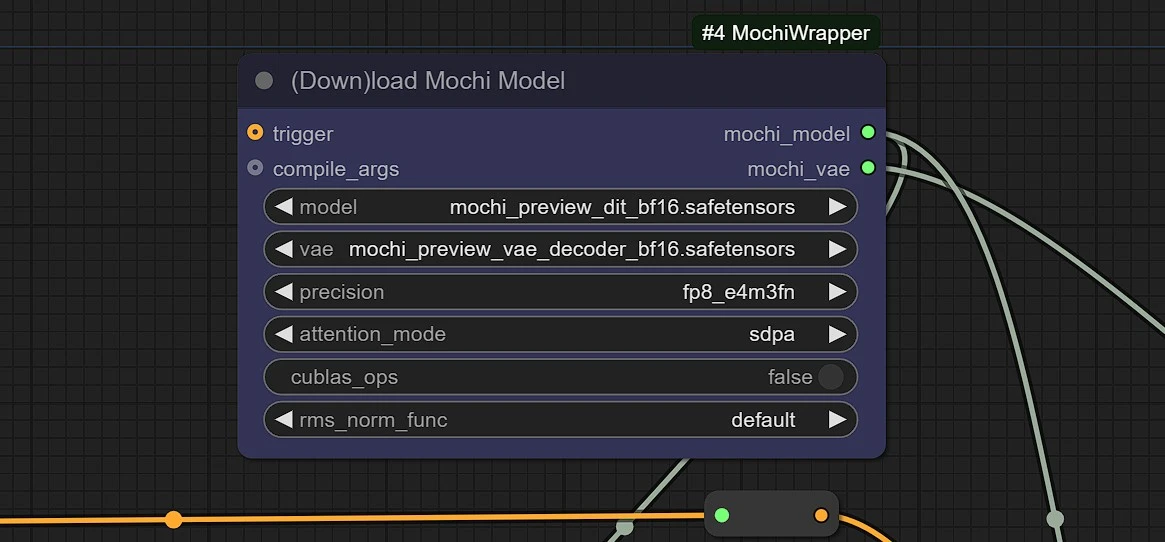

2.4 Mochiモデル#

モデルは、HuggingFace Repoから自動的にcomfyuiにダウンロードされます。最初に10.3 GBのモデルをダウンロードするのに約5-10分かかります。

Mochi Editのアンプリング技術は、プロセスを簡素化し、複雑な前処理や追加モジュールを必要としないことで、ビデオと画像編集を革命的に変えます。この革新的なアプローチは、マルチモーダルプロンプトを通じて高品質でカスタマイズされたビジュアルを簡単に生成する力をユーザーに提供します。柔軟性とアクセス性を組み合わせることで、Mochi Editは、より直感的で創造的な画像生成の未来を切り開きます。