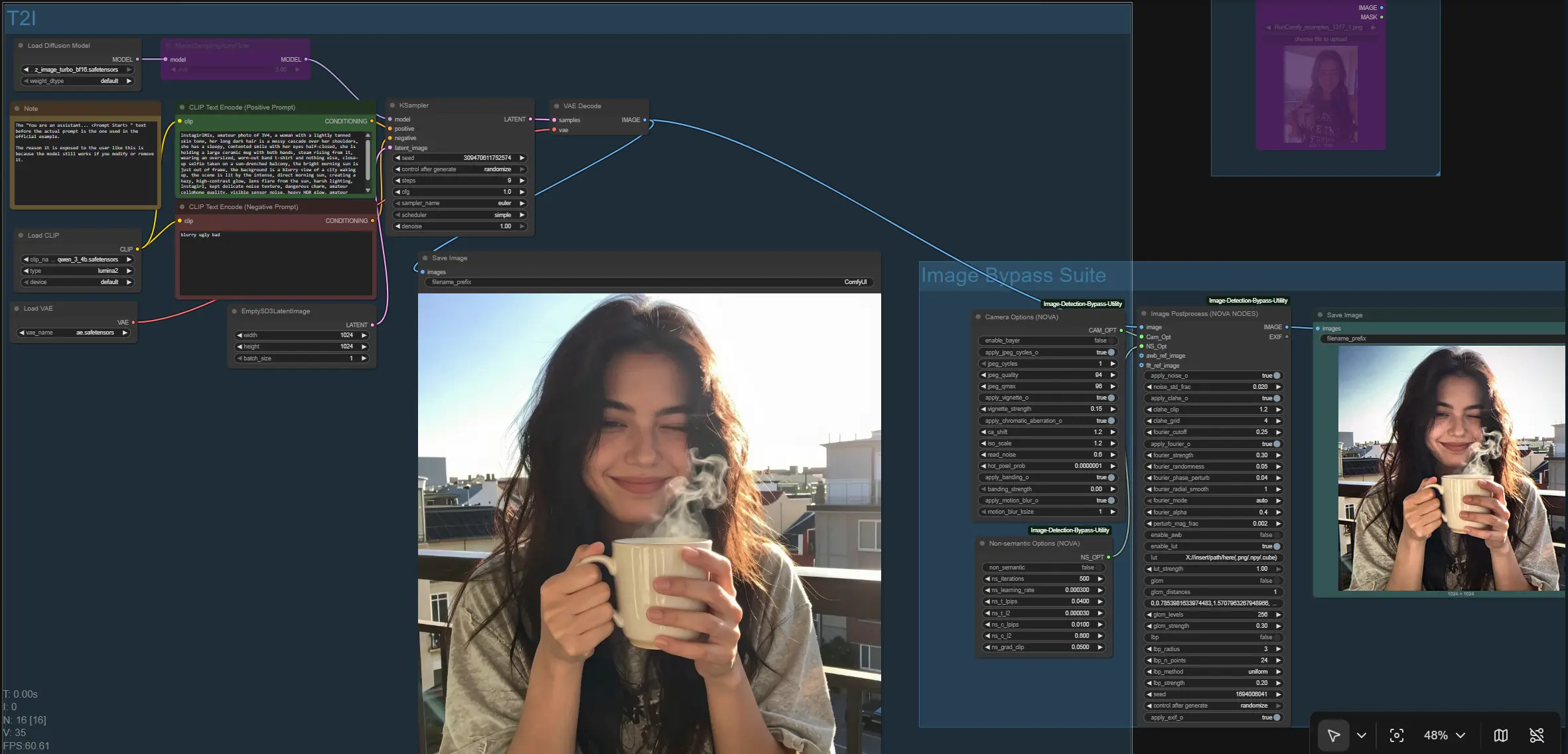

ComfyUI イメージバイパスワークフロー#

このワークフローは、非セマンティック正規化、FFTドメイン制御、カメラパイプラインシミュレーションを組み合わせたモジュラーイメージバイパスパイプラインをComfyUIに提供します。入力ルーティング、前処理動作、および出力の一貫性を完全に制御しながら、イメージバイパス段階を通じて画像を処理する信頼できる方法を必要とするクリエイターや研究者向けに設計されています。

基本的に、グラフは画像を生成または取り込み、センサのようなアーティファクト、周波数整形、テクスチャマッチング、知覚最適化を適用できるイメージバイパススイートを通じてルートします。その結果は、バッチ作業、自動化、消費者用GPUでの迅速な反復に適したクリーンで構成可能なパスになります。イメージバイパスロジックは、このリポジトリからのオープンソースユーティリティによって駆動されます: PurinNyova/Image-Detection-Bypass-Utility。

Comfyui イメージバイパスワークフローの主要モデル#

- z_image_turbo_bf16 (UNet checkpoint). T2Iブランチで迅速なプロトタイピングとベースライン画像生成に使用される高速テキストから画像への拡散バックボーンです。お好みのチェックポイントに置き換えることができます。参考: Comfy-Org/z_image_turbo on Hugging Face。

- VAE (ae.safetensors). 潜在デコードをピクセルに戻す処理を担当し、サンプリングの出力を視覚化し、イメージバイパス段階でさらに処理できるようにします。異なる再構築プロファイルを好む場合は、互換性のある任意のVAEと交換できます。

- プロンプトエンコーダー (CLIPLoader経由でロード). サンプラーのために正および負のプロンプトをコンディショニングベクトルにエンコードします。グラフはロードする特定のテキストエンコーダーファイルに依存せず、必要に応じてベースジェネレーターのモデルを置き換えることができます。

Comfyui イメージバイパスワークフローの使用方法#

高レベルでは、ワークフローはイメージバイパススイートに入る画像を生成する2つの方法を提供します: テキストから画像へのブランチ (T2I) と画像から画像へのブランチ (I2I)。どちらもイメージバイパスロジックを適用し、最終結果を書き込む単一の処理ノードに収束します。グラフはまた、バイパス前のベースラインを保存し、出力を比較できるようにします。

グループ: T2I#

プロンプトから新しい画像を合成したい場合にこのパスを使用します。プロンプトエンコーダーは CLIPLoader (#164) によってロードされ、CLIP Text Encode (Positive Prompt) (#168) および CLIP Text Encode (Negative Prompt) (#163) によって読み込まれます。UNetは UNETLoader (#165) でロードされ、オプションで ModelSamplingAuraFlow (#166) によってモデルのサンプリング動作を調整するためにパッチが適用され、KSampler (#167) で EmptySD3LatentImage (#162) からサンプリングされます。デコードされた画像は VAEDecode (#158) から出力され、イメージバイパススイートに入る前に SaveImage (#159) を介してベースラインとして保存されます。このブランチでは、主な入力は正/負のプロンプトと、必要に応じて KSampler (#167) のシード戦略です。

グループ: I2I#

すでに処理する画像がある場合はこのパスを選択します。LoadImage (#157) を介してロードし、NovaNodes (#146) のイメージバイパススイート入力に IMAGE 出力をルートします。これにより、テキストのコンディショニングとサンプリングが完全にバイパスされます。これは、バッチ後処理、既存のデータセットでの実験、または他のワークフローからの出力の標準化に理想的です。生成または厳密に変換したいかどうかに応じて、T2I と I2I の間で自由に切り替えることができます。

グループ: イメージバイパススイート#

これがグラフの中心です。中央のプロセッサー NovaNodes (#146) は、受信画像と2つのオプションブロック: CameraOptionsNode (#145) および NSOptionsNode (#144) を受け取ります。このノードは、周波数整形 (FFTスムージング/マッチング)、ピクセルおよび位相の摂動、局所コントラストおよびトーン処理、オプションの3D LUT、およびテクスチャ統計の調整を制御する自動モードまたは手動モードで動作できます。2つのオプション入力により、自動ホワイトバランスリファレンスとFFT/テクスチャリファレンス画像をプラグインして正規化をガイドできます。最終的なイメージバイパスの結果は SaveImage (#147) によって書き込まれ、ベースラインと処理された出力の両方を並べて評価することができます。

Comfyui イメージバイパスワークフローの主要ノード#

NovaNodes (#146)#

コアイメージバイパスプロセッサーです。周波数ドメイン整形、空間摂動、局所トーンコントロール、LUT適用、およびオプションのテクスチャ正規化を調整します。awb_ref_image または fft_ref_image を提供すると、パイプラインの初期段階でそれらのリファレンスを使用して色とスペクトルマッチングをガイドします。自動モードで合理的なベースラインを取得し、手動モードに切り替えてコンテンツおよび下流タスクに合わせて効果の強さとブレンドを微調整します。比較を一貫して行うためにシードを設定し再利用し、探索のためにマイクロバリエーションを多様化するためにランダム化します。

NSOptionsNode (#144)#

知覚的な類似性を保ちながらピクセルを微調整する非セマンティックオプティマイザーを制御します。反復回数、学習率、知覚/正則化の重み (LPIPS と L2) と勾配クリッピングを公開します。目に見えるアーティファクトを最小限に抑えた微妙な分布シフトが必要な場合に使用します。自然なテクスチャとエッジを維持するために変更を控えめに保ちます。オプティマイザーなしでイメージバイパスパイプラインがどれだけ役立つかを測定するために完全に無効にします。

CameraOptionsNode (#145)#

デモザイクおよびJPEGサイクル、ビネット、色収差、モーションブラー、バンディング、読み取りノイズなどのセンサーおよびレンズ特性をシミュレートします。画像に現実的な取得アーティファクトを追加できるリアリズム層として扱います。ターゲットキャプチャ条件に一致するコンポーネントのみを有効にします。多すぎると外観を過度に制約する可能性があります。再現可能な出力のために、他のパラメータを変化させながら同じカメラオプションを保持します。

ModelSamplingAuraFlow (#166)#

モデルが KSampler (#167) に到達する前に、ロードされたモデルのサンプリング動作を修正します。選択したバックボーンが別のステップ軌道から利益を得る場合に役立ちます。プロンプトの意図とサンプル構造の間に不一致がある場合に調整し、サンプラーとスケジューラーの選択と組み合わせて扱います。

KSampler (#167)#

モデル、正/負のコンディショニング、および開始潜在に基づいて拡散サンプリングを実行します。主なレバーはシード戦略、ステップ、サンプラータイプ、および全体的なノイズ除去強度です。ステップを下げると速度が向上し、ステップを上げるとベースモデルが必要とする場合に構造が安定します。イメージバイパス設定を繰り返す間、このノードの動作を安定させて、変更をジェネレーターではなく後処理に帰することができるようにします。

オプションの追加#

- モデルを自由に交換します。イメージバイパススイートはモデルに依存せず、

z_image_turbo_bf16を置き換えても同じ処理スタックを通じて結果をルートできます。 - リファレンスを賢く使用します。

awb_ref_imageおよびfft_ref_imageを提供し、ターゲットドメインと照明およびコンテンツの特性を共有します。リファレンスが一致しないとリアリズムが低下します。 - 公平に比較します。

SaveImage(#159) をベースラインとして、SaveImage(#147) をイメージバイパス出力として保持し、設定をA/Bテストし改善を追跡します。 - バッチを慎重に扱います。

EmptySD3LatentImage(#162) のバッチサイズをVRAMが許す限り増やし、パラメータの小さな変更を測定するときは固定シードを優先します。 - ユーティリティを学びます。イメージバイパスコンポーネントの機能詳細および継続的な更新については、上流プロジェクトを参照してください: PurinNyova/Image-Detection-Bypass-Utility。

クレジット#

- このワークフローで使用されるグラフエンジンComfyUI: comfyanonymous/ComfyUI。

- 例のベースチェックポイント: Comfy-Org/z_image_turbo。

謝辞#

このワークフローは以下の作品およびリソースを実装し、構築しています。我々は、Image-Detection-Bypass-Utilityの貢献とメンテナンスに感謝します。権威ある詳細については、以下にリンクされたオリジナルのドキュメントおよびリポジトリを参照してください。

リソース#

- PurinNyova/Image-Detection-Bypass-Utility

- GitHub: PurinNyova/Image-Detection-Bypass-Utility

- ドキュメント / リリースノート: Repository (tree/main)

注: 参照されているモデル、データセット、およびコードの使用は、それぞれの著者およびメンテナーによって提供されるライセンスおよび条件に従います。