Trasforma immagini in video fluidi con scene naturali e movimento coerente.

multi_shots consente al modello Wan 2.6 di generare tagli di camera dinamici o angolazioni variabili da un singolo input statico.Wan 2.6 da Immagine a Video rappresenta un balzo in avanti rispetto alle precedenti iterazioni di Wan 2.5, ottimizzando specificamente la coerenza temporale e introducendo la reattività audio nativa per l'animazione dei personaggi.

False per una ripresa continua e fluida.True per consentire all'IA di simulare tagli di camera dinamici o movimento intenso.

Trasforma immagini in video fluidi con scene naturali e movimento coerente.

Animazioni AI di alta qualità, controllo in tempo reale e effetti pro

Crea ritratti video realistici e dinamici partendo da semplici immagini statiche

Trasforma immagini in video perfetti con controllo del movimento preciso

Crea video realistici e fluidi da due immagini con transizioni perfette

Trasforma immagini in video realistici con movimento fluido e look cinematografico.

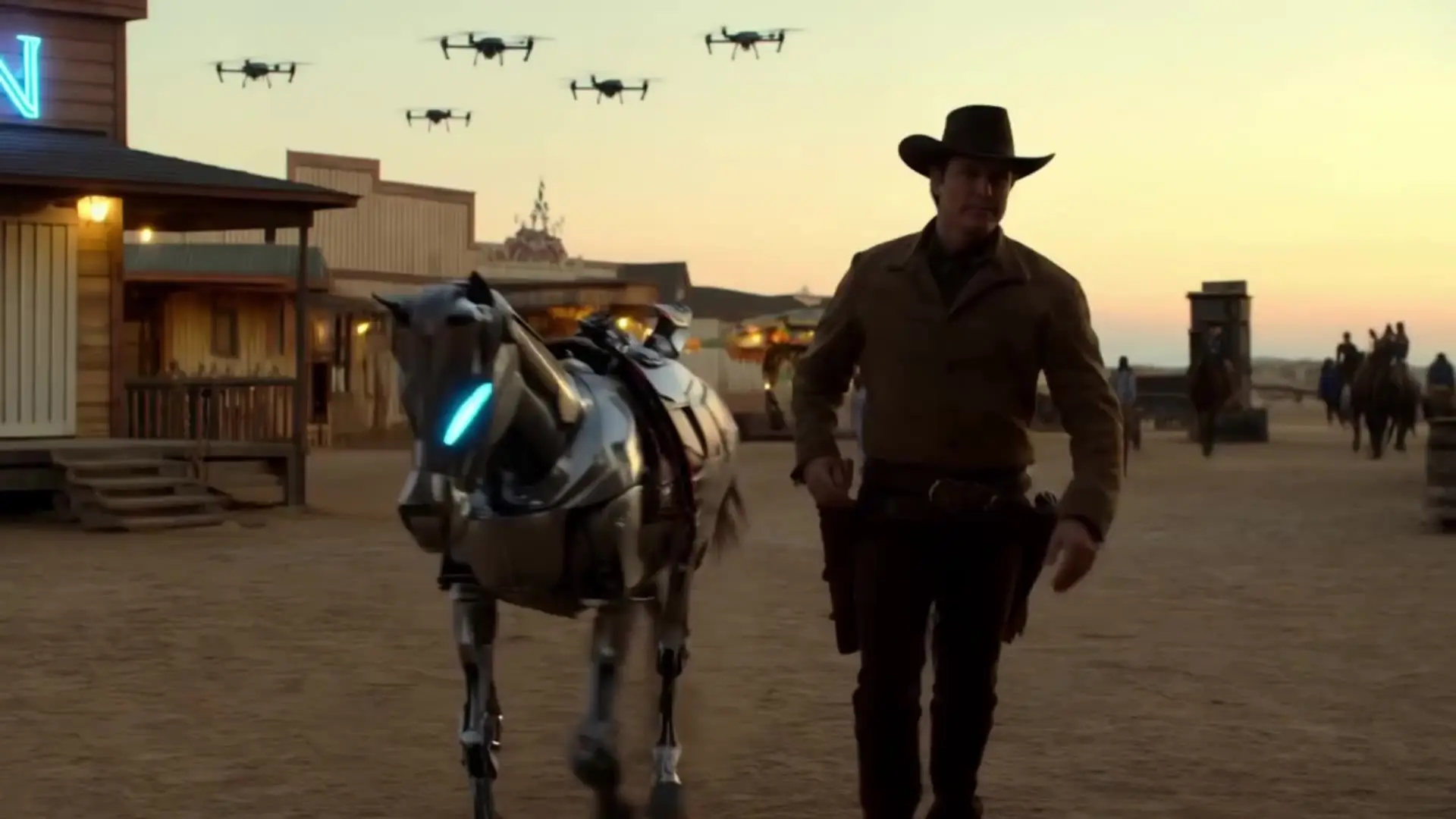

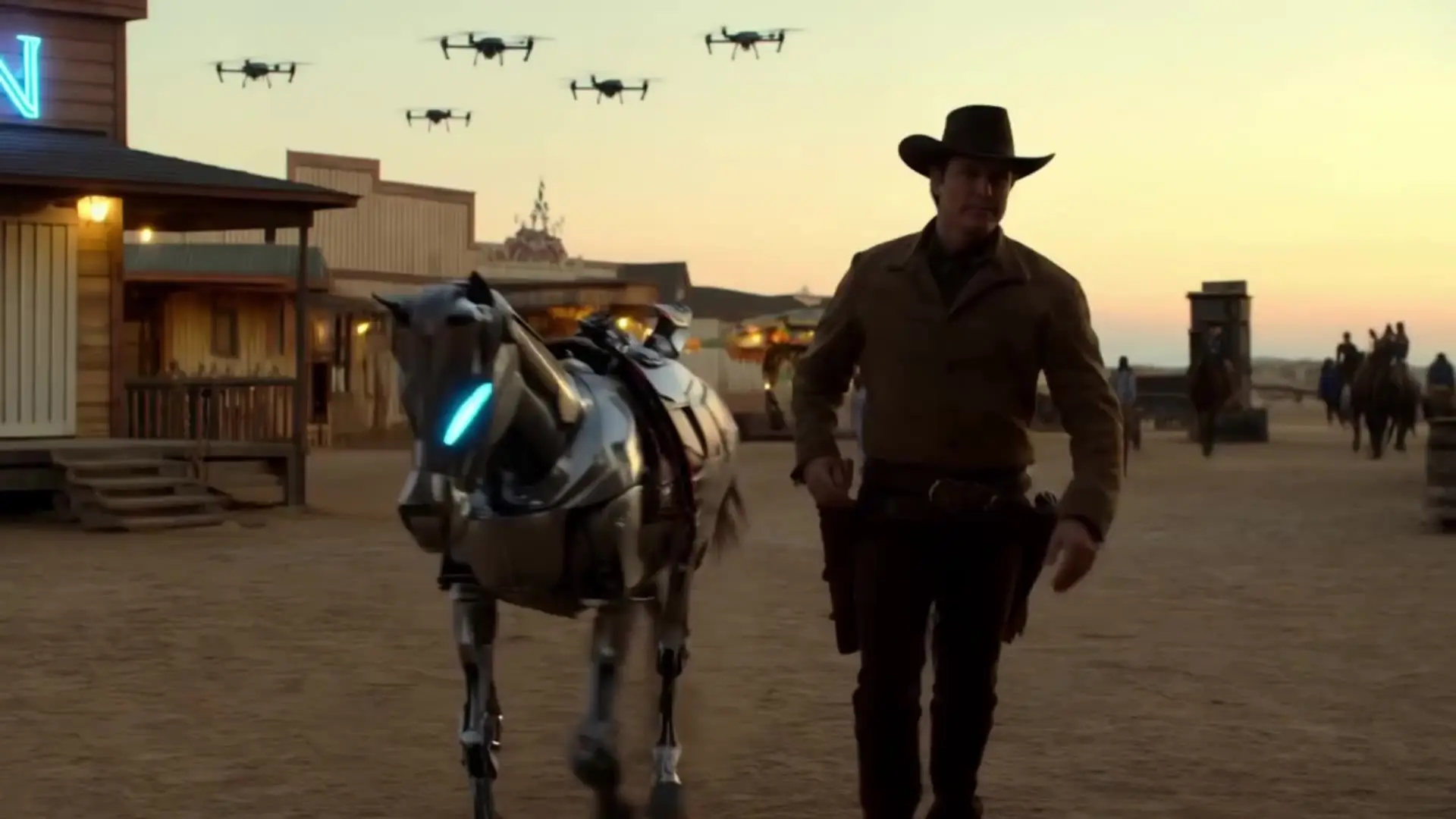

Wan 2.6 è una piattaforma avanzata di IA multimodale che trasforma immagini statiche in clip dinamiche grazie alla funzione image-to-video. Consente ai creator di animare immagini ferme con movimenti di camera fluidi e motion naturale, perfetta per contenuti cinematografici o promozionali.

Rispetto a Wan 2.5, Wan 2.6 offre maggiore realismo, durate di scena più lunghe, migliore stabilità temporale e una sincronizzazione audio‑visiva più naturale per la generazione image-to-video. Questo rende l’output più pronto per la produzione rispetto alla maggior parte dei modelli concorrenti.

L’accesso a Wan 2.6 funziona con un sistema a crediti all’interno del Runcomfy AI Playground. Gli utenti possono riscattare crediti per generare output image-to-video. Ogni nuovo account riceve crediti di prova gratuiti, mentre l’uso continuativo è tariffato secondo la sezione “Generation” della piattaforma.

Wan 2.6 è ideale per video editor, team marketing, educatori e creator social che hanno bisogno di animazioni rapide e realistiche a partire da visual statici. Lo strumento image-to-video è adatto a contenuti come clip pubblicitari, scene e‑learning e showcase di prodotto.

Wan 2.6 supporta risoluzione 1080p a 24 fps per tutti gli output image-to-video, con opzioni di esportazione MP4, MOV e WebM. La sincronizzazione audio‑visiva nativa garantisce lip‑sync professionale e transizioni di camera fluide.

Sì. Wan 2.6 consente di caricare immagini o video di riferimento per guidare stile e movimento dei progetti image-to-video. Inoltre genera voiceover e suoni ambientali completamente sincronizzati per un risultato finale coerente.

Assolutamente. Wan 2.6 supporta più lingue con lip‑sync nativo e allineamento vocale nella generazione image-to-video, rendendolo ideale per campagne globali e produzione video localizzata.

Wan 2.6 è accessibile tramite il Runcomfy AI Playground su runcomfy.com/playground. L’interfaccia funziona in modo fluido su browser desktop e mobile, consentendo la creazione image-to-video ovunque.

Anche se Wan 2.6 offre risultati di alta qualità, è meglio fornire prompt dettagliati, perché descrizioni di movimento vaghe possono portare a risultati incoerenti. Il modello non supporta completamente il negative prompting in image-to-video, quindi è consigliato descrivere in modo esplicito le azioni desiderate.

RunComfy is the premier ComfyUI platform, offering ComfyUI online environment and services, along with ComfyUI workflows featuring stunning visuals. RunComfy also provides AI Models, enabling artists to harness the latest AI tools to create incredible art.