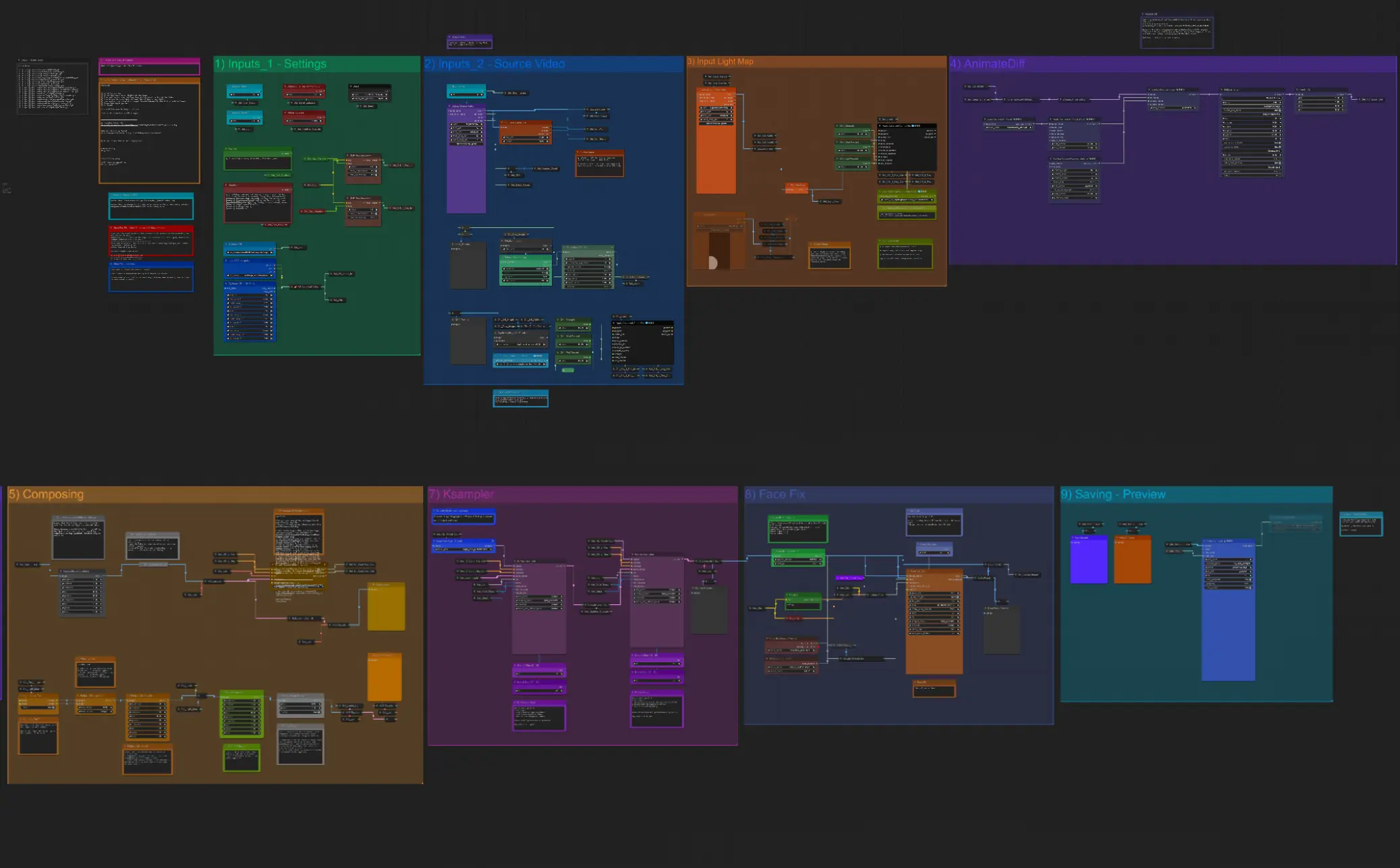

Workflow ComfyUI IC-Light per Video Relighting#

Sblocca tutto il potenziale dei tuoi progetti video con il workflow ComfyUI IC-Light, progettato specificamente per migliorare l'illuminazione nei video dei tuoi personaggi "Human" usando una lightmap. Con ComfyUI IC-Light, puoi trasformare facilmente i tuoi video semplicemente fornendo i tuoi prompt e gli elementi della lightmap, come forme e luci al neon. Lo strumento creerà un nuovo video con un'illuminazione notevolmente migliorata.

COME USARE il workflow ComfyUI IC-Light#

- Carica il Video di Origine: Inizia caricando il video che desideri migliorare.

- Carica il Video Light Map o l'Immagine Light Map Singola: Scegli un video light map o un'immagine singola da utilizzare come nuovo template di illuminazione.

- Inserisci Load Cap e altre Impostazioni, le stesse impostazioni dovrebbero essere nel Video Light Map.

- Inserisci i Prompt che descrivono le tue nuove impostazioni di illuminazione come la luce solare o le luci al neon.

- Seleziona il Modello. È preferito un modello realistico.

- Modifica la Composizione della Light Map e altre Impostazioni se necessario.

- Premi su render.

Gli output saranno salvati in ComfyUI > Outputs

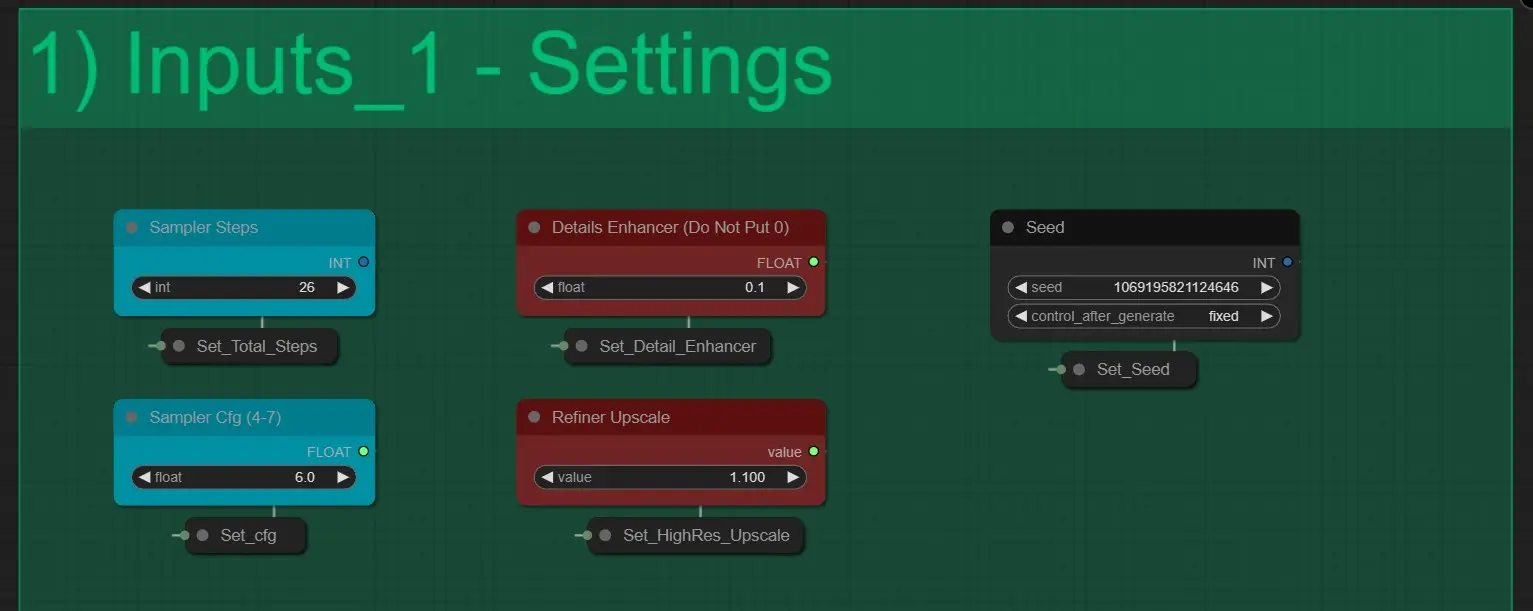

Inputs_1 - Impostazioni#

Qui abbiamo 5 Impostazioni:

- Sampler Steps: Determina il numero totale di passaggi che il KSampler impiega per renderizzare un'immagine. Non dovrebbe essere cambiato. [Valore Predefinito 26]

- Detail Enhancer: Aumenta i dettagli minuti nel Render Finale. [Usa un valore tra 0.1 e 1]

- Seed: Controlla il Seed di Generazione per ogni KSamplers.

- Sampler CFG: Controlla i valori CFG dei KSamplers.

- Refiner Upscale: Funziona come il valore Highres Fix. [Usa tra 1.1 – 1.6 per i migliori risultati]

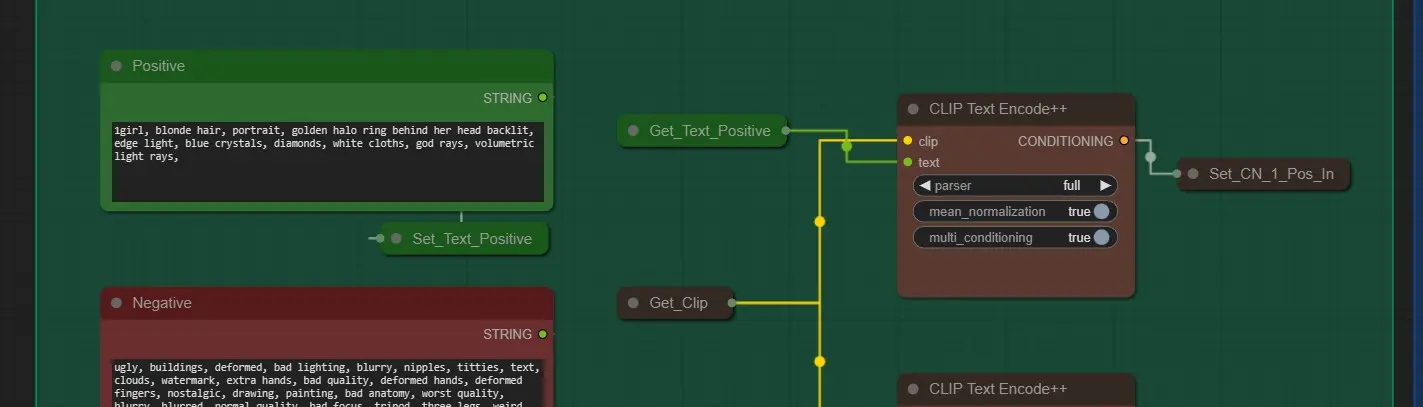

Prompt#

- Positive Prompt: Inserisci i prompt che descrivono al meglio la tua Immagine con la nuova illuminazione.

- Negative Prompts: È configurato per dare i migliori risultati. Sentiti libero di modificarlo.

- Clip Text Encode nodes: Aiuta a codificare il testo per massimizzare la qualità. Lascialo su “full”

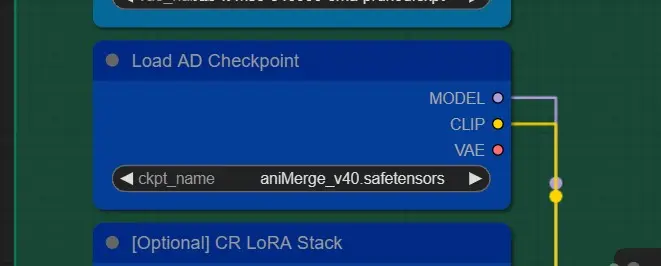

Models and Loras#

- Checkpoint: Scegli qualsiasi modello realistic SD 1.5 per risultati accurati. Sentiti libero di scegliere qualsiasi modello SD 1.5 per risultati stilistici.

- Loras: [Opzionale] Scegli qualsiasi loras dalla lista fornita se lo desideri. Non usarli alla massima potenza. Usa circa 0.5-0.7 per l'effetto migliore

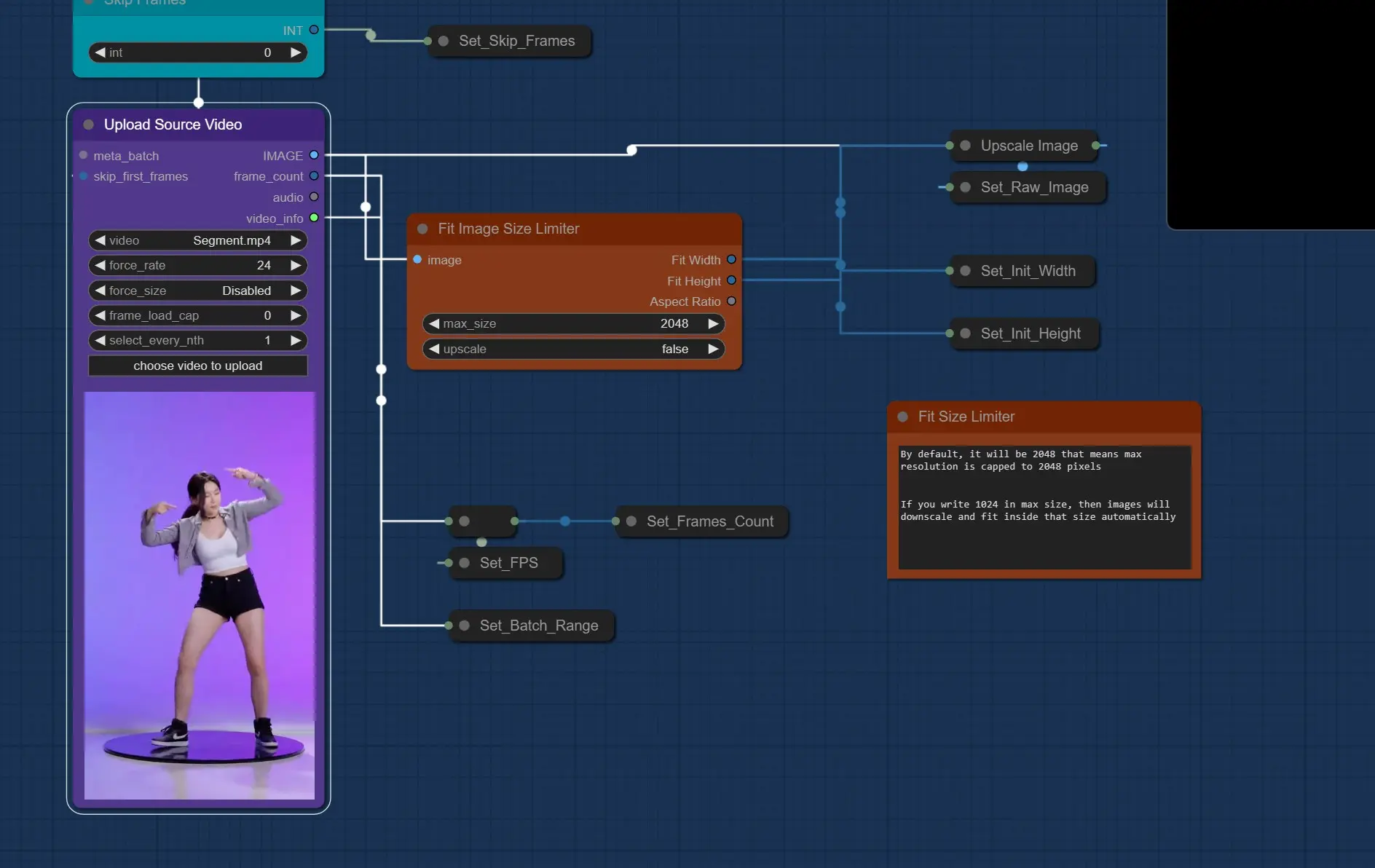

Input Source Video#

- Carica il Video di Origine: Qui clicchi e carichi il video del tuo personaggio umano che desideri cambiare la luce.

- Deve essere inferiore a 100 MB, Comfy non riuscirà a caricare file di grandi dimensioni.

- Non deve durare più di 15-20 secondi. Potrebbe non riuscire a renderizzare video più lunghi

- Deve essere in 720p o inferiore

- Usa i nodi Skip Frames se hai bisogno di saltare alcuni fotogrammi iniziali. [Anche i video Light Map salteranno questi fotogrammi]

- Fit Image Size Limiter: Qui limiti la risoluzione di rendering, sia in formato paesaggio che ritratto, la risoluzione massima sarà sempre inferiore o uguale al valore impostato.

- Usa un valore tra 800 – 1200 per i migliori risultati. [Questo influenzerà la Vram]

- Usa un valore tra 800 – 1200 per i migliori risultati. [Questo influenzerà la Vram]

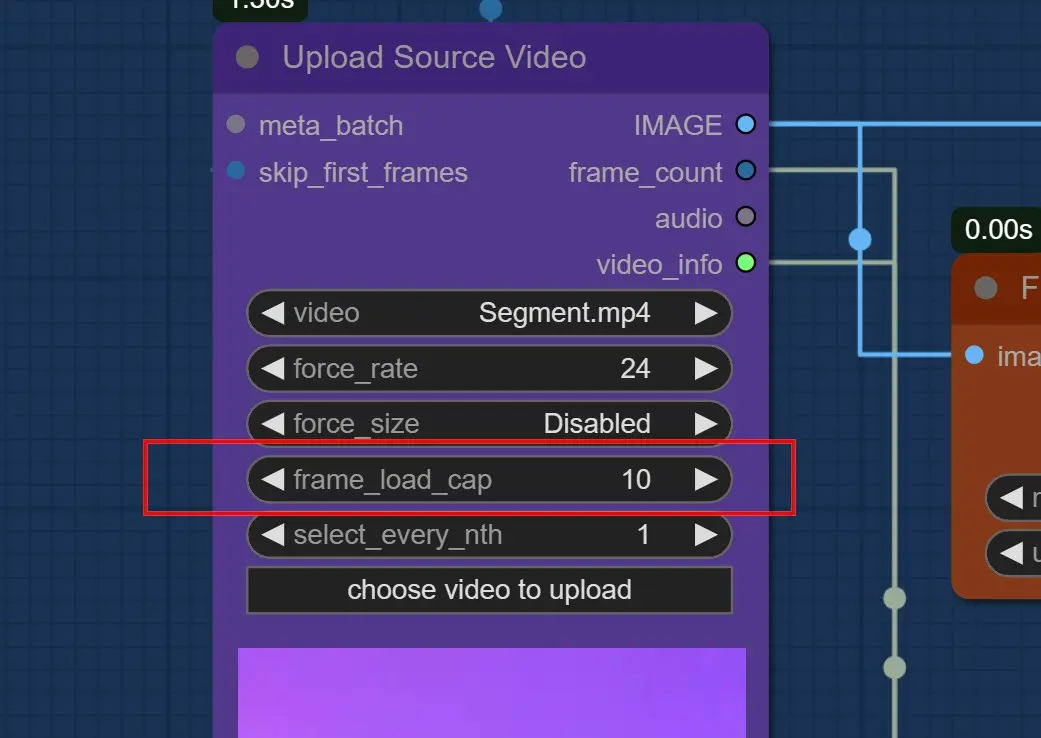

Importante: Usa un Frames Load Cap di 10 per Testare Prima

- Usa circa 200 - 300 fotogrammi a 1000 – 1200 fit size, se hai 24 GB.

- Usa 0 se vuoi renderizzare tutti i fotogrammi. [Non Raccomandato per video più lunghi]

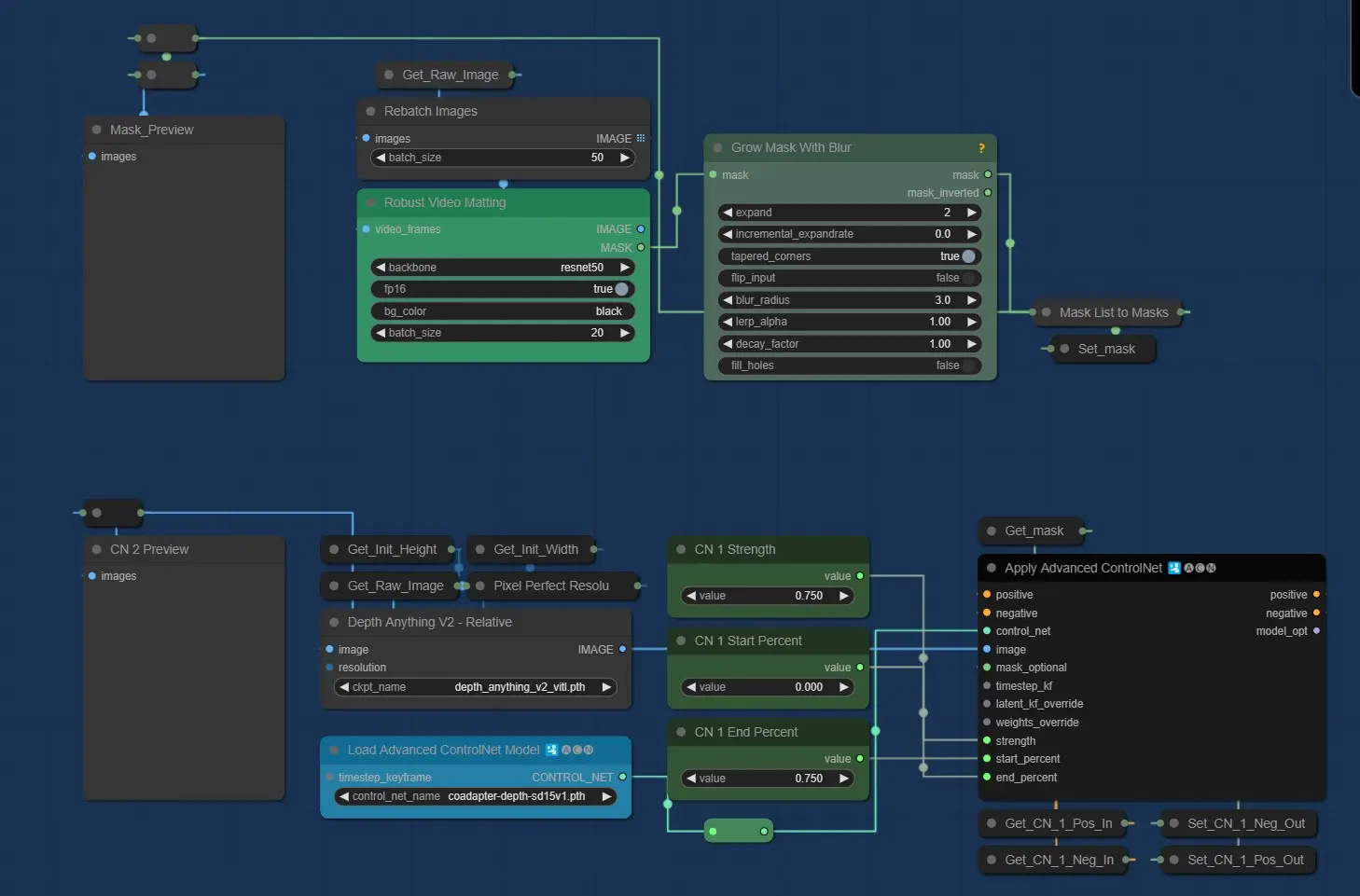

Impostazioni di Maschera e Profondità#

- Mask: Utilizza il Robust Video Matting, le impostazioni predefinite sono adeguate.

- Depth ControlNet: Utilizza i modelli più recenti DepthAnything v2.

- La Forza e la Percentuale di Fine sono impostate al 75% per dare risultati ottimali

- Usa Co Adaptor Depth per i migliori risultati.

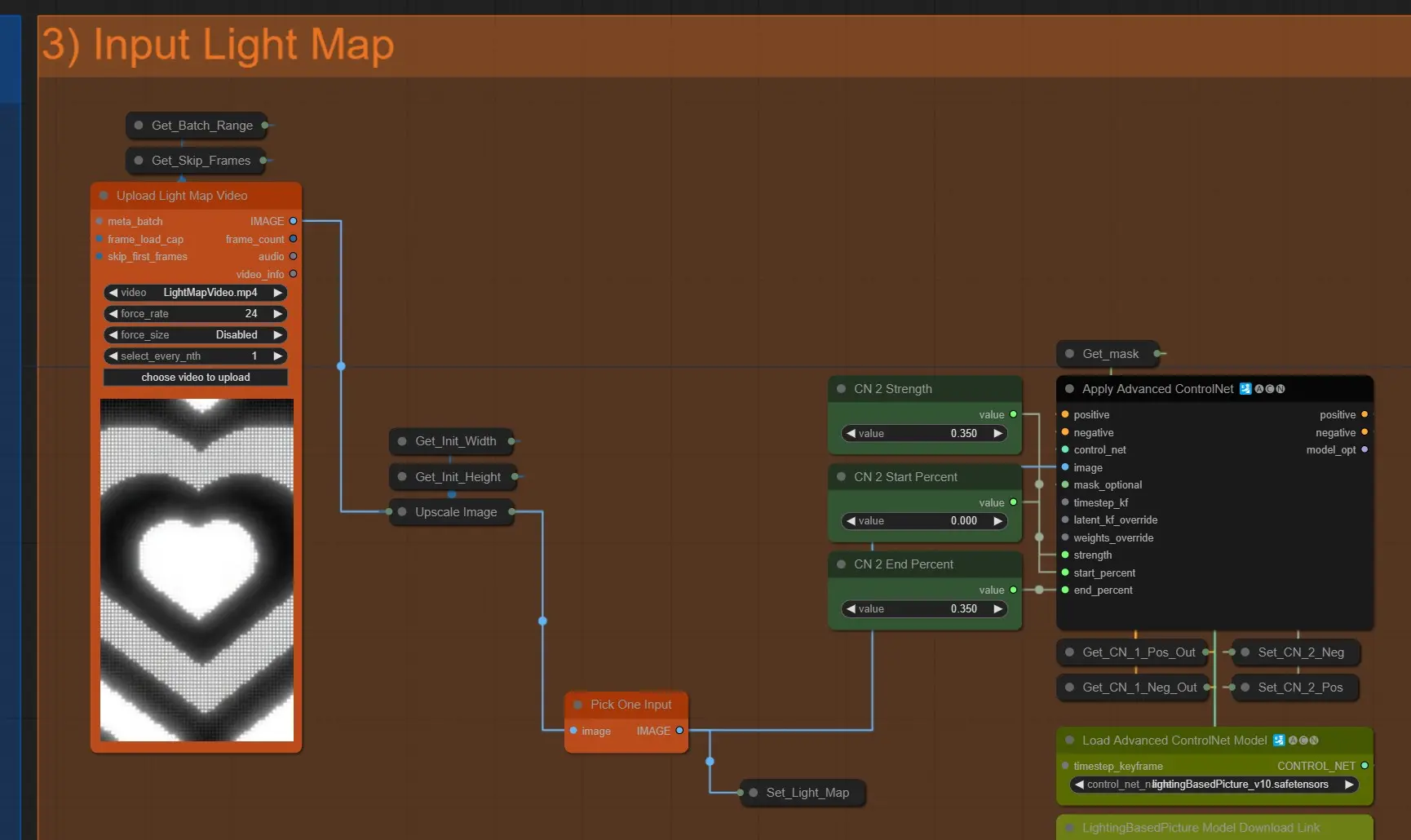

Light Map#

- Carica Light Map: Clicca e carica un video light map che desideri.

- Si scalerà automaticamente alle dimensioni del video di origine

- Assicurati che sia più lungo o uguale alle dimensioni del video di origine altrimenti darà errore.

- Light Map ControlNet: Questa light map è anche utilizzata come Light controlnet usando questo modello

- CN Strength e Percentuale di Fine: Usa valori bassi qui, valori più alti possono causare sovraesposizione o transizioni di luce brusche.

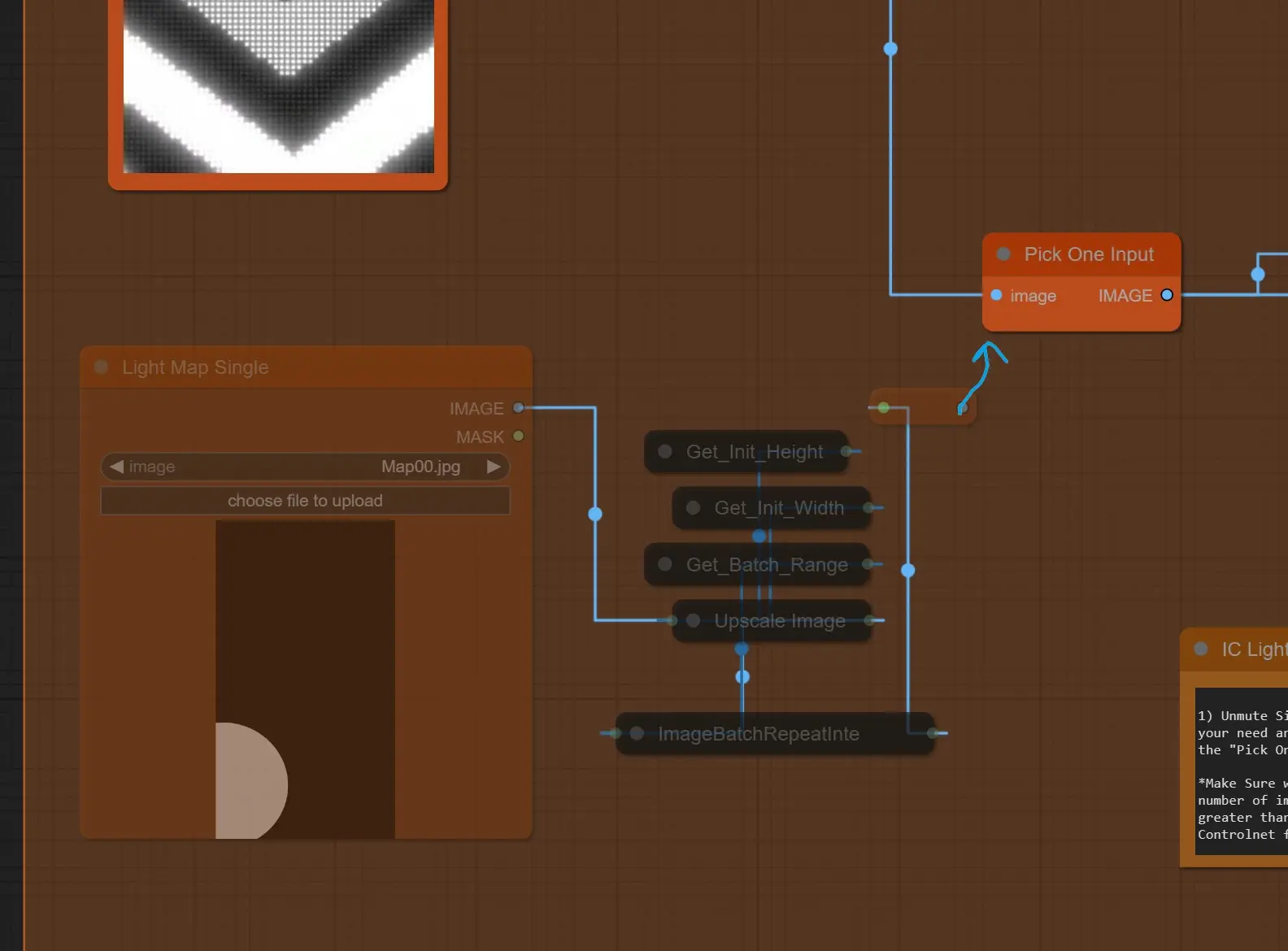

Light Map Singola#

- Per utilizzare un'Immagine Singola come light map, riattiva questi nodi e collega il nodo di reindirizzamento al Nodo “Pick one Input”.

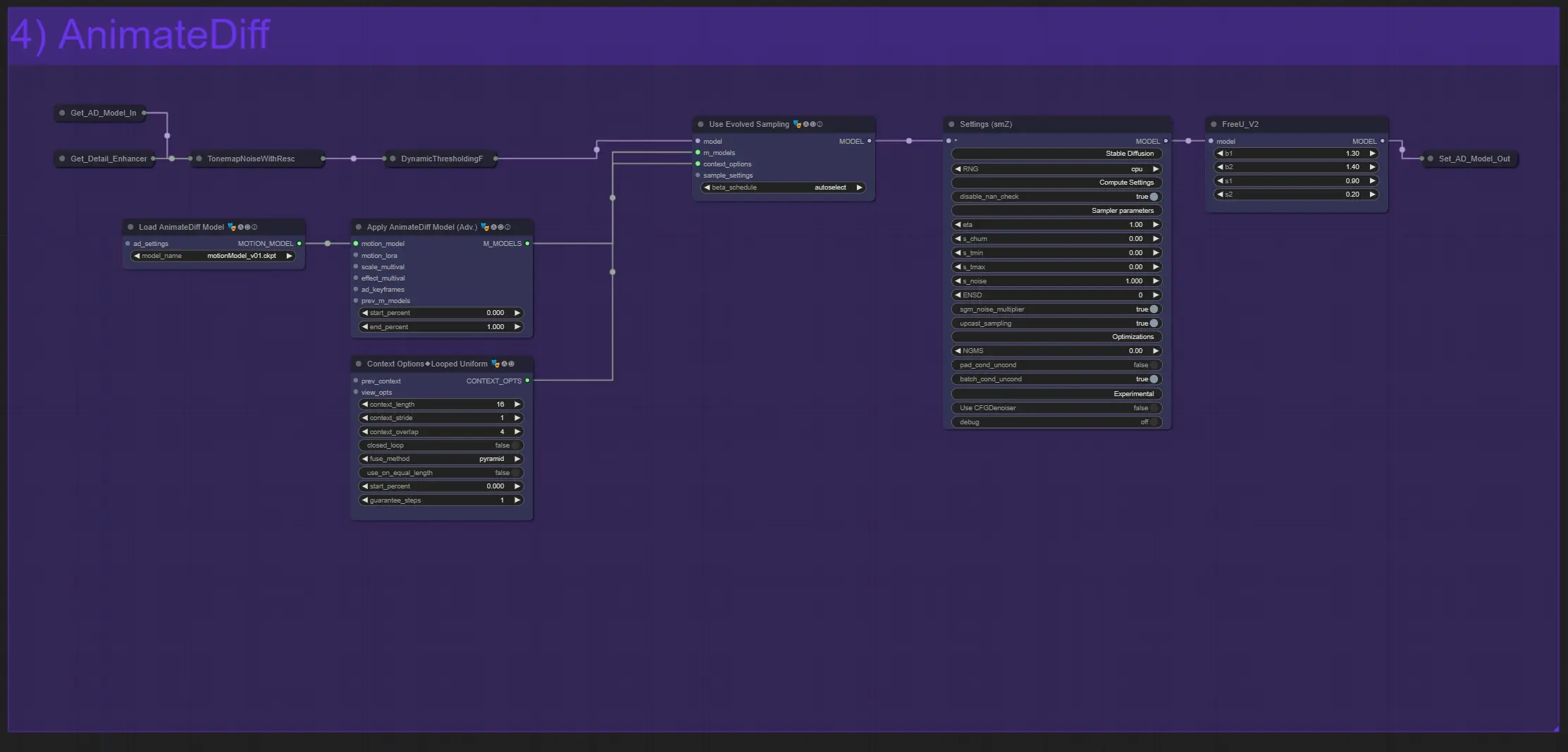

AnimateDiff#

- Carica il Modello Animatediff: Puoi usare qualsiasi modello per effetti diversi.

- Altri nodi Animatediff: Devi avere una certa conoscenza di animatediff per cambiare altre impostazioni Puoi trovarle [qui ]

- Impostazioni SMZ: Questo nodo serve per aumentare la qualità del pipeline del modello, tutte le impostazioni sono predefinite per funzionare bene.

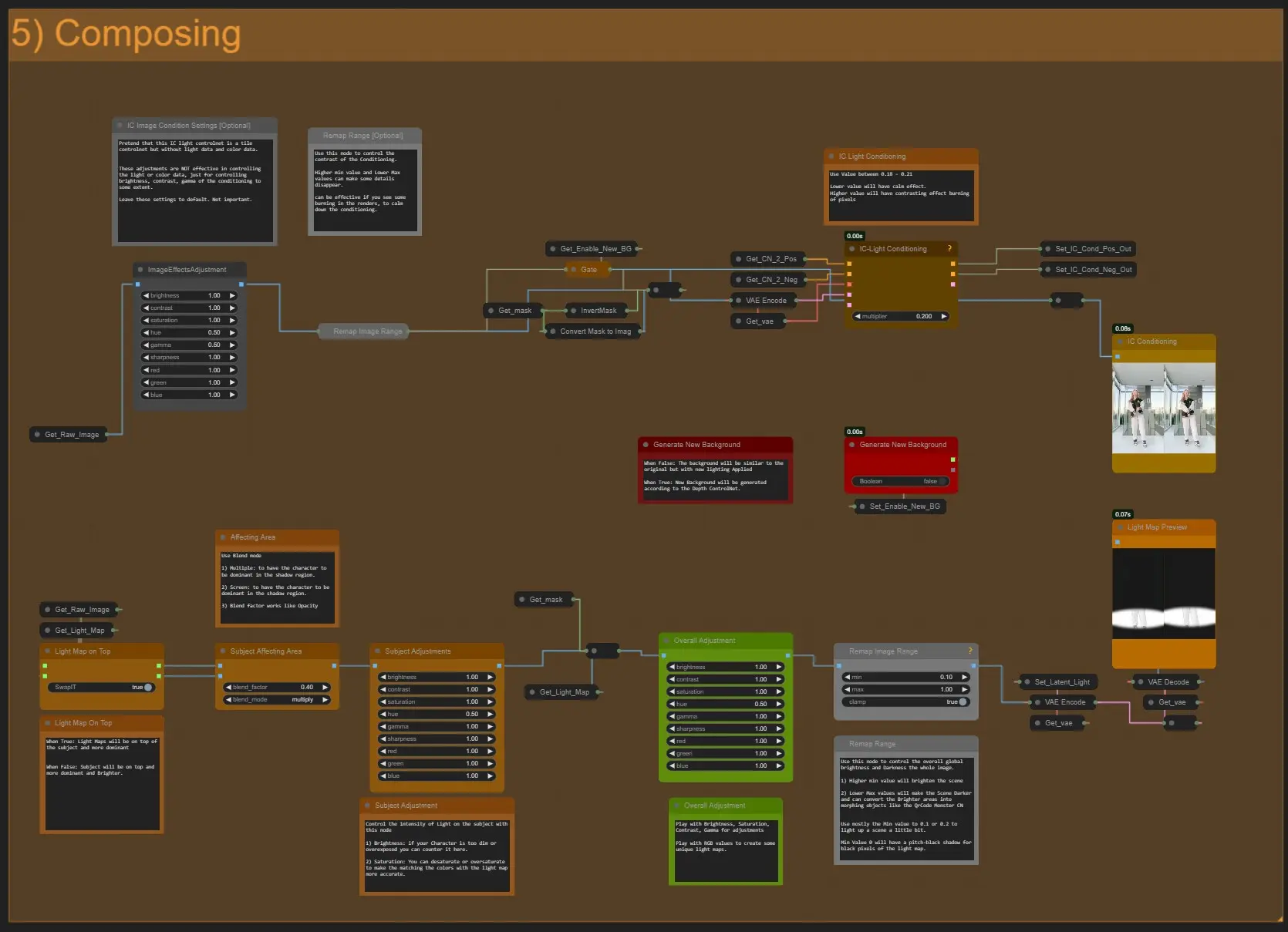

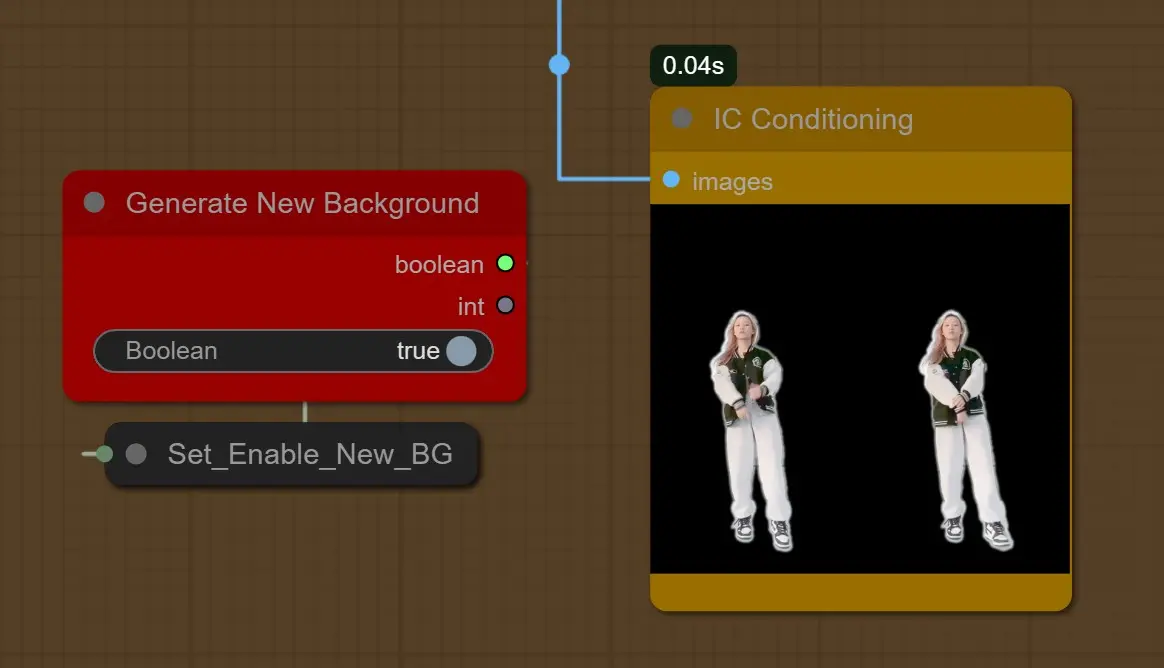

Composizione della Light Map e Condizionamento IC#

- I Nodi di Regolazione Superiore (In Colore Grigio) servono per controllare il Condizionamento della IC-Light Conditioning, per renderlo meno contrastato e controllare la luminosità.

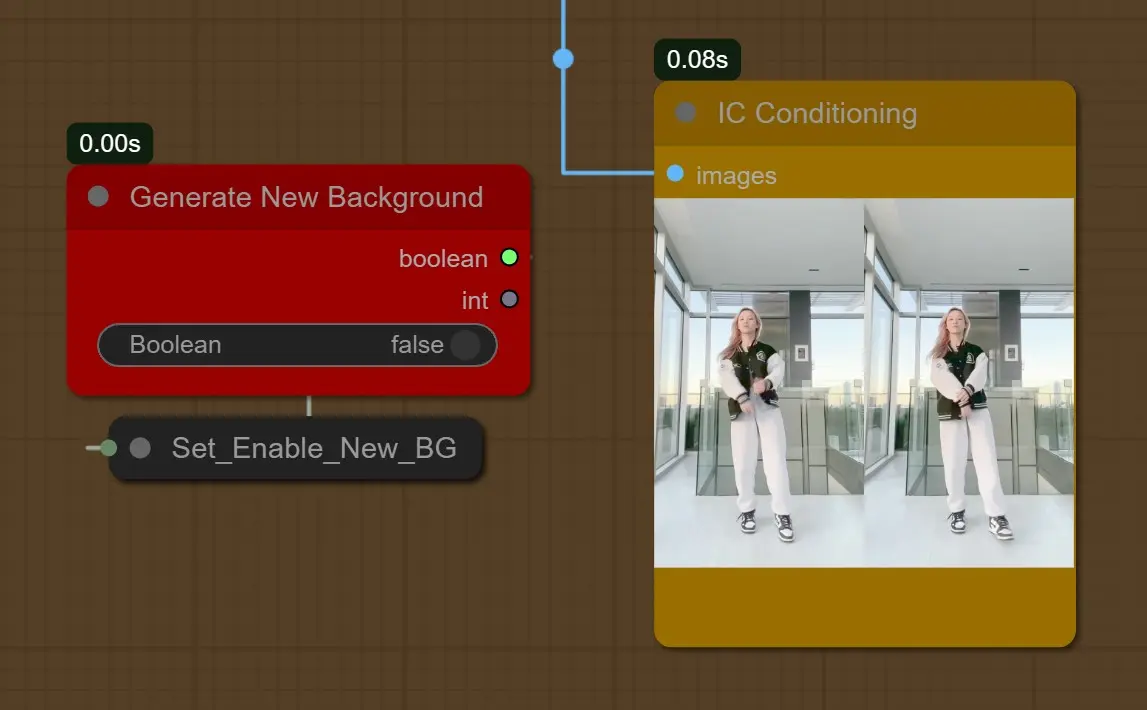

- Genera Nuovo Sfondo: Quando Disabilitato utilizzerà gli input dell'immagine originale e cercherà di mappare i dettagli simili allo sfondo del video di origine secondo i “Prompt di Sfondo” se presenti nella casella del prompt positivo

[1girl, sunlight, sunset, white shirt, black short jeans, interior, room]

- Quando Genera Nuovo Sfondo è Abilitato: Genererà un nuovo sfondo considerando la profondità

[1girl, sunlight, sunset, nature in the background, sky]

Anche la Forza e la Percentuale di Fine del Depth ControlNet sono state ridotte al 45% per avere un'area aperta nello sfondo.

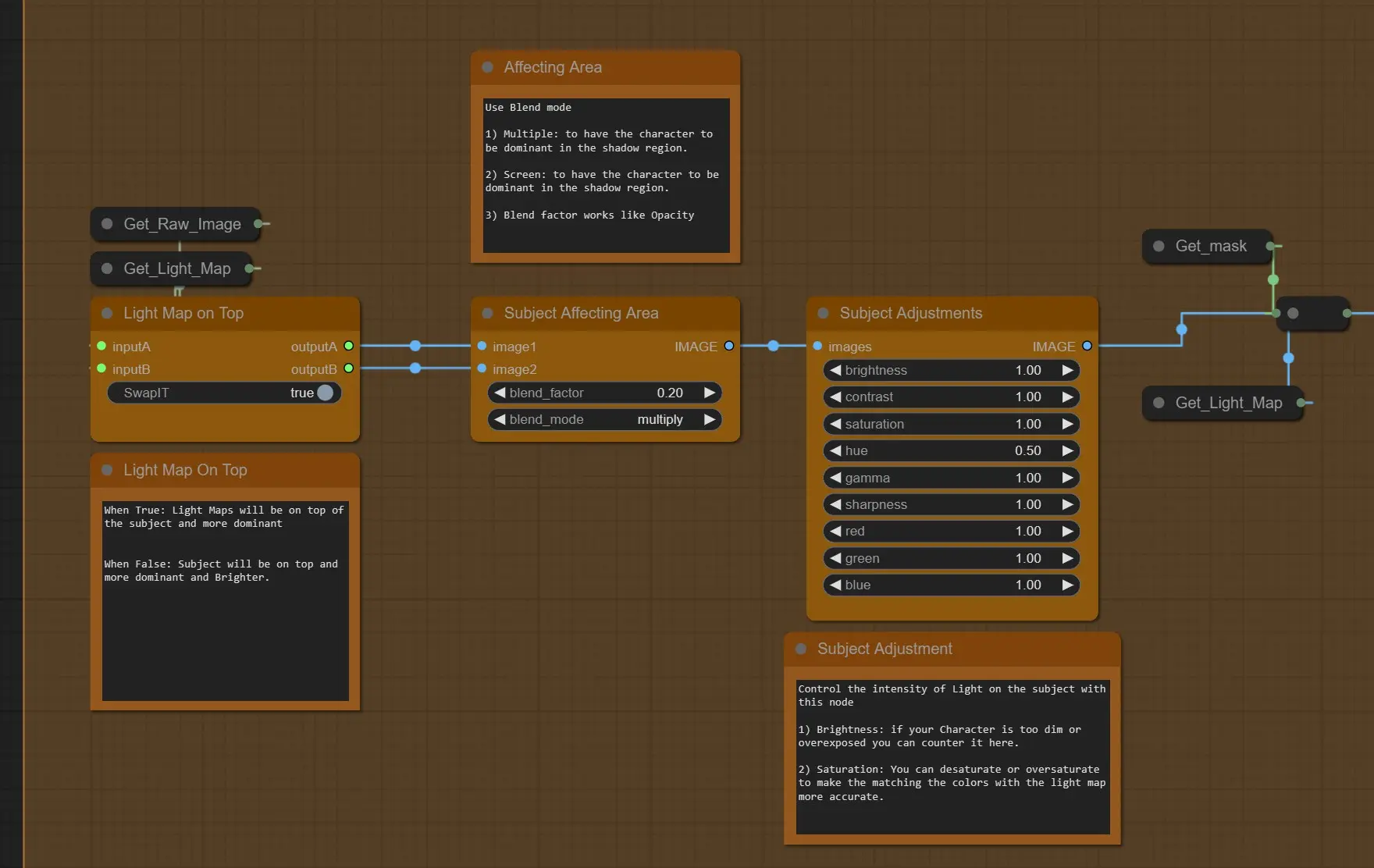

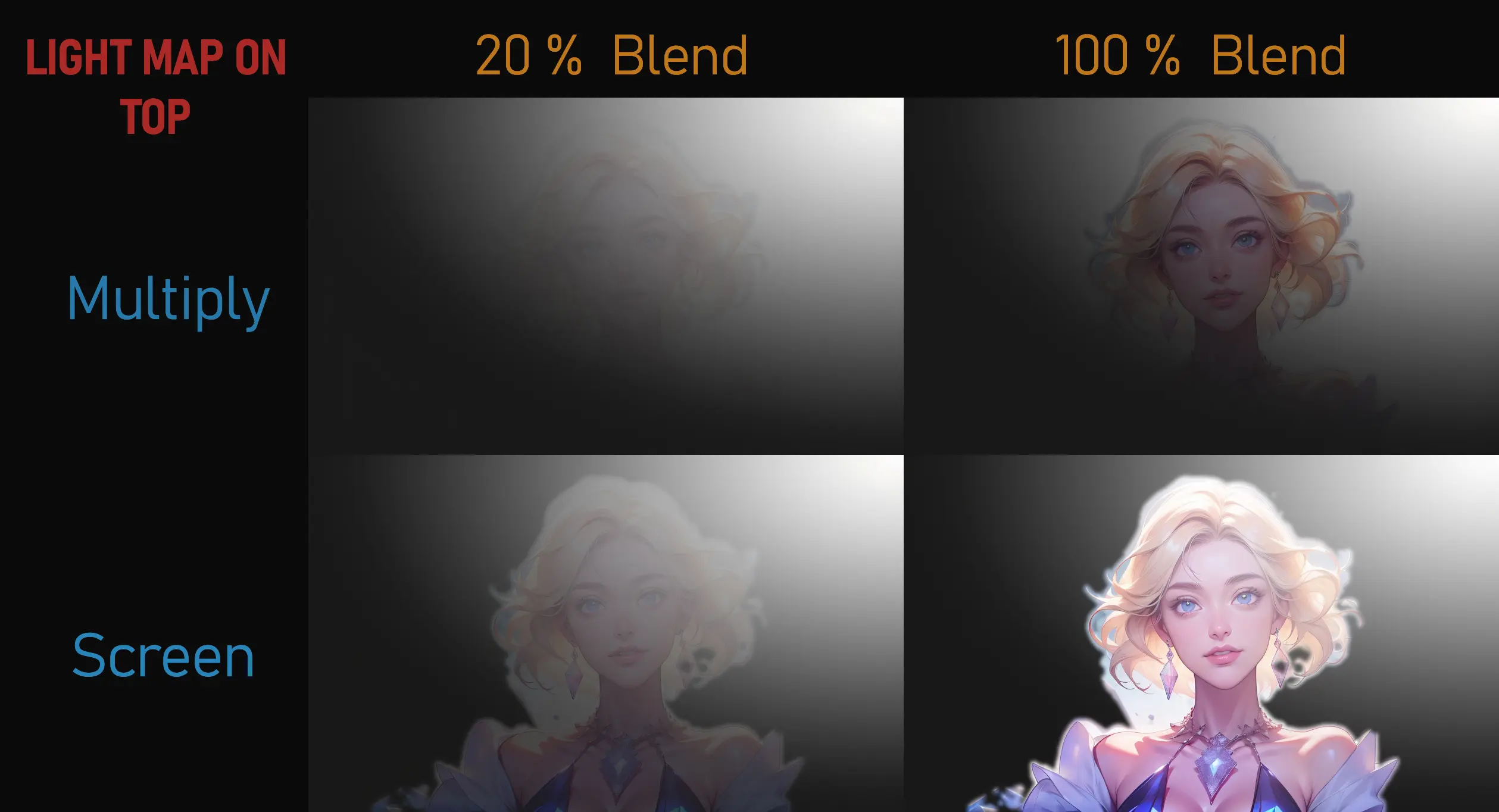

- Light Map on Top: Quando True, la light map sarà sopra il video di origine e più dominante, quando False il video di origine sarà sopra, più dominante e più luminoso

- Area di Influenza del Soggetto: Funzionano meglio 2 modalità di fusione

- Multiply: Scura le aree d'ombra secondo la light map sopra o sotto

- Screen: Illumina l'area d'ombra secondo la light map sopra o sotto

- Il Fattore di Fusione serve per l'intensità.

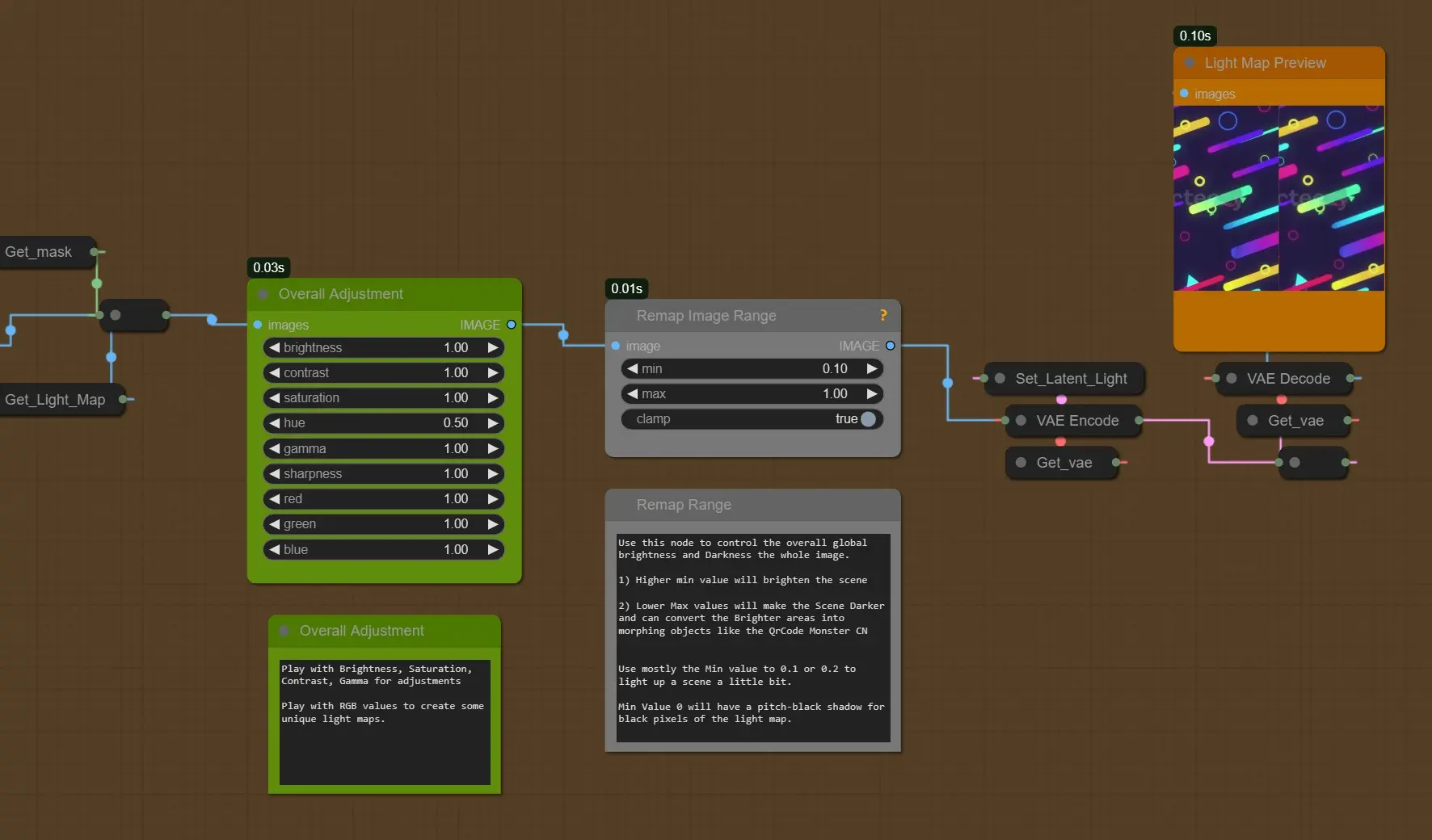

- Regolazioni Generali: Questo controllerà la luminosità, il contrasto, il gamma, la tinta della Light map finale elaborata sopra.

- Rimappatura dell'Immagine: Usa questo nodo per controllare la luminosità globale e l'oscurità dell'intera immagine.

- Un valore minimo più alto illuminerà la scena

- Valori massimi più bassi renderanno la scena più scura e possono trasformare le aree più luminose in oggetti come il QrCode Monster CN

- Usa principalmente il valore Min a 0.1 o 0.2 per illuminare leggermente una scena.

- Il valore Min 0 avrà un'ombra nera per i pixel neri della light map.

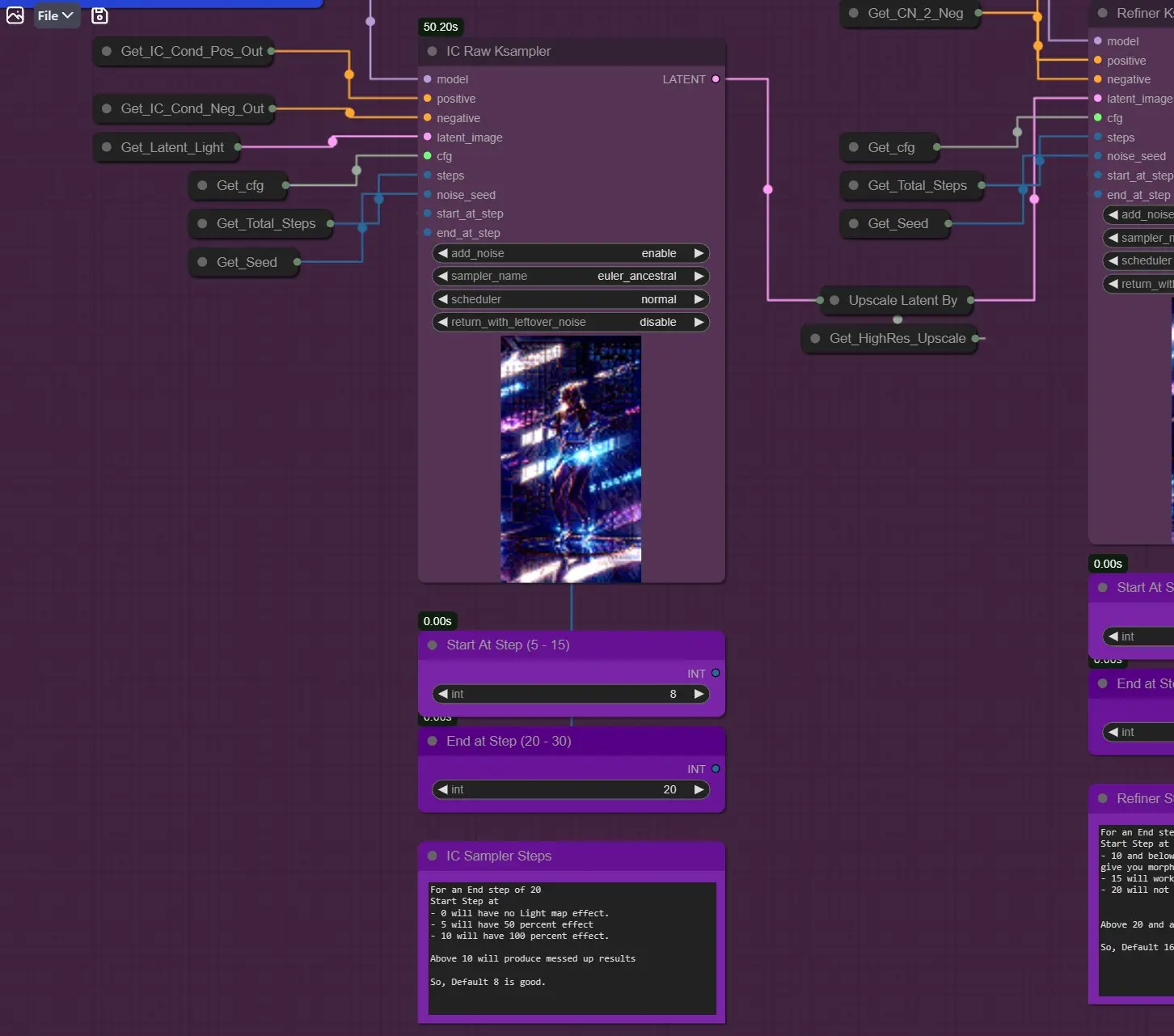

KSamplers (Raw e Refine)#

IC Raw Ksampler: A differenza di qualsiasi altro campionatore, inizia al passaggio 8 invece che a zero, a causa della Condizione IC-Light (I fotogrammi sono denoised dall'8° Passaggio)

- Per esempio, un Passaggio Finale di 20

- Passaggio Iniziale a

- 0 non avrà effetto light map.

- 5 avrà un effetto al 50 percento

- 10 avrà un effetto al 100 percento.

- Quindi, circa 3-8 è un buon valore da testare.

Quando Genera Nuovo Sfondo è TRUE, puoi andare sotto il 5 per risultati migliori

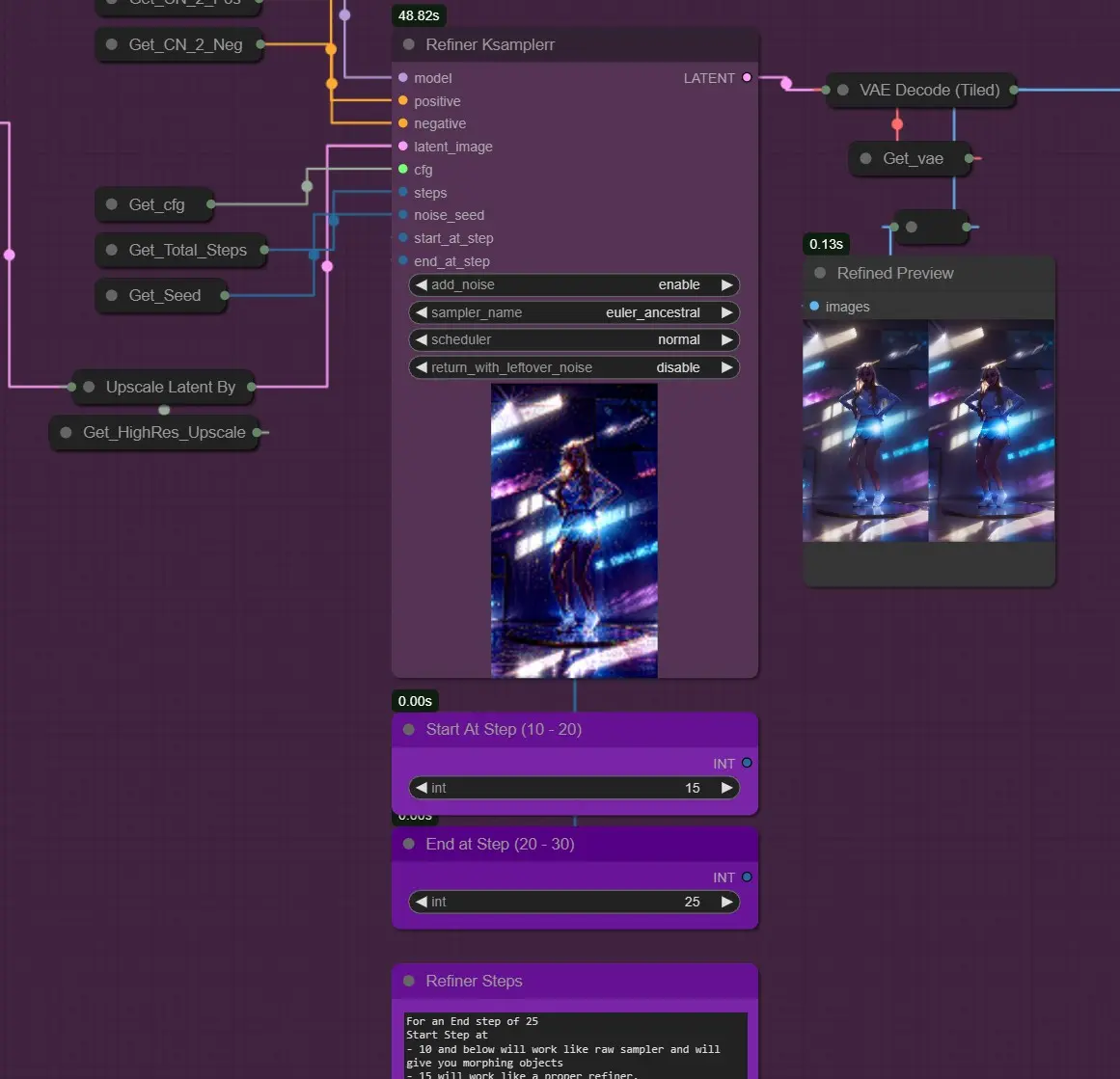

- Ksampler Refine: Funziona come un Img2Img Refiner Dopo IC raw sampler.

Per un Passaggio Finale di 25

- Passaggio Iniziale a

- 10 e sotto funzionerà come raw sampler e ti darà oggetti morphing

- 15 funzionerà come un vero e proprio refiner

- 20 non funzionerà correttamente

- Sopra i 20 e oltre produrrà risultati incasinati

- Quindi, il Default 16 è buono.

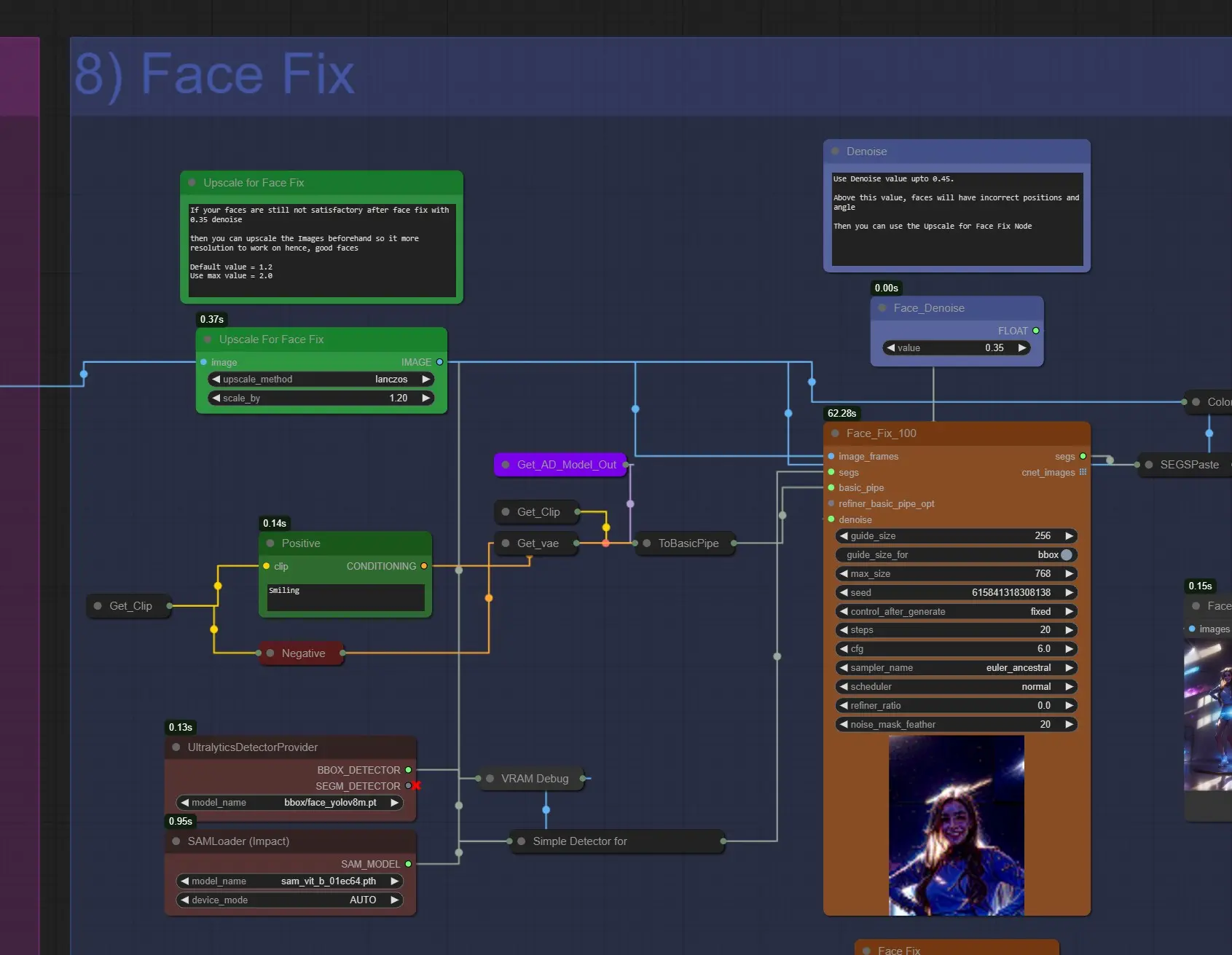

Face Fix#

- Upscale per Face Fix: Se i tuoi volti non sono soddisfacenti dopo il face fix, puoi aumentarli a circa 1.2 a 1.6 per avere volti migliori.

- Positive Prompt: Qui puoi scrivere i prompt per il volto. È impostato su “smiling” di default. Puoi cambiarlo.

- Face Denoise: Usa circa 0.35 – 0.45. Su valori più alti il volto potrebbe rendere in modo errato e potrebbero sorgere problemi di volti scorrevoli.

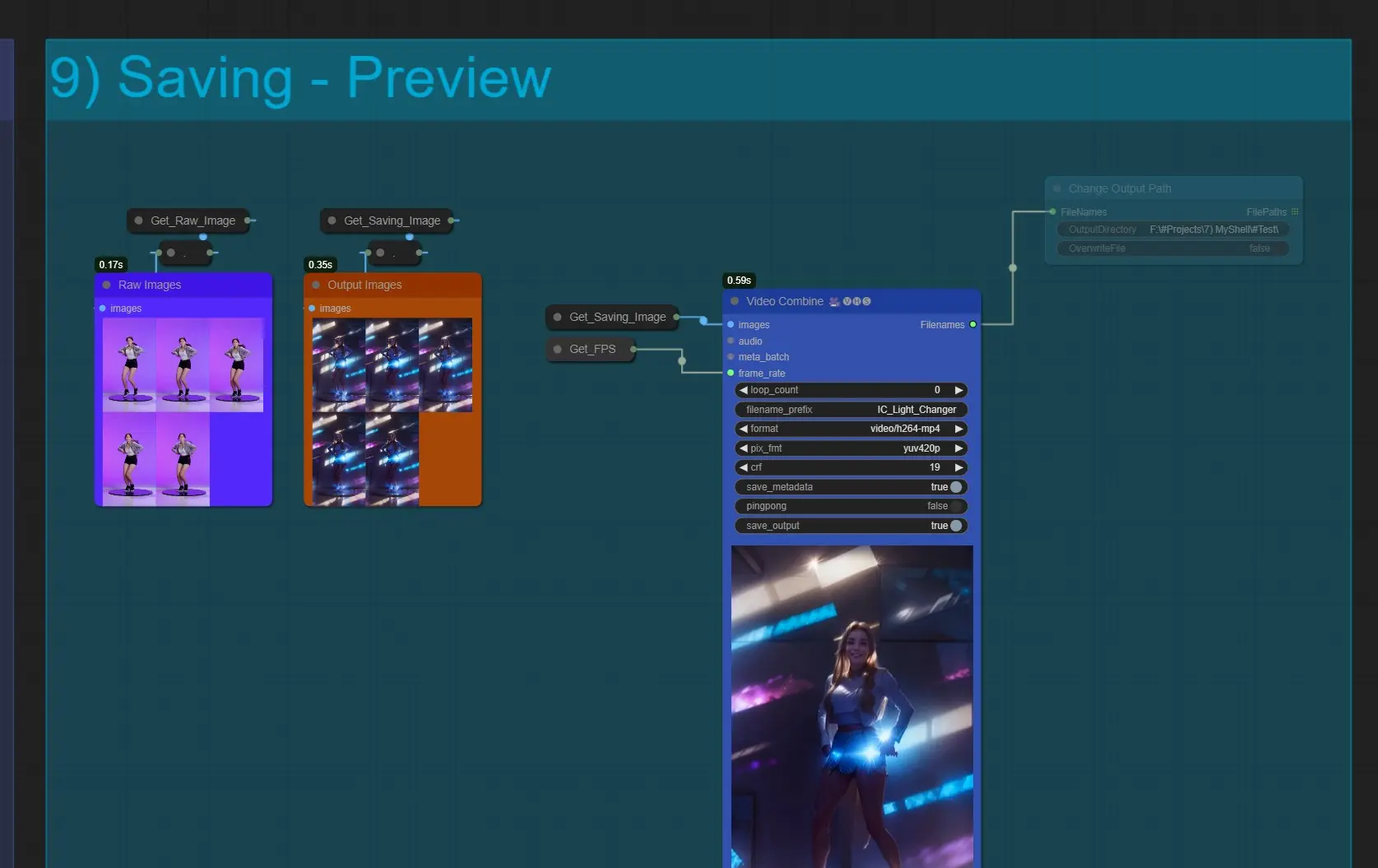

Salvataggio#

- Video Combine: Questo esporterà tutti i fotogrammi in formato video. Se questo nodo fallisce durante la combinazione significa che ci sono troppi fotogrammi e sta esaurendo la ram. Riduci il frames load cap se accade

- Sarà salvato in ComfyUI > Outputs per default.

- Cambia il Percorso di Output: Attiva questo nodo, se desideri salvare l'output in una posizione di salvataggio personalizzata

Informazioni sull'Autore di questo workflow#

Jerry Davos

- Canale YouTube: https://www.youtube.com/@jerrydavos

- Patreon: https://www.patreon.com/jerrydavos

Contatti

- Email: davos.jerry@gmail.com

- Discord: https://discord.gg/z9rgJyfPWJ