Wan2.2 Transfert d'Action Animée V7 : Workflow Vidéo Motion-to-Character pour ComfyUI#

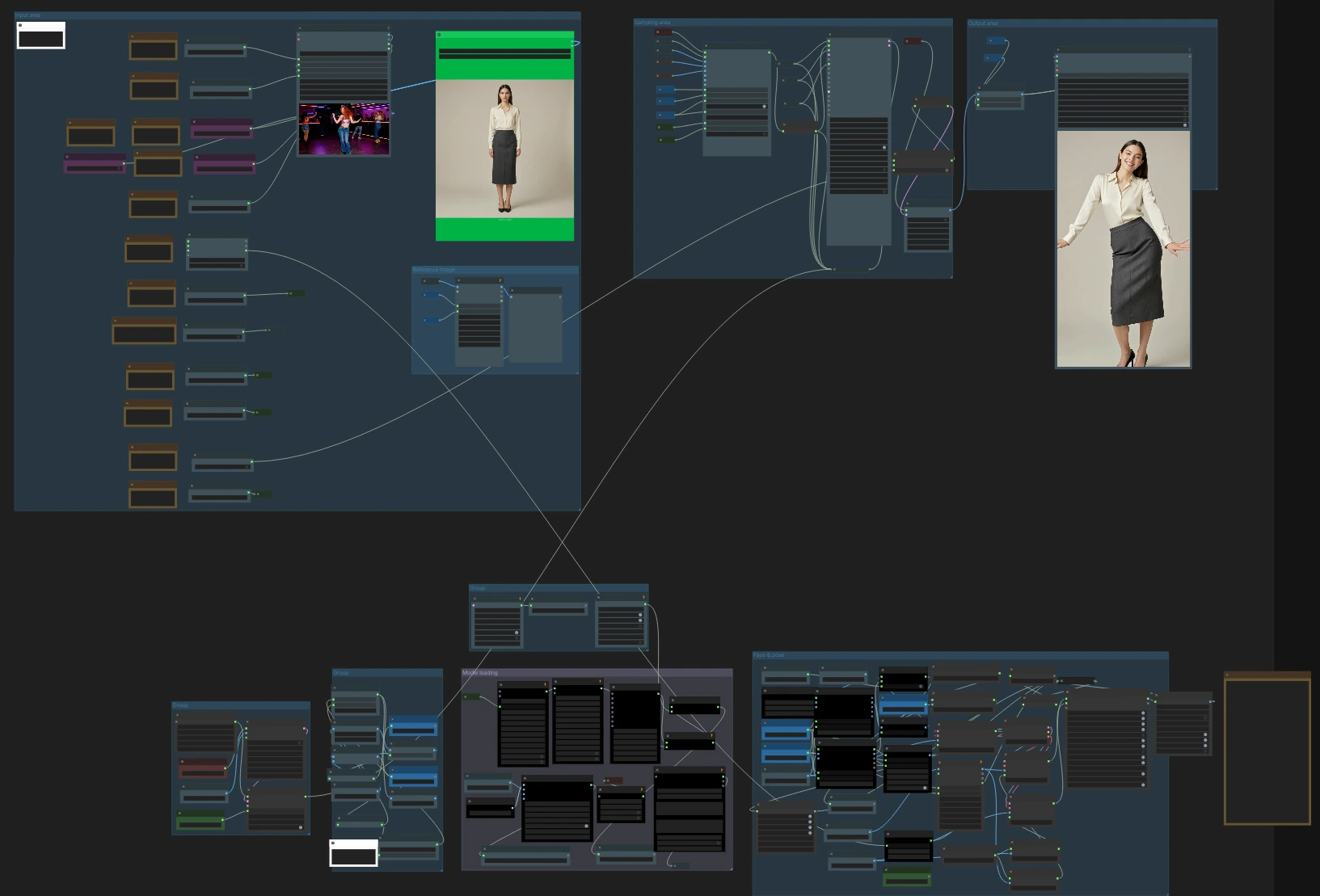

Wan2.2 Transfert d'Action Animée V7 est un workflow vidéo ComfyUI pour transférer le mouvement d'une vidéo source sur un personnage ou une image cible tout en préservant l'identité, le cadrage et le style. Construit autour de Wan2.2 Animate avec pose, visage, vision CLIP, Uni3C ControlNet et guidage Wan LoRA empilé, il produit un MP4 prêt à être édité ou publié.

Ce workflow de Transfert d'Action Animée Wan2.2 est idéal pour les créateurs qui souhaitent une configuration de transfert d'action prête à l'emploi avec RunComfy, avec des exemples d'entrées et des résultats cohérents et répétables. Il gère le conditionnement de la pose et du visage, le guidage optionnel de la caméra, les utilitaires de cadrage et d'aspect, et le passage audio pour que vous puissiez vous concentrer sur la direction de la performance et du look.

Modèles clés dans le workflow ComfyUI Wan2.2 Transfert d'Action Animée#

- Wan2.2 Animate 14B. Le modèle de diffusion vidéo principal qui génère des cadres cohérents en mouvement conditionnés par l'identité, la pose et les embeddings de texte. Model card

- Wan Video VAE (Wan 2.1). Codage/décodage latent de haute qualité pour les cadres vidéo qui équilibre détail et vitesse dans ComfyUI. Assets

- Encodeur Vision CLIP (ViT-H/14 via OpenCLIP). Extrait les indices d'identité et de composition de l'image cible pour garder le sujet stable à travers les cadres. Repo

- ViTPose Whole-Body. Estimation robuste des points clés du corps, des mains et du visage pour un transfert d'action précis. Paper

- Détecteurs YOLOv10. Détection de personnes et de régions utilisée pour localiser les corps avant l'extraction des points clés et la cartographie des proportions. Repo

- Extracteur SDPose Whole-Body. Backend alternatif de points clés du corps entier intégré pour une analyse de pose multi-stratégie. Repo

- Uni3C ControlNet pour la vidéo (via WanVideoWrapper). Guidage structurel optionnel qui stabilise la caméra et les contraintes de scène pendant le rendu. Repo

Comment utiliser le workflow ComfyUI Wan2.2 Transfert d'Action Animée#

À un niveau élevé, vous chargez une image de personnage cible et une vidéo source, le workflow extrait les signaux de pose et de visage, encode l'identité avec la vision CLIP, applique éventuellement le guidage de caméra Uni3C et les Wan LoRAs, puis rend avec Wan2.2 Animate en cadres et exporte un MP4 avec ou sans l'audio source.

Zone d'entrée#

Chargez votre vidéo source dans VHS_LoadVideo (#275) et votre image de personnage cible dans LoadImage (#299). Le chargeur de vidéo gère les plafonds de fréquence d'images, l'extraction audio optionnelle et les contrôles de sélection de base ; le chargeur d'image est utilisé comme référence d'identité et de cadrage. Les utilitaires d'aspect calculent automatiquement la largeur et la hauteur à partir de votre orientation choisie pour que la sortie corresponde à 16:9 ou 9:16 sans distorsions. Si vous prévoyez de conserver l'audio source, laissez-le connecté ; l'exportateur coupera ou remplira comme configuré.

Image de référence#

Ce groupe prépare l'image cible pour le guidage d'identité. ImageResizeKJv2 (#225) aligne l'image à la résolution de rendu, CLIPVisionLoader (#178) charge la colonne vertébrale de vision, et WanVideoClipVisionEncode (#189) produit des embeddings de vision CLIP. Utilisez une image propre et bien éclairée avec le cadrage souhaité ; la vision CLIP préserve l'identité du sujet, les indices de vêtements, et la composition pour que la vidéo générée suive votre look.

Calcul du visage et de la pose#

Le workflow prend en charge plusieurs pipelines de pose pour plus de robustesse. OnnxDetectionModelLoader (#204) avec PoseAndFaceDetection (#235, #249) extrait la pose du corps entier plus les recadrages de visage de la vidéo source. En parallèle, la détection de région basée sur YOLO (YOLOModelLoader (#327, #387) avec BBoxYOLO (#324, #379, #395)) alimente SDPoseKeypointExtractor (#326, #383, #384) pour des points clés alternatifs. Un itinéraire de reciblage de proportions utilisant BodyRatioMapperProportionTransfer (#388) adapte le mouvement entre différentes proportions corporelles et rend une carte de pose propre via BodyRatioMapperSDPoseRender (#391). Un commutateur booléen vous permet de contourner le guidage du visage pour les acteurs entièrement masqués ou casqués afin d'éviter les conflits d'expression.

Chargement du modèle#

WanVideoVAELoader (#277) et WanVideoModelLoader (#287) intègrent la colonne vertébrale Wan2.2 Animate et VAE. Deux nœuds WanVideoLoraSelectMulti (#248, #276) vous permettent d'empiler des LoRAs pour le style, la vitesse, le relighting, ou le guidage d'inpainting, et WanVideoSetBlockSwap (#290) configure l'échange de blocs compatible avec la mémoire pour les clips longs. WanVideoContextOptions (#270) définit les fenêtres de contexte temporel et la foulée pour que le modèle voie suffisamment de cadres voisins pour rester stable sans lisser excessivement l'action.

Guidage de caméra et de structure Uni3C#

Lorsque vous avez besoin d'un comportement de caméra plus stable ou de contraintes de scène, activez le chemin Uni3C. WanVideoUni3C_ControlnetLoader (#345) charge le modèle de contrôle, WanVideoEncode (#346) convertit les cadres en latents pour le conditionnement, et WanVideoUni3C_embeds (#344) génère des embeddings Uni3C dont vous pouvez ajuster la force. Ce guidage est fusionné dans la chaîne de rendu principale pour stabiliser les panoramiques, zooms, ou scènes à grand mouvement.

Échantillonnage et rendu#

WanVideoAnimateEmbeds (#295) fusionne l'identité de vision CLIP, les cartes de pose, et les recadrages de visage en embeddings d'image pendant que vous contrôlez pose_strength et face_strength. Le renderer principal fonctionne en deux étapes avec WanVideoSampler (#222, #367) ; un commutateur choisit la branche guidée par Uni3C lorsqu'elle est activée, sinon la branche standard. Après échantillonnage, WanVideoDecode (#246) transforme les latents en images et les utilitaires de sélection de cadres les acheminent vers l'exportation. Le workflow équilibre la longueur de contexte, la foulée, et la mémoire pour que vous puissiez rendre de longues séquences de manière fiable.

Export#

Deux exportateurs sont inclus. VideoCombineNode (#330) fournit une exportation MP4 compacte avec une coupe optionnelle à l'audio. VHS_VideoCombine (#285) offre une interface plus riche pour la fréquence d'images, CRF, pix_fmt, et le nommage de sortie ; il prend également en charge le passage audio direct. Un utilitaire de compression peut zipper tous les cadres si vous préférez des séquences d'images pour le travail postérieur.

Utilitaires de lot et aides#

Un petit groupe gère les mathématiques des cadres, les répétitions, et les comptes pour que les lots de référence correspondent à la longueur de la séquence cible. Les utilitaires comme ImageFromBatch (#181), ImageBatch (#304), BatchCount+ (#308, #314), et easy mathInt (#309) gardent les longueurs synchronisées pour un conditionnement fluide à travers le clip. Les nœuds d'hygiène VRAM effacent la mémoire entre les étapes lourdes pour réduire les erreurs de mémoire insuffisante lors de rendus longs.

Nœuds clés dans le workflow ComfyUI Wan2.2 Transfert d'Action Animée#

VHS_LoadVideo(#275). Charge la vidéo source et extrait l'audio. Utilisez le plafond de cadres lors des tests ou des itérations ; une fois que vous verrouillez le look et le mouvement, retirez le plafond pour des rendus en pleine longueur. Gardez la FPS d'origine si vous voulez que le mouvement se sente identique à la source, ou forcez une nouvelle FPS si vous avez besoin d'une cadence de livraison spécifique.WanVideoAnimateEmbeds(#295). Combine les signaux d'identité (vision CLIP), de pose et de visage en embeddings qui pilotent le modèle. Ajustezpose_strengthpour décider à quel point le mouvement suit la source etface_strengthpour prioriser la similarité faciale ; une force de visage plus faible peut aider les personnages stylisés, d'anime ou d'animaux.WanVideoContextOptions(#270). Configure la fenêtre de contexte temporel, la foulée, et le chevauchement qui contrôlent combien de cadres voisins le modèle considère. Un contexte plus large offre une continuité plus fluide ; un contexte plus court peut préserver des changements nets dans l'action rapide. Gardez les paramètres de contexte cohérents lorsque vous changez de FPS ou de résolution.WanVideoUni3C_embeds(#344). Génère un guidage optionnel de caméra/structure. Augmentezstrengthlorsque vous voyez des tremblements de caméra ou des zooms non intentionnels ; diminuez-le si le guidage commence à combattre votre cadrage créatif.WanVideoLoraSelectMulti(#276). Empile les Wan LoRAs pour le style, la vitesse, le relighting, ou l'inpainting. Commencez avec un LoRA à une force modérée, puis ajoutez-en d'autres uniquement si nécessaire ; fusionner trop de LoRAs forts peut déstabiliser l'identité.WanVideoSampler(#367). Le principal échantillonneur de diffusion pour Wan2.2 Animate. Le planificateur, la force de débruitage, et le nombre d'étapes interagissent ; augmenter les étapes améliore le détail mais coûte du temps, tandis qu'une débruitage plus élevé augmente la réécriture du mouvement. Si vous utilisez Uni3C, ajustez sa force avant d'augmenter les étapes.PoseAndFaceDetection(#235). Extrait la pose du corps entier et les recadrages de visage de la vidéo source. Laissez le commutateur "acteur masqué/casqué" désactivé sauf si le visage du performeur est entièrement occulté ; l'activer sur des visages visibles peut atténuer les expressions.VHS_VideoCombine(#285). Exportateur MP4 de haute qualité avec support audio. Utiliseztrim_to_audiopour synchroniser rigoureusement la vidéo avec la musique ou le dialogue et ajustezcrfpour le compromis taille/qualité. Gardezpix_fmtà une valeur compatible avec la diffusion si vous livrez à des éditeurs ou des plateformes sociales.

Extras optionnels#

- Préparez les entrées : utilisez une image cible propre et bien éclairée et un clip source avec un flou de mouvement minimal pour obtenir les meilleurs points clés.

- Faites correspondre le ratio d'aspect : choisissez 16:9 ou 9:16 tôt ; le workflow redimensionne automatiquement les images pour que la vidéo finale ne soit pas encadrée de manière inattendue.

- Conseils de stabilité : si vous voyez des dérives de bras ou de jambe, augmentez

pose_strength; si l'identité dérive, augmentez l'influence de la vision CLIP ou simplifiez l'empilement des LoRA. - Contrôle de la caméra : activez Uni3C uniquement lorsque vous avez besoin de stabilisation de caméra ; le garder désactivé offre souvent le mouvement le plus cinématographique lorsque la source est tenue à la main.

- Itération : rendez d'abord de courtes plages de cadres, puis exportez la séquence complète une fois que le mouvement et le look sont ajustés.

Ce workflow de Transfert d'Action Animée Wan2.2 apporte un transfert d'action fiable à ComfyUI avec des paramètres par défaut pratiques et de la place pour grandir. Chargez votre image et votre vidéo source, définissez la force de pose et de visage, choisissez Uni3C si nécessaire, et exportez un MP4 poli.

Remerciements#

Ce workflow met en œuvre et s'appuie sur les travaux et ressources suivants. Nous remercions chaleureusement Wan-AI pour le modèle officiel Wan2.2 Animate, Kijai pour les nœuds ComfyUI Wan (ComfyUI-WanVideoWrapper et ComfyUI-WanAnimatePreprocess), et les équipes RunningHub et RunComfy pour les workflows ComfyUI partagés pour leurs contributions et maintenance. Pour des détails autoritaires, veuillez vous référer à la documentation originale et aux dépôts liés ci-dessous.

Ressources#

- RunningHub/Source du workflow

- Docs / Notes de version : Post RunningHub

- RunComfy/Workflow de sauvegarde Cloud

- Docs / Notes de version : Workflow partagé RunComfy

- Wan-AI/Modèle officiel Wan2.2 Animate

- Hugging Face : Wan-AI/Wan2.2-Animate-14B

- kijai/Nœuds ComfyUI-WanVideoWrapper

- GitHub : kijai/ComfyUI-WanVideoWrapper

- Kijai/Modèles FP8 ComfyUI Wan2.2 Animate

- Hugging Face : Kijai/WanVideo_comfy_fp8_scaled

- kijai/Nœuds ComfyUI-WanAnimatePreprocess

- GitHub : kijai/ComfyUI-WanAnimatePreprocess

Note : L'utilisation des modèles, ensembles de données et codes référencés est soumise aux licences et conditions respectives fournies par leurs auteurs et mainteneurs.