Wan Alpha: texto a video transparente para composición profesional#

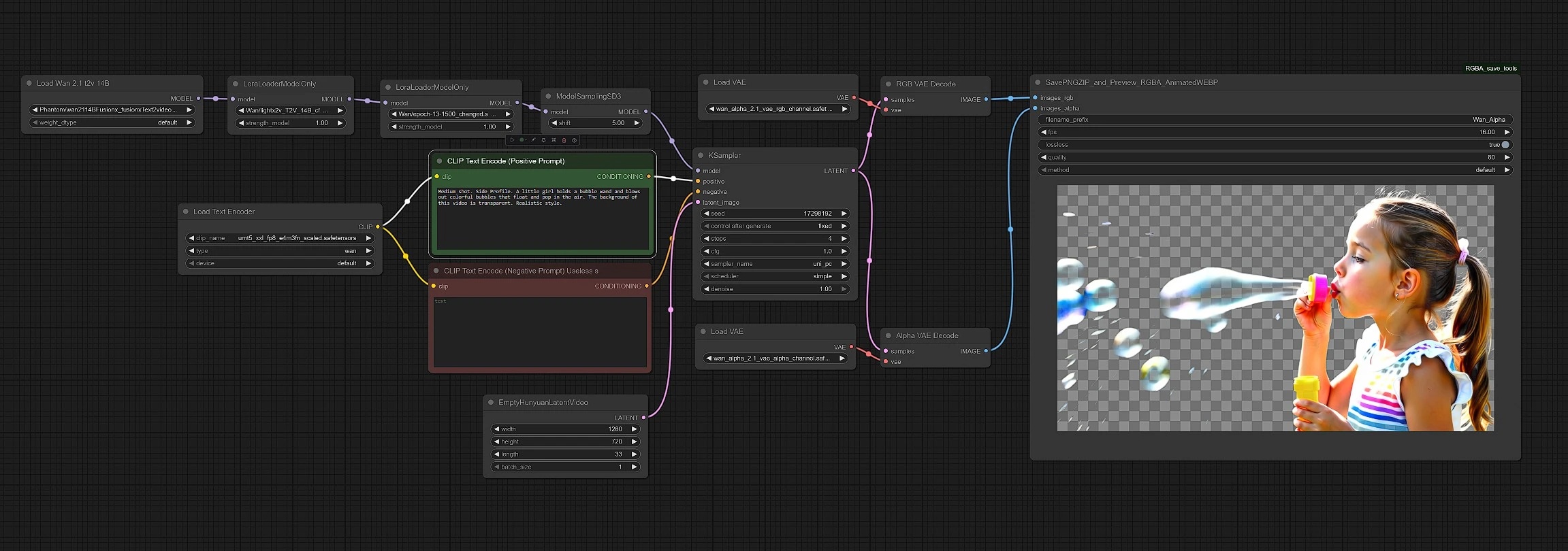

Wan Alpha es un flujo de trabajo de ComfyUI diseñado específicamente para generar videos con un canal alfa nativo usando la familia Wan 2.1. Produce conjuntamente RGB y alfa para que personajes, accesorios y efectos se integren directamente en las líneas de tiempo sin necesidad de keying o rotoscopía. Para VFX, gráficos en movimiento y aplicaciones interactivas, Wan Alpha ofrece bordes limpios, efectos semitransparentes y máscaras precisas listas para producción.

Construido alrededor de Wan2.1‑T2V‑14B y un par de VAE consciente del alfa, Wan Alpha equilibra fidelidad y velocidad. La aceleración opcional LightX2V LoRA acorta el muestreo mientras preserva el detalle, y el flujo de trabajo exporta secuencias de cuadros RGBA más una vista previa animada en WebP para una revisión rápida.

Modelos clave en el flujo de trabajo Comfyui Wan Alpha#

- Wan2.1‑T2V‑14B. Modelo de texto a video fundamental que impulsa la estructura de la escena, el movimiento y la calidad de renderizado. Los pesos oficiales y el código se mantienen en la organización Wan-Video en GitHub. Wan-Video/Wan2.1

- Codificador de texto UMT5‑XXL. Codificador multilingüe utilizado para tokenizar e incrustar indicaciones para los modelos Wan, permitiendo una rica redacción de indicaciones en múltiples idiomas. google/umt5-xxl y UMT5 docs

- Par VAE Wan‑Alpha. Un diseño VAE que aprende RGB y alfa conjuntamente para que el alfa decodificado se alinee píxel por píxel con RGB, apoyando bordes finos y semitransparencia. Consulta el informe técnico Wan‑Alpha para más información. Wan‑Alpha (arXiv)

- LightX2V LoRA. LoRA de aceleración opcional que destila muestreadores largos a unos pocos pasos para un texto a video más rápido manteniendo la calidad perceptual. ModelTC/LightX2V

Cómo usar el flujo de trabajo Comfyui Wan Alpha#

Este gráfico de ComfyUI sigue un camino directo desde la indicación hasta los cuadros RGBA: carga modelos, codifica texto, asigna un video latente, muestrea, decodifica RGB y alfa en sincronía, luego guarda.

Carga de modelo y LoRA

- Comienza en

Load Wan 2.1 t2v 14B(#37) para incorporar el modelo base. Si usas aceleración o refinamientos de estilo, aplícalos conLoraLoaderModelOnly(#59) yLoraLoaderModelOnly(#65) en secuencia. El modelo luego pasa porModelSamplingSD3(#48), que configura un muestreador compatible con el punto de control cargado. Esta pila define el movimiento previo y el estilo de renderizado que Wan Alpha refinará en pasos posteriores.

Codificación de indicaciones

Load Text Encoder(#38) carga el codificador de texto UMT5‑XXL. Ingresa tu descripción enCLIP Text Encode (Positive Prompt)(#6); mantén conciso tu sujeto, acción, encuadre de cámara y la frase "fondo transparente". UsaCLIP Text Encode (Negative Prompt) Useless s(#7) para evitar halos o desorden de fondo si es necesario. Estas codificaciones condicionan tanto la generación de RGB como de alfa para que los bordes y las señales de transparencia sigan tu intención.

Configuración de lienzo de video

- Usa

EmptyHunyuanLatentVideo(#40) para definir el lienzo de video latente. Establecewidth,height,framesyfpspara ajustar tu toma; resoluciones más altas o clips más largos requieren más memoria. Este nodo asigna un volumen latente temporalmente consistente que Wan Alpha llenará con movimiento y apariencia. Considera igualar la duración y la tasa de cuadros a tu edición para evitar re-muestreo más tarde.

Generación

- El

KSampler(#3) realiza la difusión en el video latente usando tu pila de modelos y condicionamiento de indicaciones. Ajustaseedpara variaciones, y selecciona unsampleryschedulerque equilibren velocidad y detalle. Cuando LightX2V LoRA está activo, puedes usar menos pasos para renderizados más rápidos mientras mantienes la estabilidad. La salida es una sola secuencia latente compartida por la siguiente etapa de decodificación para garantizar una alineación perfecta de RGBA.

Decodificación de RGB y alfa

RGB VAE Decode(#8) se empareja conVAELoader(#39) para reconstruir cuadros RGB. En paralelo,Alpha VAE Decode(#52) se empareja conVAELoader(#51) para reconstruir el canal alfa. Ambos decodificadores leen el mismo latente para que el mate se alinee exactamente con los píxeles de color, una idea central en el diseño de Wan‑Alpha para una transparencia consistente. Esta decodificación de doble camino es lo que hace que Wan Alpha esté listo para la composición directa.

Guardado y vista previa

SavePNGZIP_and_Preview_RGBA_AnimatedWEBP(#73) escribe dos entregables: un archivo zip de cuadros PNG RGBA y una vista previa animada compacta en WebP. La secuencia de cuadros es amigable para producción en NLEs y compositores, mientras que la vista previa acelera las revisiones. Nombra tu conjunto de salida, elige una longitud y calidad de vista previa, y ejecuta el nodo para empaquetar tu resultado.

Nodos clave en el flujo de trabajo Comfyui Wan Alpha#

EmptyHunyuanLatentVideo (#40)

- Rol: define la resolución espacial y temporal del clip generado. Ajusta

width,height,frames, yfpspara coincidir con la entrega. Los lienzos más grandes y las duraciones más largas aumentan las necesidades de VRAM; considera borradores más cortos para el desarrollo de la apariencia, luego escala para los finales.

KSampler (#3)

- Rol: el principal desruidor de Wan Alpha. Ajusta

seedpara exploraciones,stepspara intercambiar velocidad por detalle,sampleryschedulerpara estabilidad, ycfgpara equilibrar la adherencia a las indicaciones con el movimiento natural. Con LightX2V LoRA activo, puedes reducir significativamente losstepsmientras preservas la calidad gracias a la destilación de pasos. Consulta LightX2V para contexto sobre el muestreo rápido. ModelTC/LightX2V

LoraLoaderModelOnly (#59)

- Rol: carga el LightX2V LoRA que acelera el muestreo Wan2.1. Usa el control de

strengthpara mezclar su efecto si notas sobreafilado o artefactos de tempo. Mantén este LoRA más cercano al modelo base en la cadena para que los LoRAs posteriores hereden sus beneficios de velocidad.

LoraLoaderModelOnly (#65)

- Rol: carga un LoRA adicional para refinamiento de estilo o dominio. Modera

strengthpara evitar dominar la coherencia del movimiento; combina con tu indicación en lugar de reemplazarla. Si aparecen artefactos, reduce este LoRA antes de cambiar el muestreador.

VAELoader (#39) RGB

- Rol: proporciona el VAE RGB utilizado por

RGB VAE Decode(#8). Mantén esto emparejado con el VAE alfa Wan‑Alpha para asegurar que ambos decodificadores interpreten coherentemente los latentes. Cambiar a VAEs no relacionados puede desalinear bordes o suavizar la transparencia. Antecedentes sobre el diseño conjunto RGB–alfa están en el informe Wan‑Alpha. Wan‑Alpha (arXiv)

VAELoader (#51) Alfa

- Rol: proporciona el VAE alfa utilizado por

Alpha VAE Decode(#52). Reconstruye el mate desde el mismo espacio latente que RGB para que la transparencia coincida con el movimiento y el detalle. Si personalizas VAEs, prueba que RGB y alfa aún se alineen en bordes subpíxel como el cabello.

SavePNGZIP_and_Preview_RGBA_AnimatedWEBP (#73)

- Rol: exporta activos. Establece un

output_nameclaro para la versionación, elige calidad de vista previa y tasa de cuadros que reflejen el clip generado, y mantén la exportación PNG como tu maestro para composición sin pérdidas. Evita cambiar de tamaño entre decodificar y guardar para preservar la fidelidad de los bordes.

Extras opcionales#

- Las indicaciones fuertes para Wan Alpha describen explícitamente sujeto, acción, cámara, iluminación y "fondo transparente". Agrega materiales sutiles como "cabello vaporoso" o "vidrio" para ejercitar el detalle del alfa.

- Para iteraciones rápidas, usa duraciones más cortas o tasas de cuadros más bajas, luego aumenta la configuración una vez que la apariencia y el movimiento estén bloqueados.

- Si ves halos, agrega negativos como "fondo, contorno, pantalla verde, borde blanco" y mantén la iluminación consistente en la indicación.

- Al combinar múltiples LoRAs, coloca LoRAs de aceleración primero y LoRAs estilísticos después, y mantén las fuerzas modestas para retener el realismo del movimiento.

- Importa la secuencia PNG RGBA directamente en tu compositor; usa el WebP animado solo para vistas previas, no como maestro.

Recursos utilizados en Wan Alpha

- Familia de modelos Wan2.1 y código: Wan-Video/Wan2.1

- Codificador de texto UMT5: google/umt5-xxl y UMT5 docs

- Descripción del método Wan‑Alpha: Wan‑Alpha (arXiv)

- Aceleración LightX2V: ModelTC/LightX2V

Agradecimientos#

Este flujo de trabajo implementa y se basa en los siguientes trabajos y recursos. Agradecemos a WeChatCV por Wan-Alpha por sus contribuciones y mantenimiento. Para detalles autorizados, consulte la documentación original y los repositorios enlazados a continuación.

Recursos#

- WeChatCV/Wan-Alpha

- GitHub: WeChatCV/Wan-Alpha

Nota: El uso de los modelos, conjuntos de datos y código referenciados está sujeto a las licencias y términos respectivos proporcionados por sus autores y mantenedores.