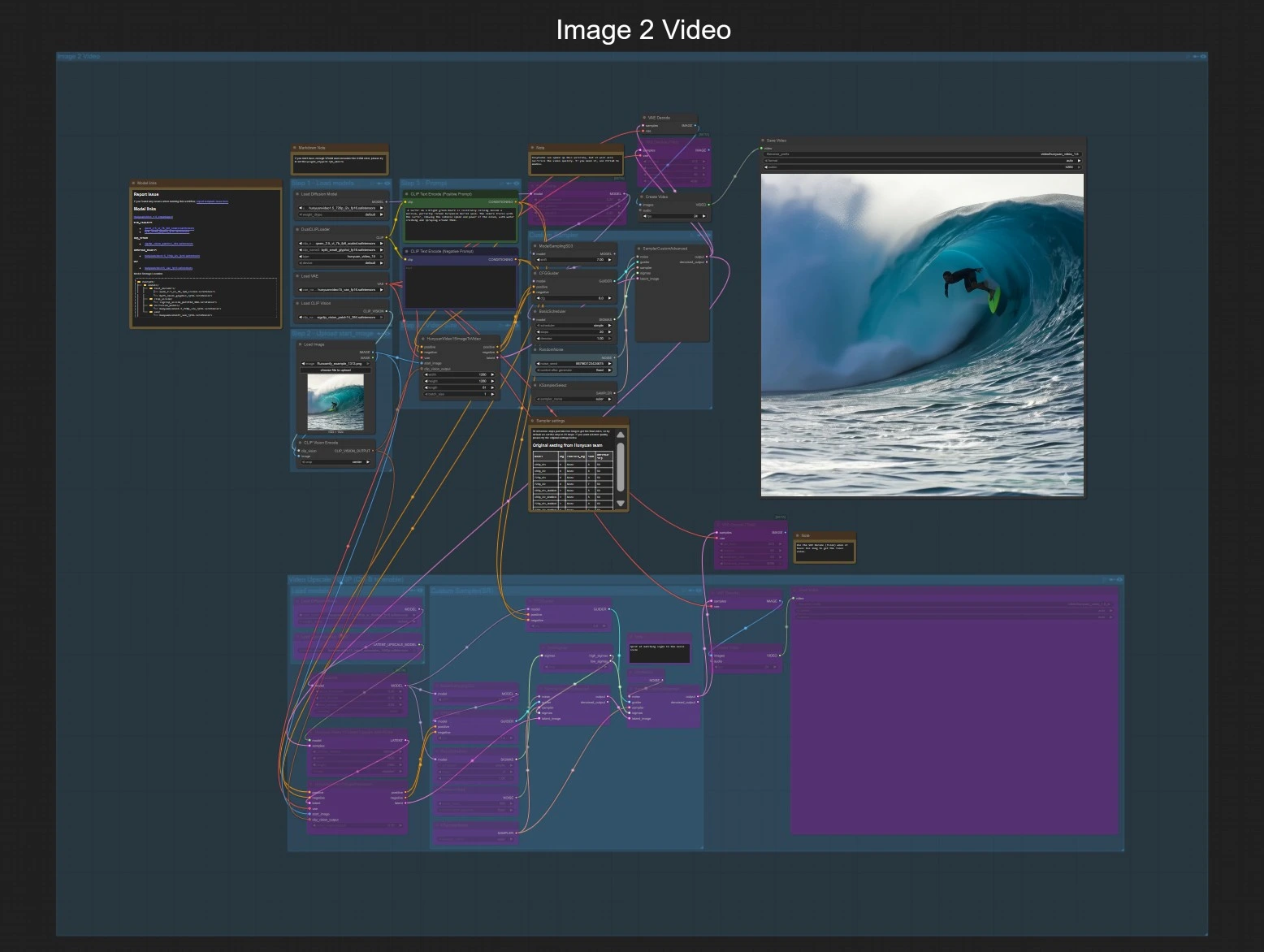

Flujo de trabajo Hunyuan Video 1.5 ComfyUI: texto a video e imagen a video rápido con super resolución 1080p#

Este flujo de trabajo envuelve Hunyuan Video 1.5 en ComfyUI para ofrecer generación de video rápida y coherente en GPUs de consumo. Admite tanto texto a video como imagen a video, luego opcionalmente escala a 1080p usando un upsampler latente dedicado y un modelo de super resolución destilado. Bajo el capó, Hunyuan Video 1.5 acopla un Transformer de Difusión con un VAE causal 3D y una estrategia de atención de mosaico deslizante selectiva para equilibrar calidad, fidelidad de movimiento y velocidad.

Creadores, equipos de producto e investigadores pueden usar este flujo de trabajo ComfyUI Hunyuan Video 1.5 para iterar rápidamente desde indicaciones o una sola imagen fija, previsualizar a 720p y terminar con salida nítida 1080p cuando sea necesario.

Modelos clave en el flujo de trabajo Comfyui Hunyuan Video 1.5#

- HunyuanVideo 1.5 720p Image-to-Video UNet. Produce movimiento y coherencia temporal a partir de una imagen inicial. Los pesos se proporcionan en el reempaque de Comfy-Org en Hugging Face Comfy-Org/HunyuanVideo_1.5_repackaged.

- HunyuanVideo 1.5 720p Text-to-Video UNet. Genera videos directamente desde indicaciones de texto usando la misma arquitectura central, ajustada para flujos de trabajo orientados a indicaciones. Ver el repositorio de reempaque arriba.

- HunyuanVideo 1.5 1080p Super-Resolution UNet (destilado). Refina latentes de 720p a mayor detalle mientras preserva el movimiento y la estructura de escena. Incluido en el mismo reempaque en Hugging Face.

- HunyuanVideo 1.5 3D VAE. Codifica y decodifica latentes de video para generación eficiente y decodificación en mosaico.

- HunyuanVideo 1.5 Latent Upsampler 1080p. Escala secuencias latentes a 1920×1080 antes de la refinación SR para eficiencia de velocidad y memoria.

- Qwen 2.5 VL 7B codificador de texto y ByT5 Small codificador de texto. Proporcionan seguimiento de instrucciones robusto y tokenización para indicaciones diversas, reempaquetados para este flujo de trabajo en el paquete de Hugging Face arriba. Tarjeta de modelo original de ByT5: google/byt5-small.

- SigCLIP Vision (ViT-L/14, 384). Extrae características visuales de alta calidad de la imagen inicial para guiar el condicionamiento de imagen a video: Comfy-Org/sigclip_vision_384.

Cómo usar el flujo de trabajo Comfyui Hunyuan Video 1.5#

Este gráfico expone dos caminos independientes que comparten la misma exportación y etapa opcional de acabado 1080p. Elige entre Imagen a Video o Texto a Video, luego habilita opcionalmente el grupo 1080p para finalizar.

Imagen a Video#

Paso 1 — Cargar modelos Los cargadores traen el Hunyuan Video 1.5 UNet para imagen a video, el 3D VAE, los codificadores de texto duales y visión SigCLIP. Esto prepara el flujo de trabajo para aceptar una sola imagen inicial y una indicación. No se necesita acción del usuario más allá de confirmar que los modelos están disponibles.

Paso 2 — Subir imagen inicial Proporciona una imagen limpia y bien expuesta en LoadImage (#80). El gráfico codifica esta imagen con CLIPVisionEncode (#79) para que Hunyuan Video 1.5 pueda anclar movimiento y estilo a tu referencia. Prefiere imágenes que coincidan aproximadamente con tu relación de aspecto objetivo para reducir recortes o relleno.

Paso 3 — Indicación Escribe tu descripción en CLIP Text Encode (Positive Prompt) (#44). Usa la indicación negativa CLIP Text Encode (Negative Prompt) (#93) para alejarse de artefactos o estilos no deseados. Mantén las indicaciones concisas pero específicas sobre el tema, el movimiento y el comportamiento de la cámara.

Paso 4 — Tamaño y duración del video HunyuanVideo15ImageToVideo (#78) establece la resolución espacial y el número de cuadros a sintetizar. Las secuencias más largas requieren más VRAM y tiempo, así que comienza más corto y escala una vez que te guste el movimiento.

Muestreo personalizado La pila de muestreo (ModelSamplingSD3 (#130), CFGGuider (#129), BasicScheduler (#126), KSamplerSelect (#128), RandomNoise (#127), SamplerCustomAdvanced (#125)) controla la fuerza de guía, los pasos, el tipo de muestreador y la semilla. Aumenta los pasos para más detalle y estabilidad, y usa una semilla fija para reproducir resultados al iterar en indicaciones.

Previsualizar y guardar La secuencia latente se decodifica con VAEDecode (#8), se enmarca en un video a 24 fps con CreateVideo (#101), y se guarda con SaveVideo (#102). Esto te da una vista previa rápida de 720p lista para revisar.

Acabado 1080p (opcional) Activa el grupo “Video Upscale 1080P” para habilitar la cadena de acabado. El upsampler latente se expande a 1920×1080, luego el UNet de super resolución destilado refina el detalle en dos fases. VAEDecodeTiled y un segundo par CreateVideo/SaveVideo exportan el resultado 1080p.

Texto a Video#

Paso 1 — Cargar modelos Los cargadores traen el Hunyuan Video 1.5 720p UNet de texto a video, el 3D VAE y los codificadores de texto duales. Este camino no requiere una imagen inicial.

Paso 3 — Indicación Ingresa tu descripción en el codificador positivo CLIP Text Encode (Positive Prompt) (#149) y opcionalmente agrega una indicación negativa en CLIP Text Encode (Negative Prompt) (#155). Describe la escena, el sujeto, el movimiento y la cámara, manteniendo el lenguaje concreto.

Paso 4 — Tamaño y duración del video EmptyHunyuanVideo15Latent (#183) asigna el latente inicial con el ancho, altura y número de cuadros elegidos. Usa esto para establecer cuánto tiempo y qué tan grande debe ser tu video.

Muestreo personalizado ModelSamplingSD3 (#165), CFGGuider (#164), BasicScheduler (#161), KSamplerSelect (#163), RandomNoise (#162), y SamplerCustomAdvanced (#166) colaboran para convertir el ruido en un video coherente guiado por tu texto. Ajusta los pasos y la guía para intercambiar velocidad por fidelidad, y fija la semilla para hacer comparables las ejecuciones.

Previsualizar y guardar Los cuadros decodificados son ensamblados por CreateVideo (#168) y guardados por SaveVideo (#167) para una revisión rápida a 720p a 24 fps.

Acabado 1080p (opcional) Habilita el grupo “Video Upscale 1080P” para escalar latentes a 1080p y refinar con el UNet SR destilado. El muestreo en dos etapas mejora la nitidez mientras preserva el movimiento. Un decodificador en mosaico y una segunda etapa de guardado exportan el video final 1080p.

Nodos clave en el flujo de trabajo Comfyui Hunyuan Video 1.5#

HunyuanVideo15ImageToVideo (#78) Genera un video condicionando una imagen inicial y tus indicaciones. Ajusta su resolución y cuadros totales para que coincidan con tu objetivo creativo. Las resoluciones más altas y clips más largos aumentan VRAM y tiempo. Este nodo es central para la calidad de imagen a video porque fusiona características de CLIP-Vision con guía de texto antes del muestreo.

EmptyHunyuanVideo15Latent (#183) Inicializa la cuadrícula latente para texto a video con ancho, altura y número de cuadros. Úsalo para definir la longitud de la secuencia desde el principio para que el programador y el muestreador puedan planificar una trayectoria de desruido estable. Mantén la relación de aspecto consistente con tu salida prevista para evitar rellenos adicionales más tarde.

CFGGuider (#129) Establece la fuerza de guía libre de clasificador, equilibrando la adherencia a la indicación contra la naturalidad. Aumenta la guía para seguir la indicación más estrictamente; redúcela para disminuir la sobresaturación y el parpadeo. Usa valores moderados durante la generación base y reduce la guía para la refinación de super resolución.

BasicScheduler (#126) Controla el número de pasos de desruido y el cronograma. Más pasos generalmente significan mejor detalle y estabilidad pero renders más largos. Combina el conteo de pasos con la elección de muestreador para mejores resultados; este flujo de trabajo predetermina a un muestreador rápido y de propósito general.

SamplerCustomAdvanced (#125) Ejecuta el ciclo de desruido con tu muestreador y guía seleccionados. En la cadena de acabado 1080p, funciona en dos fases divididas por SplitSigmas para primero establecer la estructura en ruido alto y luego refinar detalles de bajo ruido. Mantén las semillas fijas mientras ajustas pasos y guía para que puedas comparar salidas de manera confiable.

HunyuanVideo15LatentUpscaleWithModel (#109) Escala la secuencia latente a 1920×1080 usando el upsampler dedicado de los pesos reempaquetados. Escalar en el espacio latente es más rápido y eficiente en memoria que el redimensionamiento en espacio de píxeles, y prepara el escenario para que el modelo SR destilado agregue detalle fino. Los objetivos más grandes demandan más VRAM; mantén 16:9 para mejor rendimiento.

HunyuanVideo15SuperResolution (#113) Refina el latente escalado con el UNet SR 1080p destilado del paquete Hunyuan Video 1.5, opcionalmente tomando señales de imagen inicial y CLIP-Vision para consistencia. Esto agrega texturas nítidas y trabajo de líneas mientras mantiene el movimiento. Los pesos SR están disponibles en Comfy-Org/HunyuanVideo_1.5_repackaged.

EasyCache (#116) Almacena en caché estados intermedios del modelo para acelerar las iteraciones de previsualización. Habilítalo cuando desees una respuesta más rápida, y desactívalo para máxima calidad en tu pasada final. Es especialmente útil al iterar en indicaciones con la misma resolución y duración.

Extras opcionales#

- Mantén las indicaciones concretas. Describe el sujeto, verbos de movimiento y movimientos de cámara. Usa una indicación negativa corta para suprimir artefactos que veas repetidamente.

- Prefiere imágenes de inicio limpias y de alto contraste para imagen a video. Alinea la relación de aspecto con tu resolución objetivo para minimizar rellenos.

- Para velocidad, itera en duraciones más cortas y 720p; activa el grupo 1080p solo para las corridas finales.

- Si el VRAM es limitado, alterna la decodificación de VAE en mosaico y considera cargar pesos en una configuración de menor precisión expuesta por el cargador de modelos.

- Fija semillas mientras ajustas pasos, guía y redacción para hacer cambios medibles en las corridas.

Agradecimientos#

Este flujo de trabajo implementa y se basa en los siguientes trabajos y recursos. Agradecemos a Comfy.org por el tutorial del flujo de trabajo Hunyuan Video 1.5 por sus contribuciones y mantenimiento. Para detalles autorizados, por favor consulta la documentación original y los repositorios enlazados a continuación.

Recursos#

- Fuente de Hunyuan Video 1.5

- Documentos / Notas de lanzamiento: Fuente de Hunyuan Video 1.5

Nota: El uso de los modelos, conjuntos de datos y código referenciados está sujeto a las licencias y términos respectivos proporcionados por sus autores y mantenedores.