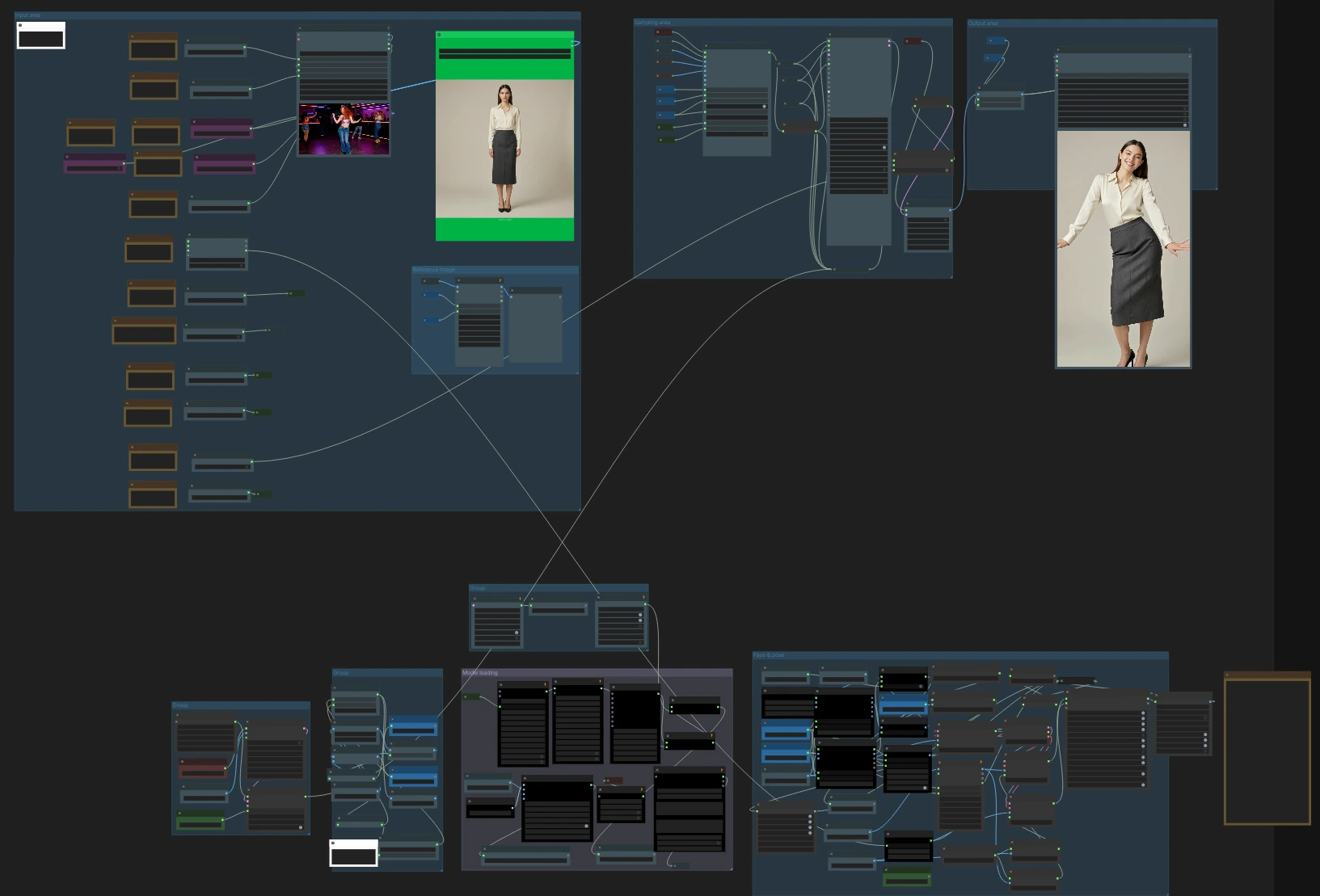

Wan2.2 Animate Action Transfer V7: Motion-to-Character Video Workflow für ComfyUI#

Wan2.2 Animate Action Transfer V7 ist ein ComfyUI-Video-Workflow zum Übertragen von Bewegungen aus einem Fahrvideo auf einen Zielcharakter oder ein Bild, während Identität, Rahmung und Stil bewahrt werden. Basierend auf Wan2.2 Animate mit Pose, Gesicht, CLIP Vision, Uni3C ControlNet und gestapelter Wan LoRA-Führung produziert er ein MP4, das bereit zum Bearbeiten oder Veröffentlichen ist.

Dieser Wan2.2 Animate Action Transfer-Workflow ist ideal für Kreative, die ein RunComfy-bereites Action-Transfer-Setup mit Beispiel-Eingaben und konsistenten, wiederholbaren Ergebnissen wünschen. Er behandelt Pose- und Gesichtsbedingungen, optionale Kameraführung, Rahmen- und Seitenverhältnis-Dienstprogramme sowie Audio-Durchleitung, sodass Sie sich auf die Regie von Performance und Look konzentrieren können.

Schlüsselmodelle im ComfyUI Wan2.2 Animate Action Transfer-Workflow#

- Wan2.2 Animate 14B. Das Kern-Videodiffusionsmodell, das bewegungskonsistente Frames erzeugt, die durch Identität, Pose und Texteingaben konditioniert werden. Model card

- Wan Video VAE (Wan 2.1). Hochwertiges latentes Codieren/Dekodieren für Videoframes, das Detailgenauigkeit und Geschwindigkeit in ComfyUI ausgleicht. Assets

- CLIP Vision-Encoder (ViT-H/14 über OpenCLIP). Extrahiert Identitäts- und Kompositionshinweise aus dem Zielbild, um das Subjekt über die Frames stabil zu halten. Repo

- ViTPose Whole-Body. Robuste Körper-, Hand- und Gesichtsschlüsselpunktschätzung zur Steuerung des genauen Aktionsübergangs. Paper

- YOLOv10-Detektoren. Personen- und Bereichserkennung zur Lokalisierung von Körpern vor der Schlüsselpunktextraktion und Proportionszuordnung. Repo

- SDPose Whole-Body-Extractor. Alternative Ganzkörperschlüsselpunktrückseite, integriert für Multi-Strategie-Pose-Analyse. Repo

- Uni3C ControlNet für Video (über WanVideoWrapper). Optionale strukturelle Führung, die Kamera- und Szenenbeschränkungen während des Renderings stabilisiert. Repo

Wie man den ComfyUI Wan2.2 Animate Action Transfer-Workflow verwendet#

Auf hoher Ebene laden Sie ein Zielcharakterbild und ein Fahrvideo, der Workflow extrahiert Pose- und Gesichtssignale, codiert Identität mit CLIP Vision, wendet optional Uni3C-Kameraführung und Wan LoRAs an, dann rendert er mit Wan2.2 Animate in Frames und exportiert ein MP4 mit oder ohne die Original-Audio.

Eingabebereich#

Laden Sie Ihr Fahrvideo in VHS_LoadVideo (#275) und Ihr Zielcharakterbild in LoadImage (#299). Der Videolader verwaltet Frame-Rate-Begrenzungen, optionale Audioextraktion und grundlegende Auswahlsteuerungen; der Bildlader wird als Identitäts- und Rahmungsreferenz verwendet. Die Seitenverhältnis-Dienstprogramme berechnen automatisch Breite und Höhe aus Ihrer gewählten Ausrichtung, sodass die Ausgabe 16:9 oder 9:16 ohne Verzerrungen entspricht. Wenn Sie das Original-Audio beibehalten möchten, lassen Sie es verbunden; der Exporter wird es nach Bedarf trimmen oder auffüllen.

Referenzbild#

Diese Gruppe bereitet das Zielbild für Identitätsführung vor. ImageResizeKJv2 (#225) richtet das Bild an der Renderauflösung aus, CLIPVisionLoader (#178) lädt das Vision-Backbone, und WanVideoClipVisionEncode (#189) erzeugt CLIP Vision-Einbettungen. Verwenden Sie ein sauberes, gut beleuchtetes Bild mit der gewünschten Rahmung; CLIP Vision bewahrt Subjektidentität, Kleidungshinweise und Komposition, sodass das generierte Video Ihrem Look folgt.

Gesichts- und Poseberechnung#

Der Workflow unterstützt mehrere Pose-Pipelines für Robustheit. OnnxDetectionModelLoader (#204) mit PoseAndFaceDetection (#235, #249) extrahiert Ganzkörperpose plus Gesichtsausschnitte aus dem Fahrvideo. Parallel dazu liefert die YOLO-basierte Bereichserkennung (YOLOModelLoader (#327, #387) mit BBoxYOLO (#324, #379, #395)) SDPoseKeypointExtractor (#326, #383, #384) für alternative Schlüsselpunkte. Eine Proportionsumsetzungsroute mit BodyRatioMapperProportionTransfer (#388) passt Bewegung zwischen verschiedenen Körperproportionen an und rendert eine saubere Posekarte über BodyRatioMapperSDPoseRender (#391). Ein boolescher Schalter lässt Sie die Gesichtsanleitung für vollständig maskierte oder helmtragende Schauspieler umgehen, sodass Sie Ausdruckskonflikte vermeiden.

Modellladen#

WanVideoVAELoader (#277) und WanVideoModelLoader (#287) bringen das Wan2.2 Animate-Backbone und VAE ein. Zwei WanVideoLoraSelectMulti-Knoten (#248, #276) ermöglichen es Ihnen, LoRAs für Stil, Geschwindigkeit, Relighting oder Inpainting-Guidance zu stapeln, und WanVideoSetBlockSwap (#290) konfiguriert speicherfreundlichen Blocktausch für lange Clips. WanVideoContextOptions (#270) setzt temporale Kontextfenster und Schrittweite, sodass das Modell genügend Nachbarframes sieht, um stabil zu bleiben, ohne Aktion übermäßig zu glätten.

Uni3C Kamera- und Strukturführung#

Wenn Sie ruhigere Kamerabewegungen oder Szenenbeschränkungen benötigen, aktivieren Sie den Uni3C-Pfad. WanVideoUni3C_ControlnetLoader (#345) lädt das Kontrollmodell, WanVideoEncode (#346) konvertiert Frames in Latents zur Konditionierung, und WanVideoUni3C_embeds (#344) erzeugt Uni3C-Einbettungen, deren Stärke Sie anpassen können. Diese Führung wird in die Haupt-Renderkette integriert, um Schwenks, Zooms oder Szenen mit großen Bewegungen zu stabilisieren.

Abtasten und Rendern#

WanVideoAnimateEmbeds (#295) fügt CLIP Vision-Identität, Posekarten und Gesichtsausschnitte in Bildeinbettungen zusammen, während Sie pose_strength und face_strength steuern. Der Haupt-Renderer läuft in zwei Stufen mit WanVideoSampler (#222, #367); ein Schalter wählt den Uni3C-geführten Zweig, wenn aktiviert, sonst den Standardzweig. Nach dem Abtasten wandelt WanVideoDecode (#246) Latents in Bilder um, und Dienstprogramme zur Frame-Auswahl leiten sie zum Export weiter. Der Workflow balanciert Kontextlänge, Schrittweite und Speicher, sodass Sie lange Sequenzen zuverlässig rendern können.

Export#

Zwei Exporter sind enthalten. VideoCombineNode (#330) bietet einen kompakten MP4-Export mit optionalem Audio-Trim. VHS_VideoCombine (#285) bietet eine reichhaltigere Schnittstelle für Bildrate, CRF, pix_fmt und Ausgabebenennung; es unterstützt auch direkte Audio-Durchleitung. Ein Komprimierungsdienstprogramm kann alle Frames zippen, wenn Sie Bildsequenzen für die Nachbearbeitung bevorzugen.

Batch-Dienstprogramme und Helfer#

Ein kleiner Cluster verwaltet Frame-Mathematik, Wiederholungen und Zählungen, sodass Referenz-Batches der Zielfolgenlänge entsprechen. Dienstprogramme wie ImageFromBatch (#181), ImageBatch (#304), BatchCount+ (#308, #314) und easy mathInt (#309) halten Längen synchronisiert für eine reibungslose Konditionierung über den Clip. VRAM-Hygienenodes löschen den Speicher zwischen schweren Schritten, um Speicherfehler bei langen Renderings zu reduzieren.

Schlüssel-Nodes im ComfyUI Wan2.2 Animate Action Transfer-Workflow#

VHS_LoadVideo(#275). Lädt das Fahrvideo und extrahiert Audio. Verwenden Sie die Frame-Begrenzung beim Testen oder Iterieren; sobald Sie Look und Bewegung fixiert haben, entfernen Sie die Begrenzung für vollständige Renderings. Halten Sie die Original-FPS, wenn Sie möchten, dass die Bewegung identisch zur Quelle fühlt, oder erzwingen Sie eine neue FPS, wenn Sie eine bestimmte Lieferkadenz benötigen.WanVideoAnimateEmbeds(#295). Kombiniert Identität (CLIP Vision), Pose und Gesichtssignale in Einbettungen, die das Modell steuern. Passen Siepose_strengthan, um zu entscheiden, wie eng die Bewegung der Quelle folgt, undface_strength, um die Gesichtssimilarität zu priorisieren; eine niedrigere Gesichtsstärke kann stilisierten, Anime- oder Tiercharakteren helfen.WanVideoContextOptions(#270). Konfiguriert temporales Kontextfenster, Schrittweite und Überlappung, die steuern, wie viele benachbarte Frames das Modell berücksichtigt. Größerer Kontext ergibt eine glattere Kontinuität; kürzerer Kontext kann scharfe Änderungen in schneller Aktion bewahren. Halten Sie die Kontexteinstellungen konsistent, wenn Sie FPS oder Auflösung ändern.WanVideoUni3C_embeds(#344). Erzeugt optionale Kamera-/Strukturführung. Erhöhen Siestrength, wenn Sie Kamerawackeln oder unbeabsichtigte Zooms sehen; verringern Sie sie, wenn die Führung beginnt, Ihrem kreativen Framing entgegenzuwirken.WanVideoLoraSelectMulti(#276). Stapelt Wan LoRAs für Stil, Geschwindigkeit, Relighting oder Inpainting. Beginnen Sie mit einem LoRA bei moderater Stärke, dann fügen Sie nur bei Bedarf zusätzliche hinzu; das Zusammenführen zu vieler starker LoRAs kann die Identität destabilisieren.WanVideoSampler(#367). Der Haupt-Diffusionssampler für Wan2.2 Animate. Scheduler, Denoise-Stärke und Schrittanzahl interagieren; das Erhöhen der Schritte verbessert die Detailgenauigkeit, kostet aber Zeit, während höhere Denoise die Bewegungsumschreibung erhöht. Wenn Sie Uni3C verwenden, stimmen Sie dessen Stärke ab, bevor Sie die Schritte erhöhen.PoseAndFaceDetection(#235). Extrahiert Ganzkörperpose und Gesichtsausschnitte aus dem Fahrvideo. Lassen Sie den "Mask/Helmet Actor"-Schalter ausgeschaltet, es sei denn, das Gesicht des Performers ist vollständig verdeckt; das Einschalten bei sichtbaren Gesichtern kann Ausdrücke dämpfen.VHS_VideoCombine(#285). Hochwertiger MP4-Exporter mit Audio-Unterstützung. Verwenden Sietrim_to_audio, um das Video hart mit Musik oder Dialog zu synchronisieren, und passen Siecrffür den Größen-/Qualitätskompromiss an. Halten Siepix_fmtauf einem sendefreundlichen Wert, wenn Sie an Redakteure oder soziale Plattformen liefern.

Optionale Extras#

- Bereiten Sie Eingaben vor: Verwenden Sie ein sauberes, gleichmäßig beleuchtetes Zielbild und einen Fahrclip mit minimaler Bewegungsunschärfe für die besten Schlüsselpunkte.

- Seitenverhältnis anpassen: Wählen Sie früh 16:9 oder 9:16; der Workflow skaliert Bilder automatisch, sodass das endgültige Video nicht unerwartet letterboxed wird.

- Stabilitätstipps: Wenn Sie Arm- oder Beinabdrift sehen, erhöhen Sie

pose_strength; wenn die Identität abweicht, erhöhen Sie den CLIP Vision-Einfluss oder vereinfachen Sie das LoRA-Stapeln. - Kamerasteuerung: Aktivieren Sie Uni3C nur, wenn Sie Kamerastabilisierung benötigen; das Ausschalten führt oft zu den filmischsten Bewegungen, wenn die Quelle handgehalten ist.

- Iteration: Rendern Sie zuerst kurze Frame-Bereiche, dann exportieren Sie die vollständige Sequenz, sobald Bewegung und Look eingestellt sind.

Dieser Wan2.2 Animate Action Transfer-Workflow bringt zuverlässigen Aktionsübergang zu ComfyUI mit praktischen Voreinstellungen und Raum zum Wachsen. Laden Sie Ihr Bild und Fahrvideo, setzen Sie Pose- und Gesichtsstärke, wählen Sie Uni3C bei Bedarf, und exportieren Sie ein poliertes MP4.

Danksagungen#

Dieser Workflow implementiert und baut auf den folgenden Arbeiten und Ressourcen auf. Wir danken Wan-AI für das Wan2.2 Animate offizielle Modell, Kijai für die ComfyUI Wan-Knoten (ComfyUI-WanVideoWrapper und ComfyUI-WanAnimatePreprocess), und den RunningHub- und RunComfy-Teams für geteilte ComfyUI-Workflows für ihre Beiträge und Wartung. Für autoritative Details verweisen wir auf die originale Dokumentation und die unten verlinkten Repositories.

Ressourcen#

- RunningHub/Workflow source

- Docs / Release Notes: RunningHub post

- RunComfy/Cloud Save workflow

- Docs / Release Notes: RunComfy shared workflow

- Wan-AI/Wan2.2 Animate official model

- Hugging Face: Wan-AI/Wan2.2-Animate-14B

- kijai/ComfyUI-WanVideoWrapper nodes

- GitHub: kijai/ComfyUI-WanVideoWrapper

- Kijai/Wan2.2 Animate FP8 ComfyUI model assets

- Hugging Face: Kijai/WanVideo_comfy_fp8_scaled

- kijai/ComfyUI-WanAnimatePreprocess nodes

Hinweis: Die Verwendung der referenzierten Modelle, Datensätze und Codes unterliegt den jeweiligen Lizenzen und Bedingungen ihrer Autoren und Betreuer.