Wichtiger Hinweis: Unterstützte Workflows & Modelle#

RunComfys Cloud ist nicht auf FLUX.1-dev ControlNet für Reallusion AI Render beschränkt. Sie können Checkpoints, ControlNets, LoRAs, VAEs und verwandte Knoten austauschen, um zusätzliche Reallusion-Workflows und Modelle auszuführen, die unten aufgeführt sind.

- FusionX WanVACE

- Wan2.1 Fun 1.3B Control

- Wan2.1 VACE 1.3B

- Wan2.1 VACE FusionX 14B

- Flux.1 Dev ControlNet

...

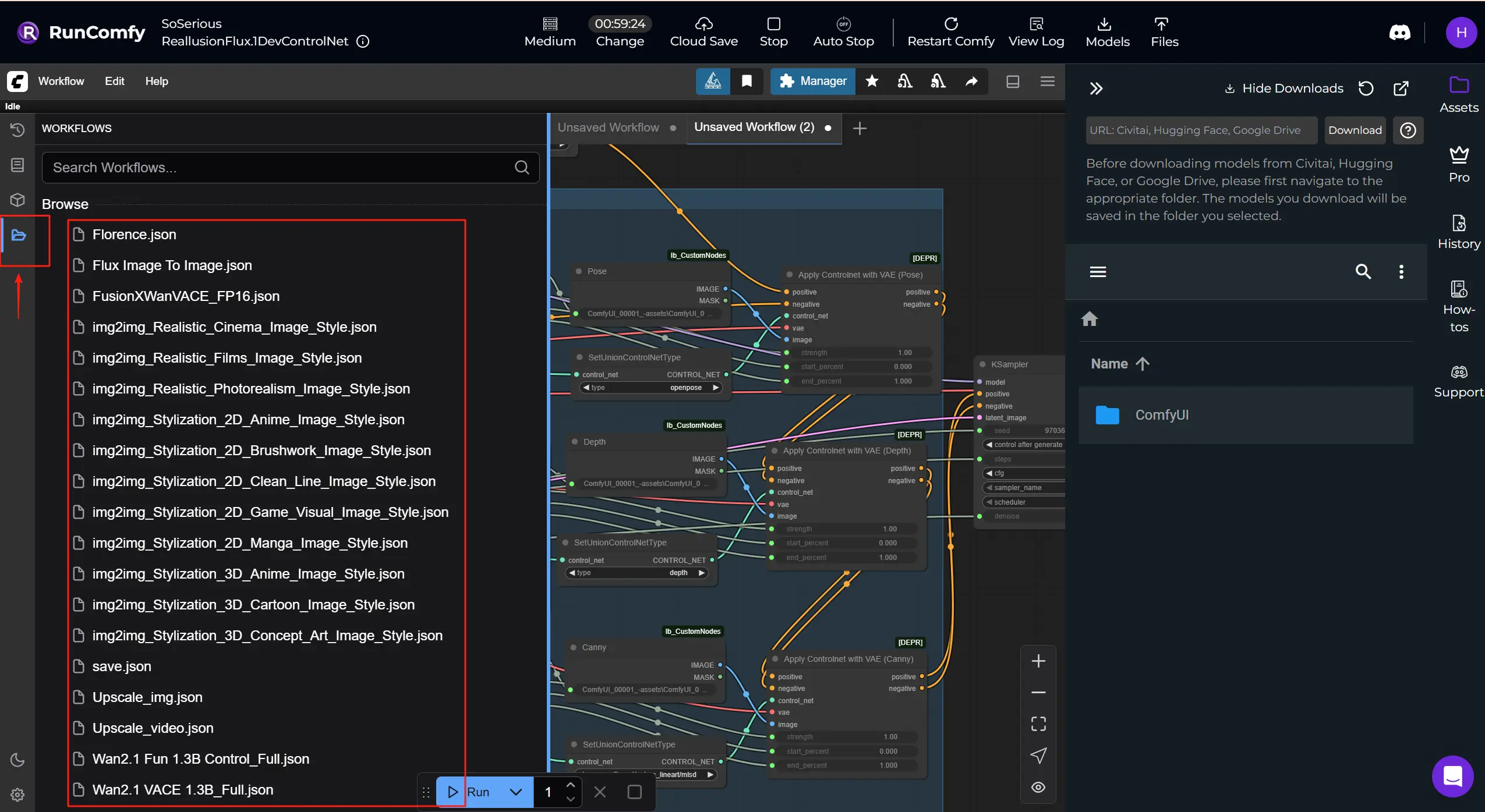

Holen Sie sich mehr Reallusion ComfyUI Workflows: Holen Sie sich mehr Workflow-Vorlagen, die Sie herunterladen und in RunComfy ausführen können. Klicken Sie auf die Schaltfläche "Workflows" und probieren Sie mehr aus.

1. Was ist Reallusion AI Render#

Reallusion ist ein Entwickler von Echtzeit-2D/3D-Charaktererstellungs- und Animationssoftware, bekannt für iClone und Character Creator, die in Film/TV, Spielen, Archviz, digitalen Zwillingen und AI-Simulationen eingesetzt werden.

Reallusion AI Render ist eine nahtlose Brücke zwischen 3D-Animationssoftware und KI-gestützten Inhaltsgenerierungs-Workflows. Stellen Sie sich vor, es handelt sich um einen AI-Render-Assistenten, der Layout-, Pose-, Kamera- oder Beleuchtungsdaten direkt von iClone oder Character Creator aufnimmt und dann diesen Kontext verwendet, um automatisch reich detaillierte Bilder oder Videos in ComfyUI zu erstellen. Diese Integration vereint Reallusions Echtzeit-3D-Erstellungstools mit ComfyUIs flexiblem, knotenbasiertem KI-Verarbeitungsarchitektur, was die bild- und videobasierte Erzählweise sowohl künstlerisch getrieben als auch streng durch 3D-Daten geführt macht. Reallusion AI Render unterstützt multimodale Eingaben wie Tiefenkarten, Normalenkarten, Kantenerkennung (Canny), 3D-Pose-Daten und Stilbilder über IPAdapter. Und dank seiner benutzerdefinierten Core-, ControlNet-, Additional Image- und Upscale-Knoten ermöglicht es Animatoren und Entwicklern, konsistente, stilisierte, hochwertige Ausgaben vollständig unter Plugin-Kontrolle zu rendern, ohne ComfyUI manuell navigieren zu müssen.

Durch die Interpretation strukturierter Anweisungen und die Kombination mit internen Parameter-Voreinstellungen verwandelt Reallusion AI Render die auf Eingabeaufforderungen basierende Generierung in einen präzisen, reproduzierbaren Produktionsprozess. Es ist maßgeschneidert für Kreative in Film, Spielen oder kommerzieller Erzählweise, die konsistente Charaktere, feinkörnige Stilkontrolle und framegenaues AI-unterstütztes Sequenz-Rendering benötigen.

2. Wichtige Funktionen und Vorteile von Reallusion AI Render Workflows#

Direkte Plugin-Integration: Reallusion AI Render arbeitet nativ mit iClone und Character Creator über ein dediziertes Plugin, das Echtzeit-Feedback und Kontrolle ermöglicht, ohne Ihre Produktionstools zu verlassen.

3D-geführtes ControlNet: Übertragen Sie nahtlos Tiefen-, Pose-, Normalen- und Kantendaten direkt aus Ihrer 3D-Szene in ComfyUI mit Reallusion AI Renders ControlNet-Knoten, um filmische Konsistenz und Shot-Level-Kontrolle zu erreichen.

Unterstützung für Multi-Image-Styling: Der Reallusion AI Render Workflow umfasst Additional Image-Knoten, die flexibles Stilblending und referenzbasierte Richtung unterstützen, was es einfach macht, Looks wiederzuverwenden oder fortschrittliches IP-adaptives Rendering durchzuführen.

Intelligenter Upscale-Workflow: Ein dedizierter UpscaleData-Knoten ermöglicht es Kreativen, die Ausgaberesolution innerhalb des Reallusion AI Render Plugins zu definieren, um sicherzustellen, dass die endgültigen Renderings den Projektspezifikationen entsprechen, ohne raten zu müssen.

Vollständige Workflow-Automatisierung: Im Gegensatz zu generischen ComfyUI-Workflows ist Reallusion AI Render für die Automatisierung konzipiert, Parameter wie Modell, Abtastschritte, CFG und Audio-Synchronisation werden programmatisch übergeben, bereit für Batch-Rendering oder benutzerdefinierte Voreinstellungen.

Produktionsbereite Charakterkonsistenz: In Verbindung mit LoRA-Training und IP-Erstellungstools bewahrt Reallusion AI Render die Gesichtsintegrität und visuelle Treue über Videosequenzen hinweg, was es ideal für KI-gesteuerte Erzählweise macht.

3. Wie man Reallusion AI Render in ComfyUI verwendet#

Wie man AI Render mit der RunComfy-Maschine verbindet: ⭐WICHTIG

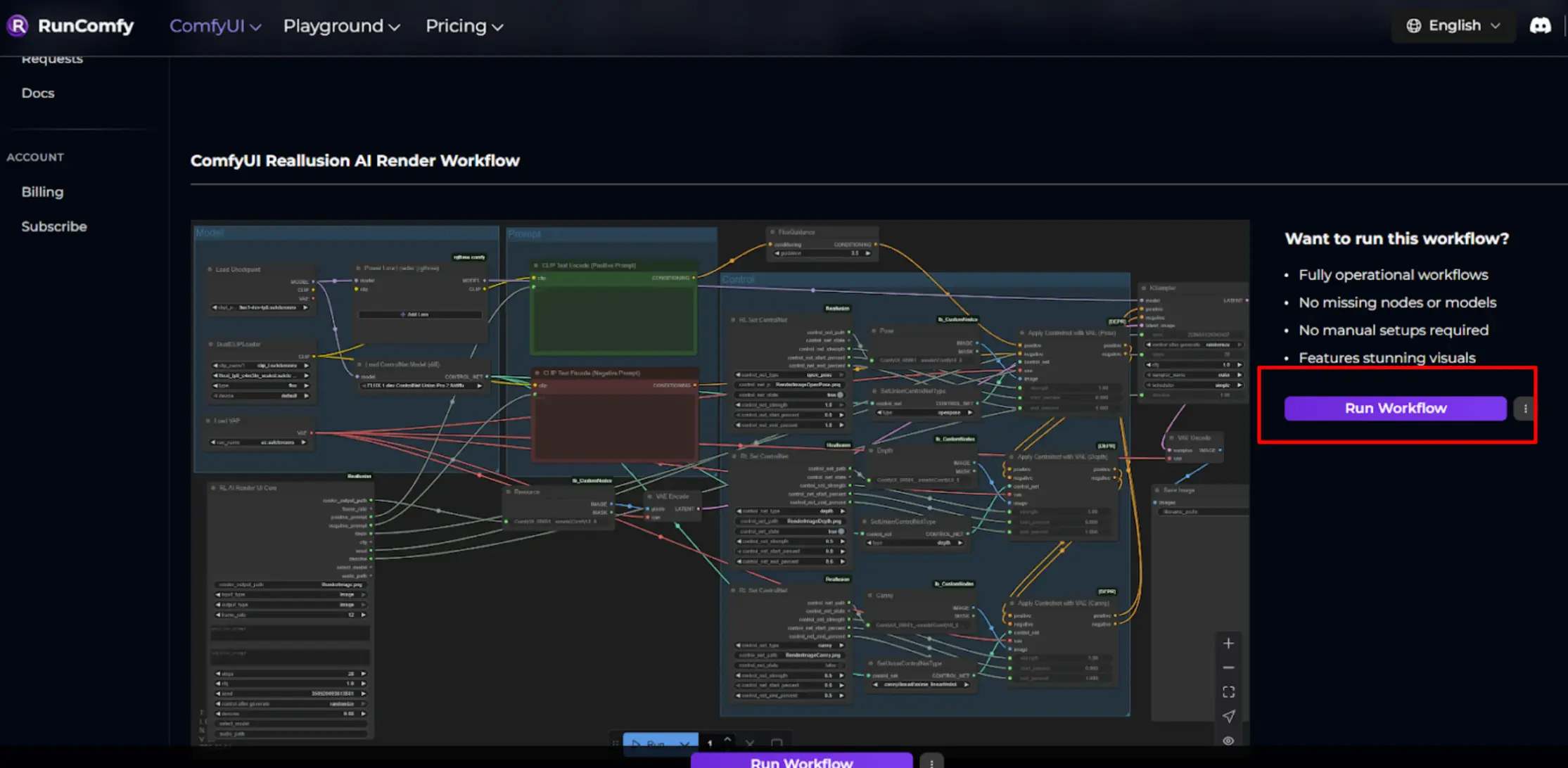

Schritt 1. Klicken Sie auf _Run Workflow_ um die Maschine zu starten.

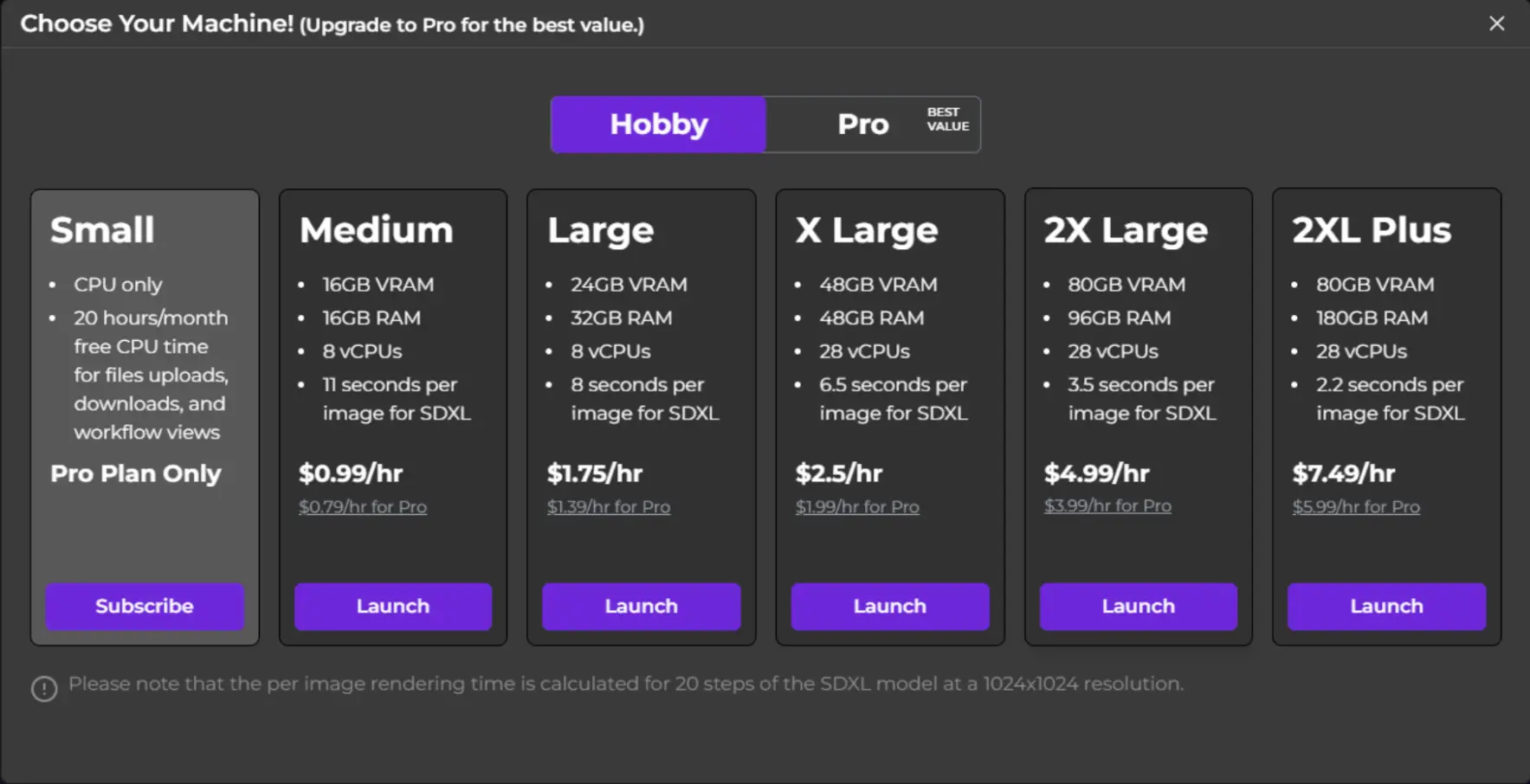

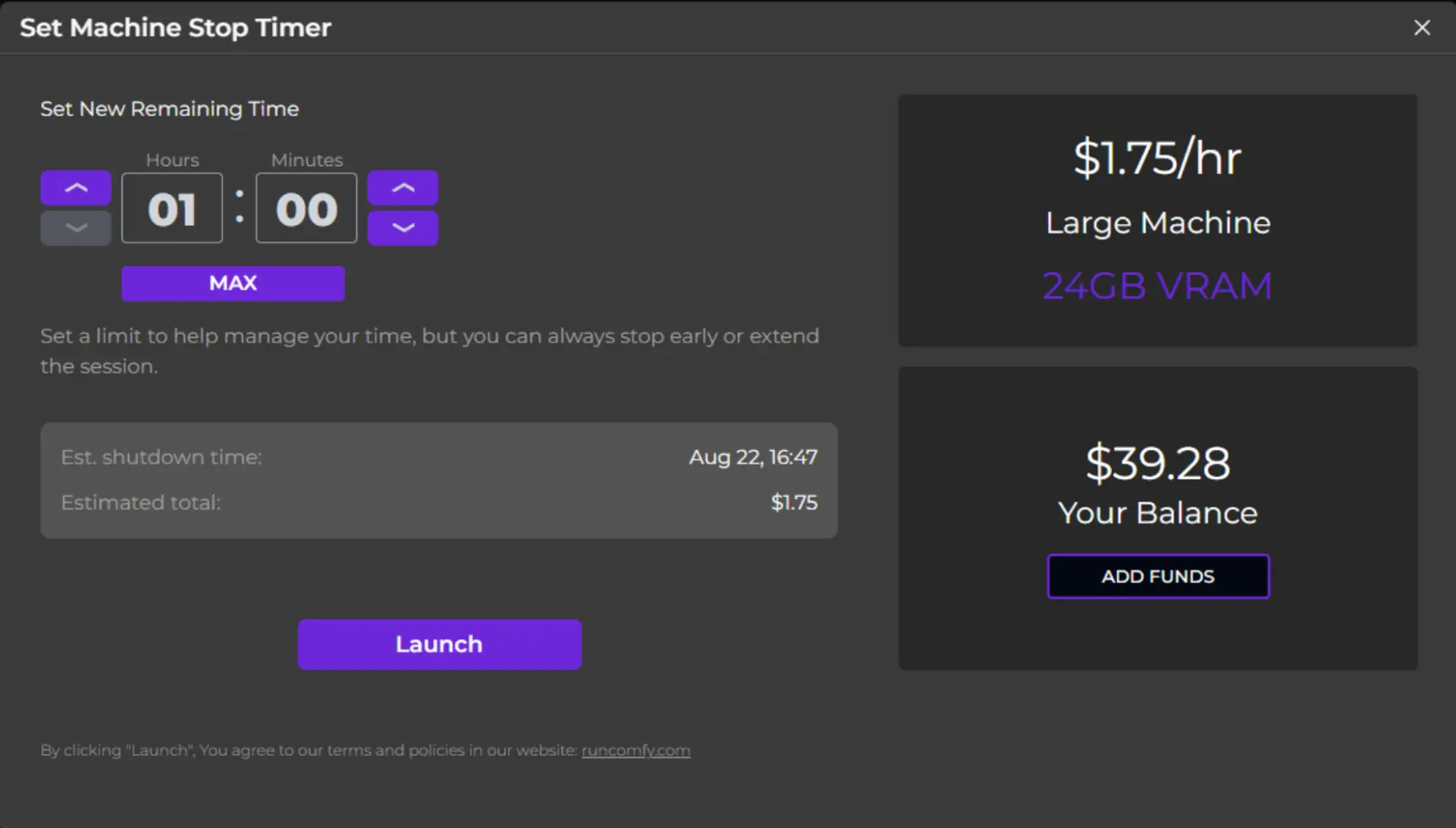

Schritt 2. Wählen Sie die Maschinen Stufe und setzen Sie die Nutzungszeit.

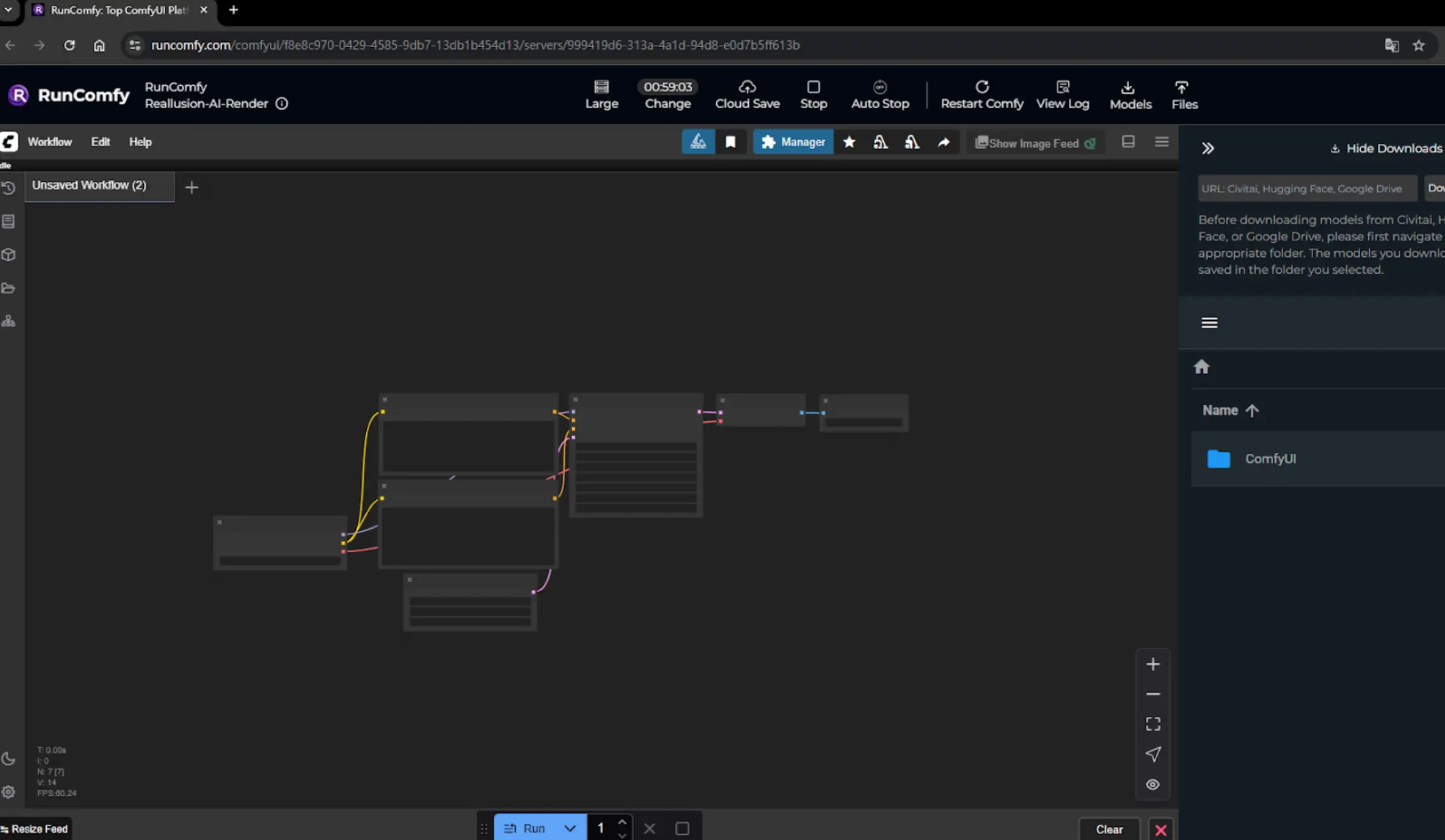

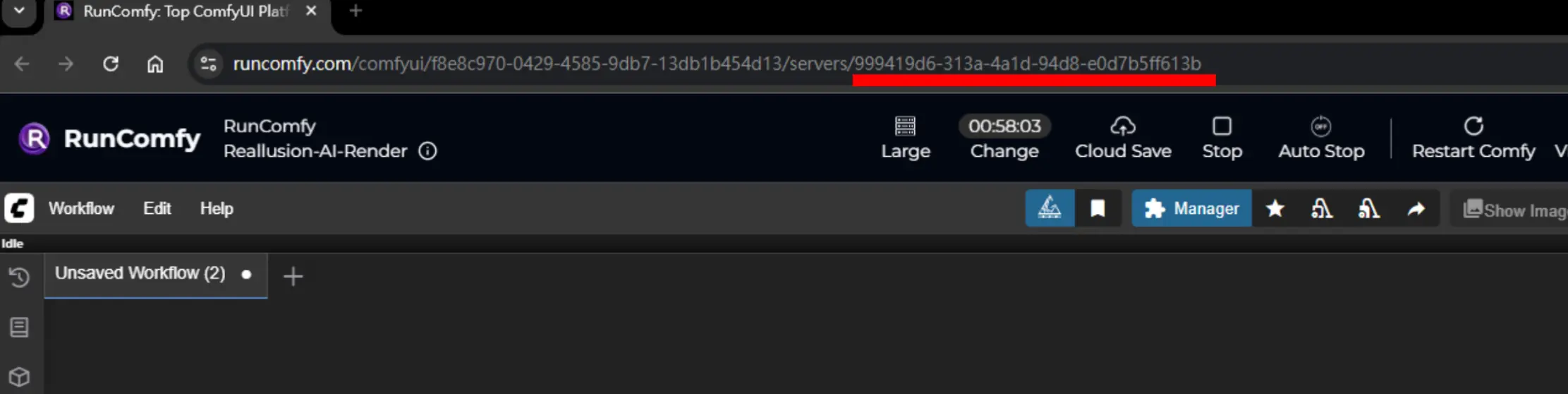

Schritt 3. Warten Sie, bis die Maschine initialisiert ist, bis Sie ComfyUI vollständig geladen sehen.

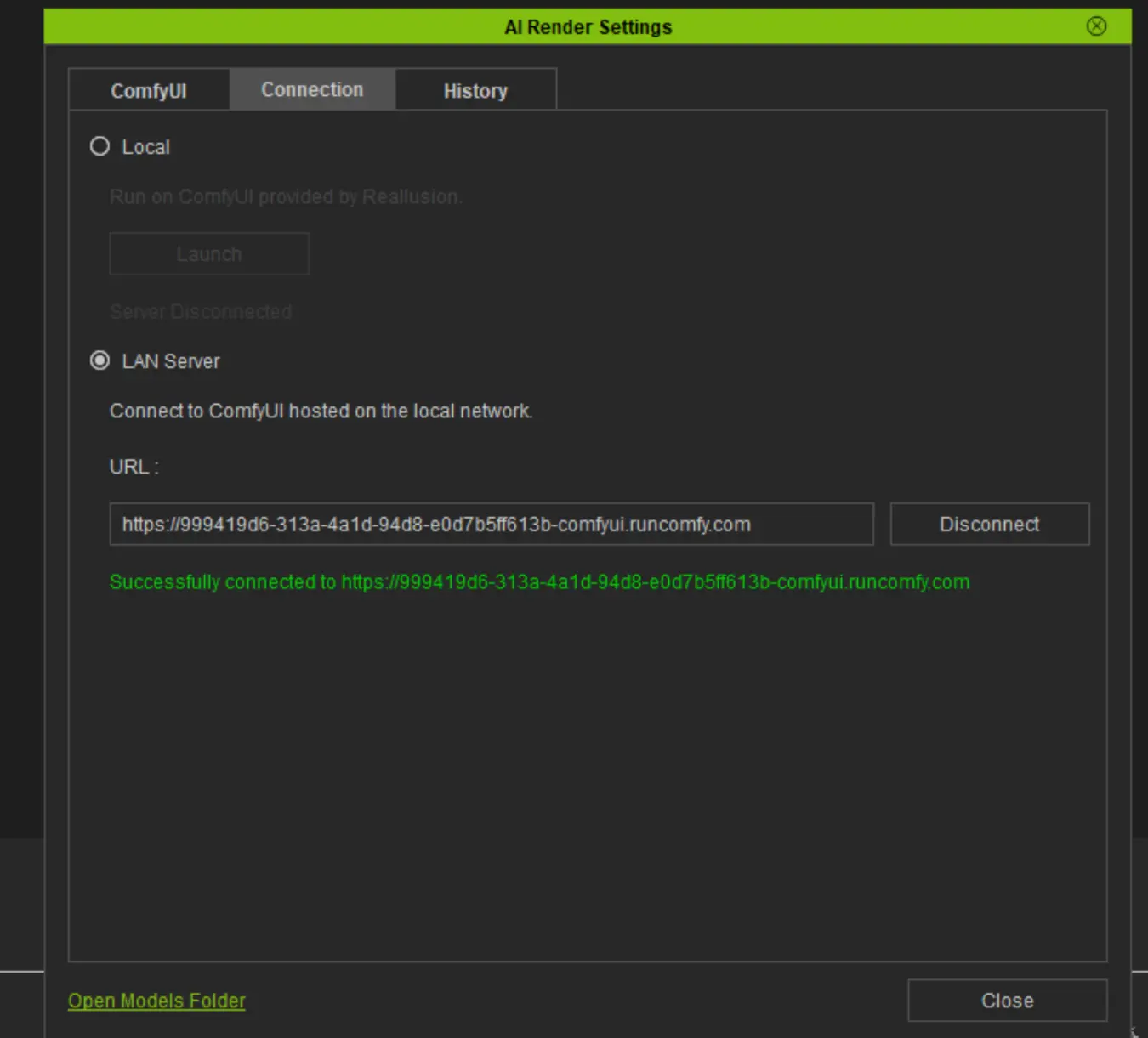

Schritt 4. Verbinden Sie AI Render mit der RunComfy-Maschine.

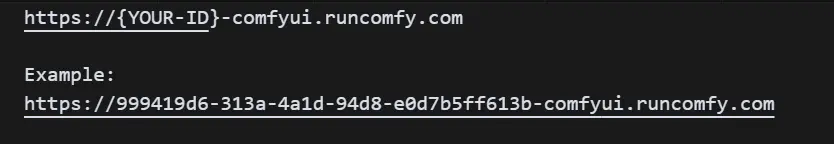

Kopieren Sie den letzten Teil der angezeigten RunComfy-URL, gehen Sie dann zu AI Render Einstellungen -> Servermodus, und geben Sie die URL in diesem Format ein:

⚠️ Hinweis: Diese ID ändert sich jedes Mal, wenn Sie eine neue Maschine starten.

Sobald Sie "Erfolgreich verbunden" sehen, ist die Verbindung abgeschlossen und Sie können beginnen, es zu verwenden.

Wesentliche Einstellungen der Knoten

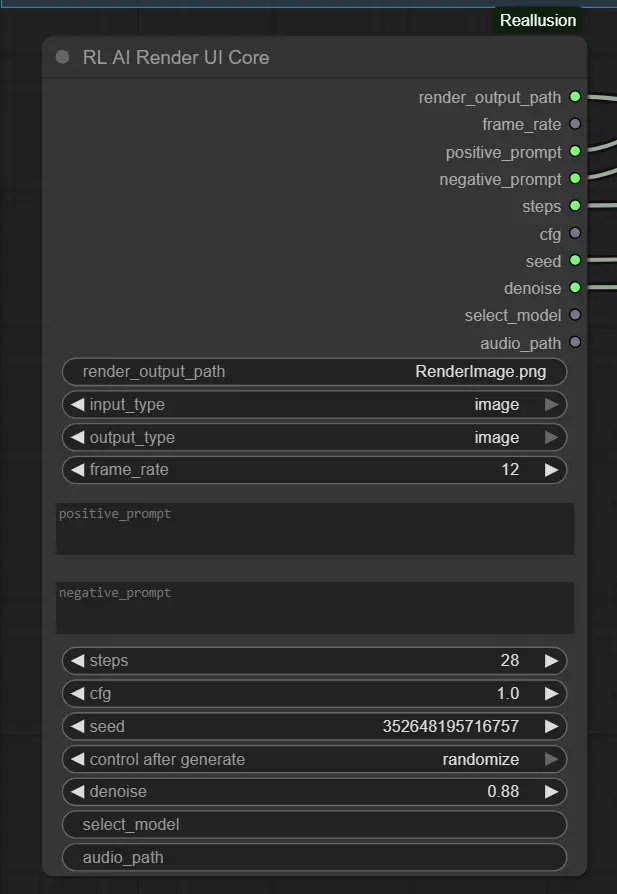

1. Eingabeaufforderung & Qualitätseinstellungen – RL AI Render UI Core Node Dieser Knoten sammelt die Hauptparameter aus dem AI Render Plugin.

- positive_prompt / negative_prompt: Beschreiben Sie Ihre gewünschten und unerwünschten Merkmale (Standard: leer).

- steps: Wie viele Iterationen zur Verfeinerung des Bildes. Beginnen Sie mit 28 für ausgewogene Qualität/Geschwindigkeit.

- cfg: Stiltreue. Verwenden Sie 1.0 für Flexibilität, erhöhen Sie leicht für stärkeren Einfluss der Eingabeaufforderung.

- denoise: Steuert, wie stark das Bild verändert wird. Verwenden Sie 0.88 für stilisierte Updates, niedriger für subtile Änderungen.

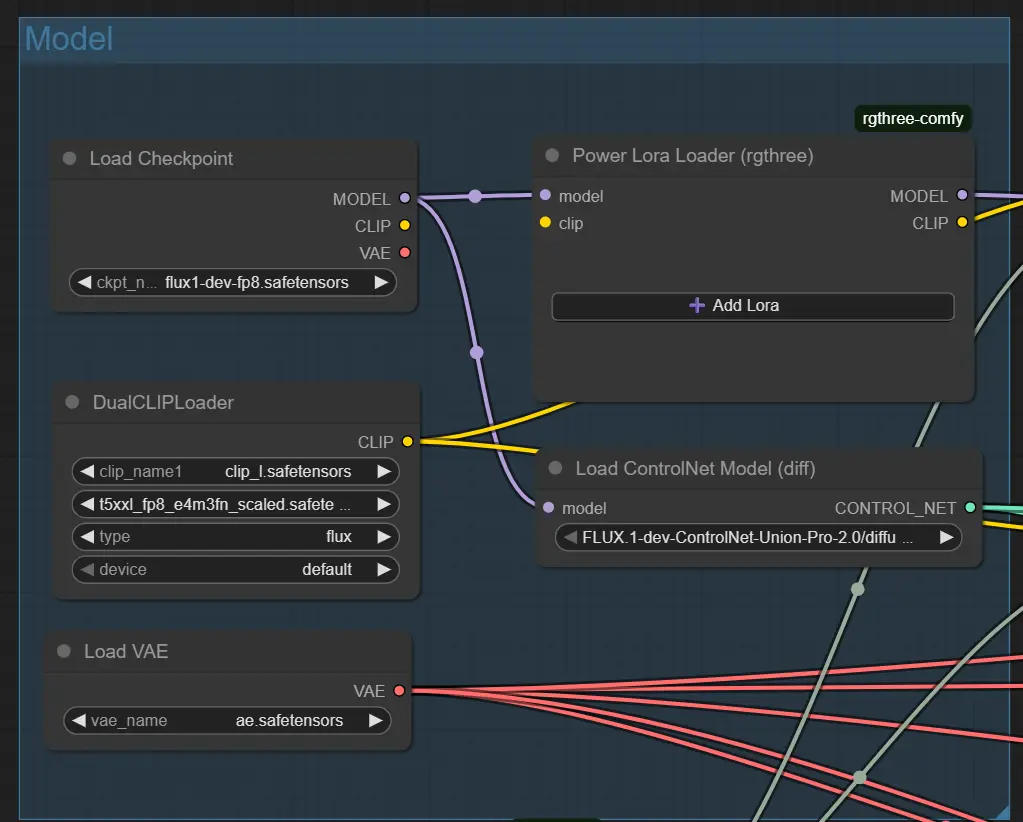

2. Basismodell-Einstellungen – Checkpoint-Knoten laden

Lädt Ihr gewähltes Modell (z.B. Flux 1 Dev ControlNet).

ckpt_name: Muss mit dem Modell übereinstimmen, das von Ihrem Stil erwartet wird (Standard: flux1-dev-fp8.safetensors).

Verwenden Sie Modelle, die IPAdapter oder ControlNet unterstützen, für beste Ergebnisse.

3. Strukturführung – ControlNet-Knoten (Pose, Tiefe, Canny) Jeder ControlNet-Knoten lädt eine spezifische Eingabedatei (z.B. Pose-Bild); nur aktiv, wenn Steuerung aktiviert ist.

- control_net_strength: Einflussstärke (Pose verwendet oft 1.0, Tiefe normalerweise 0.5).

- Passen Sie start_percent und end_percent an, um zu steuern, wann die Anleitung in der Generierung verblasst. <img src="https://cdn.runcomfy.net/workflow_assets/1270/readme03.webp" alt="Reallusion AI Render - Workflow ControlNet" width="350"/>

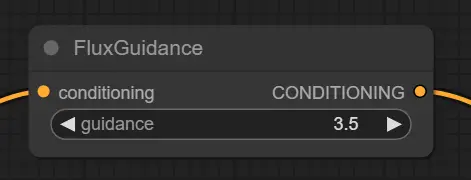

4. Eingabeaufforderungs-Konditionierung – Flux Guidance Node Passt an, wie die Eingabeaufforderung die Bildgenerierung formt.

- guidance: Höher = enger zur Eingabeaufforderung. Empfehlen 3.5 für gutes Gleichgewicht.

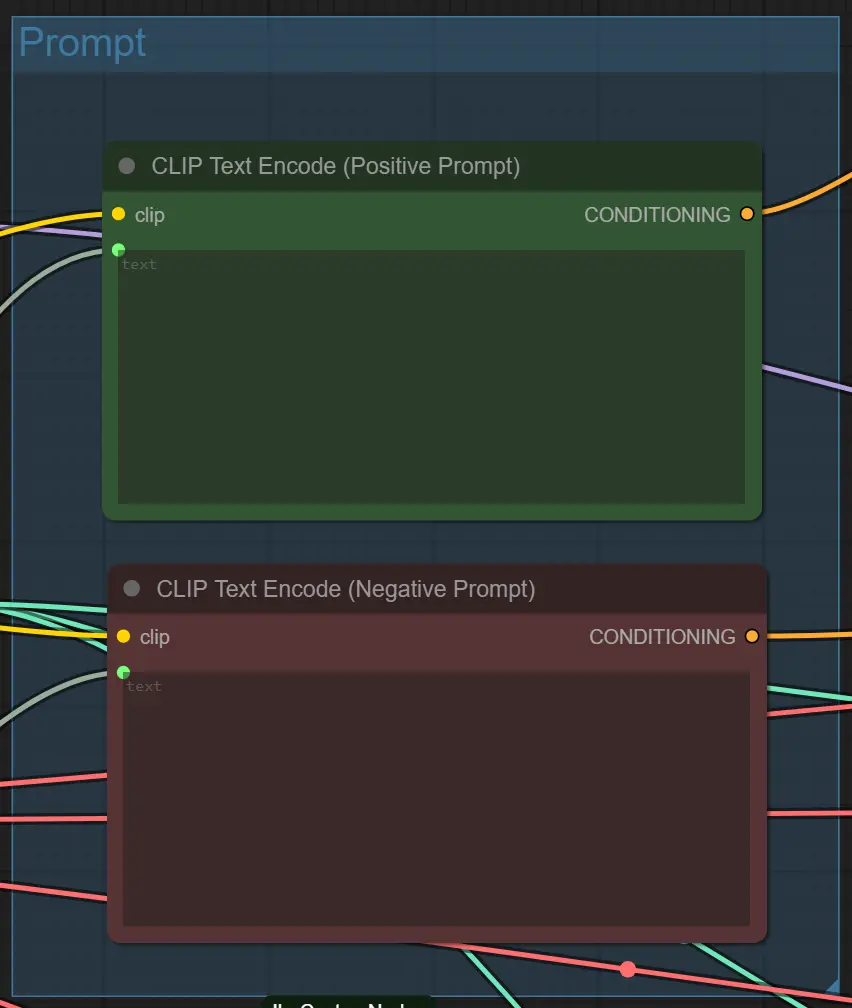

5. Text-Eingabeaufforderungscodierung – CLIP Text Encode Nodes Erzeugt Vektoranleitung aus Ihren Eingabeaufforderungen.

- Keine manuelle Änderung erforderlich. Akzeptiert Text vom Plugin.

Erweiterte Tipps für Knoten

Eingabeaufforderung Klarheit Vermeiden Sie zu komplexe oder vage Eingabeaufforderungen. Verwenden Sie direkte Stile wie filmische Beleuchtung, Anime oder Cyberpunk-Gasse. Seien Sie spezifisch für kontrolliertere Ergebnisse.

Balance von Entrauschen und Struktur Wenn ControlNet aktiviert ist (z.B. Tiefe + Pose), kann ein hohes Entrauschen wie 0.88 die Struktur stören. Versuchen Sie 0.6–0.75, wenn die Erhaltung des Layouts Priorität hat.

Passen Sie Eingaben mit ControlNet an Aktivieren Sie ControlNet nur, wenn ein passendes Anleitungbild existiert (z.B. RenderImageDepth.png für Tiefe). Mismatch kann fehlerhafte Eingabeaufforderungen oder leere Ergebnisse verursachen.

4. Anerkennung#

Dieser Workflow integriert das Flux-FP8-Modell entwickelt von Kijai mit Leistungsoptimierungstechniken, die vom Reallusion-Team in ihrem offiziellen AI-Rendering Workflow-Leitfaden beschrieben wurden. Besonderer Dank an Kijai für ihren Beitrag zur Modellentwicklung und an Reallusion für das Teilen wertvoller Erkenntnisse, die die Effizienz des AI-Renderings in ComfyUI-Workflows verbessern.

5. Weitere Ressourcen über Reallusion AI Render#

Erkunden Sie technische Ressourcen und Dokumentationen zu Reallusion AI Render.

- Setup / Schnellstart-Dokumente – Schritt-für-Schritt-Anleitung zur Konfiguration von AI Render Workflows in ComfyUI. Präsentationsfolien

- Technische Übersicht – Überblick über Integration und Funktionen in AI Renders Open Beta. Produktankündigung

- Workflow-Optimierungsleitfaden – Tipps zur Maximierung der Leistung und Anpassung von AI Render in Produktionsumgebungen. Leistungstipps

- iClone – Offizielle Seite für iClone-Software. iClone Website

- Character Creator – Offizielle Seite für Reallusion Character Creator. Character Creator Website

- AI Render Open Beta Forum – Diskussionen und Updates im offiziellen Reallusion-Forum. Forum-Link

- AI Render Installations-Tutorial – Videoanleitung zur Einrichtung von AI Render. YouTube-Tutorial

- AI Render Bild-zu-Bild Workflow Tutorial – Videoanleitung des Bild-zu-Bild-Workflows. YouTube-Tutorial

- AI Render Video-zu-Video Workflow Tutorial – Videoanleitung des Video-zu-Video-Workflows. YouTube-Tutorial