Was ist der InstantCharacter ComfyUI Workflow?#

InstantCharacter ist ein personalisierter Charakterbildgenerierungs-Workflow für ComfyUI, aufgebaut auf dem FLUX Diffusion Transformer (DiT). Stellen Sie sich InstantCharacter als eine Möglichkeit vor, hochauflösende Charakterdarstellungen aus einem einzigen Referenzbild und einem Textprompt zu ermöglichen – während es die Gesichtserkennung, Anpassung der Pose und kreative Stilgebung durch das InstantCharacter-Framework bewahrt.

Egal, ob Sie stilisierte Porträts, sequentielle Keyframes oder fantasievolle Posen in unterschiedlichen Umgebungen generieren, InstantCharacter gibt Schöpfern präzise Kontrolle mit unvergleichlicher Konsistenz. Der InstantCharacter-Workflow bringt Tencents bahnbrechende Personalisierungstechnologie zu ComfyUI und kombiniert Identitätsbewahrung mit kreativer Flexibilität.

Hauptmerkmale und Vorteile von InstantCharacter#

Charakter-Identitätsbewahrung: InstantCharacter bewahrt das Erscheinungsbild der Charaktere, während es flexibel hochwertige Bilder basierend auf Textanweisungen erstellt. Der InstantCharacter-Workflow erreicht ein exzellentes Gleichgewicht zwischen Identitätskonsistenz und Textkontrolle.

Erweiterte Merkmalextraktion: InstantCharacter nutzt SigLIP für feingranulare Identitätsdetails und DINOv2 für robuste, hintergrundresistente Merkmale. Dieser duale Encoder-Ansatz bietet umfassende Charakterinformationen durch InstantCharacters mehrstufige Extraktion.

Skalierbare DiT-Architektur: Speziell für Diffusion Transformers entwickelt, verwendet InstantCharacter eine vollständige Transformer-Architektur für effiziente FLUX-Interaktion. InstantCharacter nutzt zeitschrittbewusste Q-Former und Cross-Attention-Mechanismen für überlegene Leistung.

Stilkompatibilität: InstantCharacter zeigt exzellente Kompatibilität mit Stil-LoRAs in Anime-, realistischen und künstlerischen Stilen. Das InstantCharacter-Framework bewahrt die Kernidentitätsmerkmale während der Anpassung an diverse visuelle Stile.

Wie man InstantCharacter in ComfyUI verwendet#

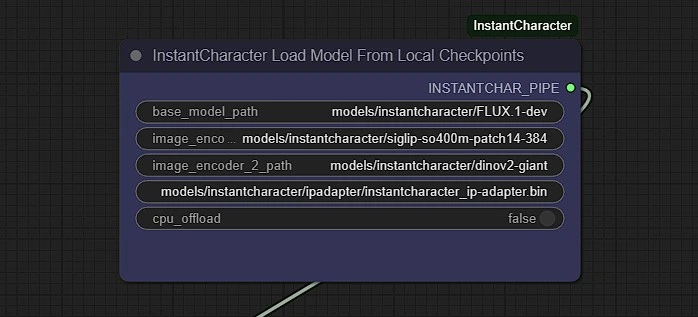

Modell laden#

Das InstantCharacter DiT-Modell und die erforderlichen Encoder werden automatisch geladen:

- InstantCharacter DiT FLUX Adapter wird automatisch für optimale Leistung initialisiert

- FLUX-Modell wird in das Verzeichnis

models/diffuserfür die InstantCharacter-Verarbeitung heruntergeladen - Bild-Encoder wird in

models/clipvisionfür die InstantCharacter-Identitätsextraktion heruntergeladen - InstantCharacter IP-Adapter erfordert manuellen Download in

models/ipadaptervon: InstantCharacter IP-Adapter

Systemanforderungen für InstantCharacter: 45GB VRAM erforderlich oder 24GB VRAM mit aktiviertem CPU-Offloading für InstantCharacter-Workflows.

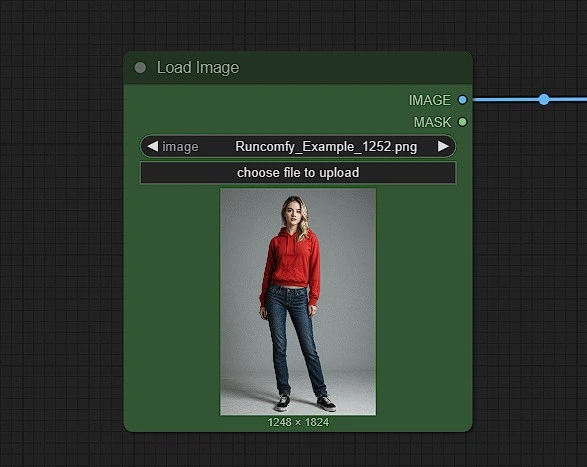

Referenz hochladen#

Laden Sie ein einziges Referenzbild Ihres Charakters für die InstantCharacter-Verarbeitung hoch:

- Porträt oder Ganzkörper-Bilder funktionieren am besten mit der InstantCharacter-Analyse

- Halten Sie den Hintergrund unaufgeräumt, um die Genauigkeit der Identitätskodierung von InstantCharacter zu verbessern

- Diese Referenz verankert die Charakteridentität über alle InstantCharacter-Generierungen hinweg

Das InstantCharacter-Modell extrahiert mehrstufige Merkmale:

- Niedrigstufige Gesichts- und Kleidungsdetails durch InstantCharacters SigLIP-Encoder

- Bereichs- und patchbasierte strukturelle Merkmale über das InstantCharacter DINOv2-System

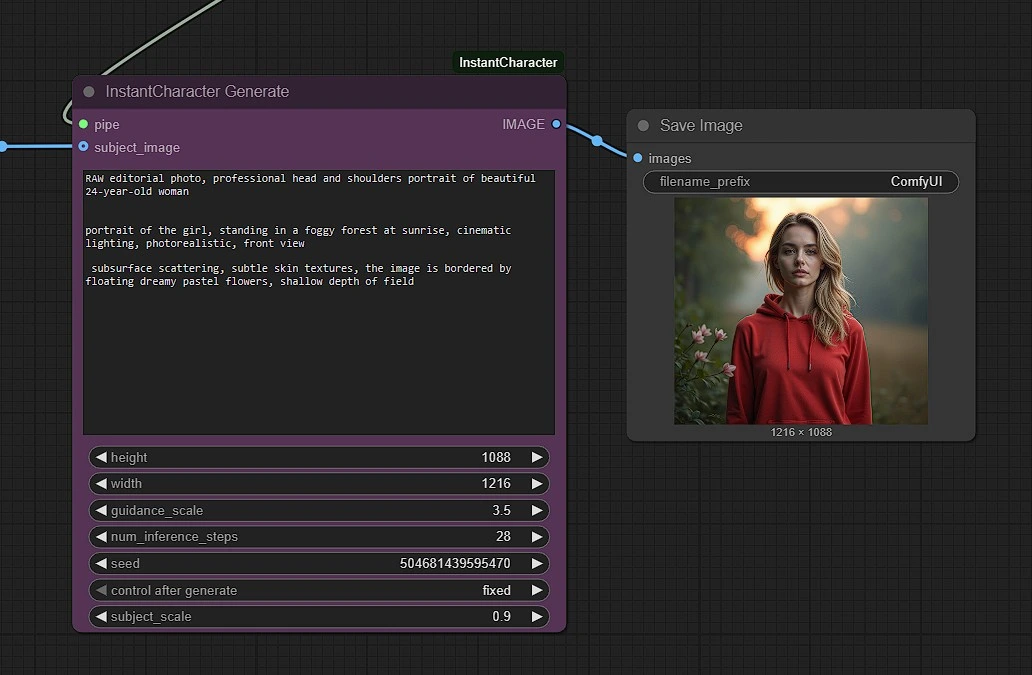

Sampler + Prompt#

Führen Sie Ihre InstantCharacter-Generierung mit detaillierten Prompts und Abtastoptionen

- Positiver Prompt für InstantCharacter

- Beschreiben Sie Szenen, Posen, Stile oder Ausdrücke, die InstantCharacter interpretieren soll

- InstantCharacter glänzt bei komplexen, aktionsorientierten Prompts

- Beispiel: "ein Charakter in Sci-Fi-Rüstung, der in einem neonbeleuchteten Korridor geht, filmische Beleuchtung"

- Negativer Prompt für InstantCharacter

- Filtern Sie unerwünschte Merkmale aus der InstantCharacter-Ausgabe heraus

- Beispiel: "verschwommen, zusätzliche Gliedmaßen, schlechte Anatomie, Wasserzeichen"

- InstantCharacter Samplereinstellungen

- Wählen Sie Sampler wie Euler oder DPM++, die für InstantCharacter optimiert sind

- Passen Sie Schritte, CFG und Auflösung für die InstantCharacter-Leistung an

- Alle InstantCharacter-Ausgaben werden automatisch in den ComfyUI-Ausgabeordner gespeichert

Das richtige Prompt-Design maximiert sowohl die Identitätsausrichtung als auch die Szenengenauigkeit in InstantCharacter-Workflows.

Danksagung#

Dieser InstantCharacter ComfyUI-Workflow integriert das von Tencent entwickelte InstantCharacter-Modell und wurde von jax-explorer implementiert. Besonderer Dank an das Tencent-Forschungsteam für die Entwicklung des fortschrittlichen Personalisierungssystems von InstantCharacter und an die ComfyUI-Community für die nahtlose Integration von InstantCharacter.

Weitere Ressourcen über InstantCharacter#

Erforschen Sie technische Ressourcen und Dokumentationen zu InstantCharacter:

- GitHub-Repository – Offizielle Implementierung von InstantCharacter und Modelfiles. ComfyUI-InstantCharacter