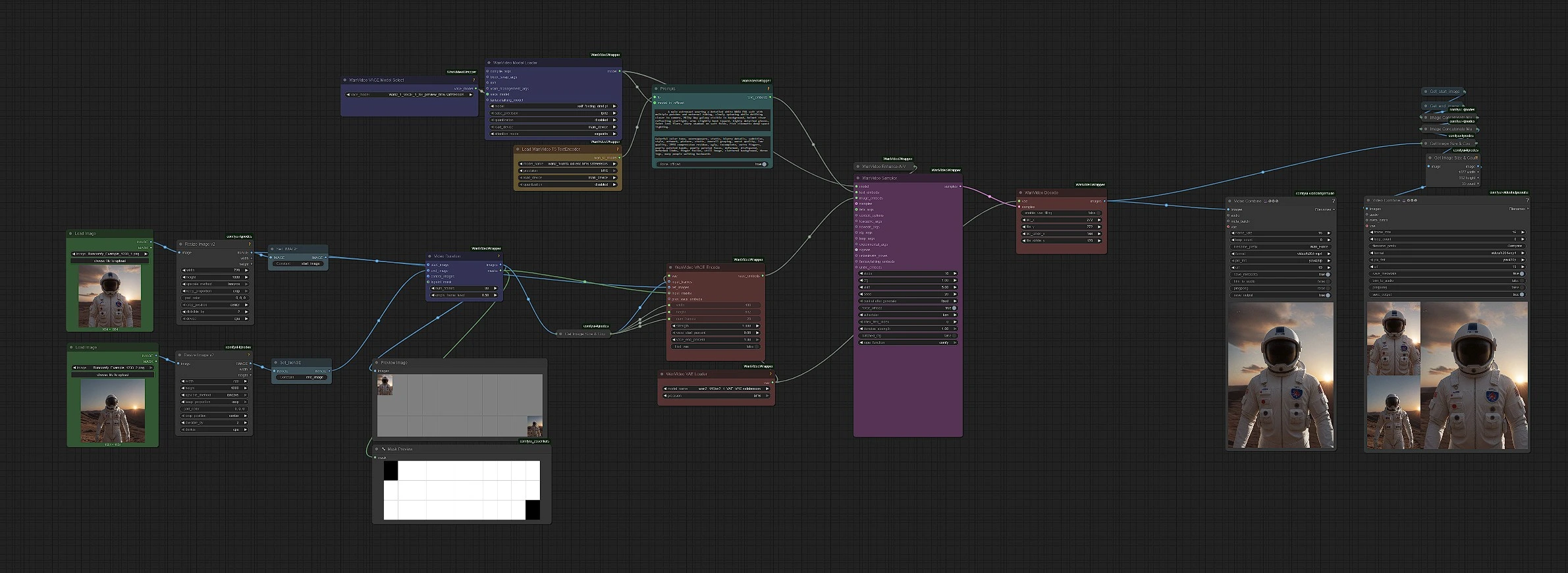

Self Forcing: 自回歸關鍵幀到影片生成#

Self Forcing是一種先進的關鍵幀驅動影片生成模型。Self Forcing透過在起始和結束關鍵幀之間生成運動,並由描述性文本提示引導,實現流暢、高質量的影片合成。

基於具有KV快取的自回歸影片擴散架構,Self Forcing在生成跨幀的時間一致、身份保留的運動方面表現出色。Self Forcing的關鍵幀-文本聯合方法允許流暢的過渡,同時在生成影片中保持主題結構和風格。

為什麼使用Self Forcing?#

Self Forcing 提供:

- 基於關鍵幀的生成:Self Forcing使用起始和結束參考圖像來控制外觀和運動

- 提示 + 關鍵幀控制:Self Forcing將創意文本描述與參考結構融合

- 自回歸運動:Self Forcing提供流暢、時間一致的幀間過渡

- 身份保留:Self Forcing在生成序列中維持主題忠實性

- 理想的精簡影片創作:Self Forcing非常適合角色驅動的敘事、電影動畫和概念影片合成

無論您是在生成動畫、電影序列還是身份一致的AI影片,Self Forcing皆能在確保運動流暢和真實的情況下,提供完整的創意控制。

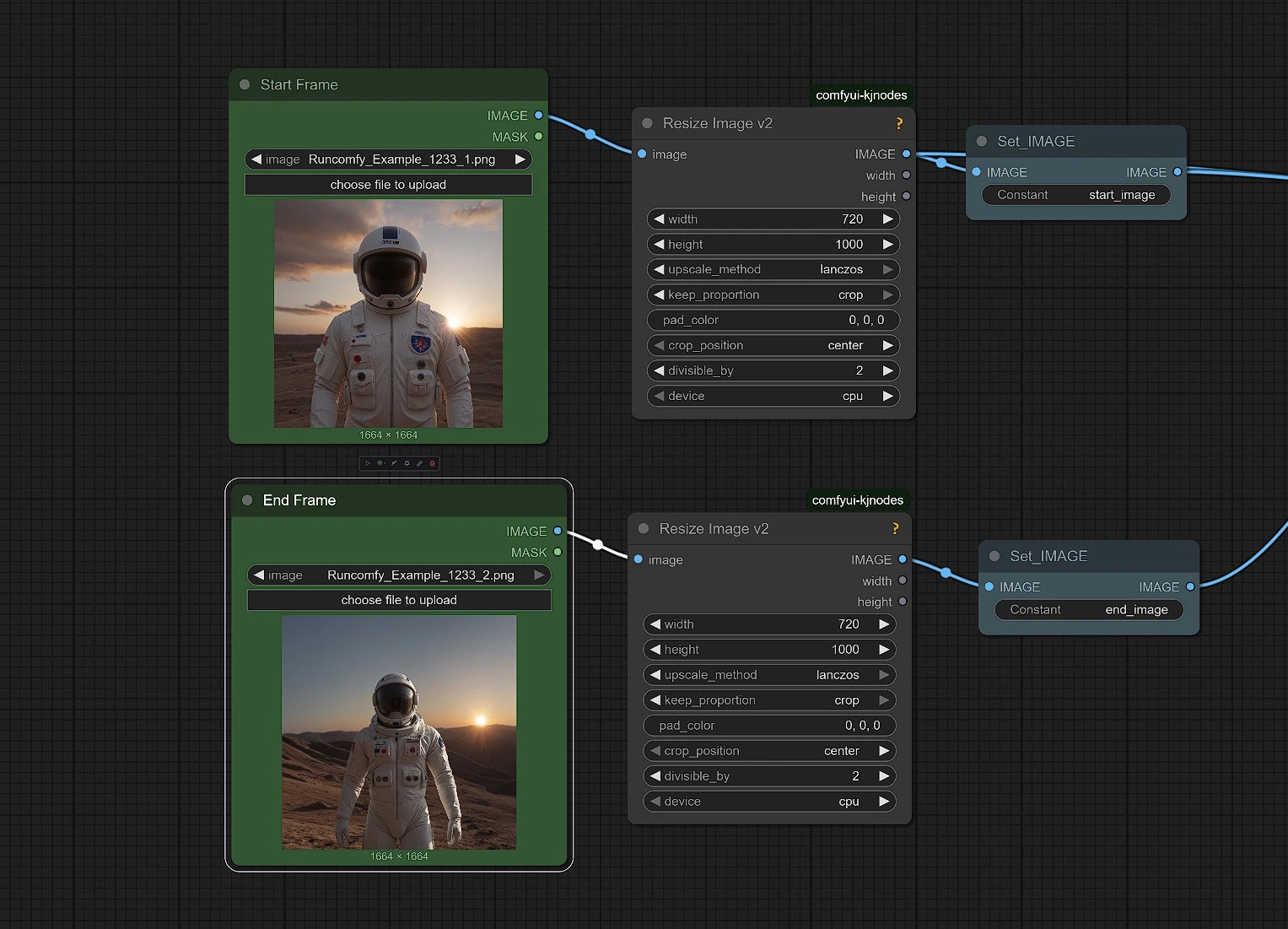

輸入圖像#

在此部分,您將上傳您的起始關鍵幀和結束關鍵幀圖像給Self Forcing。這兩個圖像定義了您的Self Forcing生成影片的開始和結束外觀。

- 使用提供的Load Image節點上傳兩個參考圖像給Self Forcing。

- 使用可選的調整大小和裁剪節點來調整您的圖像以達到最佳Self Forcing對齊和長寬比。

- 正確對齊和裁剪良好的關鍵幀可改善Self Forcing在生成序列中的運動一致性。

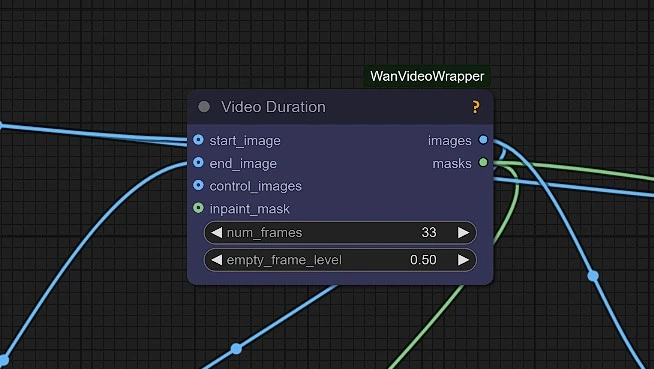

影片時長#

設置您的Self Forcing影片將生成的總幀數。

- 較長的幀數允許Self Forcing在關鍵幀之間有更漸進、流暢的過渡。

- 較短的幀數會導致Self Forcing過渡更快。

- 典型的Self Forcing範圍:16–48幀,取決於所需的長度和運動複雜性。

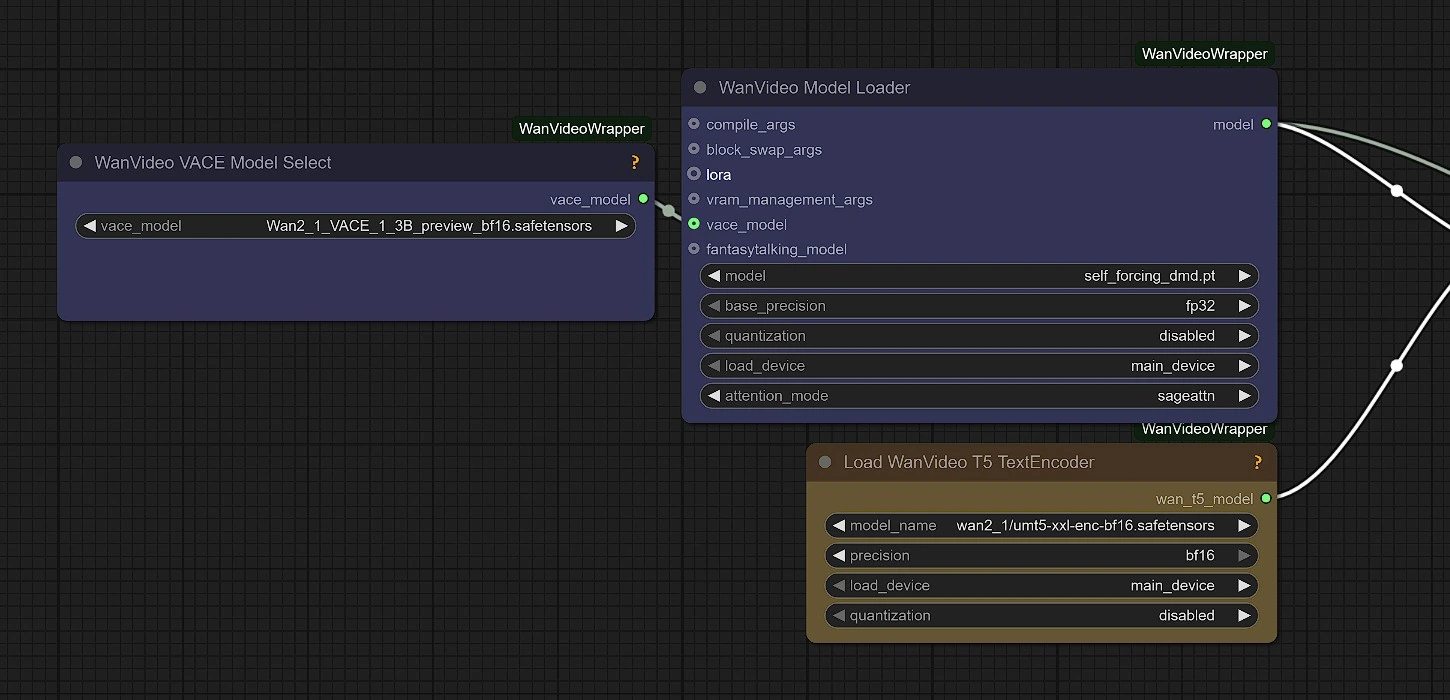

模型#

此組會載入Self Forcing自回歸影片擴散模型。Self Forcing工作流程會自動為您選擇正確的模型版本。

- Self Forcing建構於具有KV快取的自回歸展開。

- Self Forcing確保穩定、時間一致的運動生成。

- Self Forcing允許在高端GPU如RTX 4090上進行實時推理。

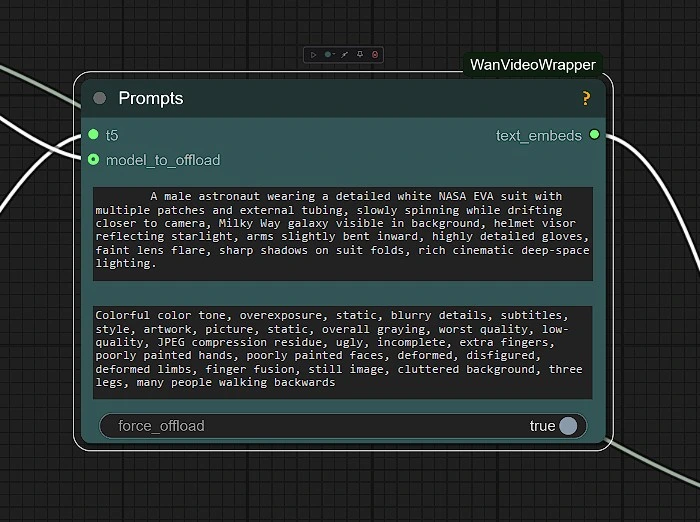

提示#

在此部分,您可以輸入您的文本提示以指導Self Forcing生成。

- 將提示與您的關鍵幀結合,以影響Self Forcing的風格、背景或運動上下文。

- 使用描述性和清晰的語言來最大化Self Forcing的創意控制。

- 負面提示也可用於抑制Self Forcing中的不需要元素。

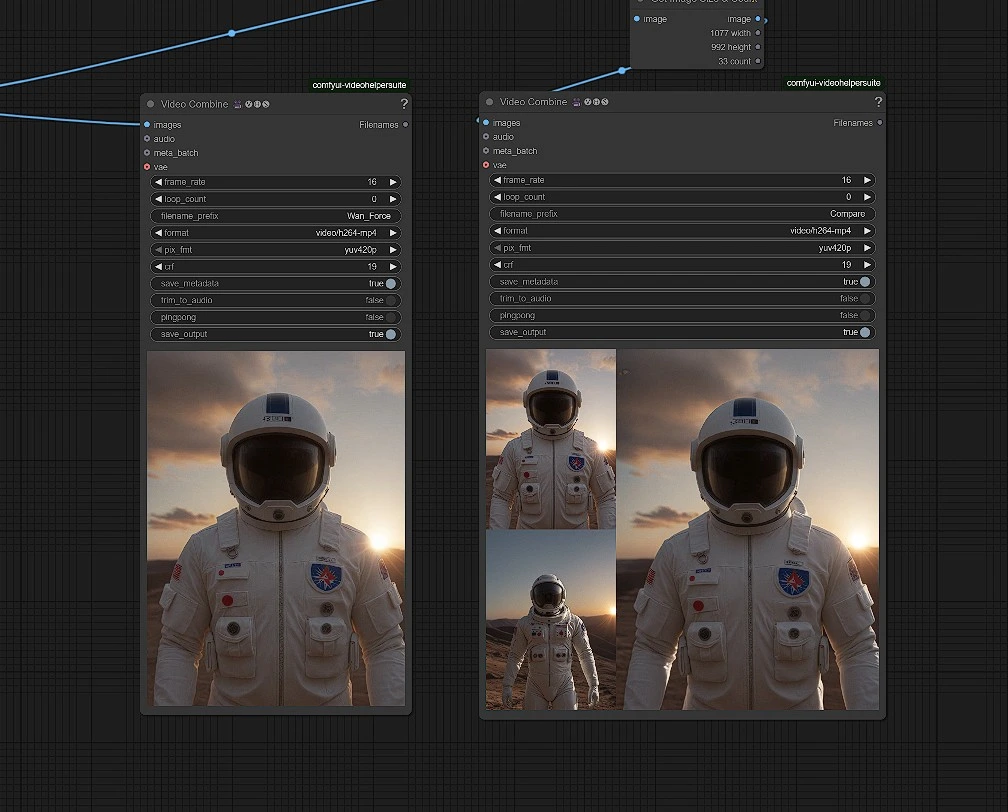

輸出#

一旦Self Forcing生成完成:

- 您的Self Forcing影片將自動保存在您的ComfyUI目錄中的

Comfyui > output資料夾。 - Self Forcing檔案將存儲為影片剪輯(MP4或圖像序列,取決於配置)。

致謝#

此工作流程使用由kijai開發的Wan Video Wrapper節點,而Self Forcing方法和工作流程本身由guandeh自訂開發。 全額信用歸於兩位作者,感謝他們對於ComfyUI中自回歸影片生成的原創Self Forcing模型開發和整合工作。

GitHub Repository: https://github.com/guandeh17/Self-Forcing