利用Seedance Lite轻松将文字或图片转换为生动视频,创意制作更高效。

利用Seedance Lite轻松将文字或图片转换为生动视频,创意制作更高效。

以FusionX轻松将图像生成电影质感视频,精准控制创意与细节

通过首帧风格控制,让AI视频从始至终保持统一视觉效果,轻松实现创意再现。

支持风格控制与物体编辑的电影级AI视频生成工具

通过遮罩、文本或参考图像在视频中灵活替换特定区域,打造逼真内容。

用Pikaframes轻松将图像转化为流畅的视频动画,打造自然关键帧过渡。

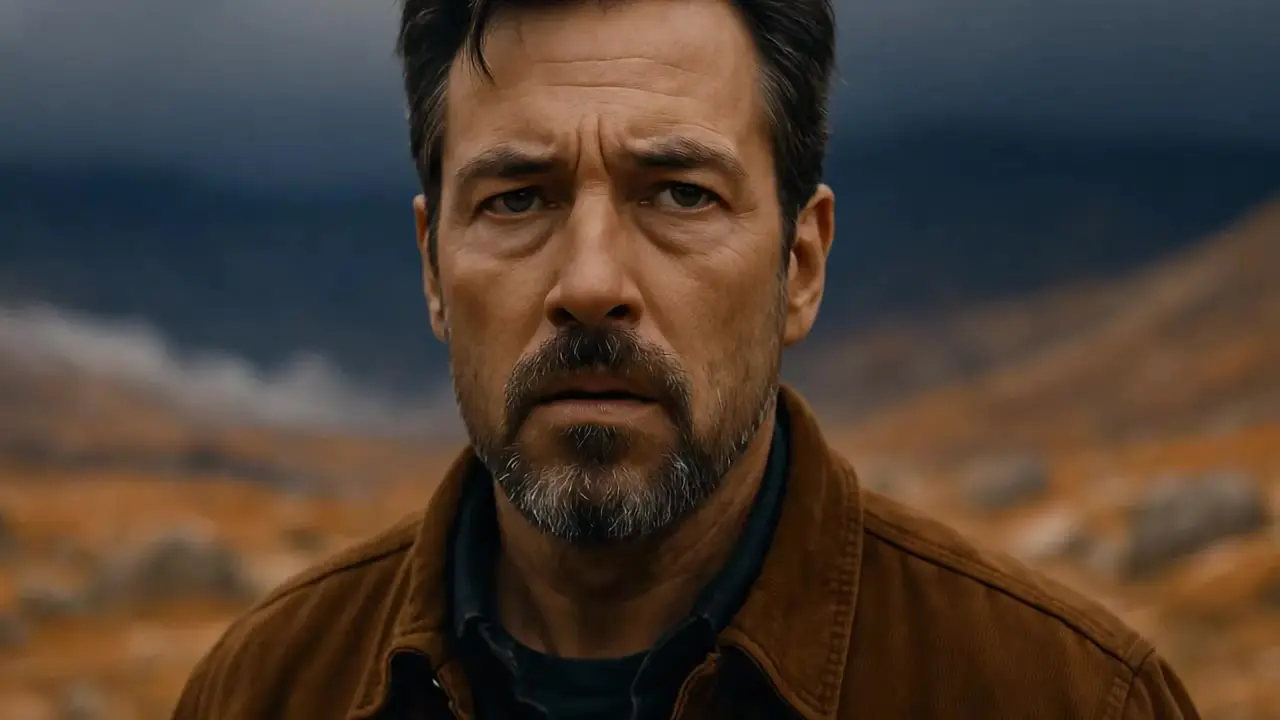

Runway Gen-4 是 Runway 最新一代的 AI 视频生成模型。相比早期版本如 Gen-2 和 Gen-3 Alpha,Runway Gen-4 在单段视频中表现出更强的视觉一致性,比如在镜头移动或场景变化时,能够更好地保持人物或物体的外观稳定。Runway Gen-4 还在运动渲染和整体场景连贯性上做了优化,虽然视频动作比前代版本更流畅,但生成效果仍会受到输入内容复杂度和提示语质量的影响,有时仍可能出现细节不一致的情况。

Runway Gen-4 需要两个输入:一张图像(作为基础画面和第一帧)和一段描述所需动作或运动的文本提示。目前 Runway Gen-4 并不支持纯文本生成视频,这在灵活性上略逊于某些文本生成视频的工具。文本提示最长可达 1000 个字符,实践中,聚焦于动作或镜头方向的提示效果最佳,因为画面外观已由图像决定。用户可以使用照片或 AI 生成图像,但最终效果仍高度依赖于提示的清晰度和图像内容。

Runway Gen-4 支持输出长度为 5 秒或 10 秒的视频,帧率为每秒 24 帧。默认输出分辨率为 1280×720(即 720p),画幅比例为 16:9,也支持竖屏(9:16)和方形(1:1)等格式。虽然 Gen-4 的画质相比以往更高,但受限的时长和分辨率对于复杂叙事或商业作品仍有一定限制。要制作更长的视频,通常需要将多个短片剪辑拼接在一起。

Runway Gen-4 特别适用于概念开发、视觉实验和原型制作。它在分镜绘制、音乐视频制作、视觉艺术项目等创意流程中有着广泛潜力,适合需要短片段、风格鲜明画面的场景。

Runway Gen-4 相较于 Gen-2 和 Gen-3 Alpha,在单个视频段落中的视觉一致性和动作流畅度方面都有明显提升。Runway Gen-4 对用户提示的理解也更加准确,生成结果更能反映描述中的动作方向或镜头运动。

尽管 Runway Gen-4 在多个方面有所升级,但仍存在一些值得关注的限制:视频时长有限,每段只能为 5 秒或 10 秒,制作长片需要额外剪辑拼接;必须提供图像输入,不支持纯文本生成,这会增加操作步骤,限制创作灵活性;跨片段保持人物和风格一致性仍具挑战性;在复杂场景中,Runway Gen-4 偶尔会出现画面失真、提示理解偏差等视觉瑕疵,可能需要多次尝试才能获得可用结果。

目前,Runway Gen-4 在单个视频片段中通常能较好保留角色外观,但在多个视频中持续保持一致性仍缺乏稳定的解决方案。为了提高连贯性,创作者可为每个场景准备风格统一的参考图像,但即使如此,也很难确保角色在多个片段中保持一致。在 Runway Gen-4 推出专门的相关功能前,维护故事连贯性通常还需通过手动调整和后期编辑来实现。

RunComfy is the premier ComfyUI platform, offering ComfyUI online environment and services, along with ComfyUI workflows featuring stunning visuals. RunComfy also provides AI Models, enabling artists to harness the latest AI tools to create incredible art.