Wan Alpha: прозрачное текст-видео для профессионального композитинга#

Wan Alpha — это специально разработанный процесс ComfyUI, который генерирует видео с нативным альфа-каналом, используя семейство Wan 2.1. Он совместно производит RGB и альфа, так что персонажи, реквизит и эффекты сразу попадают на временные шкалы без ключевой анимации или ротоскопирования. Для VFX, движущейся графики и интерактивных приложений Wan Alpha обеспечивает чистые края, полупрозрачные эффекты и маски с точностью до кадра, готовые к производству.

Основан на Wan2.1‑T2V‑14B и паре VAE, учитывающей альфа, Wan Alpha балансирует точность и скорость. Опциональное ускорение LightX2V LoRA сокращает время выборки, сохраняя детали, и процесс экспортирует последовательности кадров RGBA плюс анимированный WebP-превью для быстрого просмотра.

Ключевые модели в процессе Comfyui Wan Alpha#

- Wan2.1‑T2V‑14B. Базовая модель текст-видео, определяющая структуру сцены, движение и качество рендеринга. Официальные веса и код поддерживаются в организации Wan-Video на GitHub. Wan-Video/Wan2.1

- UMT5‑XXL текстовый энкодер. Многоязычный энкодер, используемый для токенизации и встраивания подсказок для моделей Wan, обеспечивая богатые фразы подсказок на нескольких языках. google/umt5-xxl и UMT5 docs

- Wan‑Alpha VAE пара. Дизайн VAE, который обучается RGB и альфа совместно, так что декодированная альфа совпадает с RGB пиксель в пиксель, поддерживая тонкие края и полупрозрачность. См. технический отчет Wan‑Alpha для получения дополнительной информации. Wan‑Alpha (arXiv)

- LightX2V LoRA. Опциональная LoRA для ускорения, которая сокращает долгие выборки до нескольких шагов для более быстрого текст-видео, сохраняя при этом качество восприятия. ModelTC/LightX2V

Как использовать процесс Comfyui Wan Alpha#

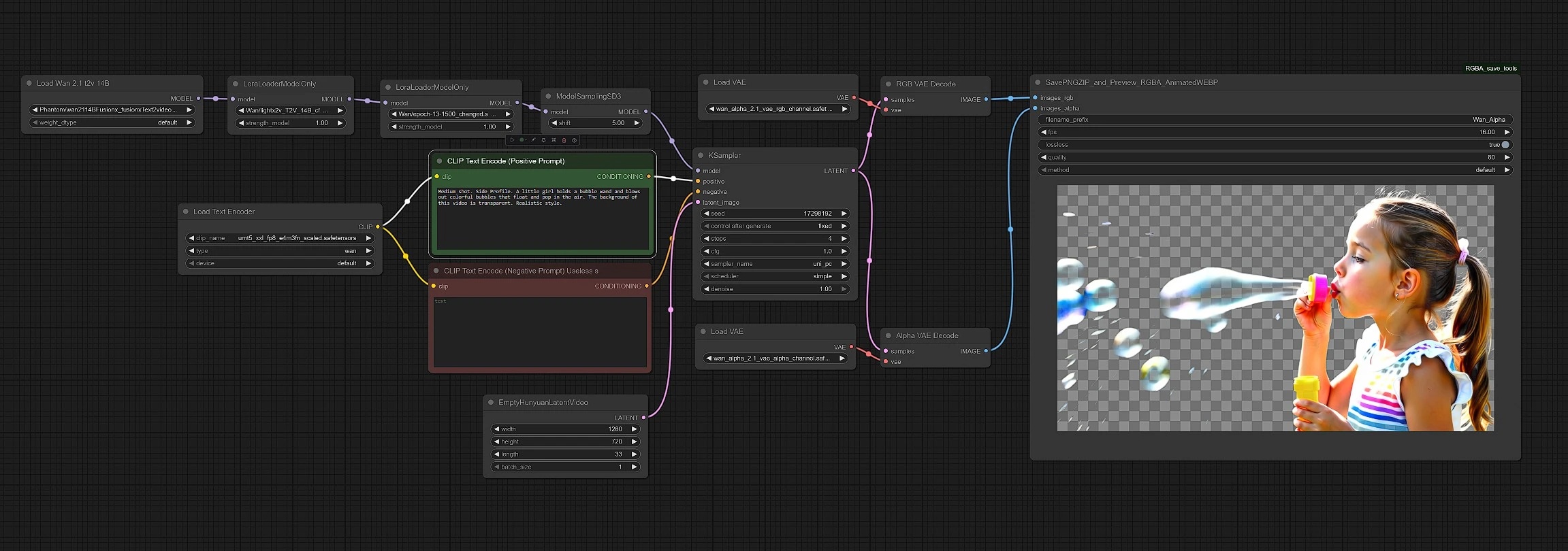

Этот граф ComfyUI следует простому пути от подсказки до кадров RGBA: загрузите модели, закодируйте текст, выделите латентное видео, выберите, декодируйте RGB и альфа синхронно, затем сохраните.

Загрузка моделей и LoRA

- Начните с

Load Wan 2.1 t2v 14B(#37), чтобы загрузить базовую модель. Если вы используете ускорение или стилистические изменения, примените их с помощьюLoraLoaderModelOnly(#59) иLoraLoaderModelOnly(#65) последовательно. Затем модель проходит черезModelSamplingSD3(#48), который настраивает выборщик, совместимый с загруженной контрольной точкой. Этот стек определяет движение и стиль рендеринга, которые Wan Alpha улучшит на следующих этапах.

Кодирование подсказок

Load Text Encoder(#38) загружает текстовый энкодер UMT5‑XXL. Введите ваше описание вCLIP Text Encode (Positive Prompt)(#6); держите ваш предмет, действие, кадрирование камеры и фразу "transparent background" краткими. ИспользуйтеCLIP Text Encode (Negative Prompt) Useless s(#7), чтобы избежать ореолов или загромождения фона, если это необходимо. Эти кодировки обусловливают как генерацию RGB, так и альфа, чтобы края и подсказки прозрачности следовали вашему намерению.

Настройка видеоканвы

- Используйте

EmptyHunyuanLatentVideo(#40), чтобы определить латентную видеоканву. Установитеwidth,height,framesиfps, чтобы соответствовать вашему кадру; более высокие разрешения или более длинные клипы требуют больше памяти. Этот узел выделяет временно согласованное латентное пространство, которое Wan Alpha заполнит движением и внешним видом. Рассмотрите возможность согласования продолжительности и частоты кадров с вашим редактированием, чтобы избежать повторной выборки позже.

Генерация

KSampler(#3) выполняет диффузию на латентном видео, используя ваш стек моделей и условие подсказки. Настройтеseedдля вариаций и выберитеsamplerиscheduler, которые балансируют скорость и детали. Когда LightX2V LoRA активен, вы можете использовать меньше шагов для более быстрого рендеринга, сохраняя стабильность. Выход — это один латентный поток, общий для следующей стадии декодирования, чтобы гарантировать идеальное соответствие RGBA.

Декодирование RGB и альфа

RGB VAE Decode(#8) работает в паре сVAELoader(#39) для реконструкции RGB кадров. ПараллельноAlpha VAE Decode(#52) работает в паре сVAELoader(#51) для реконструкции альфа-канала. Оба декодера читают один и тот же латент, так что мат совпадает точно с цветными пикселями, что является основной идеей в дизайне Wan‑Alpha для обеспечения согласованной прозрачности. Это двухпутевое декодирование делает Wan Alpha готовым к прямому композитингу.

Сохранение и предварительный просмотр

SavePNGZIP_and_Preview_RGBA_AnimatedWEBP(#73) записывает два результата: zip-архив кадров RGBA PNG и компактный анимированный WebP-превью. Последовательность кадров подходит для NLE и композиторов, а превью ускоряет обзоры. Назовите ваш набор выходных данных, выберите длину и качество превью и выполните узел, чтобы упаковать ваш результат.

Ключевые узлы в процессе Comfyui Wan Alpha#

EmptyHunyuanLatentVideo (#40)

- Роль: определяет пространственное и временное разрешение создаваемого клипа. Настройте

width,height,framesиfpsдля соответствия доставке. Большие канвы и более длительные длительности увеличивают потребность в VRAM; рассмотрите возможность использования более коротких черновиков для разработки внешнего вида, затем увеличьте масштаб для окончательных версий.

KSampler (#3)

- Роль: основной деноайзер для Wan Alpha. Настройте

seedдля исследований,stepsдля обмена скоростью на детали,samplerиschedulerдля стабильности, иcfgдля баланса приверженности подсказке с естественным движением. Когда LightX2V LoRA активен, вы можете значительно уменьшитьsteps, сохраняя качество благодаря дистилляции шагов. См. LightX2V для контекста по быстрому выбору. ModelTC/LightX2V

LoraLoaderModelOnly (#59)

- Роль: загружает LightX2V LoRA, который ускоряет выборку Wan2.1. Используйте контроль

strength, чтобы смешать его эффект, если вы видите переизбыточность или артефакты темпа. Держите эту LoRA ближе всего к базовой модели в цепочке, чтобы последующие LoRA наследовали её преимущества в скорости.

LoraLoaderModelOnly (#65)

- Роль: загружает дополнительную LoRA для стилистического или доменного уточнения. Умерьте

strength, чтобы избежать чрезмерного подавления координации движения; комбинируйте с вашей подсказкой, а не заменяйте её. Если появляются артефакты, уменьшите эту LoRA перед изменением выборщика.

VAELoader (#39) RGB

- Роль: предоставляет RGB VAE, используемый

RGB VAE Decode(#8). Держите это в паре с Wan‑Alpha альфа VAE, чтобы гарантировать, что оба декодера интерпретируют латенты согласованно. Замена на несвязанные VAE может нарушить края или смягчить прозрачность. Фон о совместном дизайне RGB–альфа представлен в отчете Wan‑Alpha. Wan‑Alpha (arXiv)

VAELoader (#51) Alpha

- Роль: предоставляет альфа VAE, используемый

Alpha VAE Decode(#52). Он реконструирует мат из того же латентного пространства, что и RGB, так что прозрачность совпадает с движением и деталями. Если вы настраиваете VAE, проверьте, что RGB и альфа всё ещё совпадают на субпиксельных краях, таких как волосы.

SavePNGZIP_and_Preview_RGBA_AnimatedWEBP (#73)

- Роль: экспортирует активы. Установите чёткое

output_nameдля версионности, выберите качество и частоту кадров превью, которые отражают созданный клип, и сохраняйте PNG экспорт как ваш мастер для безубыточного композитинга. Избегайте изменения размера между декодированием и сохранением, чтобы сохранить точность краёв.

Дополнительные параметры#

- Сильные подсказки для Wan Alpha явно описывают предмет, действие, камеру, освещение и "transparent background". Добавьте тонкие материалы, такие как "wispy hair" или "glass", чтобы использовать детали альфа.

- Для быстрой итерации используйте более короткие длительности или более низкие частоты кадров, затем увеличьте настройки, как только внешний вид и движение будут зафиксированы.

- Если вы видите ореолы, добавьте отрицательные, такие как "background, outline, green screen, white fringe" и держите освещение в подсказке согласованным.

- При объединении нескольких LoRA размещайте LoRA для ускорения раньше, а стилистические LoRA позже, и держите силы умеренными, чтобы сохранить реализм движения.

- Импортируйте последовательность RGBA PNG непосредственно в ваш композитор; используйте анимированный WebP только для превью, а не как мастер.

Ресурсы, используемые в Wan Alpha

- Семейство моделей Wan2.1 и код: Wan-Video/Wan2.1

- Текстовый энкодер UMT5: google/umt5-xxl и UMT5 docs

- Обзор метода Wan‑Alpha: Wan‑Alpha (arXiv)

- Ускорение LightX2V: ModelTC/LightX2V

Благодарности#

Этот процесс реализует и основывается на следующих работах и ресурсах. Мы благодарим WeChatCV за Wan-Alpha за их вклад и поддержку. Для получения авторитетной информации, пожалуйста, обратитесь к оригинальной документации и репозиториям, указанным ниже.

Ресурсы#

- WeChatCV/Wan-Alpha

- GitHub: WeChatCV/Wan-Alpha

Примечание: Использование упомянутых моделей, наборов данных и кода подчиняется соответствующим лицензиям и условиям, предоставленным их авторами и поддерживающими организациями.