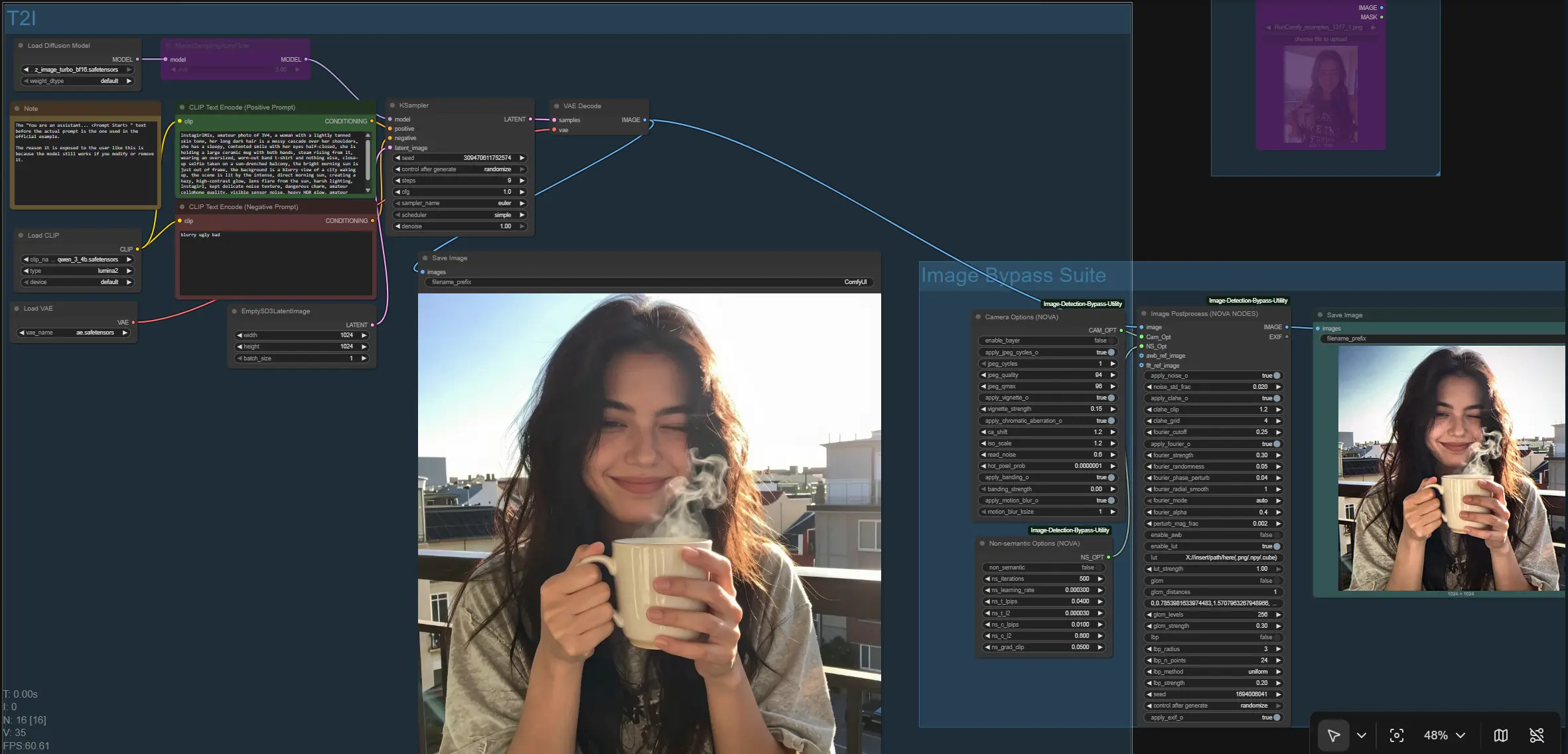

Рабочий процесс обхода изображений в ComfyUI#

Этот рабочий процесс предоставляет модульный конвейер обхода изображений для ComfyUI, который сочетает в себе несемантическую нормализацию, управление в FFT-домене и симуляцию камеры. Он разработан для создателей и исследователей, которым нужен надежный способ обработки изображений через стадию обхода изображений, сохраняя полный контроль над маршрутизацией входных данных, поведением предобработки и консистентностью выходных данных.

В своей основе граф генерирует или принимает изображение, затем маршрутизирует его через Suite обхода изображений, который может применять артефакты, подобные сенсору, формирование частот, сопоставление текстур и перцептуальный оптимизатор. Результатом является чистый, настраиваемый путь, подходящий для пакетной работы, автоматизации и быстрого повторения на потребительских GPU. Логика обхода изображений работает на основе открытой утилиты из этого репозитория: PurinNyova/Image-Detection-Bypass-Utility.

Ключевые модели в рабочем процессе обхода изображений Comfyui#

- z_image_turbo_bf16 (контрольная точка UNet). Быстрая основа диффузии текст-изображение, используемая в ветке T2I для быстрого прототипирования и базовой генерации изображений. Может быть заменена на предпочитаемую вами контрольную точку. Ссылка: Comfy-Org/z_image_turbo на Hugging Face.

- VAE (ae.safetensors). Обрабатывает латентное декодирование обратно в пиксели, чтобы выход выборки можно было визуализировать и далее обрабатывать на стадии обхода изображений. Любая совместимая VAE может быть заменена, если вы предпочитаете другой профиль реконструкции.

- Кодировщик подсказок (загружается через CLIPLoader). Кодирует ваши положительные и отрицательные подсказки в векторы кондиционирования для выборщика. График не зависит от конкретного текстового файла кодировщика, который вы загружаете, так что вы можете заменять модели по мере необходимости для вашего базового генератора.

Как использовать рабочий процесс обхода изображений Comfyui#

В целом, рабочий процесс предлагает два способа создания изображения, которое входит в Suite обхода изображений: ветвь Text-to-Image (T2I) и ветвь Image-to-Image (I2I). Обе сходятся на одном узле обработки, который применяет логику обхода изображений и записывает окончательный результат на диск. График также сохраняет базовую линию до обхода, чтобы вы могли сравнить выходные данные.

Группа: T2I#

Используйте этот путь, когда хотите создать новое изображение из подсказок. Ваш кодировщик подсказок загружается с помощью CLIPLoader (#164) и считывается CLIP Text Encode (Positive Prompt) (#168) и CLIP Text Encode (Negative Prompt) (#163). UNet загружается с помощью UNETLoader (#165), при необходимости патчится ModelSamplingAuraFlow (#166) для настройки поведения выборки модели, а затем выбирается с помощью KSampler (#167), начиная с EmptySD3LatentImage (#162). Декодированное изображение выходит из VAEDecode (#158) и сохраняется в качестве базовой линии через SaveImage (#159) перед входом в Suite обхода изображений. Для этой ветви вашими основными входными данными являются положительные/отрицательные подсказки и, при желании, стратегия начального значения в KSampler (#167).

Группа: I2I#

Выберите этот путь, когда у вас уже есть изображение для обработки. Загрузите его через LoadImage (#157) и направьте выход IMAGE на вход Suite обхода изображений на NovaNodes (#146). Это полностью обходит текстовое кондиционирование и выборку. Это идеально подходит для пакетной постобработки, экспериментов на существующих наборах данных или стандартизации выходных данных из других рабочих процессов. Вы можете свободно переключаться между T2I и I2I в зависимости от того, хотите ли вы генерировать или строго преобразовывать.

Группа: Suite обхода изображений#

Это сердце графа. Центральный процессор NovaNodes (#146) принимает входящее изображение и два блока опций: CameraOptionsNode (#145) и NSOptionsNode (#144). Узел может работать в оптимизированном автоматическом режиме или в ручном режиме, который открывает управление формированием частот (сглаживание/сопоставление FFT), пиксельными и фазовыми возмущениями, локальным контрастом и тоном, опциональными 3D LUTs и настройкой статистики текстуры. Два опциональных входа позволяют вам подключить эталон авто-балансировки белого и эталонное изображение FFT/текстуры для направления нормализации. Окончательный результат обхода изображений записывается с помощью SaveImage (#147), предоставляя вам как базовую линию, так и обработанный выход для оценки бок о бок.

Ключевые узлы в рабочем процессе обхода изображений Comfyui#

NovaNodes (#146)#

Основной процессор обхода изображений. Он организует формирование в частотной области, пространственные возмущения, локальное управление тоном, применение LUT и опциональную нормализацию текстуры. Если вы предоставите awb_ref_image или fft_ref_image, он использует эти эталоны на раннем этапе конвейера для направления цветового и спектрального сопоставления. Начните в автоматическом режиме, чтобы получить разумную базовую линию, затем переключитесь на ручной режим, чтобы точно настроить силу эффекта и смешивание для вашего контента и последующих задач. Для последовательных сравнений установите и используйте одно и то же начальное значение; для исследования рандомизируйте, чтобы разнообразить микро-вариации.

NSOptionsNode (#144)#

Контролирует несемантический оптимизатор, который корректирует пиксели, сохраняя перцептуальное сходство. Он открывает количество итераций, скорость обучения и веса перцептуализации/регуляризации (LPIPS и L2) вместе с обрезкой градиентов. Используйте его, когда вам нужны тонкие сдвиги распределения с минимальными видимыми артефактами; сохраняйте изменения консервативными, чтобы поддерживать естественные текстуры и края. Отключите его полностью, чтобы измерить, насколько помогает конвейер обхода изображений без оптимизатора.

CameraOptionsNode (#145)#

Симулирует характеристики сенсора и объектива, такие как демозаика и циклы JPEG, виньетирование, хроматическая аберрация, размытие в движении, полосатость и шум считывания. Рассматривайте это как слой реализма, который может добавить правдоподобные артефакты приобретения к вашим изображениям. Включайте только те компоненты, которые соответствуют вашим целевым условиям захвата; наложение слишком большого количества может чрезмерно ограничить внешний вид. Для воспроизводимых выходов сохраняйте те же параметры камеры, изменяя другие параметры.

ModelSamplingAuraFlow (#166)#

Патчит поведение выборки загруженной модели до того, как она достигнет KSampler (#167). Это полезно, когда ваша выбранная основа выигрывает от альтернативной траектории шага. Настройте его, когда заметите несоответствие между намерением подсказки и структурой выборки, и рассматривайте его в тандеме с вашими выборщиками и выбором планировщика.

KSampler (#167)#

Выполняет диффузионную выборку, учитывая модель, положительное и отрицательное кондиционирование и начальную латентность. Ключевые рычаги - стратегия начального значения, шаги, тип выборщика и общая сила уменьшения шума. Меньшее количество шагов помогает скорости, в то время как большее количество шагов может стабилизировать структуру, если ваша базовая модель требует этого. Сохраняйте поведение этого узла стабильным при итерациях настроек обхода изображений, чтобы вы могли приписывать изменения постобработке, а не генератору.

Опциональные дополнения#

- Свободно заменяйте модели. Suite обхода изображений не зависит от модели; вы можете заменить

z_image_turbo_bf16и все равно направлять результаты через тот же стек обработки. - Используйте эталоны вдумчиво. Предоставьте

awb_ref_imageиfft_ref_image, которые имеют общие характеристики освещения и содержания с вашей целевой областью; несоответствующие эталоны могут снизить реализм. - Сравнивайте справедливо. Сохраняйте

SaveImage(#159) в качестве базовой линии иSaveImage(#147) в качестве выхода обхода изображений, чтобы вы могли тестировать настройки A/B и отслеживать улучшения. - Пакетируйте с осторожностью. Увеличивайте размер пакета

EmptySD3LatentImage(#162) только по мере возможности VRAM и предпочитайте фиксированные начальные значения при измерении небольших изменений параметров. - Изучите утилиту. Для деталей функций и текущих обновлений компонентов обхода изображений смотрите основной проект: PurinNyova/Image-Detection-Bypass-Utility.

Кредиты#

- ComfyUI, графический движок, используемый этим рабочим процессом: comfyanonymous/ComfyUI.

- Пример базовой контрольной точки: Comfy-Org/z_image_turbo.

Благодарности#

Этот рабочий процесс реализует и основывается на следующих работах и ресурсах. Мы выражаем благодарность PurinNyova за Image-Detection-Bypass-Utility за их вклад и поддержку. Для авторитетных деталей, пожалуйста, обратитесь к оригинальной документации и репозиториям, указанным ниже.

Ресурсы#

- PurinNyova/Image-Detection-Bypass-Utility

- GitHub: PurinNyova/Image-Detection-Bypass-Utility

- Документация / Примечания к выпуску: Репозиторий (tree/main)

Примечание: Использование упомянутых моделей, наборов данных и кода подчиняется соответствующим лицензиям и условиям, предоставленным их авторами и поддерживающими.