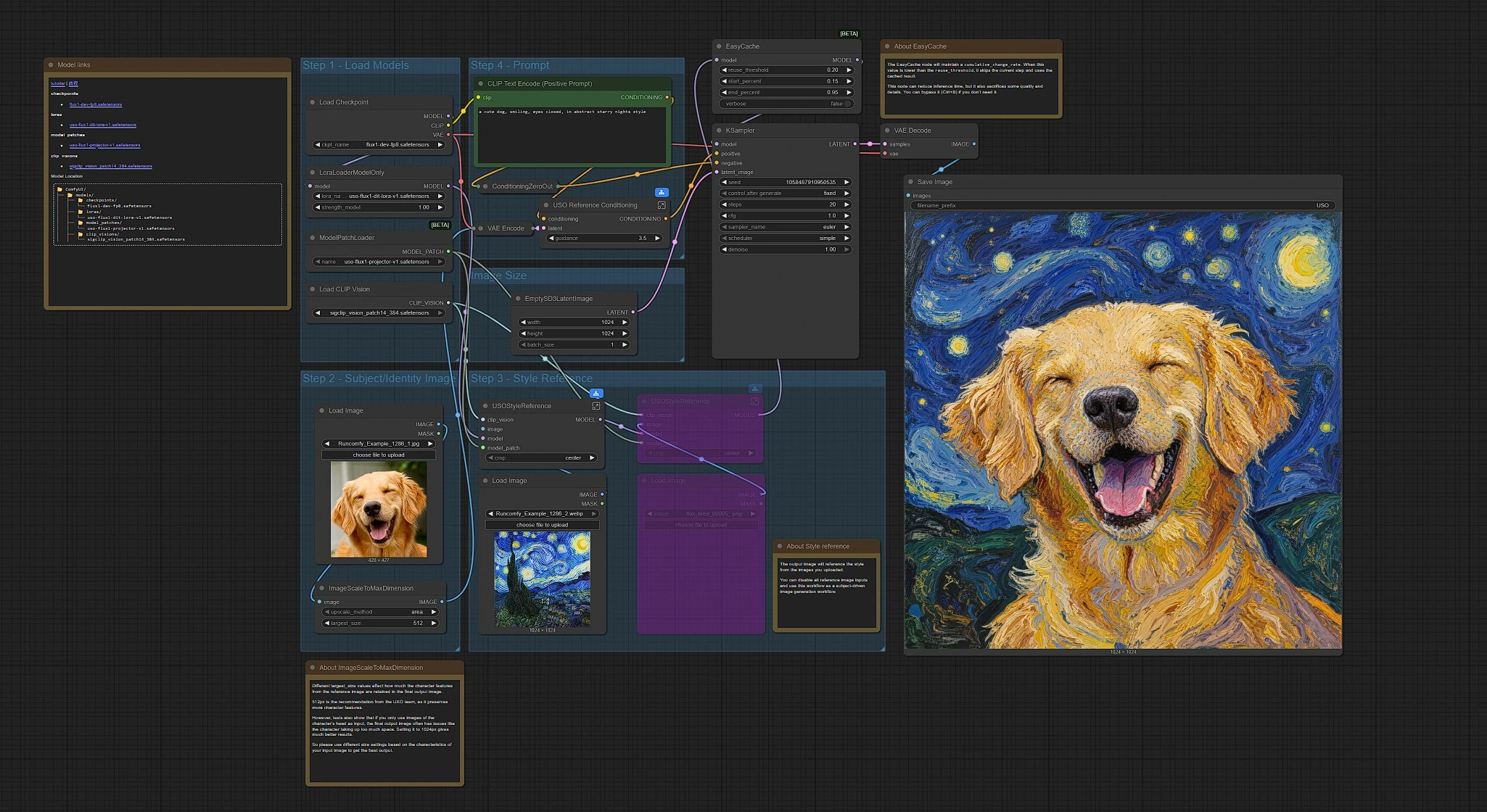

ByteDance USO: Fluxo de Trabalho de Geração Unificada de Estilo e Assunto para ComfyUI#

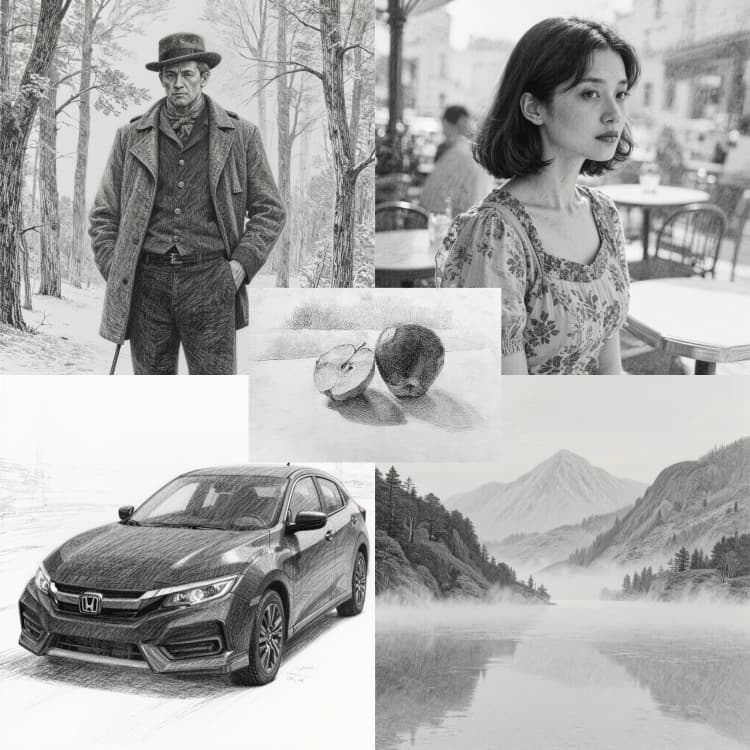

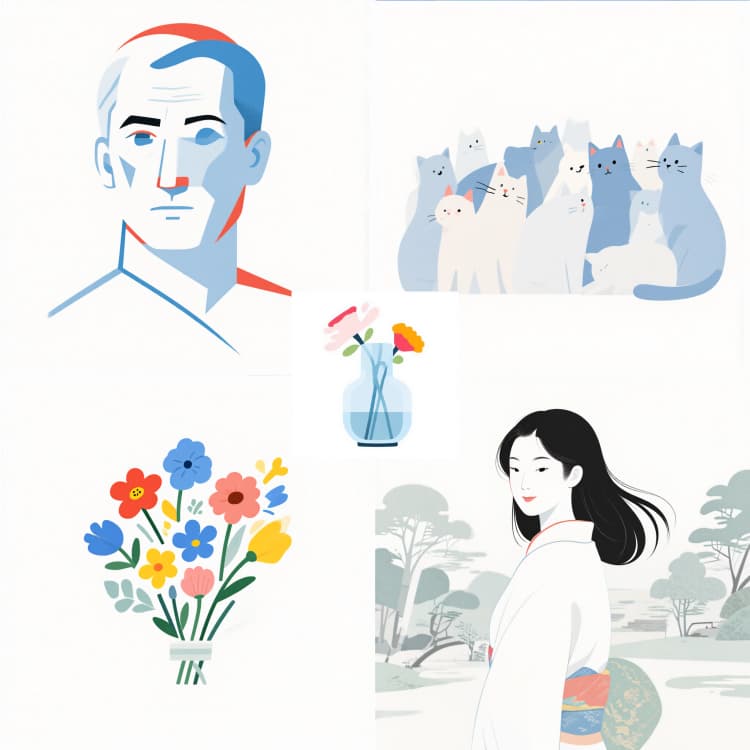

Este fluxo de trabalho traz o ByteDance USO para o ComfyUI para criadores que desejam personagens fiéis à identidade e transferência de estilo precisa em um só lugar. Construído sobre o FLUX.1‑dev, ele suporta geração baseada em assunto, baseada em estilo e combinada, para que você possa colocar um personagem em novas cenas mantendo a semelhança, aplicar estilos de imagens de referência ou fazer ambos ao mesmo tempo.

Use ByteDance USO quando precisar de forte coerência de assunto com controle de estilo flexível e de alta qualidade. O gráfico inclui dois ramos complementares: um caminho de assunto+estilo que condiciona em uma imagem de identidade, e um caminho orientado por prompt que pode ser usado com ou sem referências de estilo. Ambos os caminhos salvam imagens de forma independente para que você possa comparar resultados rapidamente.

Modelos principais no fluxo de trabalho ByteDance USO do ComfyUI#

- FLUX.1‑dev. O transformador de difusão base que alimenta a qualidade e velocidade da geração. Ele fornece a base de amostragem usada pelo ByteDance USO neste fluxo de trabalho. Model card

- ByteDance USO DiT LoRA v1. Um adaptador de baixa classificação que injeta capacidades de Estilo e Assunto Unificados no FLUX.1‑dev, permitindo a preservação de identidade e orientação de estilo em uma configuração unificada. Os arquivos são fornecidos no repack USO 1.0. Repository

- USO FLUX.1 Projector v1. Um patch de projetor que conecta os recursos CLIP‑Vision à base de geração para que as dicas de estilo e assunto possam direcionar o modelo de forma eficaz. Incluído no repack USO. Repository

- SigCLIP Vision (patch14, 384). O codificador de visão que extrai embeddings de suas imagens de referência de estilo e assunto, usado pelos módulos USO para orientação visual. Repository

Como usar o fluxo de trabalho ByteDance USO do ComfyUI#

O gráfico tem dois ramos que podem ser executados de forma independente. O ramo superior usa uma imagem de identidade mais referências de estilo; o ramo inferior é orientado por prompt e pode incluir referências de estilo opcionalmente. Gere a partir de qualquer ramo ou ambos.

Passo 1 – Carregar Modelos#

Este passo inicializa o FLUX.1‑dev, o ByteDance USO LoRA, o projetor USO e o codificador de visão SigCLIP. Ele prepara o modelo base para orientação unificada de estilo e assunto. Ambos os ramos carregam o mesmo conjunto para que você possa executar fluxos de trabalho de assunto+estilo ou prompt sem reconfigurar modelos. Uma vez carregado, o fluxo de modelo está pronto para os processadores de referência do USO.

Passo 2 – Imagem de Assunto/Identidade#

Forneça uma imagem de identidade limpa do seu personagem. O fluxo de trabalho a dimensiona para um tamanho de trabalho adequado e a codifica em um latente que preserva características faciais ou de personagem chave. Este latente é fundido com seu prompt para que o ByteDance USO possa colocar o assunto em novas cenas enquanto mantém a identidade. Omitir este passo se você quiser geração apenas de estilo ou apenas de texto.

Passo 3 – Referência de Estilo#

Adicione uma ou duas imagens de estilo para guiar paleta, materiais e pinceladas. Cada imagem é codificada com o modelo de visão e aplicada através dos nós de referência de estilo do USO, que sobrepõem influências de estilo no modelo carregado. A ordem importa ao usar duas referências, pois a segunda referência é aplicada após a primeira. Você pode ignorar este grupo para executar uma passagem puramente orientada por assunto ou apenas por texto.

Prompt#

Escreva um prompt orientado por intenção para composição, humor e detalhes. No ramo assunto+estilo, seu prompt é combinado com o latente de identidade e a orientação do USO para que texto, assunto e estilo puxem na mesma direção. No ramo orientado por prompt, o texto sozinho (opcionalmente com referências de estilo) direciona a imagem. Mantenha os prompts específicos; evite contradizer o estilo escolhido.

Tamanho da Imagem#

Escolha a resolução alvo para geração. O tamanho escolhido influencia a rigidez da composição e a densidade de detalhes, especialmente para retratos vs imagens de corpo inteiro. Se o VRAM for limitado, comece menor e aumente depois. Ambos os ramos expõem um nó de tamanho de imagem simples para que você possa ajustar aspecto e fidelidade ao seu caso de uso.

Amostragem e Saída#

Cada ramo amostra com um sampler padrão, decodifica para RGB e salva em sua própria saída. Você normalmente obterá duas imagens por execução: um resultado de assunto estilizado e um resultado orientado por prompt. Itere ajustando o prompt ou trocando referências; reamostre para explorar alternativas ou fixe a semente para repetibilidade.

Nós principais no fluxo de trabalho ByteDance USO do ComfyUI#

USOStyleReference (#56)#

Aplica uma imagem de estilo ao fluxo de modelo atual usando o projetor USO e recursos CLIP‑Vision. Use uma referência para um visual forte e coerente ou encadeie duas para misturas sutis; a segunda referência refina a primeira. Se o estilo dominar muito, experimente uma única referência mais limpa ou simplifique seu conteúdo.

ReferenceLatent (#44)#

Injeta o latente de assunto codificado no caminho de condicionamento para que o ByteDance USO preserve a identidade. Funciona melhor com fotos de identidade desobstruídas que mostram claramente o rosto ou características definidoras do personagem. Se a identidade escorregar, forneça uma referência mais completa ou reduza dicas de estilo conflitantes.

FluxKontextMultiReferenceLatentMethod (#41)#

Combina múltiplos sinais de referência dentro do caminho de contexto FLUX. É aqui que o contexto de assunto e prompt são equilibrados antes da amostragem. Se os resultados parecerem excessivamente restritos, relaxe as referências; se eles se desviarem, fortaleça a imagem do assunto ou simplifique o prompt.

FluxGuidance (#35)#

Controla a força da orientação do texto em relação aos sinais de referência. Valores mais baixos permitem que o assunto/estilo lidere; valores mais altos reforçam o prompt mais fortemente. Ajuste quando você vê o prompt subajustando (aumente a orientação) ou o estilo/assunto sendo substituído (diminua a orientação).

ImageScaleToMaxDimension (#109)#

Prepara a imagem de identidade para extração estável de recursos. Tamanhos máximos menores favorecem uma composição mais ampla; tamanhos maiores ajudam quando a referência é um retrato fechado e você precisa de dicas de identidade mais nítidas. Ajuste com base em se sua referência de assunto é de corpo inteiro ou uma foto de rosto.

EasyCache (#95)#

Acelera a inferência reutilizando estados intermediários quando as mudanças são menores. Ótimo para ajustes de prompt e iteração rápida, mas pode reduzir ligeiramente os microdetalhes. Desative para renderizações finais de mais alta qualidade.

KSampler (#31)#

Executa as etapas de difusão e controla a estocasticidade via escolha de semente e sampler. Aumente as etapas para mais detalhes ou bloqueie a semente para reproduzir um visual enquanto altera referências. Se as texturas parecerem ruidosas, experimente um sampler diferente ou menos etapas com orientação de estilo mais forte.

Extras opcionais#

- Para trabalho de identidade ByteDance USO, prefira imagens de assunto neutras e bem iluminadas; evite maquiagem pesada ou ângulos extremos que possam conflitar com dicas de estilo.

- Ao empilhar duas referências de estilo, coloque primeiro a estética mais ampla e a referência de textura/detalhe em segundo para refinar sem sobrecarregar a identidade.

- Mantenha o prompting negativo mínimo; o gráfico usa intencionalmente um caminho negativo neutro para que os priors aprendidos do USO e as referências se alinhem de maneira limpa.

- Itere rapidamente em resolução mais baixa ou com cache ativado, depois desative o cache e amplie suas sementes favoritas para os finais.

- Use sementes reprodutíveis ao comparar modos de apenas assunto, apenas estilo e combinados para entender como o ByteDance USO equilibra cada sinal.

Reconhecimentos#

Este fluxo de trabalho implementa e se baseia nos seguintes trabalhos e recursos. Agradecemos imensamente à ByteDance pelo modelo USO e à equipe ComfyUI pelo tutorial de Fluxo de Trabalho Nativo ByteDance USO ComfyUI por suas contribuições e manutenção. Para detalhes autoritativos, consulte a documentação original e os repositórios vinculados abaixo.

Recursos#

- ByteDance/USO

- GitHub: bytedance/USO

- Hugging Face: bytedance-research/USO

- arXiv: 2508.18966

- Docs / Release Notes: ByteDance USO Documentation

Nota: O uso dos modelos, conjuntos de dados e código referenciados está sujeito às respectivas licenças e termos fornecidos por seus autores e mantenedores.