ComfyUI MultiTalk: マルチパーソンおよびシングルパーソン トーキングビデオ#

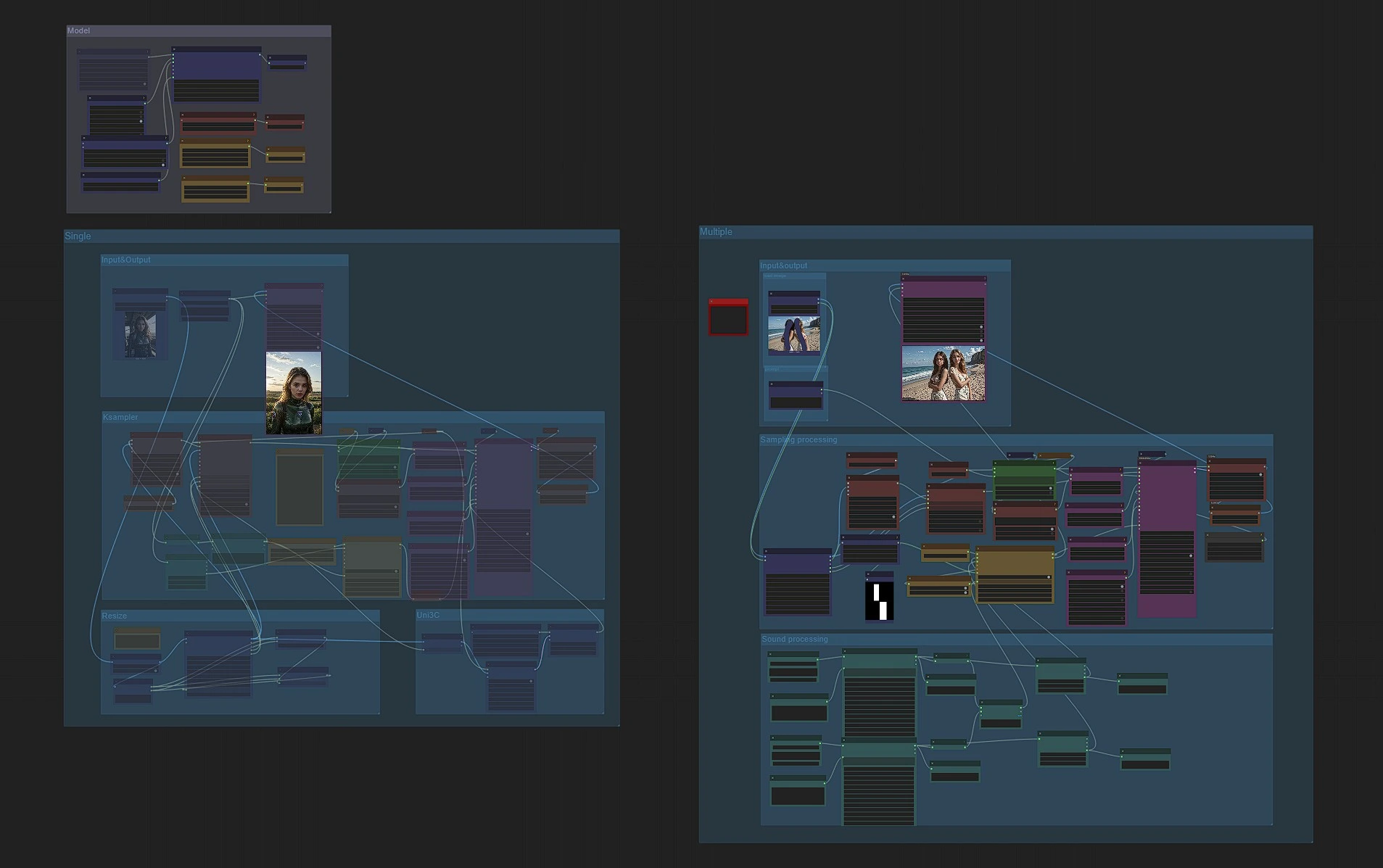

注意: これは、ComfyUI MultiTalk Single Person ワークフローのアップグレードされたマルチパーソンバージョンです。 今では、マルチパーソン会話ビデオ生成をサポートし、以前のバージョンのシングルパーソンモードも含まれています。

このワークフローは、ソーシャルコンテンツ、商品説明、キャラクター対話、迅速なプレビズに最適です。MultiTalkオーディオ埋め込みをビデオ拡散と組み合わせることで、唇、顎、微妙な顔の合図がスピーチに従います。Meigen MultiTalk マルチスピーカーシーンやスリムなシングルスピーカークリップのためのドロップインパスとして使用してください。

ComfyUI MultiTalk ワークフローの主要モデル#

Wan 2.1 ビデオ拡散モデル

シーンの外観、カメラ、動きを処理し、会話のダイナミクスのための追加のガイダンスを受け入れながら、テキストおよび画像条件付きのビデオ生成を駆動します。

Wav2Vec 2.0

MultiTalkがトーキング固有の埋め込みに変換する堅牢なスピーチ表現を抽出します。参照: facebook/wav2vec2-base-960h。

MultiTalk (MeiGen-AI)

オーディオ駆動のマルチパーソン会話ビデオのための研究方法。参照実装: MeiGen-AI/MultiTalk。

ComfyUI Wan ビデオラッパー

Wan 2.1のロード、エンコーダー、ビデオサンプラー、およびMultiTalk埋め込みノードを公開するComfyUI統合。参照: kijai/ComfyUI-WanVideoWrapper。

Index-TTS (オプション)

ワークフロー内でクリーンなダイアログトラックを生成するための音声参照付きのテキストからスピーチへの変換。参照: chenpipi0807/ComfyUI-Index-TTS。

ComfyUI MultiTalk ワークフローの使用方法#

このワークフローはエンドツーエンドで実行されます: スピーカーとオーディオを準備し、短いシーンプロンプトを設定し、レンダリングします。マルチパーソンとシングルパーソンの両方のセットアップをサポートします。グラフ内のグループは物事を整理された状態に保ち、最も重要なものは以下に説明されています。

入力と出力#

スピーカーの顔のためのアイデンティティ画像とプレビューマスクをロードし、最終フレームをオーディオとマルチプレックスします。LoadImageノードはポートレートを受け入れ、VHS_VideoCombineはレンダリングされたフレームを選択されたオーディオトラックと組み合わせてMP4にします。セットアップ中にPreviewAudioでオーディオをスクラブしてレベルと持続時間を確認できます。

モデル#

Get_WanModel、Get_WanTextEncoder、およびWanVideoModelLoaderは、テキストおよびVAEコンポーネントとともにWan 2.1を初期化します。これはエンジンルームと考えてください: ロードされると、ビデオサンプラーは画像、テキスト、および会話の埋め込みを受け入れることができます。ここで変更が必要なのは、正しいWanウェイトが選択されていることを確認することだけです。

スピーカーオーディオ (2つの方法)#

独自のダイアログトラックを持ち込むか、合成できます:

- オーディオを持ち込む:

LoadAudioを使用して各スピーカーのラインをインポートします。クリップが音楽やノイズと混ざっている場合、AudioSeparationを通過させ、クリーンなVocals出力を前方にルートします。 - オーディオを生成する:

Speaker 1 - TextおよびSpeaker 2 - Textを使用してIndexTTSNodeでタイプされたラインから声を合成し、望ましい音色のためにreference_audioをオプションで提供します。

MultiTalk オーディオ埋め込み#

MultiTalkWav2VecEmbedsはスピーチをMultiTalk埋め込みに変換し、各スピーカーのタイミングと発声の合図をキャプチャします。シングルパーソンの場合は1つのオーディオストリームを、マルチパーソンの対話の場合は2つのストリームを供給します。シーンが顔固有のターゲティングを必要とする場合、クリーンな顔のマスクをref_target_masksとして提供し、各声が正しい人物を駆動するようにします。

プロンプトとテキストコンテキスト#

PromptとWanVideoTextEncodeSingleを介して短いシーンプロンプトが視覚的なムードと環境を設定します。プロンプトは簡潔で記述的に保ちます(場所、トーン、照明)。テキストエンコーダーは、Wanがアイデンティティと会話の信号とともに使用する意味的ガイダンスを生成します。

Uni3C とリサイズ#

Uni3Cグループは、アイデンティティ、フレーミング、および構図を安定させるためのグローバルコンテキスト埋め込みを準備します。Resizeグループは、ソース画像とマスクがモデルに適したサイズにスケーリングされることを保証し、サンプラーが一貫した入力を受け取るようにします。

KSampler とサンプリング処理#

WanVideoSamplerはすべてが出会う場所です: アイデンティティ画像埋め込み、テキスト埋め込み、およびMultiTalkオーディオ埋め込みが組み合わさって最終フレームを生成します。下流のサンプリング処理グループは、ビデオコンバイナーに渡す前に滑らかさと一貫性のために必要な後処理ステップを適用します。

マルチパーソンのためのマスク#

マルチパーソンクリップの場合、ComfyUIのマスクエディタで顔ごとに1つのマスクを描画します。マスクが触れ合わないように分けておきます。1つのマスクと1つのオーディオトラックだけを提供した場合、ワークフローは自動的にシングルパーソンMultiTalkセットアップとして動作します。

ComfyUI MultiTalk ワークフローの主要ノード#

MultiTalkWav2VecEmbeds (#79/#162)#

1つ以上のダイアログトラックをMultiTalk会話埋め込みに変換します。シングルパーソンの場合は1つのオーディオ入力、マルチパーソンの場合は2つのオーディオ入力で開始します。顔ごとのルーティングが必要な場合はマスクを追加します。重要なことだけを調整します: 計画したクリップの長さに合わせたフレーム数、および正確なスピーカーから顔の整列のためにref_target_masksを提供するかどうか。

AudioSeparation (#88/#160/#161)#

ノイズの多い入力のためのオプションのクリーンアップ。このノードにノイズの多いクリップをルートしてVocals出力を前方に渡します。フィールド録音にバックグラウンドミュージックやおしゃべりが含まれている場合に使用し、すでにクリーンなボイストラックがある場合はスキップします。

IndexTTSNode (#163/#164)#

Speaker 1 - TextとSpeaker 2 - Textをダイアログオーディオに変換します。トーンとペースのクローンを作成するために短いreference_audioを提供し、次にテキストラインを供給します。MultiTalkでの最適なリップタイミングのために、文章を短く自然に保ちます。

WanVideoTextEncodeSingle (#18)#

Wan 2.1のためにシーンプロンプトをエンコードします。場所、照明、スタイルの簡潔で具体的な説明を好みます。長いリストを避けます; サンプラーが理解するのに1、2文で十分です。

謝辞#

オリジナルリサーチ: MultiTalkは、MeiGen-AIによって開発され、分野の主要な研究者との協力で行われました。オリジナルの論文 "Let Them Talk: Audio-Driven Multi-Person Conversational Video Generation" は、この技術の画期的な研究を紹介しています。 ComfyUI統合: ComfyUIによる実装は、KijaiによってComfyUI-WanVideoWrapperリポジトリを通じて提供され、この先進技術をより広いクリエイティブコミュニティに利用可能にしています。

基盤技術: Wan2.1ビデオ拡散モデルに基づき、Wav2Vecからのオーディオ処理技術を組み込み、最先端のAI研究の合成を表しています。

リンクとリソース#

- オリジナルリサーチ: MeiGen-AI MultiTalk Repository

- プロジェクトページ: https://meigen-ai.github.io/multi-talk/

- ComfyUI統合: ComfyUI-WanVideoWrapper