Qwen Edit 2509 LoRA Inference: modifiche di Qwen Image Edit Plus 2509 corrispondenti all'addestramento in ComfyUI#

Qwen Edit 2509 LoRA Inference è un workflow di RunComfy pronto alla produzione che ti consente di applicare una LoRA addestrata con AI Toolkit su Qwen Image Edit Plus 2509 in ComfyUI con risultati corrispondenti all'addestramento. È costruito attorno a RC Qwen Image Edit Plus (RCQwenImageEditPlus)—un nodo personalizzato open-source costruito da RunComfy (source) che esegue un pipeline di editing di Qwen specifico del modello (non un grafo di campionamento generico), inietta il tuo adattatore tramite lora_path / lora_scale, e mantiene il preprocessing dell'immagine di controllo richiesto allineato con il modo in cui il modello di editing codifica i prompt.

Perché Qwen Edit 2509 LoRA Inference appare spesso diverso in ComfyUI#

Le immagini di esempio di AI Toolkit sono prodotte da un pipeline in stile Qwen Image Edit Plus 2509 che accoppia il prompt di testo con l'immagine di input durante la codifica del prompt, quindi applica la guida utilizzando il comportamento "true CFG" di Qwen. Se ricrei il lavoro come un grafo di editing standard di ComfyUI, piccole differenze nel condizionamento, nella semantica della guida e dove viene applicata la LoRA possono accumularsi, quindi corrispondere a prompt/passaggi/seme ancora non riprodurrà in modo affidabile l'anteprima. In altre parole, la differenza è di solito un disallineamento del pipeline, non un "impostazione errata".

Cosa fa il nodo personalizzato RCQwenImageEditPlus#

RCQwenImageEditPlus instrada l'editing di Qwen Image Edit Plus 2509 attraverso lo stesso tipo di pipeline di inferenza allineato all'anteprima e applica la tua LoRA di AI Toolkit in modo coerente all'interno di quel pipeline utilizzando lora_path e lora_scale. Gestisce anche l'immagine di controllo nel modo in cui questa famiglia si aspetta per il prompting condizionato all'edit (incluso il ridimensionamento per la codifica del prompt), quindi il comportamento di base è più vicino a quello che hai visto durante i campioni di addestramento. Implementazione del pipeline di riferimento: `src/pipelines/qwen_image.py`.

Come usare il workflow Qwen Edit 2509 LoRA Inference#

Passo 1: Importa la tua LoRA (2 opzioni)#

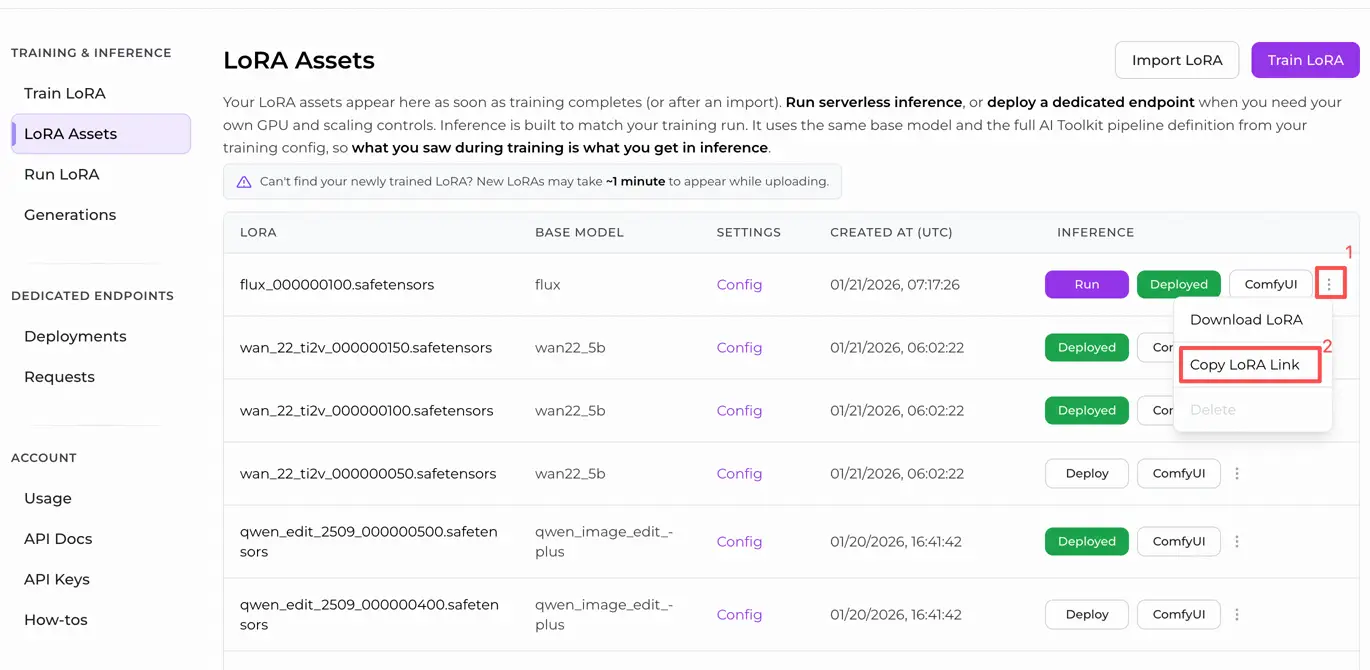

- Opzione A (Risultato di addestramento RunComfy): RunComfy → Trainer → LoRA Assets → trova la tua LoRA → ⋮ → Copia Link LoRA

- Opzione B (LoRA di AI Toolkit addestrata al di fuori di RunComfy): Copia un link di download diretto

.safetensorsper la tua LoRA e incolla quell'URL inlora_path(non è necessario scaricare inComfyUI/models/loras)

Passo 2: Configura il nodo personalizzato RCQwenImageEditPlus per Qwen Edit 2509 LoRA Inference#

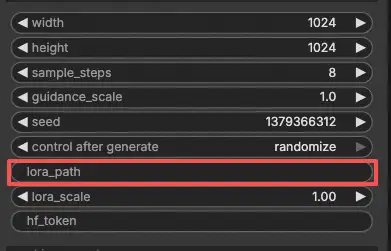

Incolla il tuo link LoRA in lora_path su RCQwenImageEditPlus (usa il link RunComfy dall'Opzione A, o un URL diretto .safetensors dall'Opzione B).

Quindi imposta il resto dei parametri del nodo (inizia rispecchiando i valori di anteprima/campione del tuo AI Toolkit mentre convalidi l'allineamento):

prompt: la tua istruzione di modifica (includi gli stessi token di attivazione con cui hai addestrato, se presenti)negative_prompt: opzionale; lascialo vuoto se non hai usato negativi nei tuoi campioni di addestramentowidth/height: dimensione dell'output (multipli di 32 sono raccomandati per questa famiglia di pipeline)sample_steps: numero di passaggi di inferenza; corrispondi al conteggio dei passaggi dell'anteprima prima di regolareguidance_scale: forza della guida (Qwen usa una scala "true CFG", quindi riutilizza il tuo valore di anteprima per primo)seed: blocca il seme mentre confronti l'anteprima di addestramento rispetto all'inferenza di ComfyUI impostando ilcontrol_after_generatesu 'fixed'lora_scale: forza della LoRA; inizia alla tua forza di anteprima, quindi regola gradualmente

Questo è un workflow di modifica delle immagini, quindi devi anche fornire un'immagine di input:

control_image(input richiesto): collega un nodo LoadImage acontrol_image, quindi sostituisci l'immagine di esempio con la foto che vuoi modificare.

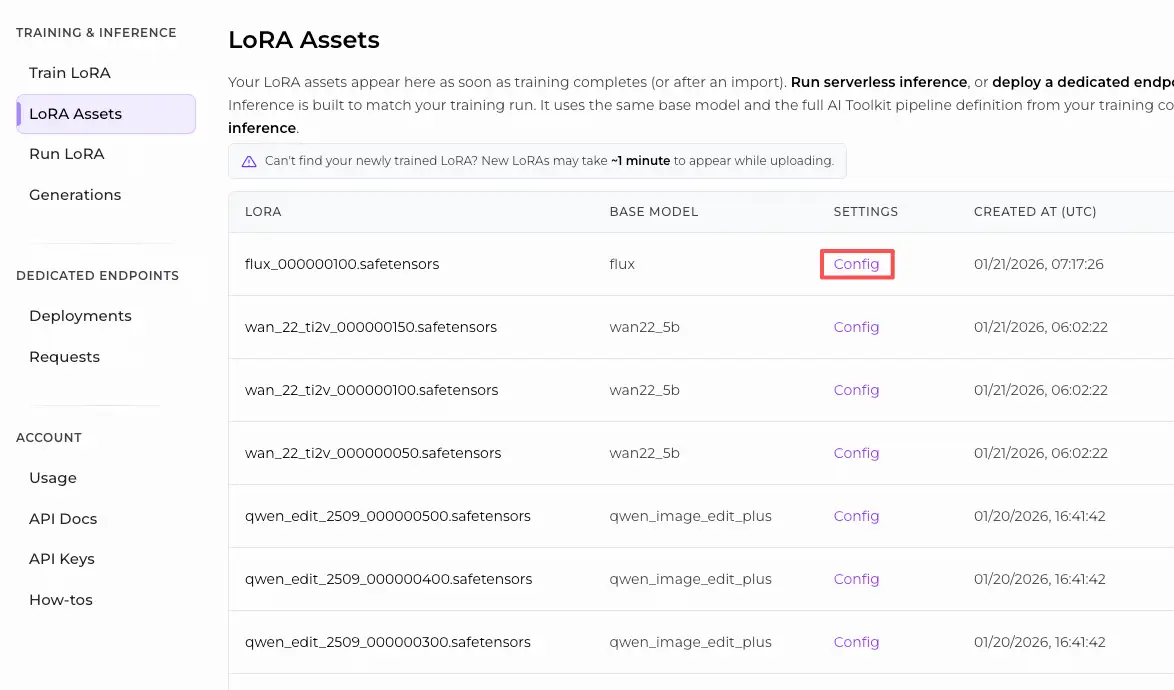

Nota sull'allineamento dell'addestramento: se hai personalizzato il campionamento durante l'addestramento, apri il tuo YAML di addestramento di AI Toolkit e rispecchia width, height, sample_steps, guidance_scale, seed e lora_scale. Se hai addestrato su RunComfy, vai a Trainer → LoRA Assets → Config e copia i valori di anteprima/campione in RCQwenImageEditPlus.

Passo 3: Esegui Qwen Edit 2509 LoRA Inference#

Metti in coda/Esegui il workflow. Il nodo SaveImage scrive l'output modificato nella tua normale cartella di output di ComfyUI.

Risoluzione dei problemi di Qwen Edit 2509 LoRA Inference#

La maggior parte dei problemi che le persone incontrano dopo aver addestrato un Qwen Image Edit Plus 2509 LoRA in AI Toolkit e poi cercando di eseguirlo in ComfyUI derivano da disallineamento del pipeline / caricatore—specialmente quando si mescolano caricatori Nunchaku-quantized Qwen Edit 2509, grafi di campionamento generici, e caricatori LoRA che patchano i pesi in un luogo diverso rispetto al pipeline di anteprima di AI Toolkit.

Il nodo personalizzato RC Qwen Image Edit Plus (RCQwenImageEditPlus) di RunComfy è progettato per riportarti a una base corrispondente all'addestramento eseguendo un pipeline di editing specifico per Qwen Image Edit Plus 2509 (non un grafo di campionamento generico), e iniettando la tua LoRA di AI Toolkit all'interno di quel pipeline tramite lora_path / lora_scale, così il comportamento di condizionamento + guida dell'edit è più vicino a quello che hai visto durante il campionamento di anteprima di AI Toolkit.

(1)Comfy genera rumore dopo aver annullato la generazione di Qwen Image Edit Nunchaku#

Perché succede

Questa è una modalità di fallimento reale riportata specificamente intorno a Qwen Image Edit in un workflow di ComfyUI basato su Nunchaku: annullare un'esecuzione può lasciare il modello/grafo in uno stato cattivo, e le esecuzioni successive producono solo rumore anche con prompt e impostazioni validi.

Come risolvere (soluzioni funzionanti riportate dagli utenti)

- Recupero usando il “Clear Models and Node Cache” di ComfyUI (o equivalente reset della cache modello/nodo) e poi eseguendo di nuovo.

- revertendo ComfyUI a 0.3.65 ha aiutato se la regressione persisteva.

- Se il tuo obiettivo è la validazione della LoRA corrispondente all'addestramento (parità di anteprima), esegui lo stesso edit attraverso RCQwenImageEditPlus prima. Questo mantiene l'inferenza pipeline-aligned con il campionamento in stile anteprima di AI Toolkit ed evita il debugging degli effetti collaterali di "rumore dopo l'annullamento" in un percorso di campionamento generico / Nunchaku.

(2)qwen image edit non supporta il caricamento di Lora#

Perché succede

Questo è stato riportato come una limitazione del percorso ComfyUI-nunchaku Qwen Image Edit: il caricamento di LoRA fallisce / avvisa perché quel percorso di inferenza non patcha gli stessi moduli contro cui la LoRA è stata addestrata (o semplicemente non supporta l'iniezione di LoRA per Qwen Edit in quella implementazione).

Come risolvere (risoluzione pratica e affidabile)

- In quel percorso Nunchaku, il problema è stato chiuso come non pianificato—quindi la soluzione pratica è cambiare l'inferenza a un pipeline che supporta l'iniezione di Qwen Edit 2509 LoRA.

- In RunComfy, ciò significa utilizzare RCQwenImageEditPlus e caricare l'adattatore solo tramite:

lora_path(il tuo URL.safetensorsdi AI Toolkit)lora_scale(forza) Questo mantiene l'applicazione della LoRA all'interno del pipeline di Qwen Edit 2509, che è esattamente ciò che vuoi per i confronti corrispondenti all'addestramento.

- Se devi rimanere su quantizzazione Nunchaku per velocità, utilizza un caricatore LoRA specifico per Qwen/Nunchaku (non il caricatore base di edit che si aspetta "comportamento generico LoRA").

(3)workflow multi-stage non reimposta la cache#

Perché succede

Nei workflow multi-stage (diverse LoRA per fase), gli utenti hanno riportato che lo stato della LoRA può "rimanere" attraverso le ri-esecuzioni—quindi la fase 1 potrebbe accidentalmente riutilizzare le LoRA della fase 2 a meno che la cache non venga reimpostata.

Come risolvere (soluzione alternativa verificata dagli utenti)

- Gli utenti hanno riportato che il workflow si reimposta correttamente solo quando il modello viene scaricato/purged manualmente tra le ri-esecuzioni.

- Se stai convalidando la corrispondenza dell'anteprima di AI Toolkit, mantieni il tuo workflow di base single-stage ed eseguilo attraverso RCQwenImageEditPlus prima (pipeline-aligned). Aggiungi la logica multi-stage solo dopo che il tuo workflow di base è stabile.

(4)TypeError: ottenuti valori multipli per l'argomento 'guidance' (v2.0+)#

Perché succede

In alcuni ambienti, gli utenti incontrano TypeError: ottenuti valori multipli per l'argomento 'guidance' quando i caricatori LoRA e le stack di scheduler/patch interagiscono con la signature di QwenImageTransformer2DModel forward (può verificarsi duplicazione degli argomenti a seconda dell'ordine delle patch e delle modifiche dello scheduler esterne).

Come risolvere (soluzione documentata dal manutentore per gli utenti colpiti)

- La sezione di risoluzione dei problemi del caricatore raccomanda: se continui a incontrare questo su v2.0+ anche dopo gli aggiornamenti, usa la v1.72 (l'ultima release v1.x prima che il supporto diffsynth ControlNet fosse aggiunto), perché evita la complessità del passaggio degli argomenti che attiva la duplicazione di

guidance. - Dopo aver ripristinato la stabilità, esegui controlli di parità di addestramento in RCQwenImageEditPlus in modo che il tuo debug dell'allineamento dell'anteprima non sia confuso da casi limite di signature del caricatore/scheduler.

(5)Immagini di controllo mancanti per QwenImageEditPlusModel#

Perché succede

Qwen Image Edit Plus 2509 è una famiglia di modelli edit-conditioned. Nell'addestramento di AI Toolkit e nell'inferenza di ComfyUI, il pipeline si aspetta un input di immagine di controllo per accoppiare l'istruzione di modifica con il percorso di codifica condizionato all'immagine. Se le immagini di controllo mancano o sono mal collegate, i lavori di addestramento o l'inferenza di edit falliranno o si comporteranno in modo inatteso.

Come risolvere (approccio corretto per il modello, coerente con l'addestramento)

- In ComfyUI, collega sempre LoadImage →

control_imagesu RCQwenImageEditPlus, e mantieni l'immagine di controllo fissa mentre convalidi la tua LoRA rispetto all'output di anteprima. - Usa RCQwenImageEditPlus per l'inferenza in modo che il preprocessing dell'immagine di controllo + codifica del prompt segua le aspettative del pipeline di Qwen Edit 2509 (pipeline-aligned con le anteprime in stile AI Toolkit), e la tua LoRA venga applicata al corretto punto di patch tramite

lora_path/lora_scale.

Esegui Qwen Edit 2509 LoRA Inference ora#

Apri il workflow, imposta lora_path, collega la tua control_image, ed esegui RCQwenImageEditPlus per riportare i risultati di ComfyUI in linea con le tue anteprime di AI Toolkit.