1. Qu'est-ce que le Workflow ComfyUI Uni3C ?#

Le workflow Uni3C intègre le modèle avancé Uni3C (Unifying Precisely 3D-Enhanced Camera and Human Motion Controls) dans l'environnement ComfyUI. Développé par DAMO Academy (Alibaba Group), Uni3C aborde le défi fondamental de la génération vidéo contrôlable en unifiant le contrôle de trajectoire de caméra et le contrôle de mouvement humain dans un cadre amélioré en 3D.

Construit sur l'architecture de transformateur de diffusion FLUX et alimenté par le modèle fondamental Wan2.1, Uni3C introduit PCDController - un module de contrôle plug-and-play qui utilise des nuages de points non projetés dérivés de l'estimation de profondeur monoculaire. Cette approche permet un contrôle précis de la caméra dans Uni3C tout en maintenant les capacités génératives des modèles de diffusion vidéo à grande échelle. Le système Uni3C utilise des modèles de personnages SMPL-X et des guidages mondiaux 3D pour obtenir une génération vidéo spatialement cohérente à la fois pour les scènes environnementales et les personnages humains.

2. Avantages d'Uni3C :#

- Cadre Unifié 3D-Enhanced : Uni3C traite simultanément les trajectoires de caméra et le mouvement humain dans un espace mondial 3D cohérent.

- Architecture PCDController : Avec le contrôleur léger de 0,95B paramètres, Uni3C exploite des nuages de points non projetés issus de l'estimation de profondeur monoculaire, sans compromettre le modèle de base de 14B paramètres.

- Intégration SMPL-X : Uni3C offre un support avancé des modèles corporels humains 3D.

- Utilisation du Préalable Géométrique : La compréhension géométrique 3D basée sur les nuages de points d'Uni3C fournit un contrôle robuste de la caméra à partir d'images uniques.

- Guidage Mondial 3D : Uni3C assure l'alignement rigide de transformation entre les nuages de points environnementaux et les personnages SMPL-X pour une génération vidéo spatialement cohérente.

3. Comment utiliser le Workflow Uni3C#

Uni3C fonctionne par extraction de référence vidéo, qui analyse les vidéos de référence pour comprendre à la fois les mouvements de caméra et les mouvements humains, puis applique les motifs pour générer de nouvelles vidéos à partir des images d'entrée. Cette approche permet un contrôle précis avec Uni3C sans ajustement manuel des paramètres.

3.1 Méthode 1 : Contrôle de Caméra Référencé Vidéo#

Idéal pour :#

Extraire les mouvements de caméra des vidéos de référence et les appliquer à de nouvelles scènes en utilisant Uni3C.

Processus d'installation :#

- Charger la Vidéo de Référence : Téléchargez une vidéo avec un mouvement de caméra intéressant dans le nœud

Load Video (Upload)- Bons Exemples : Vidéos avec zoom de caméra sur des sujets, séquences de marche avec mouvement naturel de la tête, panoramiques cinématiques, prises orbitales

- Point Clé : Toute vidéo avec un mouvement de caméra clair fonctionne - des enregistrements téléphoniques à la cinématographie professionnelle avec Uni3C.

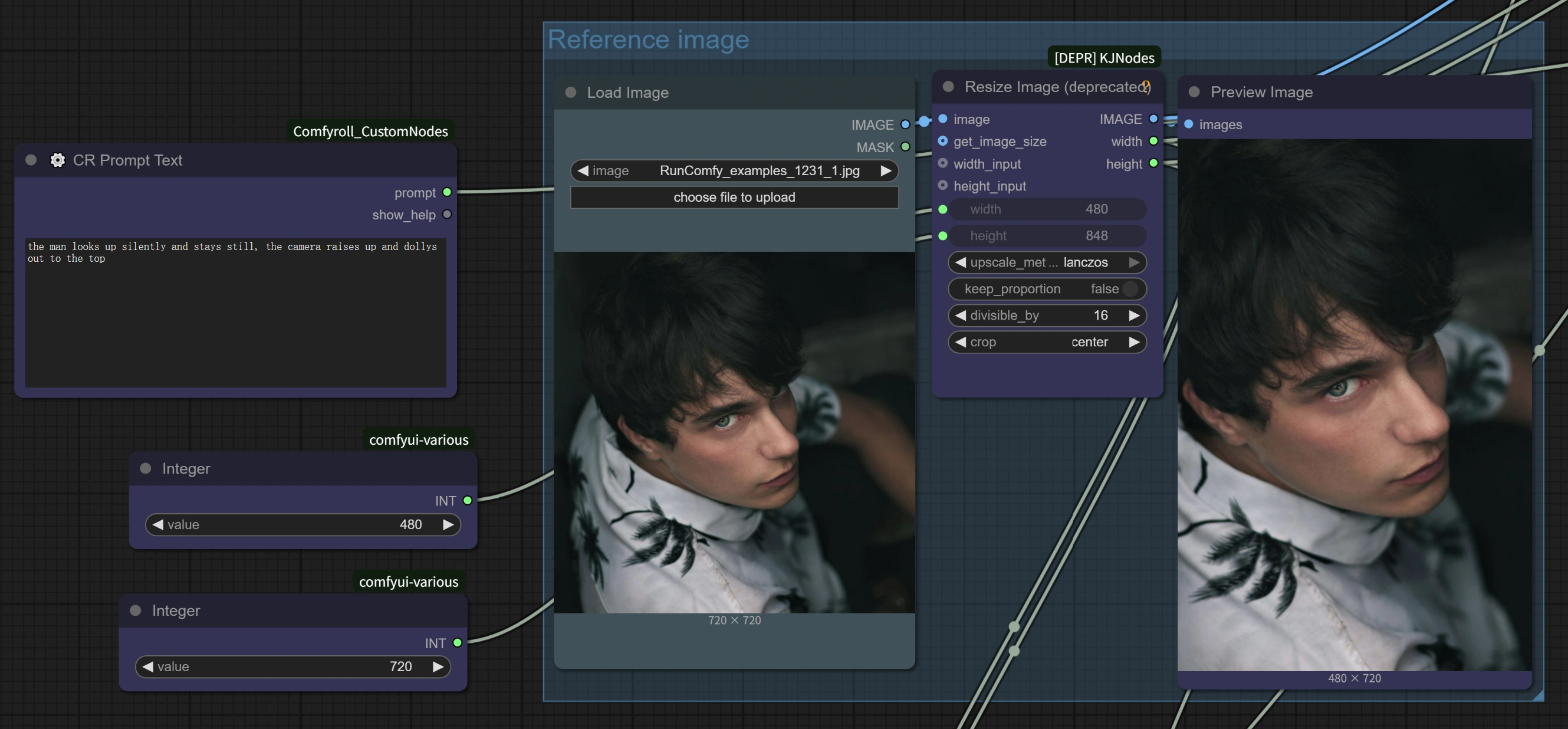

- Charger l'Image Cible : Téléchargez votre image de base dans le nœud

Load Image(fonctionne avec n'importe quel style : réaliste, anime, œuvre d'art, généré par IA) - Rédiger Votre Invite : Décrivez votre scène souhaitée dans la zone de texte pour Uni3C

- Configurer les Paramètres : Le workflow Uni3C inclut des paramètres optimisés pour une amélioration de vitesse x4

- Générer : Exécutez le workflow pour transférer le mouvement de caméra de la vidéo de référence à votre scène avec Uni3C.

Conseils Avancés :#

- Correspondance de la Direction du Mouvement : Les meilleurs résultats sont obtenus lorsque la direction du mouvement de la vidéo de référence s'aligne avec la composition de votre scène prévue pour Uni3C.

- Coordination des Invites : Rédigez des invites qui complètent le style de mouvement de la caméra pour une cohérence améliorée avec Uni3C.

- Qualité de Référence : Choisissez des vidéos de référence avec des mouvements de caméra stables et clairs pour des résultats optimaux avec Uni3C.

3.2 Méthode 2 : Transfert de Mouvement Humain#

Idéal pour :#

Transférer les mouvements humains des vidéos de référence vers différents personnages en utilisant Uni3C.

Processus d'installation :#

- Vidéo de Référence avec Mouvement Humain : Téléchargez une vidéo contenant les mouvements humains que vous souhaitez transférer

- Image du Personnage Cible : Chargez une image du personnage que vous souhaitez animer

- Contrôle du Mouvement via les Invites :

- Préserver le Mouvement Original : Utilisez des descriptions générales comme "une femme marchant" pour maintenir le mouvement de référence avec Uni3C.

- Modifier les Actions : Soyez spécifique pour changer les mouvements : "une femme se coiffant" modifiera les gestes des mains tout en préservant le flux général du mouvement avec Uni3C.

Avantages Clés :#

- Pas de Squelette Requis : Contrairement à la capture de mouvement traditionnelle, Uni3C comprend le mouvement humain sans rigging complexe.

- Préservation des Détails : Uni3C maintient les accessoires, les coiffures, et les détails vestimentaires lors du transfert de mouvement.

- Contrôle Simultané : Les mouvements de caméra et de mouvement humain sont transférés ensemble à partir de la même vidéo de référence en utilisant Uni3C.

Architecture d'Optimisation de Performance : Le workflow Uni3C met en œuvre plusieurs stratégies d'optimisation, y compris une réduction de la taille cachée de 5120 à 1024 dans PCDController, des couches de projection linéaires initialisées à zéro, et l'injection de fonctionnalités de contrôle de la caméra uniquement dans les 20 premières couches du modèle de base. L'optimisation de correspondance de flux avec des étapes d'échantillonnage réduites (10 contre 20+) et des échelles de guidage CFG ajustées offre une amélioration de vitesse de traitement allant jusqu'à x4 dans Uni3C tout en maintenant la qualité de génération.

3.3 Paramètres de Performance Optimisés#

Configuration de Boost de Vitesse x4 : Basé sur les optimisations intégrées d'Uni3C, les paramètres suivants fournissent un traitement beaucoup plus rapide :

Paramètres du Nœud WanVideo Sampler :

Steps: 10 (réduit par rapport au défaut de 20+)CFG: 1.0-1.5 (optimisé pour un équilibre vitesse-qualité)Shift: 5.0-7.0 (l'auteur recommande 7 pour les meilleurs résultats, 5 pour un traitement plus rapide avec Uni3C)Scheduler: UniPC (planificateur optimisé pour Uni3C)

Caractéristiques Clés de Performance :

- Intégration AnimateDiff : Uni3C tire parti des optimisations AnimateDiff initialement conçues pour la conversion de texte en vidéo mais efficaces pour la génération d'image en vidéo.

- Réduction Intelligente des Paramètres : Comme la conversion d'image en vidéo commence avec du contenu visuel existant, moins d'étapes de débruitage sont nécessaires par rapport à la génération de texte en vidéo avec Uni3C.

- Traitement Optimisé : Uni3C permet aux vidéos de 70 images de se terminer en ~4-5 minutes (contre ~27 minutes avec les paramètres originaux).

Options de Qualité vs Vitesse :

- Vitesse Maximale : Steps=10, CFG=1.0, Shift=5 → ~4 minutes pour 70 images avec Uni3C

- Équilibré : Steps=10, CFG=1.5, Shift=7 → ~5 minutes pour 70 images avec Uni3C

- Qualité Supérieure : Steps=15, CFG=2.0, Shift=7 → ~8-10 minutes pour 70 images avec Uni3C

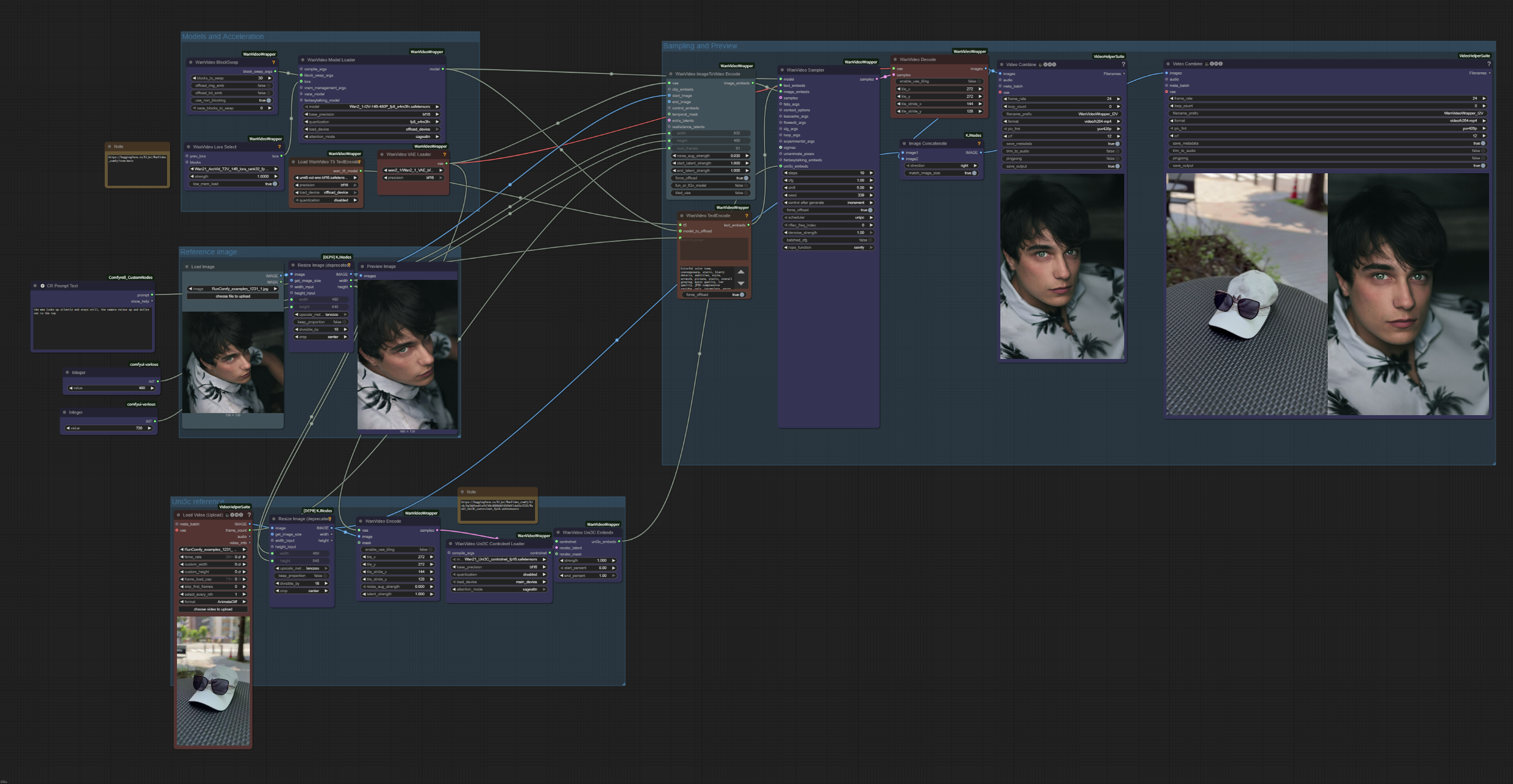

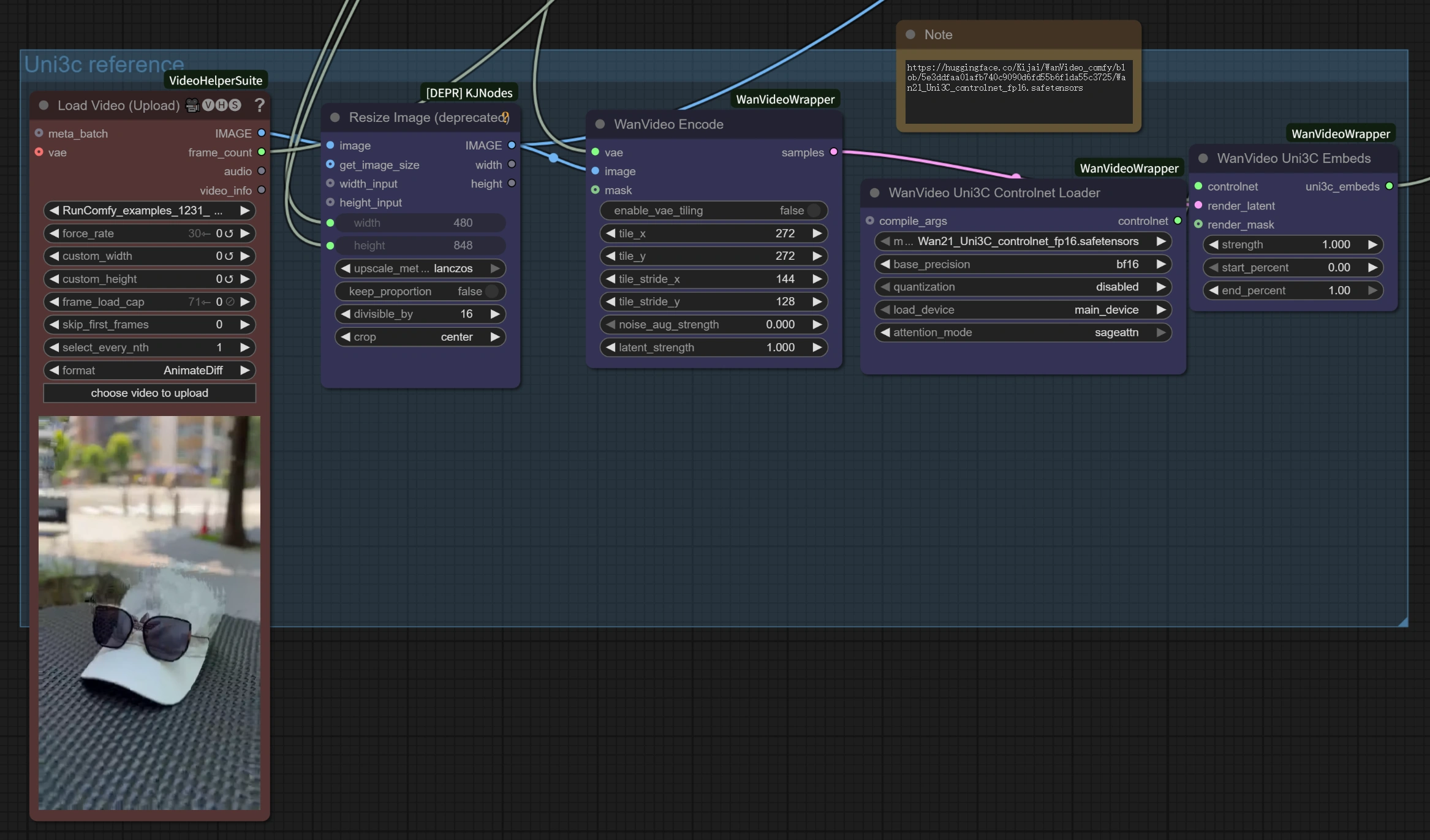

3.4 Compréhension des Composants du Workflow#

Section de Traitement Vidéo de Référence :

Load Video (Upload): Accepte les formats vidéo standard MP4, AVI pour référence de mouvement dans Uni3C.WanVideo Encode: Traite la vidéo de référence pour extraire les trajectoires de caméra et les motifs de mouvement pour Uni3C.Uni3C ControlNet Loader: Charge le modèle de contrôle spécialisé Uni3C pour la compréhension du mouvement.

Section de Génération Image en Vidéo :

Load Image: Votre image cible qui sera animée avec le mouvement de référence par Uni3C.WanVideo Image/ToVideo Encode: Convertit votre image statique en un format adapté à la génération vidéo par Uni3C.WanVideo Sampler: Moteur de génération principal avec paramètres optimisés pour une amélioration de vitesse x4 dans Uni3C.

Traitement de Sortie :

WanVideo Decode: Convertit la vidéo latente générée en format visionnable à partir d'Uni3C.Video Combine: Assemble le fichier vidéo final avec le bon taux de trame et le codage à partir d'Uni3C.

4. Conseils Avancés et Meilleures Pratiques#

Choisir des Matériaux de Référence pour Uni3C#

- Pour le Transfert de Mouvement : Sélectionnez des vidéos avec des mouvements clairs et visibles où la personne reste principalement dans le cadre pour Uni3C.

- Pour le Contrôle de la Caméra : Toute vidéo avec perspective intéressante ou mouvement de caméra souhaité pour Uni3C.

- Meilleurs Résultats : Lorsque la direction du mouvement de référence correspond à votre direction de sortie prévue avec Uni3C.

Meilleures Pratiques d'Ingénierie des Invites pour Uni3C#

- Principe "Ne pas Déranger" : Pour un transfert de mouvement pur sans changements de personnage, utilisez des invites simples et générales avec Uni3C.

- Changements d'Action Spécifiques : Soyez détaillé lorsque vous souhaitez modifier ce que le personnage fait avec Uni3C.

- Cohérence des Personnages : Concentrez les invites sur le maintien de l'apparence du personnage avec Uni3C.

Optimisation de la Qualité pour Uni3C#

- Cohérence du Mouvement : Évitez les changements soudains dans les vidéos de référence pour des résultats plus fluides avec Uni3C.

- Stabilité des Cadres : Assurez-vous que les matériaux de référence ont un éclairage et un cadrage cohérents pour Uni3C.

5. Remerciements#

Ce workflow est alimenté par Uni3C, développé par DAMO Academy (Alibaba Group), Université Fudan, et Hupan Lab. L'intégration ComfyUI est basée sur l'excellent travail de kijai (ComfyUI-WanVideoWrapper), avec des optimisations supplémentaires et un design de workflow pour rendre cette puissante technologie Uni3C accessible aux créateurs du monde entier.