Convierte textos en videos de alta calidad con Hunyuan Video de Tencent.

Convierte textos en videos de alta calidad con Hunyuan Video de Tencent.

Transforma imágenes en videos fluidos con escenas naturales y movimiento coherente.

Crea videos HD desde texto con Hailuo 02 Pro, rápidos y precisos.

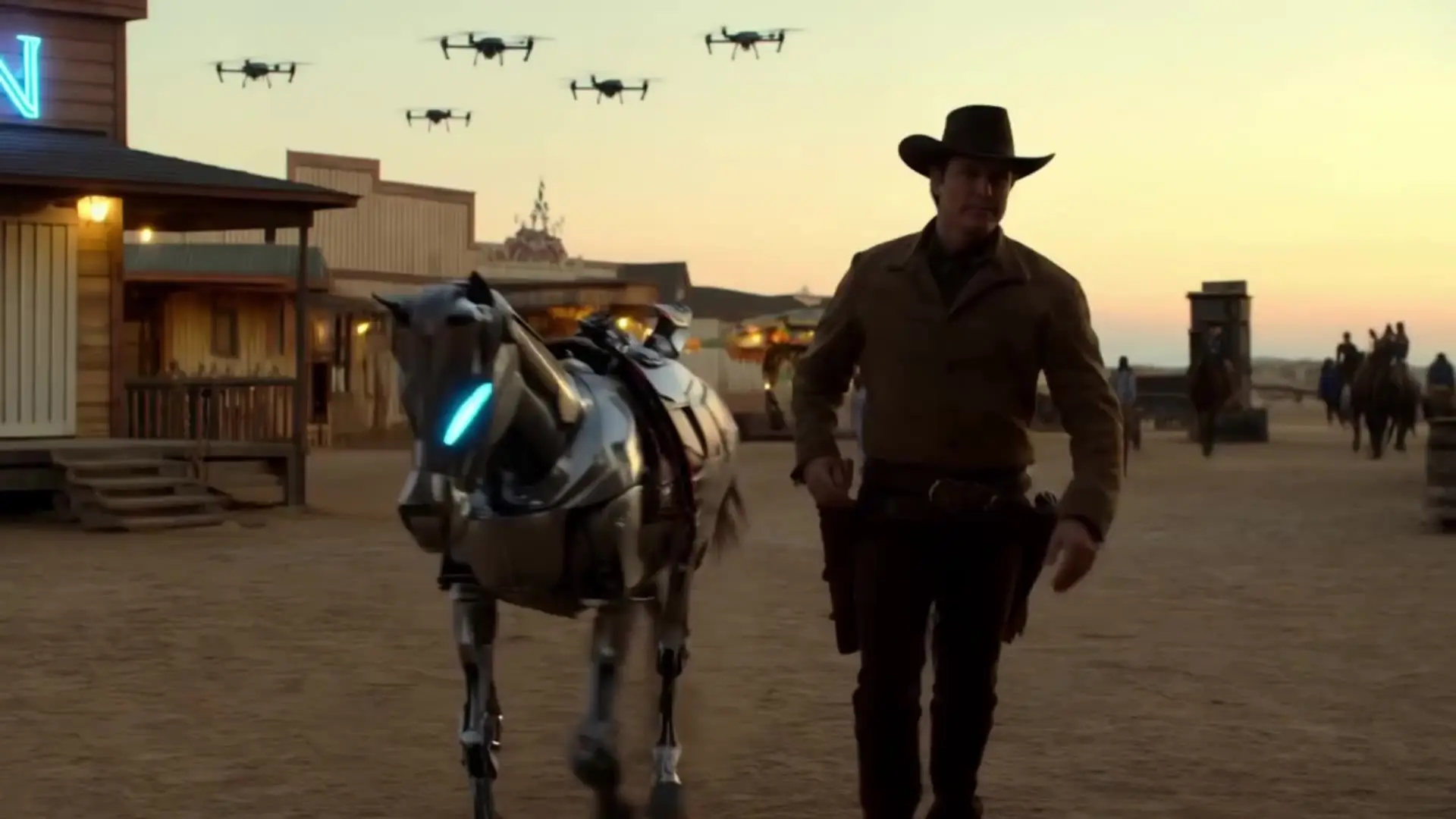

Transforma imágenes en videos cinematográficos al instante con la potencia creativa de Veo 3.1 Fast.

Convierte una imagen en video animado con efectos rápidos y creativos.

Convierte imágenes en videos animados con identidad realista y fluidez.

Veo 3.1 es un modelo de inteligencia artificial generativa desarrollado por Google DeepMind que convierte texto e imágenes en videoclips realistas. Su función de generación de video a partir de imágenes permite subir imágenes de referencia para guiar el estilo visual o la composición de la escena, obteniendo clips de alta calidad y coherencia, con sonido sincronizado.

Veo 3.1 incorpora secuencias multiescena, clips más largos de hasta 60 segundos, mayor coherencia entre escenas y mejor respuesta a instrucciones visuales. Además, mejora el proceso de imagen a video con presets cinematográficos y calidad de salida en 1080p, superando lo ofrecido por Veo 3.

El acceso a Veo 3.1 está disponible a través de plataformas como Vertex AI, Google AI Studio y el playground de Runcomfy, utilizando un sistema basado en créditos. Aunque se entregan créditos de prueba gratuita a nuevos usuarios, generar videos extensos a partir de imágenes puede requerir adquirir créditos adicionales o usar un plan de pago.

Veo 3.1 es perfecto para creadores de contenido, educadores y profesionales del marketing que necesiten producir videos cinematográficos y narrativos con rapidez. Su capacidad de traducir imágenes en video con precisión lo hace ideal para contar historias de marca, crear clips explicativos o producir contenido para redes sociales que exija alta fidelidad y control creativo.

Los videos generados con Veo 3.1 pueden alcanzar resolución Full HD (1080p), con audio sincronizado y elementos visuales consistentes. El modelo asegura continuidad entre escenas, generando movimiento cinematográfico, coherencia en la iluminación y un realismo de nivel profesional en cada salida.

Sí. Veo 3.1 incluye generación de audio de forma nativa, integrando música, sonidos ambientales y sincronización de diálogos junto al contenido visual. Esto hace que el proceso de imagen a video sea más inmersivo y permite entregar secuencias completas, listas para ser usadas en proyectos creativos sin necesidad de etapas adicionales.

Puedes acceder a Veo 3.1 mediante la API de Gemini, Google AI Studio, Vertex AI y el playground de Runcomfy en runcomfy.com. Una vez registrado, podrás generar clips utilizando el módulo de imagen a video y consumir créditos según la duración y resolución elegida para tu video.

Veo 3.1 funciona mejor con indicaciones bien estructuradas y con imágenes de referencia de alta calidad. Sin embargo, escenas muy prolongadas de más de 60 segundos o interacciones complejas con múltiples personajes pueden requerir varias versiones por separado. Aunque los resultados son realistas, es posible que se necesite algo de edición final para ajustar colores o tiempos específicos.

RunComfy is the premier ComfyUI platform, offering ComfyUI online environment and services, along with ComfyUI workflows featuring stunning visuals. RunComfy also provides AI Models, enabling artists to harness the latest AI tools to create incredible art.