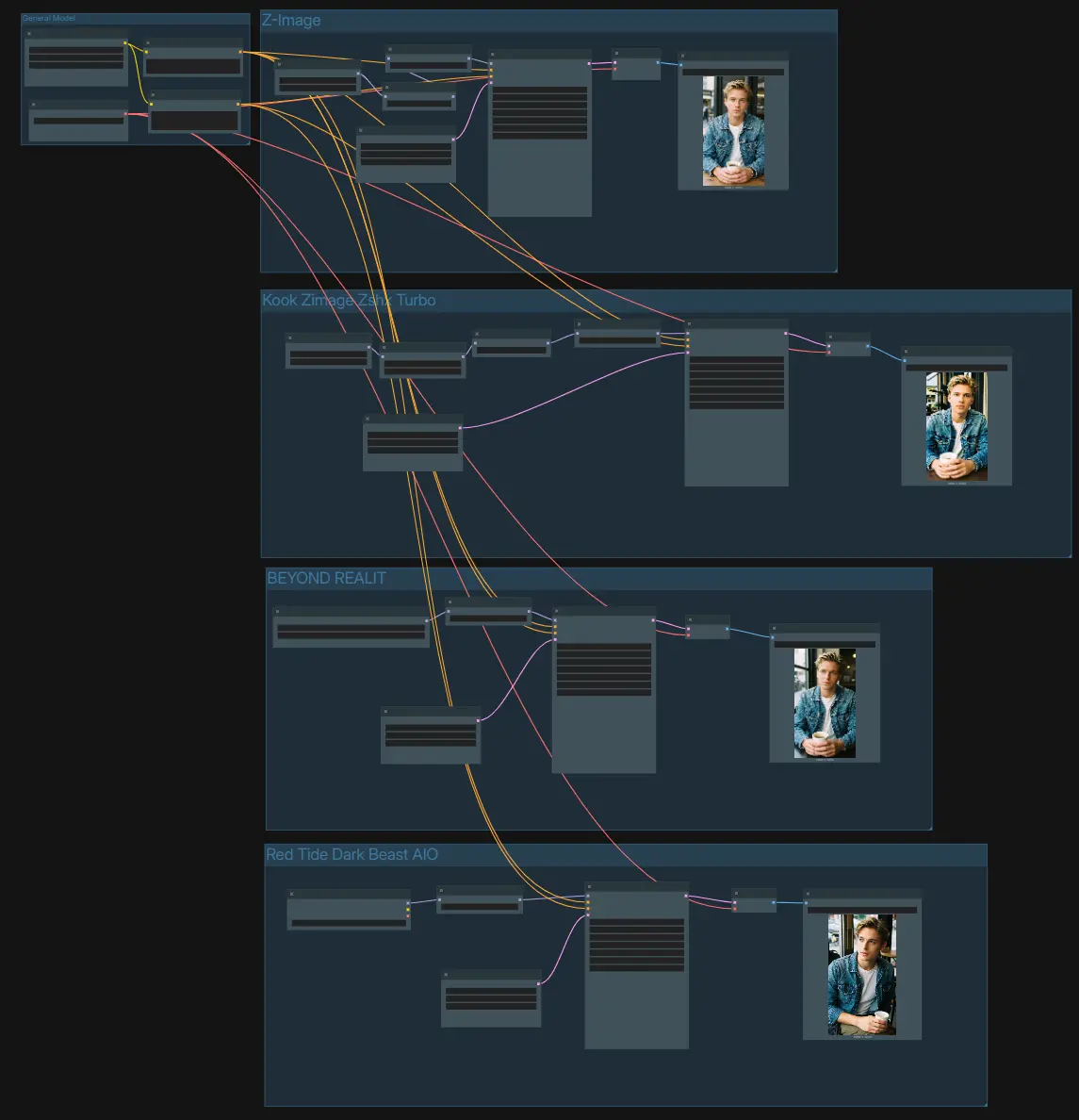

Z-Image Finetuned Modelle: Multi-Style, hochqualitative Bildgenerierung in ComfyUI#

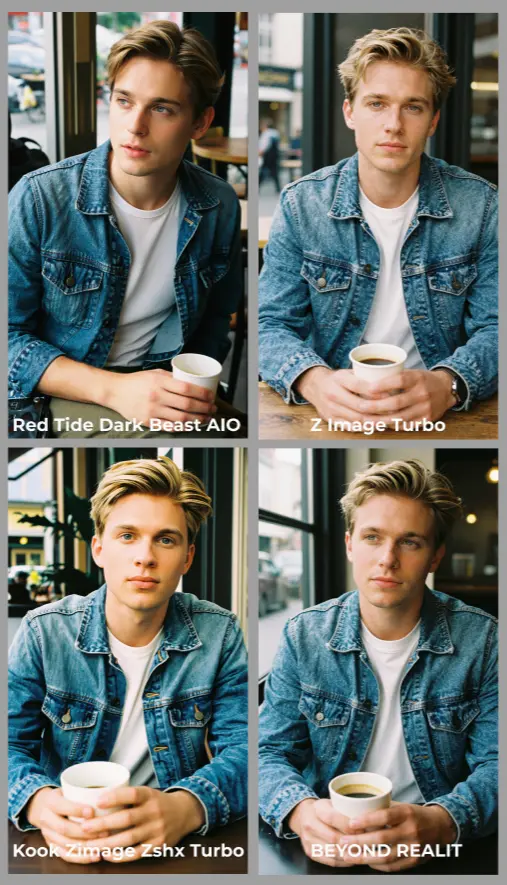

Dieser Workflow kombiniert Z-Image-Turbo und eine rotierende Auswahl an Z-Image Finetuned-Modellen in einem einzigen, produktionsreifen ComfyUI-Graphen. Er ist darauf ausgelegt, Stile nebeneinander zu vergleichen, das Verhalten der Eingabeaufforderung konsistent zu halten und scharfe, kohärente Ergebnisse mit minimalen Schritten zu erzielen. Im Hintergrund kombiniert er optimierte UNet-Ladung, CFG-Normalisierung, AuraFlow-kompatibles Sampling und optionale LoRA-Injektion, sodass Sie Realismus, filmische Porträts, dunkle Fantasie und Anime-inspirierte Looks erkunden können, ohne Ihre Leinwand neu zu verdrahten.

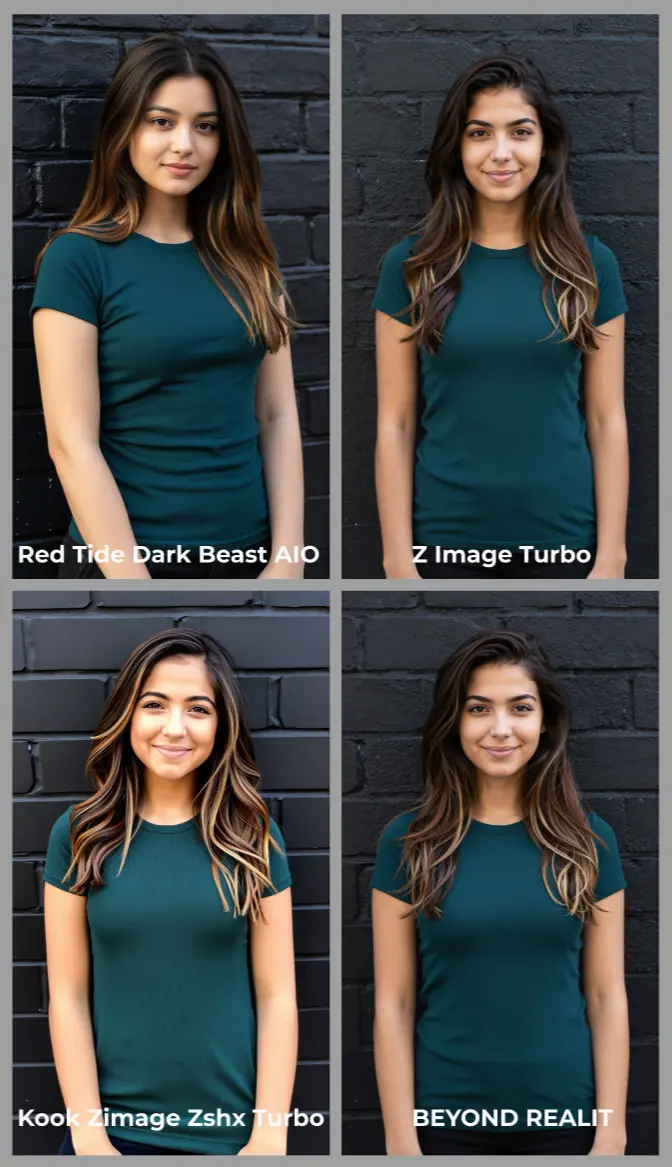

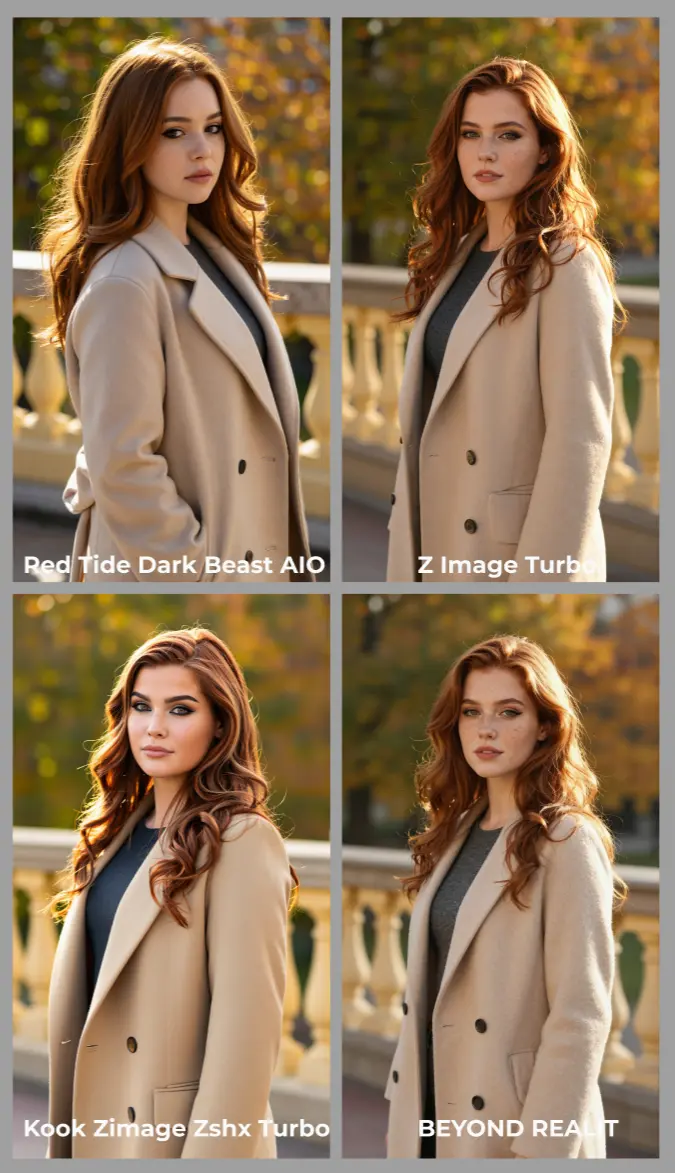

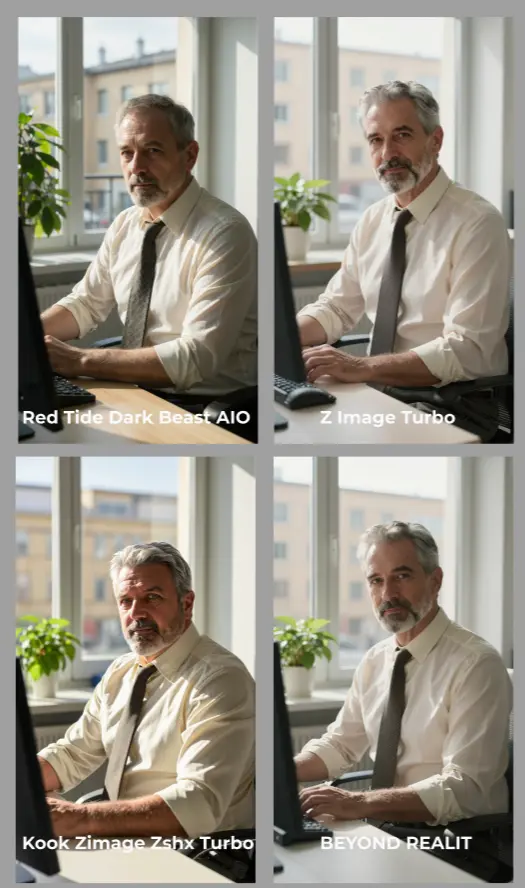

Z-Image Finetuned Modelle ist ideal für Künstler, Prompt-Ingenieure und Modellentdecker, die eine schnelle Möglichkeit suchen, mehrere Checkpoints und LoRAs zu bewerten, während sie innerhalb einer konsistenten Pipeline bleiben. Geben Sie eine Eingabeaufforderung ein, rendern Sie vier Variationen aus verschiedenen Z-Image Finetunes und finden Sie schnell den Stil, der am besten zu Ihrem Brief passt.

Schlüsselmodelle im Comfyui Z-Image Finetuned Modelle Workflow#

- Tongyi-MAI Z-Image-Turbo. Ein 6B-Parameter Single-Stream Diffusion Transformer, destilliert für wenige Schritte, fotoreale Text-zu-Bild-Konvertierung mit starker Befehlstreue und zweisprachiger Texterstellung. Offizielle Gewichte und Nutzungshinweise finden Sie in der Modellkarte, mit dem technischen Bericht und den Destillationsmethoden, die auf arXiv und im Projekt-Repo detailliert sind. Model • Paper • Decoupled-DMD • DMDR • GitHub • Diffusers pipeline

- BEYOND REALITY Z-Image (Community-Finetune). Ein fotorealistisch ausgerichteter Z-Image-Checkpoint, der glänzende Texturen, scharfe Kanten und stilisierte Veredelungen betont, geeignet für Porträts und produktähnliche Kompositionen. Model

- Z-Image-Turbo-Realism LoRA (Beispiel-LoRA, das in dieser Workflow-LoRA-Spur verwendet wird). Ein leichter Adapter, der ultra-realistisches Rendern fördert, während die Basisausrichtung der Z-Image-Turbo-Eingabeaufforderung beibehalten wird; ladbar ohne Ihr Basismodell zu ersetzen. Model

- AuraFlow-Familie (sampling-kompatible Referenz). Der Workflow verwendet AuraFlow-Style-Sampling-Hooks für stabile Generationen mit wenigen Schritten; sehen Sie sich die Pipeline-Referenz für Hintergrundinformationen zu AuraFlow-Planern und deren Designziele an. Docs

Wie man den Comfyui Z-Image Finetuned Modelle Workflow verwendet#

Der Graph ist in vier unabhängige Generationsspuren organisiert, die einen gemeinsamen Text-Encoder und VAE teilen. Verwenden Sie eine Eingabeaufforderung, um alle Spuren zu steuern, und vergleichen Sie dann die Ergebnisse, die von jedem Zweig gespeichert wurden.

- Allgemeines Modell

- Das gemeinsame Setup lädt den Text-Encoder und VAE. Geben Sie Ihre Beschreibung in die positive

CLIPTextEncode(#75) ein und fügen Sie optionale Einschränkungen in die negativeCLIPTextEncode(#74) ein. Dies hält die Konditionierung über die Zweige hinweg identisch, sodass Sie fair beurteilen können, wie sich jeder Finetune verhält. DerVAELoader(#21) liefert den Decoder, der von allen Spuren verwendet wird, um Latents zurück in Bilder zu verwandeln.

- Das gemeinsame Setup lädt den Text-Encoder und VAE. Geben Sie Ihre Beschreibung in die positive

- Z-Image (Base Turbo)

- Diese Spur führt das offizielle Z-Image-Turbo UNet über

UNETLoader(#100) aus und patcht es mitModelSamplingAuraFlow(#76) für Stabilität bei wenigen Schritten.CFGNorm(#67) standardisiert das Verhalten der klassifikatorfreien Führung, sodass der Kontrast und die Details des Samplers über Eingabeaufforderungen hinweg vorhersehbar bleiben. EinEmptyLatentImage(#19) definiert die Leinwandgröße, dann generiertKSampler(#78) Latents, die vonVAEDecode(#79) dekodiert und vonSaveImage(#102) geschrieben werden. Verwenden Sie diesen Zweig als Ihre Basislinie, wenn Sie andere Z-Image Finetuned Modelle bewerten.

- Diese Spur führt das offizielle Z-Image-Turbo UNet über

- Z-Image-Turbo + Realism LoRA

- Diese Spur injiziert einen Stiladapter mit

LoraLoaderModelOnly(#106) auf dem BasismodellUNETLoader(#82).ModelSamplingAuraFlow(#84) undCFGNorm(#64) halten die Ausgaben scharf, während die LoRA den Realismus fördert, ohne das Thema zu überfordern. Definieren Sie die Auflösung mitEmptyLatentImage(#71), generieren Sie mitKSampler(#85), dekodieren Sie überVAEDecode(#86) und speichern Sie mitSaveImage(#103). Wenn eine LoRA zu stark erscheint, reduzieren Sie ihr Gewicht hier, anstatt Ihre Eingabeaufforderung zu überbearbeiten.

- Diese Spur injiziert einen Stiladapter mit

- BEYOND REALITY Finetune

- Dieser Pfad tauscht einen Community-Checkpoint mit

UNETLoader(#88) aus, um einen stilisierten, kontrastreichen Look zu liefern.CFGNorm(#66) zähmt die Führung, sodass das visuelle Markenzeichen sauber bleibt, wenn Sie Sampler oder Schritte ändern. Stellen Sie Ihre Zielgröße inEmptyLatentImage(#72) ein, rendern Sie mitKSampler(#89), dekodieren SieVAEDecode(#90) und speichern Sie überSaveImage(#104). Verwenden Sie dieselbe Eingabeaufforderung wie die Basislinie, um zu sehen, wie dieser Finetune Komposition und Beleuchtung interpretiert.

- Dieser Pfad tauscht einen Community-Checkpoint mit

- Red Tide Dark Beast AIO Finetune

- Ein auf dunkle Fantasie ausgerichteter Checkpoint wird mit

CheckpointLoaderSimple(#92) geladen und dann vonCFGNorm(#65) normalisiert. Diese Spur neigt zu stimmungsvollen Farbpaletten und stärkeren Mikro-Kontrasten, während die Eingabeaufforderung gut eingehalten wird. Wählen Sie Ihren Rahmen inEmptyLatentImage(#73), generieren Sie mitKSampler(#93), dekodieren Sie mitVAEDecode(#94) und exportieren Sie ausSaveImage(#105). Es ist eine praktische Möglichkeit, grittigere Ästhetiken innerhalb desselben Z-Image Finetuned Modelle-Setups zu testen.

- Ein auf dunkle Fantasie ausgerichteter Checkpoint wird mit

Schlüssel-Knoten im Comfyui Z-Image Finetuned Modelle Workflow#

ModelSamplingAuraFlow(#76, #84)- Zweck: Patches das Modell, um einen AuraFlow-kompatiblen Sampling-Pfad zu verwenden, der bei sehr niedrigen Schrittzahlen stabil ist. Die

shift-Steuerung passt subtil die Sampling-Trajektorien an; behandeln Sie es als ein Feineinstellungsrad, das mit Ihrer Sampler-Auswahl und dem Schrittbudget interagiert. Für die beste Vergleichbarkeit über Spuren hinweg behalten Sie denselben Sampler bei und passen nur eine Variable (z.B.shiftoder LoRA-Gewicht) pro Test an. Referenz: AuraFlow-Pipeline-Hintergrund und Planungsnotizen. Docs

- Zweck: Patches das Modell, um einen AuraFlow-kompatiblen Sampling-Pfad zu verwenden, der bei sehr niedrigen Schrittzahlen stabil ist. Die

CFGNorm(#64, #65, #66, #67)- Zweck: Normalisiert die klassifikatorfreie Führung, sodass Kontrast und Detail nicht wild schwanken, wenn Sie Modelle, Schritte oder Planer ändern. Erhöhen Sie seine

strength, wenn Highlights auswaschen oder Texturen zwischen den Spuren inkonsistent erscheinen; reduzieren Sie es, wenn Bilder zu stark komprimiert aussehen. Halten Sie es ähnlich über die Zweige hinweg, wenn Sie ein sauberes A/B der Z-Image Finetuned Modelle wünschen.

- Zweck: Normalisiert die klassifikatorfreie Führung, sodass Kontrast und Detail nicht wild schwanken, wenn Sie Modelle, Schritte oder Planer ändern. Erhöhen Sie seine

LoraLoaderModelOnly(#106)- Zweck: Injiziert einen LoRA-Adapter direkt in das geladene UNet, ohne den Basis-Checkpoint zu verändern. Der

strength-Parameter steuert den stilistischen Einfluss; niedrigere Werte bewahren die Basisrealität, während höhere Werte das Aussehen der LoRA durchsetzen. Wenn eine LoRA Gesichter oder Typografie übermächtig beeinflusst, reduzieren Sie zuerst ihr Gewicht, dann feilen Sie an der Formulierung der Eingabeaufforderung.

- Zweck: Injiziert einen LoRA-Adapter direkt in das geladene UNet, ohne den Basis-Checkpoint zu verändern. Der

KSampler(#78, #85, #89, #93)- Zweck: Führt die eigentliche Diffusionsschleife aus. Wählen Sie einen Sampler und Planer, die gut mit wenigen Schritt-Destillationen zusammenpassen; viele Benutzer bevorzugen Euler-Style-Sampler mit einheitlichen oder mehrstufigen Planern für Turbo-Klassen-Modelle. Halten Sie Samen fixiert, wenn Sie Spuren vergleichen, und ändern Sie nur eine Variable nach der anderen, um zu verstehen, wie sich jeder Finetune verhält.

Optionale Extras#

- Beginnen Sie mit einem beschreibenden, absatzstilartigen Prompt und verwenden Sie ihn in allen Spuren, um Unterschiede zwischen den Z-Image Finetuned Modellen zu beurteilen; iterieren Sie Stilwörter erst, nachdem Sie einen bevorzugten Zweig ausgewählt haben.

- Für Turbo-Klassen-Modelle liefert sehr niedriger oder sogar null CFG oft die saubersten Ergebnisse; verwenden Sie die negative Eingabeaufforderung nur, wenn Sie bestimmte Elemente ausschließen müssen.

- Behalten Sie dieselbe Auflösung, denselben Sampler und denselben Samen bei, wenn Sie A/B-Tests durchführen; ändern Sie das LoRA-Gewicht oder

shiftin kleinen Schritten, um Ursache und Wirkung zu isolieren. - Jeder Zweig schreibt seine eigene Ausgabe; die vier

SaveImage-Knoten sind eindeutig beschriftet, sodass Sie schnell vergleichen und kuratieren können.

Links für weiterführende Lektüre:

- Z-Image-Turbo Modellkarte: Tongyi-MAI/Z-Image-Turbo

- Technischer Bericht und Methoden: Z-Image • Decoupled-DMD • DMDR

- Projekt-Repository: Tongyi-MAI/Z-Image

- Beispiel-Finetune: Nurburgring/BEYOND_REALITY_Z_IMAGE

- Beispiel-LoRA: Z-Image-Turbo-Realism-LoRA

Acknowledgements#

Dieser Workflow implementiert und baut auf den folgenden Arbeiten und Ressourcen auf. Wir danken den HuggingFace-Modellen für den Artikel für ihre Beiträge und Wartung. Für autoritative Details verweisen wir auf die originale Dokumentation und die unten verlinkten Repositories.

Ressourcen#

- HuggingFace Modelle:

Hinweis: Die Nutzung der referenzierten Modelle, Datensätze und Codes unterliegt den jeweiligen Lizenzen und Bedingungen, die von ihren Autoren und Betreuern bereitgestellt werden.