Wan 2.2 Prompt Relay: zeitgesteuertes Bild-zu-Video in ComfyUI#

Dieser Arbeitsablauf bringt Szenensteuerung auf Segmentebene zu Wan 2.2 Bild-zu-Video. Er nutzt Wan 2.2 für die Generierung und die Prompt Relay Methode, um verschiedene Prompts über eine einzige Zeitlinie zu leiten, sodass Sie die Kontrolle von einer Szene zur nächsten übergeben können, ohne das Rendern zu unterbrechen. Das Ergebnis ist ein fließendes Mehrereignis-Video, bei dem jedes Segment seinem eigenen Prompt folgt, während Objektidentität und Stil konsistent bleiben.

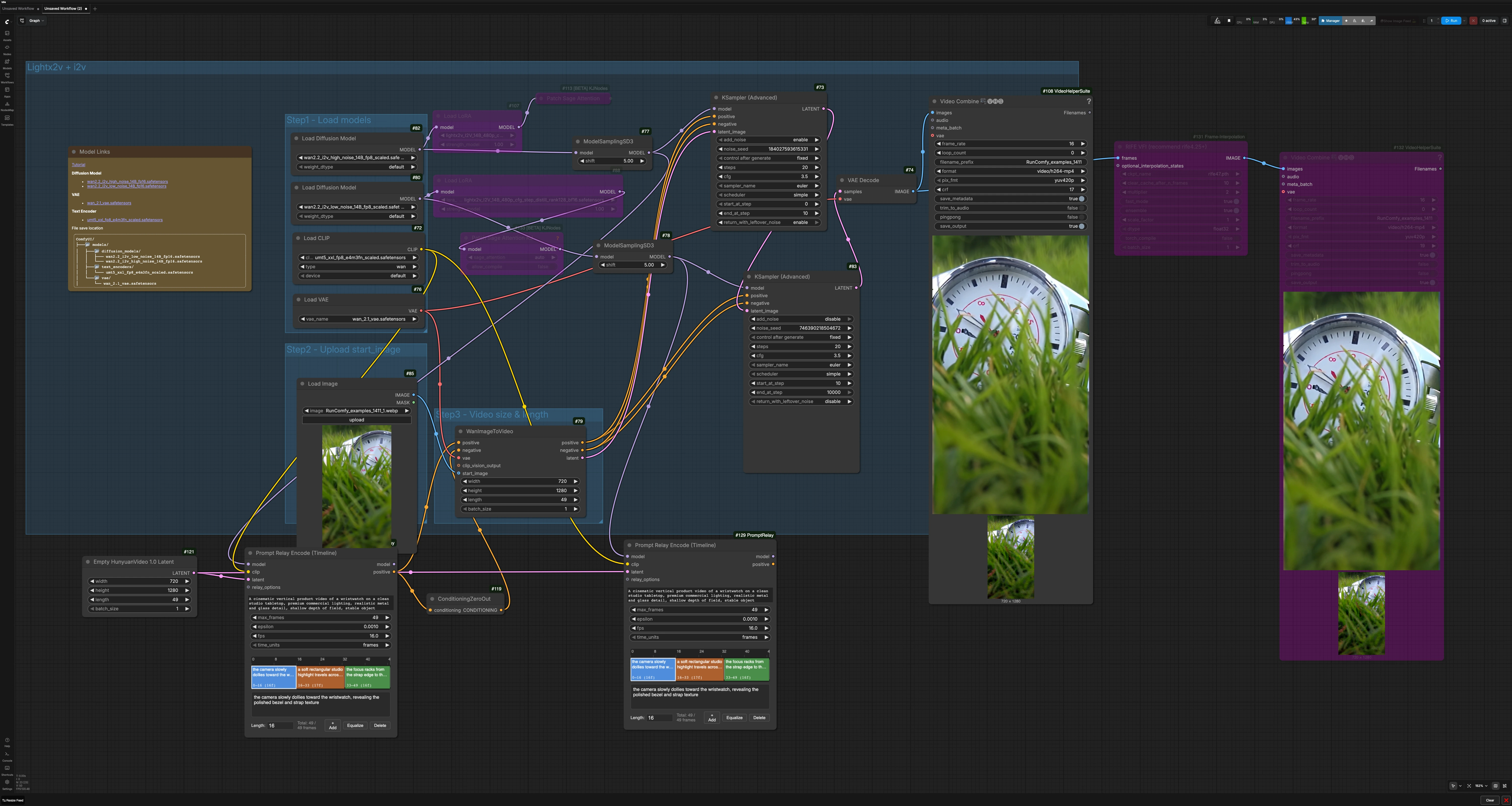

Wan 2.2 Prompt Relay ist eine Inferenzzeit-Routing-Technik, kein eigenständiges Modell oder LoRA. Der Graph ist für RunComfy Cloud konzipiert und enthält eine zweistufige Sampler-Kette sowie optionale RIFE-Frame-Interpolation. Verwenden Sie es, wenn Sie enge temporale Szenensteuerung mit minimalem Setup wünschen: Stellen Sie ein Startbild bereit, definieren Sie einen globalen Prompt und pro Segment Prompts, legen Sie die Videolänge fest und rendern Sie.

Schlüsselmodelle im ComfyUI Wan 2.2 Prompt Relay Arbeitsablauf#

- Wan 2.2 Bild-zu-Video Diffusionsmodell 14B. Hochrausch- und Niedrigrauschvarianten werden kombiniert, um Bewegung und Detail in einem zweistufigen Durchgang auszugleichen. Modelle sind im Comfy-Org neu verpackten Set auf Hugging Face verfügbar. Comfy-Org/Wan_2.2_ComfyUI_Repackaged

- UMT5-XXL Text-Encoder für Wan. Dieser Encoder übersetzt Ihre globalen und lokalen Prompts in Konditionierung, die von Wan 2.2 verwendet wird. Comfy-Org/Wan_2.1_ComfyUI_repackaged

- Wan 2.1 VAE. Wird verwendet, um Latents nach dem Sampling zurück in Frames zu dekodieren. Comfy-Org/Wan_2.2_ComfyUI_Repackaged/vae

- RIFE Frame-Interpolation Modell (optional). Erhöht die temporale Glätte oder die Zielbildrate nach der Generierung. hzwer/Practical-RIFE

So verwenden Sie den ComfyUI Wan 2.2 Prompt Relay Arbeitsablauf#

Der Arbeitsablauf leitet Text-Prompts über die Zeit, erzeugt ein latentes Video aus einem Startbild, verfeinert und dekodiert Frames, bevor optionale Interpolation und Kodierung stattfinden. Er ist in einige klare Gruppen unterteilt, die zusammenarbeiten, um das finale MP4 zu erzeugen.

- Schritt1 - Modelle laden Dieser Abschnitt initialisiert Wan 2.2, den Text-Encoder und das VAE. Die Hochrausch- und Niedrigrausch-Wan-Modelle werden beide vorbereitet, sodass die Pipeline zuerst die Bewegung etablieren und dann die Details verbessern kann. Wenn ein LoRA vorhanden ist, wird es vor dem Sampling auf das Basismodell angewendet. Sie müssen hier nichts ändern, es sei denn, Sie möchten Checkpoints austauschen.

- Schritt2 - Startbild hochladen Importieren Sie ein einzelnes Referenzbild, das Komposition, Subjektidentität und Beleuchtung für den ersten Frame mit

LoadImage(#85) definiert. Das Startbild verankert das Aussehen des Videos und hilft, Kontinuität über Segmente hinweg zu bewahren. Verwenden Sie ein sauberes, modellgerechtes Referenzbild für beste Ergebnisse. Ersetzen Sie es, wann immer Sie ein anderes Subjekt oder Layout wünschen. - Schritt3 - Video-Größe & Länge Legen Sie die Zielauflösung und die Gesamtbildanzahl im latenten Videoinitialisierer (

EmptyHunyuanLatentVideo(#121)) fest und halten Sie sie konsistent mit Ihrem Segmentplan. Die Summe Ihrer Segmentlängen sollte den Gesamtbildern entsprechen. Passen Sie die Bildrate, die Sie exportieren möchten, an die Prompt Relay Einstellungen und den Videowriter später im Graphen an. - Lightx2v + i2v Der Kernrenderpfad verwendet eine zweistufige Sampler-Kette. Stufe eins mit dem Hochrauschmodell etabliert Bewegung und Szenenübergänge. Stufe zwei mit dem Niedrigrauschmodell verfeinert Details und Textur, während der Bewegungspfad von Stufe eins erhalten bleibt. Diese Kombination macht Wan 2.2 Prompt Relay sowohl steuerbar als auch stabil für Szenen-zu-Szenen Übergaben.

- Prompt-Routing Geben Sie einen starken

global_promptein, der auf den gesamten Clip inPromptRelayEncodeTimeline(#117) angewendet wird. Definieren Sie dann Segment-Prompts entweder als JSON-Zeitliniendaten oder als pipe-getrennte Liste. Prompt Relay kodiert pro Frame Konditionierung, die sich nur an Segmentgrenzen ändert, und bietet optional Übergänge für natürliche Übergaben. Der Knoten speist Wan’s Konditionierung ein und stellt sicher, dass jedes Segment seiner beabsichtigten Richtung folgt. - Sampling und Dekodierung Die Pipeline durchläuft

WanImageToVideo(#79), dann einen grobenKSamplerAdvanced(#73), gefolgt von einem feinenKSamplerAdvanced(#83). Frames werden mitVAEDecode(#74) dekodiert und mitVHS_VideoCombine(#108) als Video geschrieben. Optional verwenden SieRIFE VFI(#131), bevor Sie ein zweitesVHS_VideoCombine(#132) verwenden, wenn Sie eine glattere Bewegung oder eine höhere Ausgabebildrate wünschen.

Schlüssel-Knoten im ComfyUI Wan 2.2 Prompt Relay Arbeitsablauf#

PromptRelayEncodeTimeline(#117) Zentral für Wan 2.2 Prompt Relay, wandelt dieser Knoten Ihrenglobal_promptund pro Segment Prompts in einen zeitbewussten positiven Konditionierungsstrom um. Sie können Segmente imtimeline_dataJSON oder inlocal_promptsmit einer Pipe-Syntax verfassen. Verwenden Siemax_frames, um die Videolänge anzupassen, wählen Sietime_units, die mit Ihrem Plan übereinstimmen, und passen Sieepsilonan, um Prompt-Übergaben zwischen Segmenten zu mildern oder zu verstärken. Halten Siefpskonsistent mit Ihrem finalen Export.WanImageToVideo(#79) Wandelt das Startbild plus Konditionierung in eine initiale latente Zeitlinie für Wan 2.2 um. Verbinden Sie Ihr Startreferenzbild mitstart_imageund halten Sie Breite, Höhe und Länge mit dem latenten Initialisierer abgestimmt. Negative Konditionierung in diesem Graphen ist absichtlich auf Null gesetzt, um Überbeschränkungen zu reduzieren und eine stabile Identität zu bewahren; führen Sie nur dann einen expliziten negativen Prompt ein, wenn Sie wiederkehrende Artefakte unterdrücken möchten.KSamplerAdvanced(#73) Erster Pass-Sampler, der Bewegung und Layout betont. Er arbeitet mit dem Hochrausch-Wan-Modell, das überModelSamplingSD3konfiguriert ist, um die Trajektorie zu erkunden, während die Prompt Relay Konditionierung respektiert wird. Passen Siestepsundcfgfür die Stärke der Führung an und halten Sie einen festennoise_seed, wenn Sie reproduzierbare Bewegung über Bearbeitungsiterationen hinweg wünschen.KSamplerAdvanced(#83) Zweiter Pass-Sampler, der Details und temporale Konsistenz mit dem Niedrigrausch-Wan-Modell verbessert. Er verfeinert Textur, Kanten und Mikrobewegung, ohne die grobe Trajektorie des ersten Passes zu bekämpfen. Wenn Sie hier die Genauigkeit erhöhen, sollten Sie die Führung ausbalancieren, um Über-Schärfung zu vermeiden, die die Bewegung destabilisieren kann.EmptyHunyuanLatentVideo(#121) Erstellt das leere latente Video, das räumliche Auflösung, Bildbudget und Batch-Größe definiert. Setzen Sie die Gesamtbilder auf die Summe aller Segmentlängen, damit Prompt Relay die Prompts sauber zuordnen kann. Eine Änderung der Auflösung wirkt sich auf Speicher und das Aussehen der Bewegungskadenz aus, daher skalieren Sie sorgfältig.VHS_VideoCombine(#108, #132) Kodiert Frames zu MP4. Passen Sieframe_ratean die Prompt Relayfpsan, wenn Sie keine Interpolation verwenden. Wenn SieRIFE VFIverwenden, setzen Sie die Bildrate des Writers auf die neue effektive fps. Passen Siecrffür das Gleichgewicht zwischen Größe und Qualität an.

Optionale Extras#

- Schreiben Sie den

global_prompt, um Ton, Kamerasprache und Qualitätstags zu fixieren, und halten Sie Segment-Prompts kurz und aktionsorientiert. - Stellen Sie sicher, dass die Gesamtlänge Ihrer Segmente der Videolänge entspricht, um Fehlanpassungen der Prompts zu vermeiden.

- Halten Sie die Seeds fest, während Sie an Prompts arbeiten, und randomisieren Sie die Seeds nur, wenn Sie einen neuen Ansatz wünschen.

- Verwenden Sie höhere oder breitere Startbilder, um eine Präferenz für das Seitenverhältnis vorzuschlagen, aber setzen Sie immer explizit Breite und Höhe für Vorhersehbarkeit.

- Wenn Sie Identitätsdrift über Segmente hinweg feststellen, verstärken Sie den

global_promptmit auffälligen Objektbeschreibungen und vereinfachen Sie lokale Prompts.

Ressourcen, um die hier verwendeten Komponenten zu erkunden:

- Prompt Relay Knoten für ComfyUI von kijai GitHub

- Wan 2.2 neu verpackte Modelle Hugging Face

- UMT5-XXL Text-Encoder neu verpackt für Wan 2.x Hugging Face

Danksagungen#

Dieser Arbeitsablauf implementiert und baut auf den folgenden Arbeiten und Ressourcen auf. Wir danken kijai für den ComfyUI-PromptRelay-Knoten, gordonchen19 für das Prompt-Relay-Projekt und Comfy-Org für die Wan_2.2_ComfyUI_Repackaged-Modelle für ihre Beiträge und Wartung. Für autoritative Details verweisen wir auf die Originaldokumentationen und Repositories, die unten verlinkt sind.

Ressourcen#

- YouTube/Workflow @Ai Verse Quell-Tutorial

- Docs / Release Notes: @Ai Verse Workflow Quell-Tutorial

- AI Verse/AI Verse Workflow-Seite

- Docs / Release Notes: AI Verse Workflow-Seite

- kijai/ComfyUI-PromptRelay Knoten-Repo

- GitHub: kijai/ComfyUI-PromptRelay

- gordonchen19/Prompt Relay Projektseite

- GitHub: gordonchen19/Prompt-Relay

- Docs / Release Notes: Prompt Relay Projektseite

- Comfy-Org/Wan 2.2 ComfyUI neu verpackte Modelle

- Hugging Face: Comfy-Org/Wan_2.2_ComfyUI_Repackaged (split_files)

Hinweis: Die Nutzung der referenzierten Modelle, Datensätze und Codes unterliegt den jeweiligen Lizenzen und Bedingungen der Autoren und Betreuer.