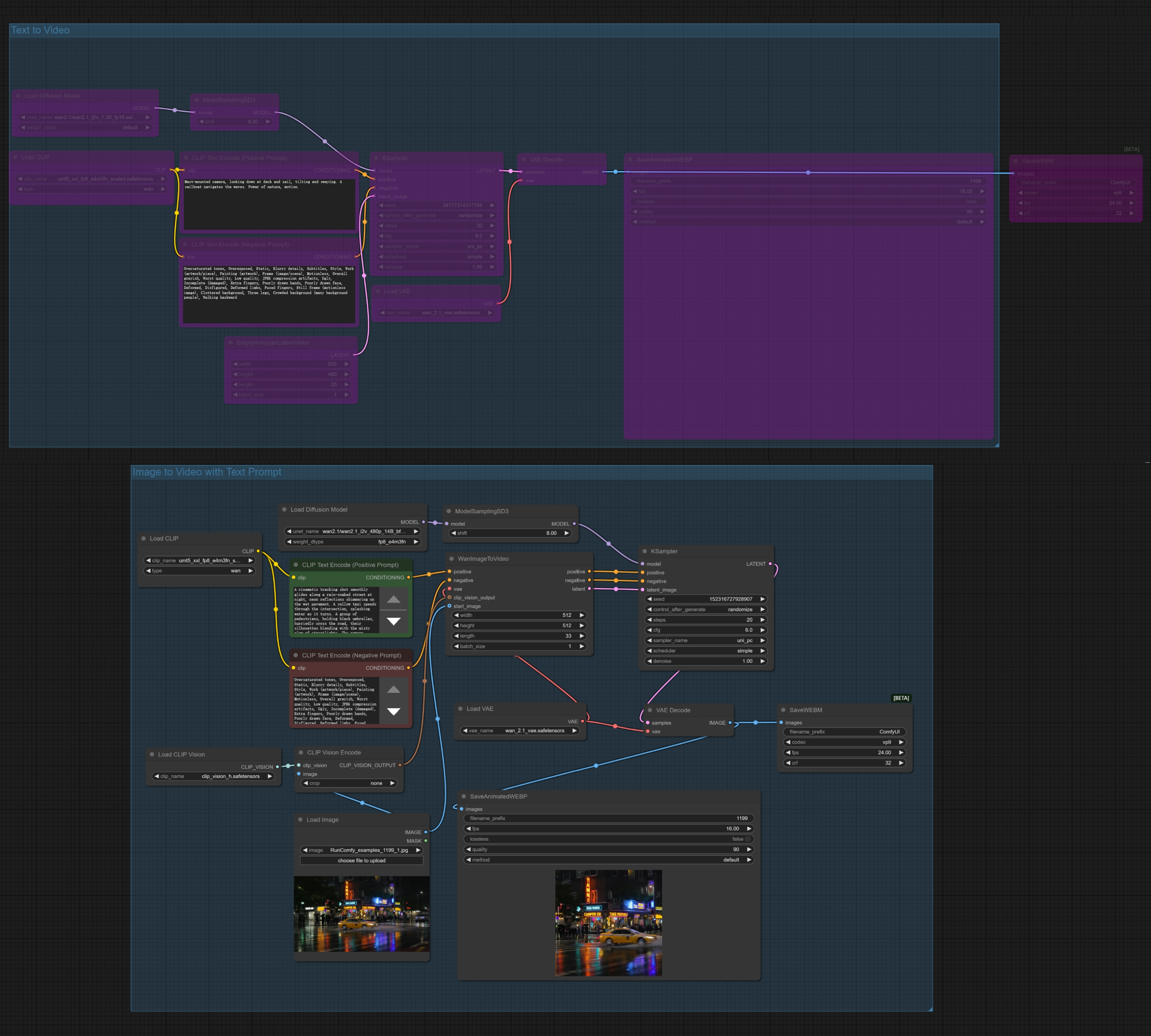

ComfyUI Wan 2.1 Workflow Beschreibung#

1. Was ist Wan 2.1?#

Der ComfyUI Wan 2.1 Workflow ist eine hochmoderne Videogenerierungspipeline, die die neuesten Wan 2.1-Modelle nutzt, um hochwertige Videos aus Textvorgaben oder/und Basisbildern zu erstellen. Wan 2.1 unterstützt Text-to-Video (T2V) und Image-to-Video (I2V) Generation und produziert 5-Sekunden-Videos mit natürlicher Bewegung und professioneller Qualität. Wan 2.1 setzt einen neuen Maßstab für KI-Videoerstellung und übertrifft Open-Source- und kommerzielle Alternativen. Das Wan 2.1 14B-Modell treibt die Grenzen weiter und liefert außergewöhnliche Ergebnisse bis zu 720P.

2. Vorteile und Fähigkeiten von Wan 2.1#

- Hochwertige Ausgabe: Generiert 480P bis 720P Videos mit realistischer Bewegung und hochauflösenden Texturen.

- Hardware-Zugänglichkeit: Das leichte Wan 2.1 1.3B-Modell benötigt nur 8,19 GB VRAM und ist mit den meisten modernen GPUs kompatibel (die hier von RunComfy bereitgestellt werden!).

- Vielseitige Generierung: Wan 2.1 unterstützt sowohl Text-to-Video (T2V) als auch Image-to-Video (I2V) Workflows.

- Mehrsprachige Unterstützung: Wan 2.1 ist das erste Videomodell, das sowohl chinesischen als auch englischen Text innerhalb von Videos generieren kann.

- VAE-Effizienz: Das Wan-VAE-Backend handhabt 1080P-Videos effizient und bewahrt die zeitliche Konsistenz.

- Schnelle Verarbeitung: Das Wan 2.1 1.3B-Modell liefert schnelle Ergebnisse bei gleichbleibender Qualität.

3. Wie man Wan 2.1 verwendet#

3.1 Wan 2.1 Generierungsmethoden#

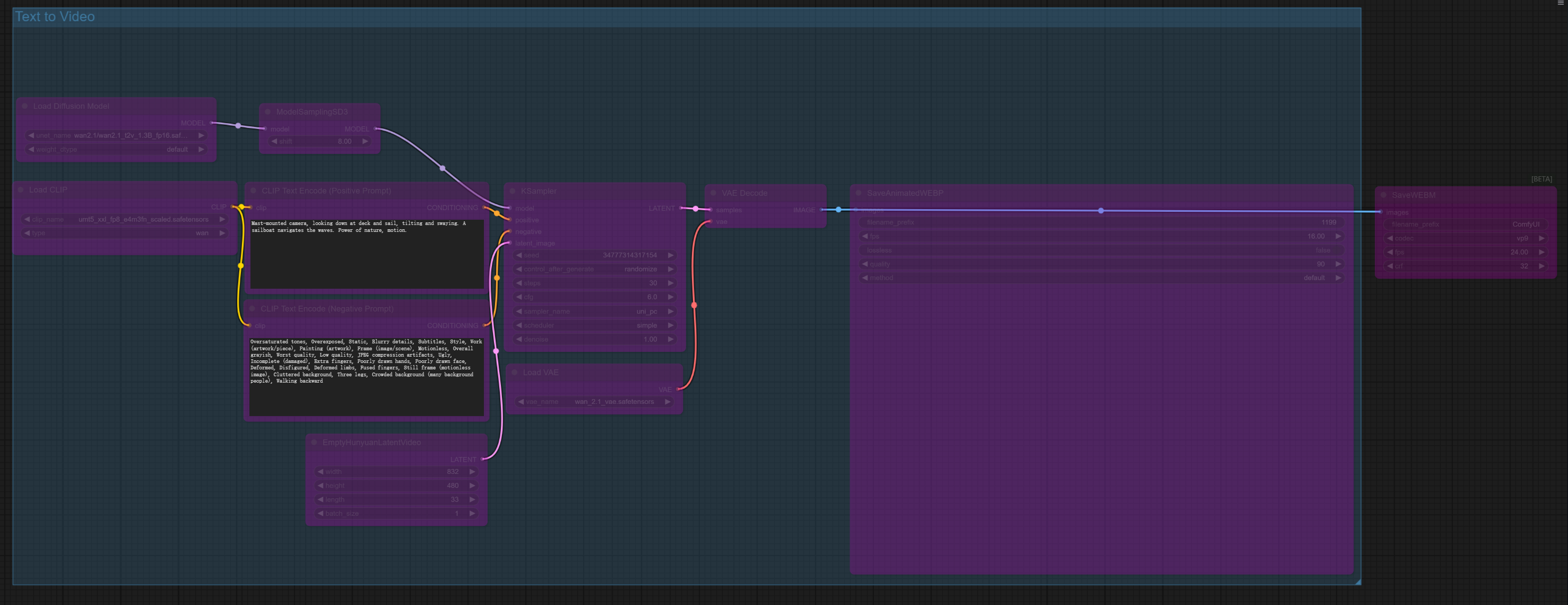

Primäre Wan 2.1 Generierungsmethode (standardmäßig deaktiviert): Text-to-Video#

- Eingaben: Textvorgabe

- Am besten für: Erstellen von Videos von Grund auf mit textuellen Beschreibungen

- Merkmale:

- Verwendet das Wan 2.1 1.3B-Modell für schnellere Generierung

- Erstellt 33-Frame (5-Sekunden) Videos in 480P-Auflösung

- Optimiert für flüssige Bewegung in kurzen Clips

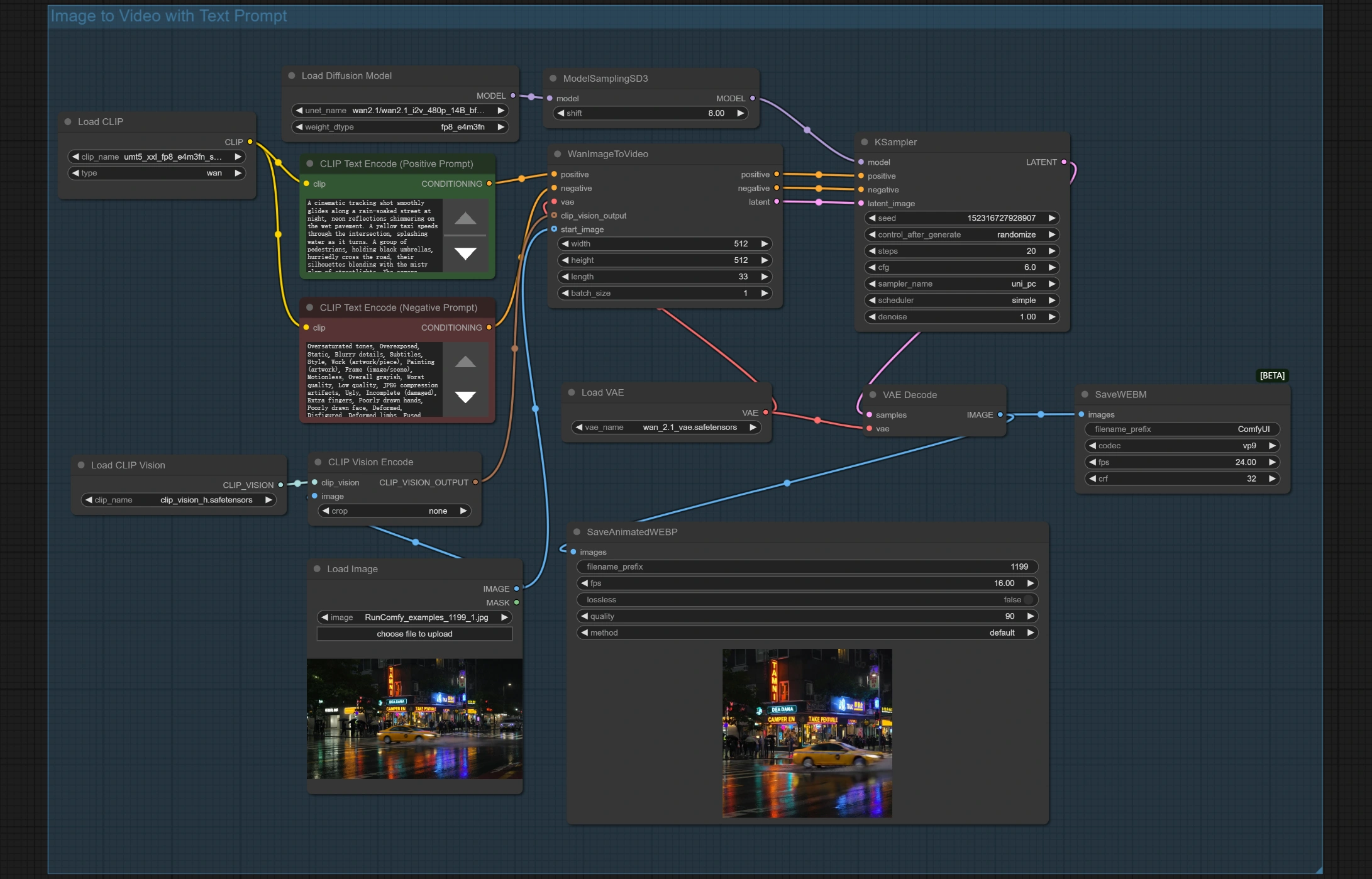

Erweiterte Wan 2.1 Methode (standardmäßig aktiviert): Image-to-Video mit Textvorgabe#

- Eingaben: Basisbild + Textvorgabe

- Am besten für: Animieren von Standbildern, während die Bewegung mit einer Vorgabe gesteuert wird

- Merkmale:

- Bewahrt visuelle Elemente des Eingabebildes

- Ermöglicht Textsteuerung über Bewegungsrichtung

- Verwendet das Wan 2.1 14B-Modell für höhere Treue

- Erstellt 33-Frame-Videos in 512x512-Auflösung

Beispiel-Workflow:#

- In CLIPTextEncode (Positive Prompt / Negative Prompt): Geben Sie Ihre Szenenbeschreibung ein (z.B. "ein Fuchs, der sich schnell in einer schönen Winterlandschaft mit Bäumen und Bergen bei Tag bewegt, verfolgte Kamera").

- In Load Image: Laden Sie Ihr Basisbild hoch.

- Für weitere Verfeinerung (optional):

- In KSampler: Passen Sie

stepsan (Standard: 30) für ein Gleichgewicht zwischen Qualität und Geschwindigkeit. - In ModelSamplingSD3: Ändern Sie den

scale-Wert (Standard: 8) für Vorgabentreue.

- In KSampler: Passen Sie

- Klicken Sie auf Queue Prompt, um die Generierung zu starten.

- In SaveAnimatedWEBP finden Sie Ihre Ausgabevorschau (auch gespeichert in ComfyUI > Output-Ordner).

3.2 Parameterreferenz für Wan 2.1#

- KSampler:

steps: 20-30 (höhere Werte verbessern die Qualität, erhöhen aber die Zeit)cfg: 6.0 (steuert die Stärke der Vorgabentreue)scheduler: "simple" (bestimmt den Rauschplanungsansatz)sampler_name: "uni_pc" (empfohlener Sampler für Wan 2.1) <p align="center"> <img src="https://cdn.runcomfy.net/workflow_assets/1199/readme03.webp" alt="Wan 2.1" width="350"/> </p>

- WanImageToVideo:

width/height: 512 (Ausgabeauflösung)length: 33 (Frames pro Video)batch_size: 1 (Anzahl der Videos pro Lauf)

- ModelSamplingSD3:

scale: 8 (steuert die Anleitungstreue)

- EmptyHunyuanLatentVideo:

width/height: 832/480 (T2V-Ausgabeauflösung)length: 33 (Frames pro Video)batch_size: 1 (Anzahl der Videos pro Lauf) <p align="center"> <img src="https://cdn.runcomfy.net/workflow_assets/1199/readme04.webp" alt="Wan 2.1" width="350"/> </p>

3.3 Erweiterte Optimierung mit Wan 2.1#

- Speicheroptimierung:

- Verwenden Sie das Wan 2.1 1.3B-Modell für schnellere Generierung mit geringeren VRAM-Anforderungen.

- Reduzieren Sie die Auflösung (z.B. 512x320) für schnellere Verarbeitung.

- Verringern Sie die Frame-Anzahl für kürzere und schnellere Renderings.

- Qualitätsoptimierung:

- Verwenden Sie das Wan 2.1 14B-Modell für hochwertigere Ausgaben.

- Erhöhen Sie die KSampler-Schritte auf 30-40 für verfeinerte Ergebnisse.

- Nutzen Sie Image-to-Video mit einem hochwertigen Basisbild für beste Treue.

Weitere Informationen#

Für zusätzliche Details zu Wan 2.1 besuchen Sie das Wan-Video GitHub-Repository.

Credits#

Das Wan 2.1 Modell wurde vom Wan Team entwickelt, und die ComfyUI-Integration wurde von den ursprünglichen Entwicklern erstellt. Alle Anerkennung gebührt diesen Innovatoren für die Weiterentwicklung der KI-gestützten Videogenerierung.