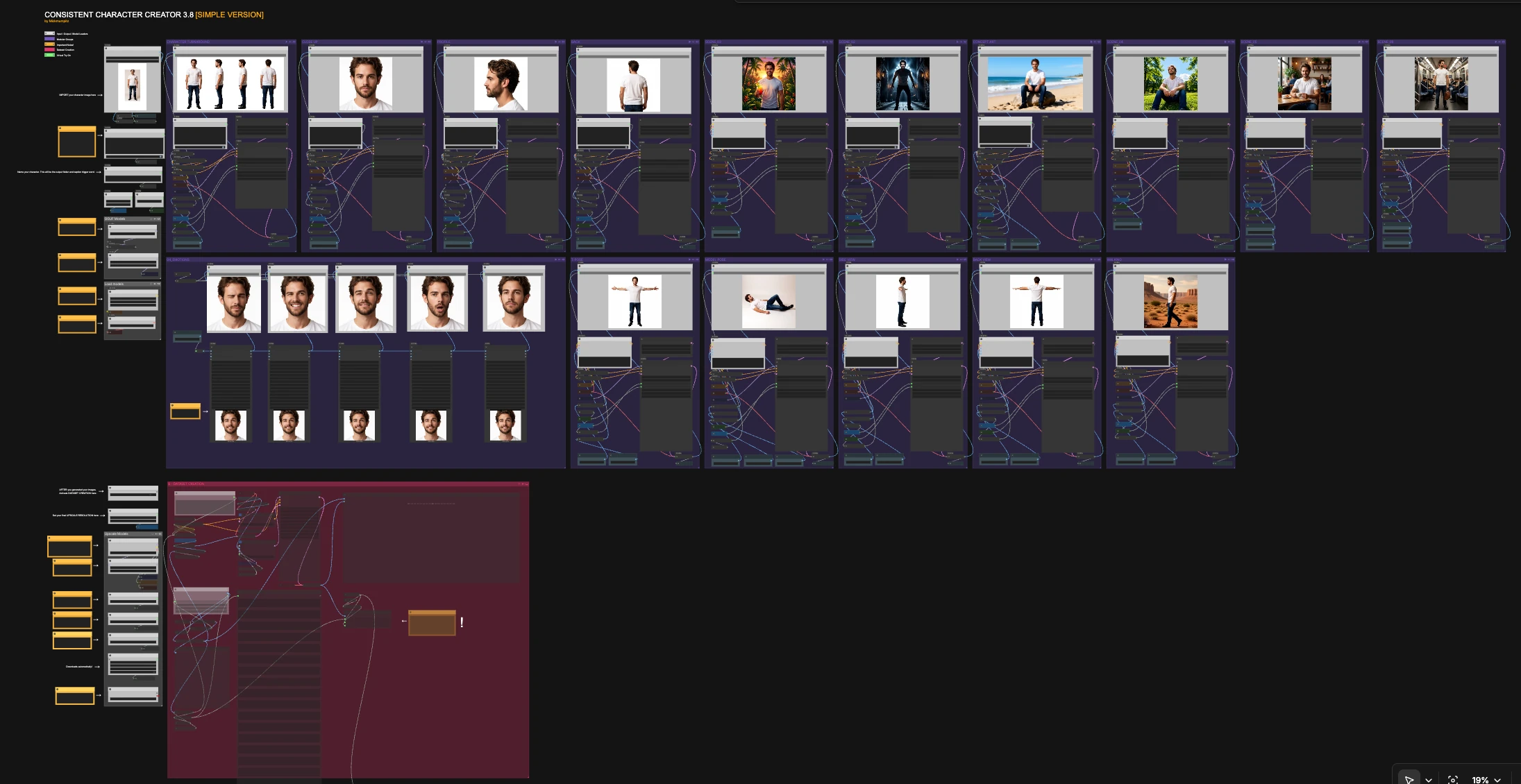

Consistent Character Creator 3.8: Hyperrealistische, identitätskonsistente KI-Charaktere aus einem Foto#

Consistent Character Creator 3.8 ist ein modularer ComfyUI-Workflow, der ein einzelnes Referenzbild in ein vollständiges, identitätskonsistentes Charakterpaket verwandelt. Er konzentriert sich auf Geschwindigkeit und Wiederholbarkeit, während er die Proportionen, Kleidung und Gesichtszüge des Subjekts über Ansichten und Szenen hinweg bewahrt.

Basierend auf Qwen-Image-Edit-2511 fügt diese Version reichhaltigere Drehungen, mehrere Szenenvarianten, Nahaufnahmen, Anprobe- und Pose-Pfade sowie ein Dataset-Export-Utility hinzu. Das Ergebnis ist ein Ein-Leinwand-System für Charakterkünstler, Spieleentwickler und Kreative, die schnell hyperrealistische, konsistente Ergebnisse benötigen.

Schlüsselmodelle im Comfyui Consistent Character Creator 3.8 Workflow#

- Qwen-Image-Edit-2511 (GGUF) UNet. Der bildgeführte Generator, der Identität und Stil aus Ihrem Referenzfoto verankert. Wird über die "Qwen Image Edit"-Knoten mit GGUF-Gewichten verwendet, die für ComfyUI optimiert sind. unsloth/Qwen-Image-Edit-2511-GGUF

- Qwen Bildencoder und VAE. Text-Encoder und der VAE, die mit dem Qwen Bildbearbeitungs-UNet zusammenarbeiten, um das Referenzbild korrekt zu interpretieren und hochwertige Pixel zu dekodieren. Comfy-Org/Qwen-Image_ComfyUI

- Qwen-Image-Edit-2511-Lightning LoRA. Ein leichter LoRA, der Qwen-Bildbearbeitungen beschleunigt und stabilisiert, während die Identität erhalten bleibt. lightx2v/Qwen-Image-Edit-2511-Lightning

- FLUX.1-dev Checkpoint. Verwendet in der Dataset-Pipeline für stilbewusste Hochskalierung und Verfeinerung. Comfy-Org/flux1-dev

- USO FLUX Projektormodell-Patch. Verbindet CLIP-Vision-Stilmerkmale in FLUX für stilkonsistente Verfeinerung und Dataset-Vorbereitung. Comfy-Org/USO_1.0_Repackaged

- SigCLIP Vision 384. Extrahiert visuelle Merkmale für Stilreferenz und Anleitung im Dataset-Pfad. Comfy-Org/sigclip_vision_384

- Florence-2-FLUX-Large. Generiert hochwertige automatische Beschreibungen für Dataset-Export. gokaygokay/Florence-2-Flux-Large

- 4x-UltraSharp Upscaler. Scharfe, natürliche Hochskalierung, die im Dataset-Fluss verwendet wird. Jeder kompatible Upscaler kann ausgetauscht werden.

Verwendung des Comfyui Consistent Character Creator 3.8 Workflows#

Die allgemeine Logik ist einfach: Importieren Sie ein sauberes Referenzbild, geben Sie dem Charakter einen kurzen Namen (wird für Ordner und Beschreibungen verwendet), fügen Sie optional einen einzeiligen Stil-Prompt hinzu und führen Sie dann jede benötigte Gruppe aus. Jede Gruppe ist eigenständig und kann unabhängig ausgelöst werden, um Nahaufnahmen, Drehungen, Posen, Szenen und Dataset-Exporte zu erstellen, die visuell konsistent bleiben.

Modelle laden#

Diese Utility-Gruppe initialisiert die Qwen Bildbearbeitungs-Encoder, den gepaarten VAE und die CLIP Text-/Vision-Backbones. Die Qwen-Image-Edit-2511 GGUF-Gewichte und der Lightning LoRA werden geladen und kombiniert, sodass Sie schnell iterieren können, ohne manuelle Einrichtung. Sie müssen hier nichts ändern, es sei denn, Sie möchten Checkpoints oder Encoder austauschen.

GGUF-Modelle#

Diese Gruppe richtet den Graphen auf das Qwen-Image-Edit-2511 GGUF UNet aus, das von allen Generationspfaden verwendet wird. Es hält das Sampling über die Leinwand stabil, während der Lightning LoRA die Schritte beschleunigt. Behandeln Sie es als Rückgrat, das die Identität durchsetzt.

Upscale-Modelle#

Lädt den FLUX.1-dev Checkpoint, den USO FLUX Projektormodell-Patch, einen CLIP-Vision-Encoder und Ihren gewählten Upscaler. Diese Assets werden hauptsächlich innerhalb der Dataset-Pipeline verwendet, um schärfere, stilkonsistente Trainingsbilder und Beschreibungen zu erzeugen. Sie können die Standardeinstellungen beibehalten, es sei denn, Sie bevorzugen einen anderen Upscaler oder müssen den Stilprojektor austauschen.

CHARAKTER-DREHUNG#

Erzeugt ein sauberes Mehransichtsblatt aus Ihrem einzelnen Eingabebild. Der Qwen-Encoder konditioniert auf die Referenz und eine kurze Anweisung, die eine gleichmäßige, weiße Hintergrundaufstellung verlangt. Verwenden Sie dies, wenn Sie eine schnelle Identitätsprüfung durchführen möchten, bevor Sie Szenen und Posen ausführen. Ausgaben werden unter dem Namen Ihres Charakters gespeichert, um sie in späteren Gruppen einfach wiederzuverwenden.

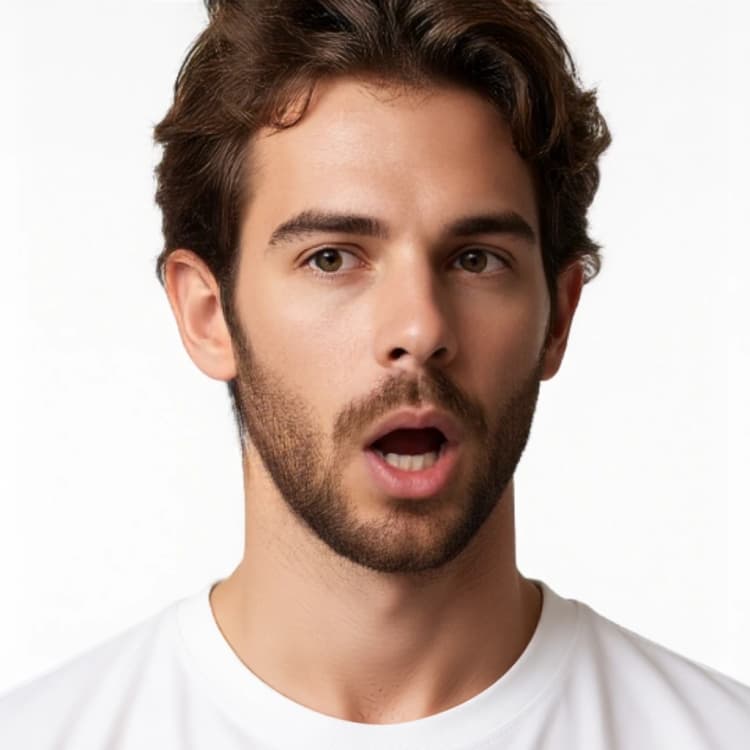

NAHAUFNAHME#

Erstellt eine frontale, neutrale Nahaufnahme, die Hautfarbe, Gesichtszüge und Mikrodetaillierung festhält. Der Encoder priorisiert Ihr Referenzbild über Text, sodass die Ähnlichkeit erhalten bleibt. Verwenden Sie es für Thumbnails, ID-Karten oder um zu beurteilen, ob die Identität für breitere Szenen bereit ist.

PROFIL#

Erzeugt eine Seitenansicht-Nahaufnahme des Kopfes zur Profil- und Silhouettenüberprüfung. Der Prompt fordert eine saubere Rahmung, um die Proportionen konsistent zu halten. Führen Sie dies frühzeitig aus, um die Form von Ohr, Nase und Kiefer zu bestätigen, bevor Sie zu Ganzkörperaufnahmen übergehen.

RÜCKEN#

Erstellt eine Über-die-Schulter- oder Rückenansicht, um das Porträtspektrum zu vervollständigen. Dies hilft, die Haarsilhouette, die Nähte der Kleidung und die Rückenproportionen zu validieren. Es ist besonders nützlich, wenn Sie später Animationen oder Drehungen generieren möchten.

T-POSE#

Erzeugt eine Ganzkörper-neutrale T-Pose auf Weiß für Rigging, Anprobe oder Vorlagenarbeiten. Da es durch dieselbe Referenz konditioniert ist, werden Proportionen und Kleidung ohne Drift übertragen. Verwenden Sie dies als Grundlage, bevor Sie Bewegungen oder stilisierte Posen versuchen.

MODELLPOSE#

Platziert den Charakter in entspannten Studio-Posen für Anprobe- und Lookbook-Style-Aufnahmen. Es ist darauf ausgelegt, Kleidung, Frisur und Styling intakt zu halten, während die Körperhaltung geändert wird. Ideal für Bekleidungsvisualisierung oder Kunstdirektionstests.

SEITENANSICHT#

Erstellt eine Ganzkörper-Seitenansicht zur Skalen- und Haltungsanpassung. Das Ausführen von SEITENANSICHT plus RÜCKANSICHT gibt Ihnen orthografische Referenzen, die Sie für Modellierung oder 2D-Rigging verwenden können. Identität wird durch denselben Konditionierungsstapel erhalten, der auch anderswo verwendet wird.

RÜCKANSICHT#

Erstellt eine Ganzkörper-Rückenansicht, um die orthografische Abdeckung zu vervollständigen. Hilfreich für Details auf der Rückseite von Kleidungsstücken, Rucksäcken oder Haarschnittkontrollen. Verwenden Sie dies zusammen mit SEITENANSICHT und T-POSE beim Zusammenstellen von Drehblättern.

GEHEN#

Erzeugt einen filmischen Seitenansicht-Gehrahmen, der das Outfit und die Silhouette beibehält. Die Anweisung fördert natürliche Bewegungen, ohne die Identität zu brechen. Nützlich für schnelle Storyboards und Shot-Tests.

SZENE_02#

Versetzt den Charakter in ein stimmungsvolles Interieur mit Beleuchtungsänderungen und bewahrt dabei Kleidung und Gesicht. Verwenden Sie es, um zu testen, wie Ihr Charakter unter stilisierter Beleuchtung aussieht. Die Identitätskonsistenz wird durch die bildorientierte Konditionierung aufrechterhalten.

SZENE_03#

Platziert den Charakter im Freien mit warmem Licht und Vordergrundrequisiten, während er denselben Look und die Garderobe beibehält. Es ist ein guter Belastungstest für Farbgleichgewichtverschiebungen und hält das Gesicht dennoch stabil. Tauschen Sie dies ein, wenn Sie helle, gesättigte Ergebnisse wünschen.

SZENE_04#

Gibt Ihnen ein sonniges Park-Setup mit einem anderen Kamerawinkel, um die Stabilität des Gesichts bei niedrigen Winkeln zu überprüfen. Führen Sie dies nach dem neutralen Paket aus, um die Ähnlichkeit bei Aufwärtsaufnahmen zu bestätigen. Nützlich für soziale, Lifestyle- oder Produktkontexte.

SZENE_05#

Fügt eine gemütliche Café-Umgebung und Handheld-Requisitenführung hinzu, während Outfit und Stil erhalten bleiben. Dies ist eine Realitätsüberprüfung, die Innenbeleuchtung und Handinteraktion mischt, ohne die Identität zu verlieren. Verwenden Sie es, wenn Sie naturalistische Erzählrahmen benötigen.

SZENE_06#

Bewegt den Charakter in den öffentlichen Nahverkehr mit beibehaltener Kleidung und Farbpalette. Es überprüft die Identität in engeren, geschäftigeren Hintergründen. Praktisch für redaktionelle oder urbane Erzähltafeln.

KONZEPTKUNST#

Erzeugt eine kunstgesteuerte Variante, die den Stil extrapoliert, während die ursprünglichen Proportionen und das Outfit weiterhin geehrt werden. Es ist für Moodboards, Key-Art oder Vorproduktion-Skizzen gedacht. Da es dieselbe Referenz nutzt, bleibt Ihr Charakter erkennbar.

04_EMOTIONEN#

Erstellt mehrere Nahaufnahmevariationen mit subtilen Ausdrucksänderungen. Es ist nützlich für UI-Avatare, Reaktionsblätter oder Dialogporträts, während es dem Subjekt treu bleibt. Lösen Sie diese Gruppe aus, wenn Sie ein kompaktes Emotionspaket mit derselben Identität wünschen.

B - DATENSATZERSTELLUNG#

Nach der Erstellung Ihres Pakets lädt diese Gruppe ausgewählte Bilder, skaliert sie hoch und normalisiert sie, beschriftet sie automatisch mit Florence-2 und schreibt einen einsatzbereiten Ordner. Es verwendet einen Stil-Referenzpfad, sodass Ihr Dataset denselben Look wie das generierte Paket beibehält. Legen Sie den Charakternamen einmal fest und der Exporter speichert Bilder und Beschreibungen in einem dedizierten Dataset-Ordner für zukünftige Feinabstimmungen.

Schlüssel-Knoten im Comfyui Consistent Character Creator 3.8 Workflow#

TextEncodeQwenImageEditPlus(#1199). Versorgt Qwen mit Ihrem Referenzbild plus einer kurzen Anweisung, damit das Modell weiß, was geändert und was beibehalten werden soll. Halten Sieimage1mit Ihrem Charakterfoto verbunden und schreiben Sie prägnanteprompt-Texte, wenn Sie Pose- oder Szenenänderungen benötigen, anstatt Stilumschreibungen. Je weniger Sie die Identität überbeschreiben, desto konsistenter bleiben die Ausgaben.FluxKontextMultiReferenceLatentMethod(#1351). Sperrt Identitätsmerkmale früh im Samplingschema, sodass das Subjekt über Winkel und Beleuchtung hinweg überlebt. Verwenden Sie es, wie es bereitgestellt wird, für die stärkste Identität; lockern Sie es nur, wenn Sie absichtlich mehr Umgestaltung wünschen.KSampler(#199). Konvertiert Konditionierung in Bilder über alle Pakete hinweg. Wenn Sie mehr Treue benötigen, passen Siestepsan; wenn Sie eine lockerere Einhaltung der Anweisung wünschen, passen Siecfgan. Kleine koordinierte Änderungen hier beeinflussen jede Gruppe auf vorhersehbare Weise.LoraLoaderModelOnly(#547). Befestigt den Qwen-Image-Edit-2511-Lightning LoRA an das UNet. Wenn Sie Überschärfung oder Driften des Looks feststellen, senken Siestrength_modelleicht; erhöhen Sie es, wenn die Bearbeitungen zu schwach erscheinen. Dies ist der Hauptregler für Geschwindigkeit zu Qualität bei Qwen-Bearbeitungen. lightx2v/Qwen-Image-Edit-2511-LightningUSOStyleReference(Subgraph). Kombiniert CLIP-Vision-Merkmale mit FLUX über den USO-Projektor, um den Stil Ihres Pakets beim Hochskalieren für Dataset-Export zu bewahren. Wenn Gesichter zu eng oder zu locker zugeschnitten sind, passen Sie diecrop-Option im CLIP-Vision-Encoder für stabilere Rahmung an. Comfy-Org/USO_1.0_RepackagedFlorence2Run(#1413). Generiert automatisch Beschreibungen, die vom Dataset-Schreiber verwendet werden. Lassen Sie die Beschreibungs-taskim detaillierten Modus für Trainingsdatasets; wechseln Sie nur zu kürzeren Modi, wenn Sie kompakte Tags benötigen. gokaygokay/Florence-2-Flux-LargeSaveImageTextDataSetToFolder(#1440). Schreibt Bilder und gepaarte Beschreibungen in einen sauberen Ordner unter Verwendung Ihres Charakternamens. Legen Siefolder_namefest, um Datasets pro Charakter getrennt zu halten, undfilename_prefixfür reproduzierbare Benennung.

Optionale Extras#

- Beginnen Sie mit NAHAUFNAHME und PROFIL, um die Ähnlichkeit zu validieren, und führen Sie dann CHARAKTER-DREHUNG aus, bevor Sie Szenen und Posen erkunden.

- Halten Sie Prompts kurz und beschreibend für Kamera, Pose oder Umgebung; lassen Sie das Referenzbild die Identität definieren.

- Verwenden Sie einen einfachen, eindeutigen NAMEN; er wird zum Ausgabeordner und zu einem praktischen Auslösetoken für Beschreibungen.

- Wenn Sie mit dem Paket zufrieden sind, führen Sie B - DATENSATZERSTELLUNG einmal aus, um normalisierte Bilder und Beschreibungen für Feinabstimmungen zu exportieren.

- Für "Anprobe"-Looks führen Sie zuerst MODELLPOSE oder T-POSE aus, um Proportionen zu fixieren, und wechseln Sie dann zu Ihrer bevorzugten Szenengruppe.

Danksagungen#

Dieser Workflow implementiert und baut auf den folgenden Arbeiten und Ressourcen auf. Wir danken MickMumpitz herzlich für die New Video Create Workflow-Quellseite und das begleitende Quellarchiv für ihre Beiträge und Wartung. Für autoritative Details verweisen wir auf die Originaldokumentation und -repositories, die unten verlinkt sind.

Ressourcen#

- MickMumpitz/Workflow-Quellseite

- Docs / Release Notes: Workflow-Quellseite von MickMumpitz

- MickMumpitz/Quellarchiv

- Lokale Quelldatei, die für die Einrichtung verwendet wird:

260106_MICKMUMPITZ_CCC_3-8_SMPL.json

- Lokale Quelldatei, die für die Einrichtung verwendet wird:

Hinweis: Die Nutzung der referenzierten Modelle, Datasets und Codes unterliegt den jeweiligen Lizenzen und Bedingungen, die von ihren Autoren und Betreuern bereitgestellt werden.