1. Was ist ToonCrafter?#

ToonCrafter ist eine fortschrittliche KI-Technik, die zwischen zwei Cartoon-Bildern interpoliert, indem vortrainierte Bild-zu-Video-Diffusionspriors verwendet werden. Dadurch kann ToonCrafter interpolierte Videos aus zwei verschiedenen Cartoon-Bildern erzeugen und einen nahtlosen Übergang zwischen ihnen schaffen. Es unterstützt die Videoerstellung von bis zu 16 Frames mit einer Auflösung von 512x320 Pixeln.

2. Wie funktioniert ToonCrafter?#

ToonCrafter ist ein KI-Tool, das entwickelt wurde, um aus statischen Cartoon-Bildern glatte Animationen zu erstellen, indem fortschrittliche KI-Techniken verwendet werden. Es verwendet Latent Diffusion Models (LDMs), um Bilder in einen komprimierten latenten Raum zu kodieren, in dem Rauschen hinzugefügt und dann schrittweise durch einen Denoising-Prozess entfernt wird. Diese Methode erzeugt Zwischenframes zwischen den ursprünglichen Bildern und führt zu flüssigen Animationen.

Ein bemerkenswertes Merkmal von ToonCrafter ist das Toon Rectification Learning. Dieser Prozess passt das KI-Modell, das ursprünglich auf Live-Action-Videos trainiert wurde, an, um Cartoon-Animationen zu verstehen und zu erzeugen. Durch Feinabstimmung des Modells mit einem großen Datensatz hochwertiger Cartoon-Videos lernt ToonCrafter die einzigartigen Bewegungs- und Stilelemente von Cartoons, wie z. B. übertriebene Bewegungen und einfachere Texturen.

ToonCrafter integriert auch einen Mechanismus zur Detail Injection and Propagation. Dieser verwendet einen dual-referenzbasierten 3D-Decoder, um die visuelle Treue der erzeugten Frames aufrechtzuerhalten. Der Decoder analysiert und injiziert Pixel-Details von den Eingabeframes in die neuen Frames, um Konsistenz mit dem ursprünglichen Artwork zu gewährleisten und visuelle Artefakte zu vermeiden.

Zusätzlich bietet ToonCrafter eine skizzenbasierte steuerbare Generierung, die es Animatoren ermöglicht, Skizzen bereitzustellen, die die Erstellung der Zwischenframes leiten. Diese Funktion gibt Künstlern mehr Kontrolle über den Animationsprozess und ermöglicht es ihnen, bestimmte Posen oder Bewegungen anzugeben, um sicherzustellen, dass die endgültige Animation ihren Vorstellungen entspricht.

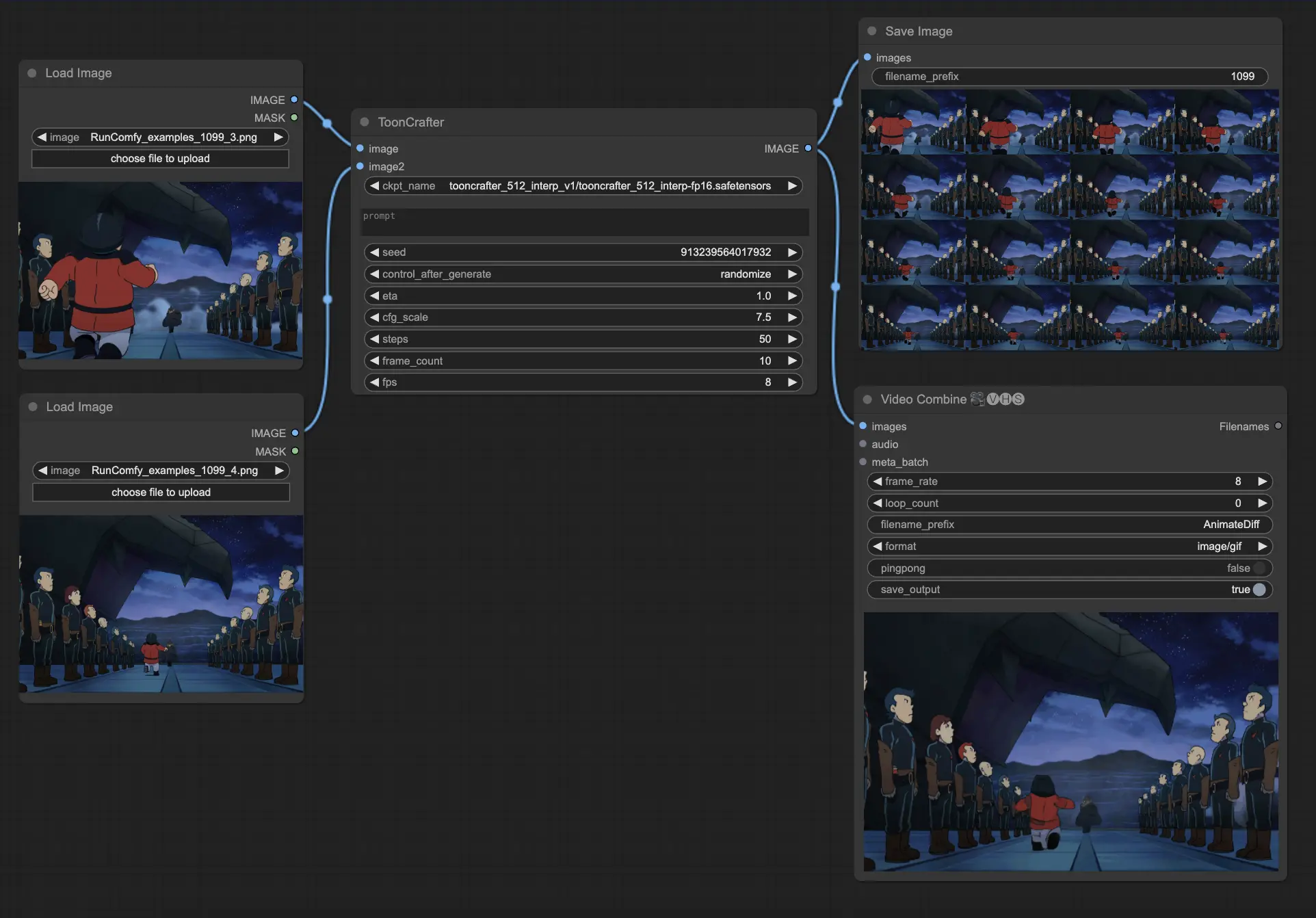

3. Wie man ComfyUI ToonCrafter verwendet#

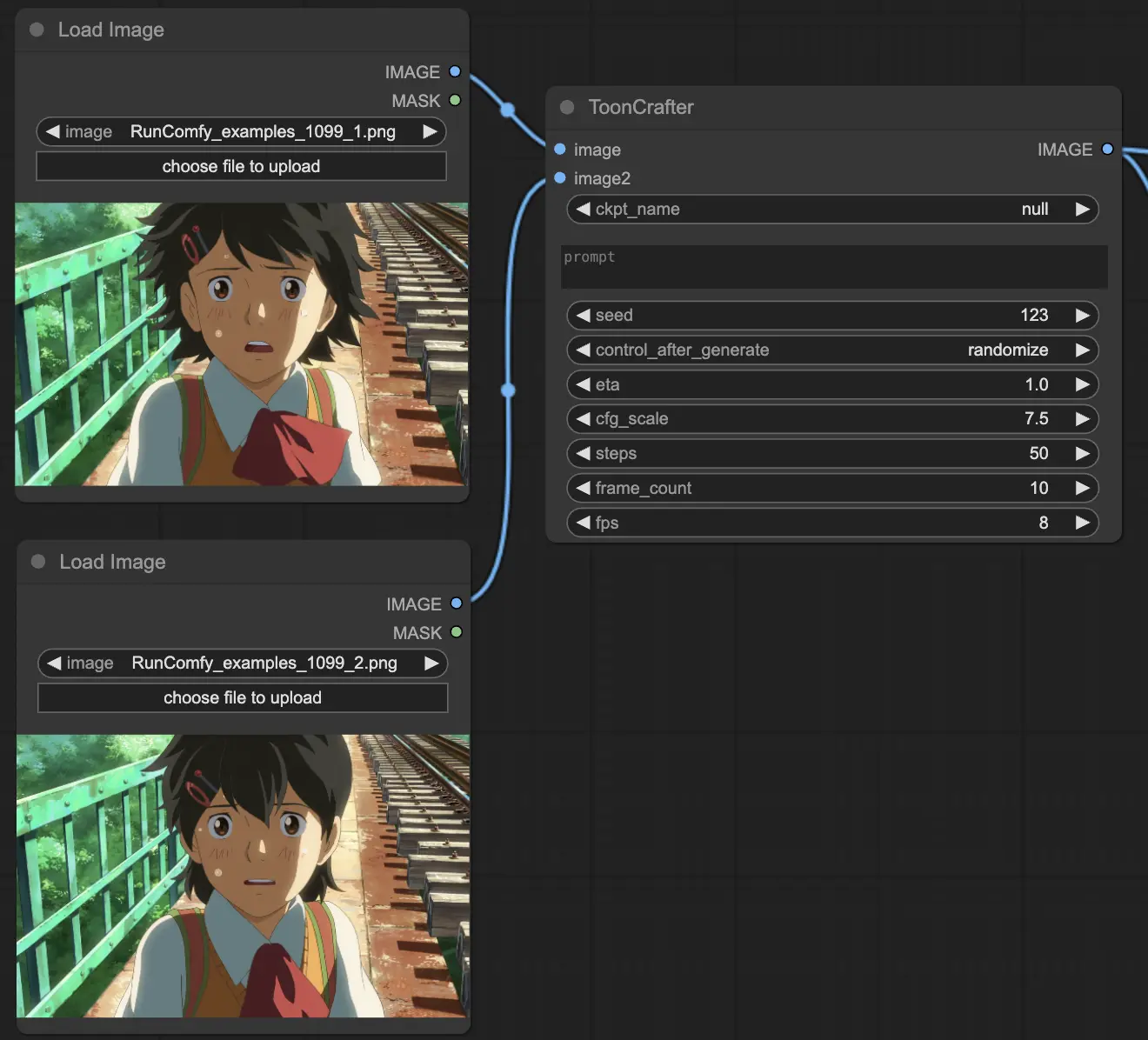

ComfyUI ToonCrafter Node: Eingabeparameter#

Der ToonCrafter-Knoten erfordert mehrere Eingabeparameter, die das Verhalten und das Ergebnis des Interpolationsprozesses bestimmen. Hier ist eine detaillierte Erklärung jedes Parameters:

- image: Das erste Eingabebild (Typ: IMAGE).

- image2: Das zweite Eingabebild (Typ: IMAGE).

- ckpt_name: Der Name des zu verwendenden Checkpoints (Typ: STRING, Optionen: Liste der verfügbaren Checkpoints).

- prompt: Eine textuelle Beschreibung zur Steuerung der Interpolation (Typ: STRING, unterstützt mehrzeilige und dynamische Prompts).

- seed: Ein Seed-Wert zur Zufallszahlengenerierung, um die Reproduzierbarkeit zu gewährleisten (Typ: INT, Standard: 123).

- eta: Der Parameter steuert das Ausmaß des Rauschens, das während des Diffusionsprozesses hinzugefügt wird. In Diffusionsmodellen wird das Rauschen schrittweise reduziert, um das endgültige Bild oder den Frame zu erzeugen. Das Anpassen des eta-Werts bestimmt, wie viel Rauschen bei jeder Iteration dieses Prozesses eingeführt wird. (Typ: FLOAT, Standard: 1.0, Bereich: 0.0 bis 15.0, Schritt: 0.1).

- cfg_scale: Die Skala der classifier-free guidance (Typ: FLOAT, Standard: 7.5, Bereich: 1.0 bis 15.0, Schritt: 0.5).

- steps: Anzahl der Diffusionsschritte (Typ: INT, Standard: 50, Bereich: 1 bis 60, Schritt: 1).

- frame_count: Die Anzahl der zu erzeugenden Frames (Typ: INT, Standard: 10, Bereich: 5 bis 30, Schritt: 1).

- fps: Frames pro Sekunde für das Ausgabevideo (Typ: INT, Standard: 8, Bereich: 1 bis 60, Schritt: 1).

ComfyUI ToonCrafter Node: Ausgabeparameter#

Das Ergebnis des ToonCrafter-Knotens ist eine Sequenz interpolierter Frames, die zur Erstellung eines Videos verwendet werden können. Hier ist, was Sie erwarten können:

- IMAGE: Die erzeugten Frames des interpolierten Videos. Diese Frames werden als Tensor zurückgegeben und können weiterverarbeitet oder als Videodatei gespeichert werden.