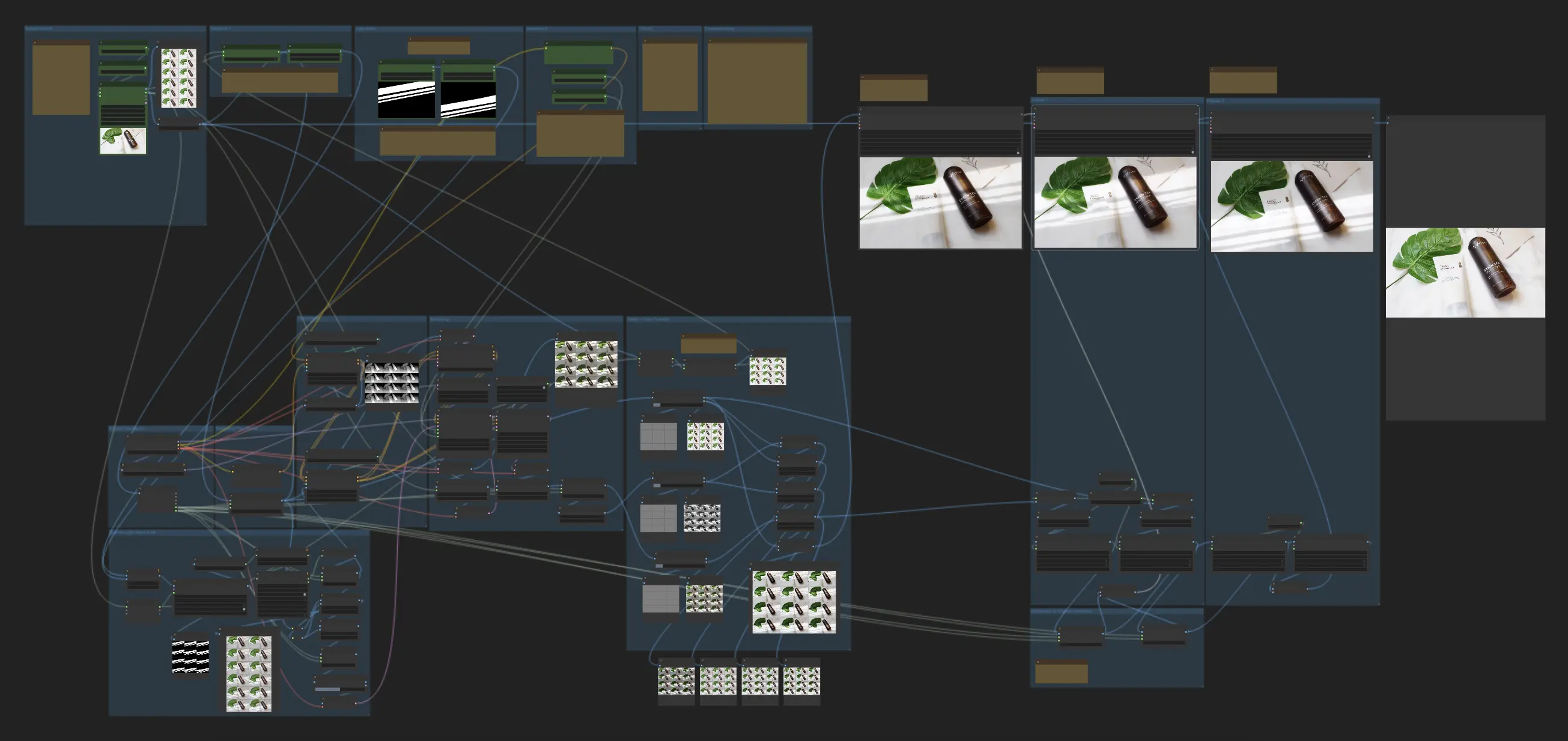

Übersicht des Produkt Beleuchtungs-Video-Workflows#

Dieser Workflow ermöglicht es Ihnen, ein Video und eine oder mehrere Lichtmasken einzugeben, um ein Beleuchtungsvideo zu erstellen. Er unterstützt drei Szenarien:

- Bewegtes Motiv mit einer bewegten Lichtmaske

- Unbewegtes Motiv mit einer bewegten Lichtmaske

- Bewegtes Motiv mit einer stillen Lichtmaske

Obwohl dieser Beleuchtungsvideo-Workflow experimentell ist und möglicherweise keine perfekten Ergebnisse liefert, stellt er einen bedeutenden Schritt in Richtung nicht-animateDiff-Pipelines dar, die Produkttreue über perfekte Frame-Merging im Beleuchtungsvideo-Prozess priorisieren.

Eingaben und Variablen für Beleuchtungsvideo#

Um den Workflow auszuführen und die gewünschten Beleuchtungseffekte im Video zu erzielen, müssen Sie die folgenden Eingaben und Variablen bereitstellen:

- Quellvideo: Das zu beleuchtende Eingabevideo

- Anzahl der Frames: Die Gesamtzahl der zu bearbeitenden Frames

- Anzahl der zu überspringenden Anfangsframes: Die Anzahl der Frames, die vom Anfang des Videos übersprungen werden

- Stilles oder Bewegtes Motiv: Ein boolescher Schalter, um anzugeben, ob das Motiv still oder bewegt ist

- Größe der längeren Seite (Größe ändern): Die Größe, auf die die Frames basierend auf der längeren Seite geändert werden

- Zwei Lichtmasken: Entweder die Anfangs- und Endpositionen der Lichtmaske (für eine bewegte Lichtmaske) oder dieselbe Lichtmaske (für eine stille Lichtmaske)

- Lichtaufforderung: Ein Textaufforderung, die die gewünschte Beleuchtung beschreibt

- CFG: Ein Wert zwischen 1.05 und 3 zur Steuerung der Stärke der Lichtänderungen (höhere Werte führen zu auffälligeren Änderungen, aber auch zu einer höheren Wahrscheinlichkeit von Artefakten)

- Denoise: Ein Wert zwischen 0.3 und 0.6 zur Steuerung der Entstärkungsstärke (höhere Werte führen zu weniger Flimmern, können jedoch dazu führen, dass die Lichtmaske mehr wie ein Filter aussieht)

Wie der Beleuchtungs-Video-Workflow funktioniert#

- Der Workflow verwendet IC-Light, um jeden Frame unabhängig zu beleuchten.

- Für jeden Frame wird ein Latent basierend auf einer Mischung aus dem Motiv-Frame und dem entsprechenden Lichtmasken-Frame generiert.

- Das Latent wird bei einem niedrigen Denoise-Wert generiert, um die Lichtmaske auf das Endergebnis zu erzwingen.

- Da IC-Light bei niedrigen Entstärkungswerten Details verlieren kann, werden die Details und Originalfarben am Ende des Workflows mithilfe der Frequenztrennung zurückübertragen, um die Videoqualität nach der Beleuchtung zu erhalten.