Wan2.1 Stand In: 单图像角色一致性视频生成用于ComfyUI#

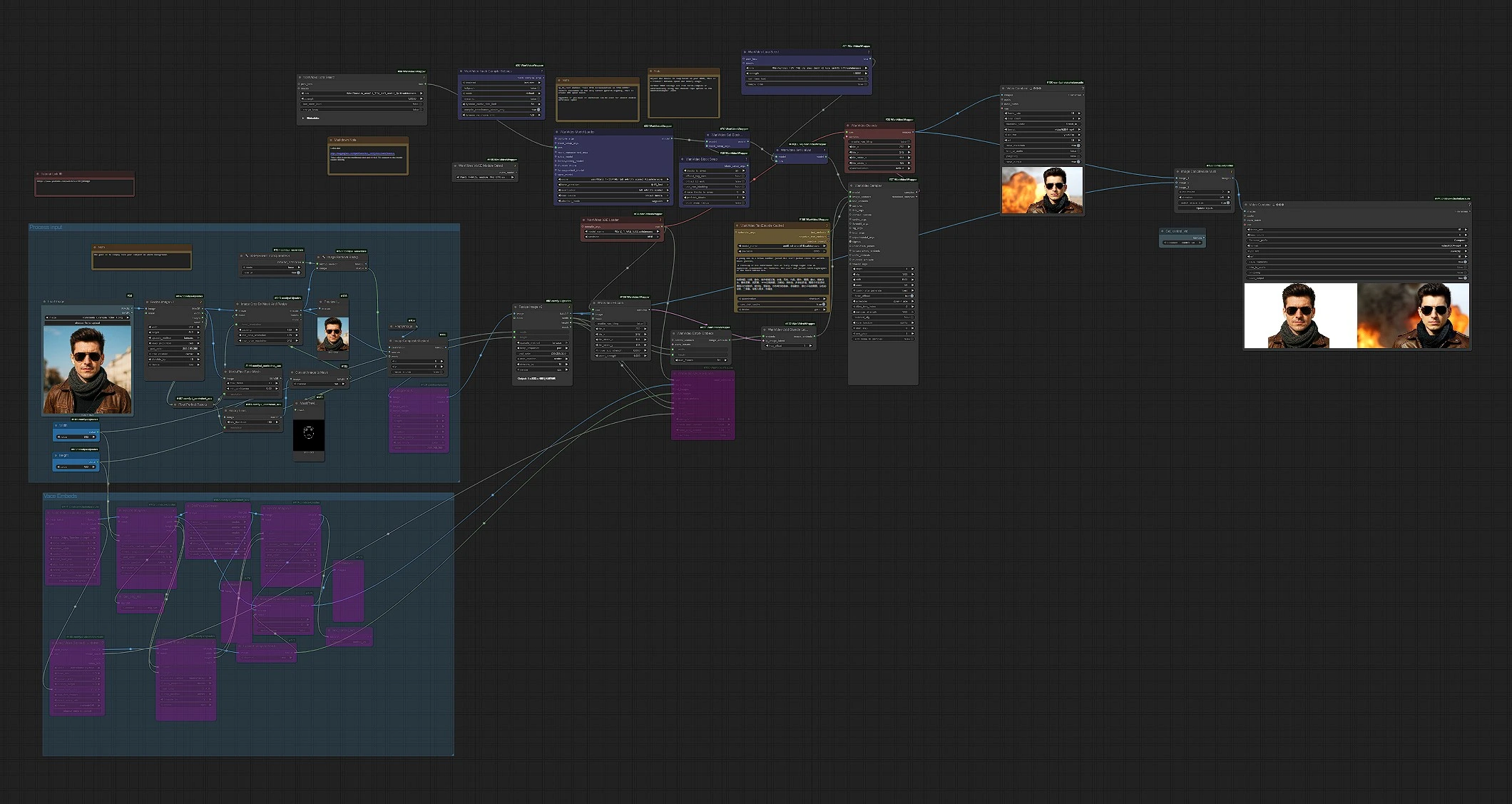

此工作流将一个参考图像转化为短视频,其中相同的面孔和风格在各帧中持续。由Wan 2.1系列和专门构建的Stand In LoRA驱动,专为需要稳定身份且设置最小化的故事讲述者、动画师和头像创作者设计。Wan2.1 Stand In流水线处理背景清理、裁剪、遮罩和嵌入,因此您可以专注于您的提示和动作。

当您需要从单张照片中获得可靠的身份连续性、快速迭代和出口准备的MP4时,请使用Wan2.1 Stand In工作流,还可选择附带并排比较输出。

Comfyui Wan2.1 Stand In工作流中的关键模型#

- Wan 2.1 Text‑to‑Video 14B。主要生成器,负责时序一致性和运动。支持480p和720p生成,并与LoRAs整合以实现目标行为和风格。Model card

- Wan‑VAE for Wan 2.1。高效的时空VAE,在保持运动线索的同时编码和解码视频潜变量。它支撑此工作流中的图像编码/解码阶段。查看Wan 2.1模型资源和Diffusers集成说明以了解VAE使用。Model hub • Diffusers docs

- Stand In LoRA for Wan 2.1。角色一致性适配器,训练以从单个图像锁定身份;在此图中加载模型时应用以确保身份信号在基础上融合。Files

- LightX2V Step‑Distill LoRA (可选)。轻量级适配器,可改善指导行为和效率与Wan 2.1 14B。Model card

- VACE module for Wan 2.1 (可选)。通过视频感知条件启用运动和编辑控制。工作流中包含一个嵌入路径,您可以启用以进行VACE控制。Model hub

- UMT5‑XXL文本编码器。为Wan 2.1文本到视频提供强大的多语言提示编码。Model card

如何使用Comfyui Wan2.1 Stand In工作流#

概览:加载干净的正面参考图像,工作流准备一个面向面部的遮罩和合成,编码为潜变量,将该身份合并到Wan 2.1图像嵌入中,然后采样视频帧并导出MP4。保存两个输出:主要渲染和并排比较。

处理输入(组)#

从一个光线良好、正面朝向的图像开始,背景简单。流水线在LoadImage (#58)中加载您的图像,使用ImageResizeKJv2 (#142)标准化大小,并使用MediaPipe-FaceMeshPreprocessor (#144)和BinaryPreprocessor (#151)创建面部中心遮罩。在TransparentBGSession+ (#127)和ImageRemoveBackground+ (#128)中去除背景,然后使用ImageCompositeMasked (#108)将主体合成到干净的画布上以最小化颜色渗透。最后,ImagePadKJ (#129)和ImageResizeKJv2 (#68)对齐生成的长宽比;准备好的帧通过WanVideoEncode (#104)编码为潜变量。

VACE嵌入(可选组)#

如果您希望从现有剪辑中获得运动控制,请使用VHS_LoadVideo (#161)加载它,并可选地使用VHS_LoadVideo (#168)加载第二个指南或alpha视频。帧通过DWPreprocessor (#163)获取姿势线索,通过ImageResizeKJv2 (#169)进行形状匹配;ImageToMask (#171)和ImageCompositeMasked (#174)让您精确混合控制图像。WanVideoVACEEncode (#160)将这些转化为VACE嵌入。此路径是可选的;当您仅希望从Wan 2.1获得文本驱动的运动时,请保持不变。

模型、LoRAs和文本#

WanVideoModelLoader (#22)加载Wan 2.1 14B基础加上Stand In LoRA,因此身份从一开始就被锁定。通过WanVideoBlockSwap (#39)和WanVideoSetBlockSwap (#70)提供VRAM友好的速度功能。您可以通过WanVideoSetLoRAs (#79)附加额外的适配器,例如LightX2V。使用UMT5‑XXL在后台进行多语言控制,提示使用WanVideoTextEncodeCached (#159)进行编码。保持提示简洁且描述性;强调主体的服装、角度和照明以补充Stand In身份。

身份嵌入和采样#

WanVideoEmptyEmbeds (#177)建立图像嵌入的目标形状,WanVideoAddStandInLatent (#102)注入您编码的参考潜变量以在时间上携带身份。结合的图像和文本嵌入输入WanVideoSampler (#27),使用配置的调度器和步骤生成潜变量视频序列。采样后,帧由WanVideoDecode (#28)解码并在VHS_VideoCombine (#180)中写入MP4。

比较视图和导出#

为了即时质量保证,ImageConcatMulti (#122)将生成的帧与调整大小的参考并排堆叠,以便逐帧判断相似度。VHS_VideoCombine (#74)将其保存为单独的“比较”MP4。因此,Wan2.1 Stand In工作流在不额外努力的情况下生成干净的最终视频和并排检查。

Comfyui Wan2.1 Stand In工作流中的关键节点#

WanVideoModelLoader(#22)。加载Wan 2.1 14B并在模型初始化时应用Stand In LoRA。保持Stand In适配器在此连接而不是稍后在图中,以便身份在去噪路径中始终得到强化。与WanVideoVAELoader(#38)配对以匹配Wan‑VAE。WanVideoAddStandInLatent(#102)。将您编码的参考图像潜变量融合到图像嵌入中。如果身份漂移,增加其影响;如果运动似乎过于受限,稍微减少它。WanVideoSampler(#27)。主要生成器。调整步骤、调度器选择和指导策略在细节、运动丰富度和时间稳定性上有最大影响。推高分辨率或长度时,考虑调整采样器设置而不是更改上游的任何内容。WanVideoSetBlockSwap(#70)与WanVideoBlockSwap(#39)。通过在设备之间交换注意力块来交换GPU内存以提高速度。如果看到内存不足错误,增加卸载;如果有余量,减少卸载以更快迭代。ImageRemoveBackground+(#128)和ImageCompositeMasked(#108)。这些确保主体被干净地隔离并放置在中性画布上,从而减少颜色污染并改善Stand In身份在各帧中的锁定。VHS_VideoCombine(#180)。控制主MP4输出的编码、帧率和文件命名。用它设置您偏好的FPS和交付的质量目标。

可选附加功能#

- 使用正面、光线均匀的参考在简单背景上以获得最佳结果。小旋转或严重遮挡可能削弱身份转移。

- 保持提示简洁;描述与您的参考匹配的服装、情绪和光照。避免与Wan2.1 Stand In信号相冲突的面部描述符。

- 如果VRAM紧张,首先增加区块交换或降低分辨率。如果有余量,在增加步骤之前尝试在加载器堆栈中启用编译优化。

- Stand In LoRA是非标准的,必须在模型加载时连接;按照此图中的模式以保持身份稳定。LoRA文件:Stand‑In

- 为了高级控制,启用VACE路径以使用引导剪辑引导运动。如果您仅希望从Wan 2.1获得纯文本驱动的运动,请首先禁用此功能。

资源

- Wan 2.1 14B T2V: Hugging Face

- Wan 2.1 VACE: Hugging Face

- Stand In LoRA: Hugging Face

- LightX2V Step‑Distill LoRA: Hugging Face

- UMT5‑XXL encoder: Hugging Face

- WanVideo wrapper nodes: GitHub

- KJNodes utilities用于调整大小、填充和遮罩:GitHub

- ControlNet Aux预处理器(MediaPipe Face Mesh, DWPose):GitHub

致谢#

此工作流实现并构建在ArtOfficial Labs的作品和资源之上。我们感谢ArtOfficial Labs和Wan 2.1作者为Wan2.1 Demo的贡献和维护。有关权威详细信息,请参阅以下链接的原始文档和存储库。

资源#

- Wan 2.1/Wan2.1 Demo

- 文档/发行说明:Wan2.1 Demo

注意:所引用的模型、数据集和代码的使用受其作者和维护者提供的各自许可和条款的约束。