A técnica Hallo2 foi desenvolvida por Jiahao Cui, Hui Li, Yao Yao, Hao Zhu, Hanlin Shang, Kaihui Cheng, Hang Zhou, Siyu Zhu e Jingdong Wang da Fudan University e Baidu Inc. Para mais informações, visite Hallo2 GitHub. Os nós e o fluxo de trabalho ComfyUI_Hallo2 foram desenvolvidos por smthemex. Para mais detalhes, visite ComfyUI_Hallo2 GitHub. Todos os créditos às suas contribuições.

1. Sobre o Hallo2#

Hallo2 é um modelo de ponta para gerar vídeos de animação de retratos guiados por áudio, de longa duração e em resolução 4K. Ele se baseia no modelo original Hallo com várias melhorias importantes:

- Suporta a geração de vídeos muito mais longos, de até dezenas de minutos ou até horas

- Gera vídeos em resolução 4K

- Permite controlar expressão e pose usando prompts textuais além do áudio

O Hallo2 alcança isso usando técnicas avançadas como aumento de dados para manter a consistência ao longo de longas durações, quantização vetorial de códigos latentes para resolução 4K e um processo de remoção de ruído aprimorado guiado por áudio e texto.

2. Características Técnicas do Hallo2#

Hallo2 combina vários modelos e técnicas avançadas de IA para criar seus vídeos de retratos de alta qualidade:

- Diffusion Model: Este é o "motor" principal que gera os quadros de vídeo. Começa com ruído aleatório e gradualmente o refina para corresponder ao resultado desejado, guiado pelos prompts de áudio e texto.

- 3D U-Net: Este é um tipo de rede neural que atua como o "escultor" no processo de difusão. Ele observa o quadro ruidoso atual, o áudio e as instruções de texto, e sugere como alterar o ruído para que pareça mais com o retrato final.

- Audio Encoder: O Hallo2 usa um modelo chamado Wav2Vec2 como seus "ouvidos" para entender o áudio, convertendo a forma de onda bruta em uma representação compacta que captura tom, velocidade e conteúdo da fala.

- Face Detector: Para ajudá-lo a focar na animação do rosto, o Hallo2 usa um modelo de detecção facial para localizar automaticamente o rosto do retrato na imagem de referência. Ele então sabe onde aplicar os movimentos labiais e de expressão.

- Image Compressor: Para trabalhar eficientemente com imagens em alta resolução 4K, o Hallo2 usa um tipo especial de modelo autoencoder (VQ-VAE) para compactá-las em uma representação "latente" menor, e depois decodificá-las de volta para 4K no final. Isso é como os JPEGs reduzem o tamanho dos arquivos de imagem enquanto preservam a qualidade.

- Augmentation Tricks: Para ajudar a manter a qualidade em vídeos longos, o Hallo2 aplica alguns "aumentos de dados" inteligentes aos quadros gerados anteriormente antes de usá-los para influenciar o próximo quadro. Isso inclui ocasionalmente apagar partes aleatórias ou adicionar ruído sutil. Isso ajuda a evitar erros acumulados que poderiam, de outra forma, se acumular e arruinar a consistência ao longo do tempo.

Em resumo - o Hallo2 recebe áudio e uma imagem de retrato, tem um "agente" de IA que esculpe os quadros de vídeo para correspondê-los enquanto permanece fiel ao retrato original, e emprega alguns truques extras para manter tudo sincronizado e coerente, mesmo em vídeos longos. Todas essas partes trabalham juntas em um pipeline de múltiplas etapas para produzir os resultados impressionantes que você vê.

3. Como Usar o ComfyUI Hallo2 Workflow#

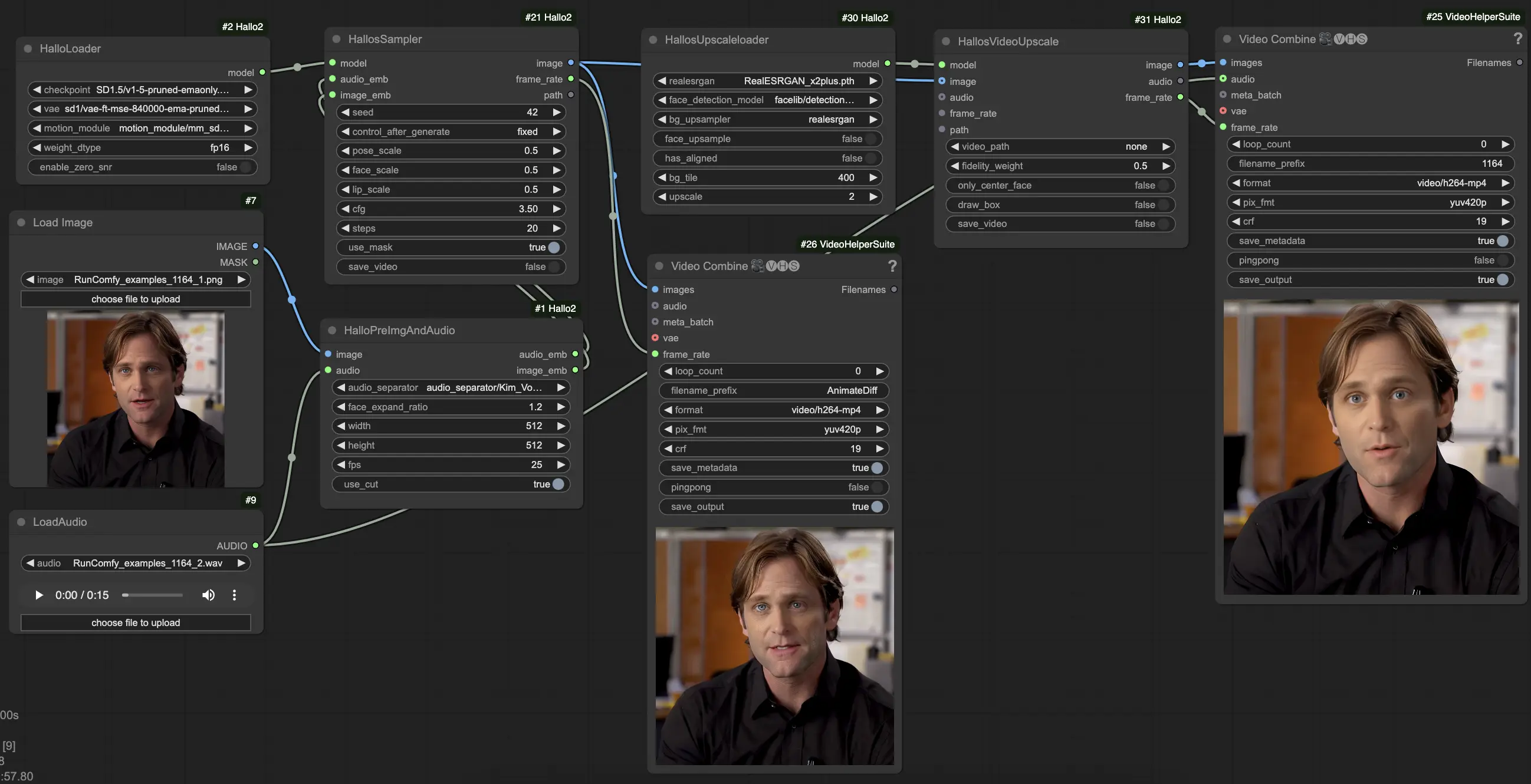

O Hallo2 foi integrado ao ComfyUI por meio de um fluxo de trabalho personalizado com vários nós especializados. Veja como usá-lo:

- Carregue sua imagem de retrato de referência usando o nó

LoadImage. Esta deve ser um retrato claro de frente. (Dicas: Quanto melhor enquadrada e iluminada sua imagem de referência, melhores serão os resultados. Evite perfis laterais, oclusões, fundos ocupados, etc.) - Carregue seu áudio de condução usando o nó

LoadAudio. Deve corresponder ao humor que você deseja que o retrato expresse. - Conecte a imagem e o áudio ao nó

HalloPreImgAndAudio. Isso pré-processa a imagem e o áudio em embeddings. Parâmetros chave:audio_separator: Modelo para separar fala de ruído de fundo. Geralmente deixe no padrão.face_expand_ratio: Quanto expandir a região do rosto detectada. Valores mais altos incluem mais cabelo/fundo.width/height: Resolução de geração. Valores mais altos são mais lentos, mas mais detalhados. 512-1024 quadrado é um bom equilíbrio.fps: FPS de vídeo alvo. 25 é um bom padrão.

- Carregue o modelo principal Hallo2 usando o nó

HalloLoader. Aponte para seu checkpoint Hallo2, VAE e arquivos do módulo de movimento. - Conecte os embeddings de imagem e áudio pré-processados, juntamente com o modelo carregado, ao nó

HalloSampler. Isso realiza a geração real do vídeo. Parâmetros chave:seed: Semente aleatória que determina detalhes menores. Mude se você não gostar do primeiro resultado.pose_scale/face_scale/lip_scale: Quanto escalar a intensidade de pose, expressão facial e movimentos labiais. 1.0 = intensidade total, 0.0 = congelado.cfg: Escala de orientação sem classificador. Maior = segue mais de perto o condicionamento, mas é menos diverso.steps: Número de etapas de remoção de ruído. Mais etapas = melhor qualidade, mas mais lento.

- Neste ponto, você pode visualizar o vídeo gerado. Para melhorar ainda mais a qualidade com super-resolução, adicione os nós

HallosUpscaleloadereHallosVideoUpscaleao final da cadeia. O carregador de upscale lê um modelo de upscale pré-treinado, enquanto o nó de upscale realiza o upscale para 4K.