FLUX Redux ACE Face Swap Workflow ComfyUI#

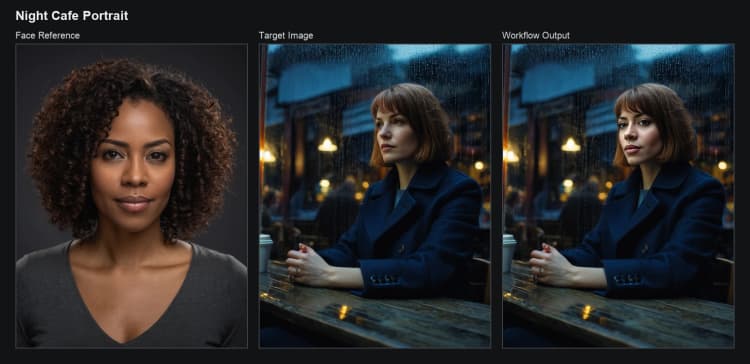

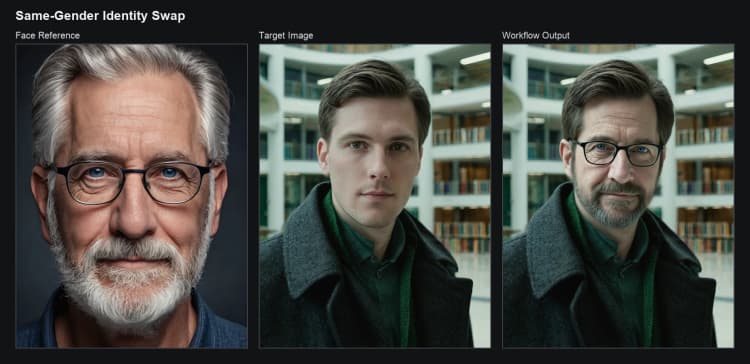

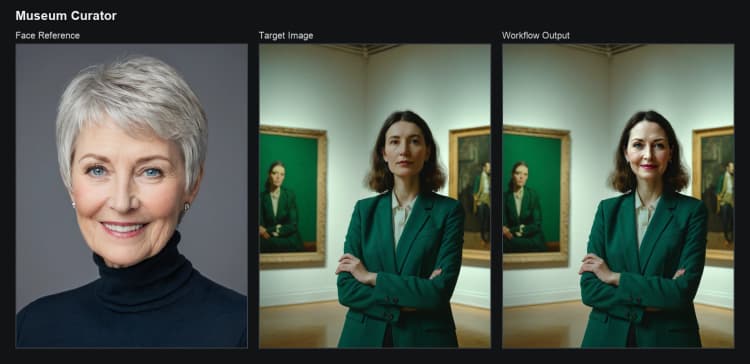

FLUX Redux ACE Face Swap est un workflow de remplacement de visage guidé par référence pour ComfyUI qui combine l'inpainting FLUX.1 Fill avec l'orientation d'identité/style FLUX.1 Redux. Fournissez une référence de visage propre et une image cible/arrière-plan, et le workflow transfère l'identité tout en préservant la pose, les vêtements, l'éclairage, la composition et la scène.

Conçu pour les créateurs qui ont besoin d'un remplacement de visage photoréaliste reproductible, le pipeline FLUX Redux ACE Face Swap gère la détection, le masquage intelligent, le conditionnement de l'inpainting, l'orientation visuelle basée sur Redux, et un passage de détail final. Vous pouvez orienter les résultats avec une courte invite, ou la laisser vide pour un transfert d'identité pur.

Modèles clés dans le workflow ComfyUI FLUX Redux ACE Face Swap#

- Black Forest Labs FLUX.1‑Redux‑dev. Adaptateur qui extrait les indices de style et d'identité d'une image pour guider les modifications; utilisé ici pour garder le visage de référence cohérent à travers les générations. Carte du modèle

- Black Forest Labs FLUX.1‑Fill‑dev. Transformateur de flux rectifié spécialisé pour l'inpainting; remplit la région du visage masqué tout en suivant votre invite et l'orientation Redux. Carte du modèle

- Black Forest Labs FLUX.1‑dev encodeurs de texte et autoencodeur. Les encodeurs de texte CLIP‑L et T5‑XXL et l'AE utilisés pour le codage/décodage latent dans la famille FLUX. Carte du modèle

- Modèles d'analyse de visage InsightFace. Détection et alignement de visage robustes utilisés pour localiser le visage de référence pour l'orientation. GitHub

- CLIP Vision (SigLIP, ViT patch14 @ 384). Encodeur de vision utilisé par l'étape d'orientation Redux pour comparer les caractéristiques de l'image et stabiliser les indices d'identité/style. Carte du modèle

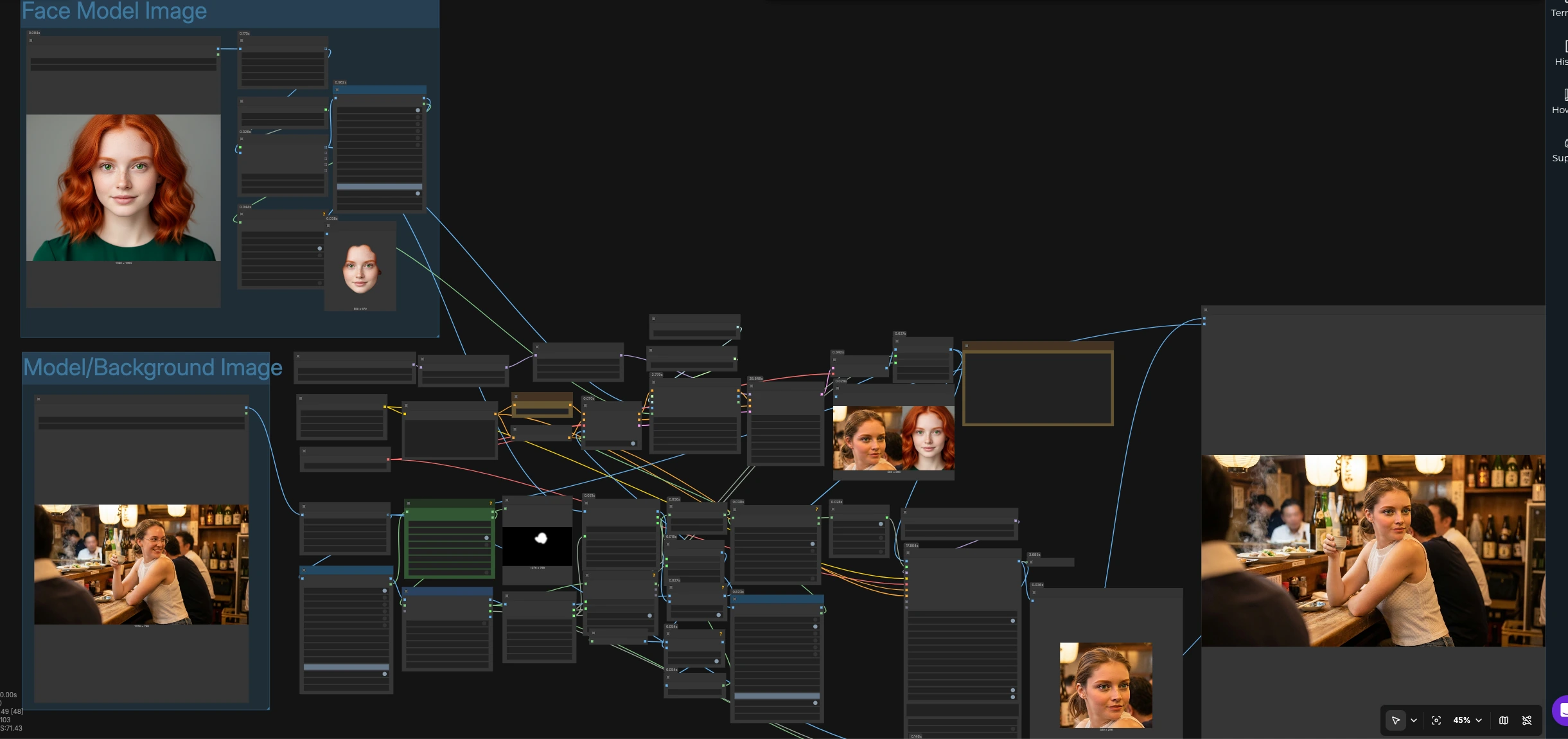

Comment utiliser le workflow ComfyUI FLUX Redux ACE Face Swap#

Le workflow fonctionne sur deux pistes coordonnées : une piste de visage de référence pour extraire les indices d'identité, et une piste d'image cible pour préparer une région de visage éditable. Elles convergent dans l'inpainting FLUX avec l'orientation Redux, puis un passage de détail par région et une restauration finale.

Configuration du visage de référence

- Déposez votre référence de visage dans

LoadImage(#19). Le pipeline contraint la taille pour la stabilité, puisFaceAnalysisModels(#39) etFaceBoundingBox(#38) trouvent le visage.LayerMask: PersonMaskUltra V2(#72) crée un masque de visage propre etGrowMaskWithBlur(#44) adoucit les bords pour un mélange naturel. - Cette image de référence et le masque alimentent

ReduxAdvanced(#40) avec CLIP‑Vision. Redux extrait les caractéristiques visuelles qui définissent l'identité, la ligne de cheveux et le style local, produisant un conditionnement qui guidera l'échange.

Configuration de l'image cible

- Déposez l'image cible/arrière-plan dans

LoadImage(#86). Le workflow segmente le sujet avecLayerMask: PersonMaskUltra V2(#69), étend et nettoie le masque viaGrowMaskWithBlur(#70), puisCropByMask V2(#64) isole une région d'édition précise. - La coupe cible est redimensionnée (

ImageResize+(#32)), et le visage de référence est redimensionné pour correspondre (ImageResize+(#10)). Deux nœuds d'assistance (ImageConcanate(#21) et (#11)) assemblent une toile jumelée et une image de masque correspondante qui définissent la zone éditable pour l'inpainting.

Guidage de l'inpainting conscient de l'identité

CLIPTextEncode(#26) accepte une invite optionnelle pour influencer le style ou la scène (par exemple : "préserver l'éclairage et l'arrière-plan, mélange naturel").FluxGuidance(#27) etConditioningZeroOut(#35) façonnent le conditionnement positif/négatif pour l'inpainting.InpaintModelConditioning(#16) transforme la coupe cible, le masque et le VAE en un latent avec un conditionnement aligné. Ce conditionnement, combiné au conditionnement Redux deReduxAdvanced(#40), forme l'orientation "ACE" qui garde l'identité de référence tout en respectant la composition cible.

Génération et raffinement

KSampler(#28) exécute FLUX.1‑Fill‑dev à travers la région masquée pour remplacer le visage tout en suivant les indices Redux. Le résultat décodé est recadré à la zone de travail (ImageCrop(#17)) pour un raffinement de haute qualité.DetailerForEach(#50) utilise SEGS du masque cible (MaskToSEGS(#52)) pour appliquer un passage d'amélioration par région avec le modèle FLUX, améliorant la peau, les yeux et les bords des cheveux pour un échange convaincant.

Restauration et sauvegarde

RestoreCropBox(#66) composite la région de visage affinée sur le cadre cible original avec la boîte de recadrage originale, assurant un mélange homogène.PreviewImage(#80) etImage Comparer (rgthree)(#77) vous aident à vérifier les différences A/B, etSaveImage(#81) enregistre le résultat final.

Nœuds clés dans le workflow ComfyUI FLUX Redux ACE Face Swap#

ReduxAdvanced (#40)

- Central pour la cohérence de l'identité, ce nœud consomme l'image de référence, son masque, et les caractéristiques CLIP‑Vision avec le modèle de style FLUX.1‑Redux‑dev. Augmentez son influence si l'échange s'écarte de la référence; diminuez-la si l'éclairage ou le maquillage de la cible nécessite plus de liberté. Utilisez le mode masqué pour une orientation de visage uniquement ou étendez le masque pour inclure la ligne de cheveux au besoin. Repo, modèle Redux

InpaintModelConditioning (#16)

- Construit le paquet latent, masque et conditionnement pour FLUX.1‑Fill‑dev. Pour des bords propres, gardez un masque doux avec quelques pixels de flou; resserrez-le lorsque l'échange doit éviter de toucher les cheveux ou les accessoires. Si l'invite est optionnelle, comptez sur l'orientation Redux; ajoutez une courte invite seulement lorsque vous avez besoin de style ou de direction de scène.

KSampler (#28)

- Conduit le remplacement de visage réel avec FLUX.1‑Fill‑dev en utilisant le latent de

InpaintModelConditioninget le conditionnement positif amélioré par Redux. Utilisez un débruitage modéré pour respecter la pose et l'éclairage; augmentez-le seulement lorsque le visage cible nécessite un redraw plus fort. Le verrouillage des graines aide à reproduire une correspondance d'identité choisie à travers les prises. modèle Fill

DetailerForEach (#50)

- Effectue un passage d'amélioration par région sur la coupe générée. Il utilise SEGS dérivés du masque cible pour se concentrer sur les zones faciales clés. Augmentez la force de détail pour la texture de la peau et la clarté des yeux; diminuez-la pour un mélange plus doux, de qualité beauté. Impact Pack

FaceBoundingBox (#38)

- Détecte et isole le visage de référence. Si le workflow saisit la mauvaise région dans les prises multi-personnes, augmentez le seuil de confiance ou pré-recadrez votre référence pour plus de clarté. ComfyUI_FaceAnalysis, InsightFace

LayerMask: PersonMaskUltra V2 (#69)

- Génère des masques de personne/visage pour les pistes de référence et cible. Agrandissez légèrement le masque pour un mélange plus sûr; rétrécissez-le pour éviter les débordements de la ligne de cheveux ou les boucles d'oreilles. Des masques propres ici se traduisent directement par moins d'artefacts plus tard. Repo

LayerUtility: RestoreCropBox (#66)

- Réassemble le visage affiné dans le cadre original en utilisant la boîte de recadrage stockée. Ajustez le floutage à ce stade uniquement si vous voyez un bord visible entre la région éditée et l'arrière-plan.

Extras optionnels#

- Utilisez une référence frontale nette avec une expression neutre et un éclairage similaire à la cible pour un meilleur transfert d'identité.

- Gardez les invites courtes et descriptives; laissez FLUX Redux ACE Face Swap porter l'identité tandis que FLUX.1 Fill respecte la composition.

- Si vous préférez un look de portrait spécifique, échangez votre propre LoRA avant l'échantillonnage; des forces subtiles se mélangent généralement le mieux.

- Pour une itération plus rapide lors du prototypage, activez un nœud de mise en cache ou d'accélération compatible avec votre configuration, puis revenez aux paramètres de qualité complète pour les finales.

- Ayez toujours les droits et le consentement pour les visages que vous traitez, et suivez les termes de licence FLUX.1 [dev] sur les cartes de modèle liées ci-dessus.

Remerciements#

Ce workflow implémente et s'appuie sur les travaux et ressources suivants. Nous remercions chaleureusement RunningHub pour la source de workflow RunningHub, Black Forest Labs pour le modèle FLUX.1-Redux-dev, et Black Forest Labs pour le modèle FLUX.1-Fill-dev pour leurs contributions et maintenance. Pour des détails autoritaires, veuillez vous référer à la documentation et aux dépôts originaux liés ci-dessous.

Ressources#

- Source de workflow RunningHub/RunningHub

- Docs / Notes de version : runninghub.ai post

- black-forest-labs/FLUX.1-Redux-dev

- Hugging Face : black-forest-labs/FLUX.1-Redux-dev

- black-forest-labs/FLUX.1-Fill-dev

- Hugging Face : black-forest-labs/FLUX.1-Fill-dev

Note : L'utilisation des modèles, ensembles de données et codes référencés est soumise aux licences et termes respectifs fournis par leurs auteurs et mainteneurs.