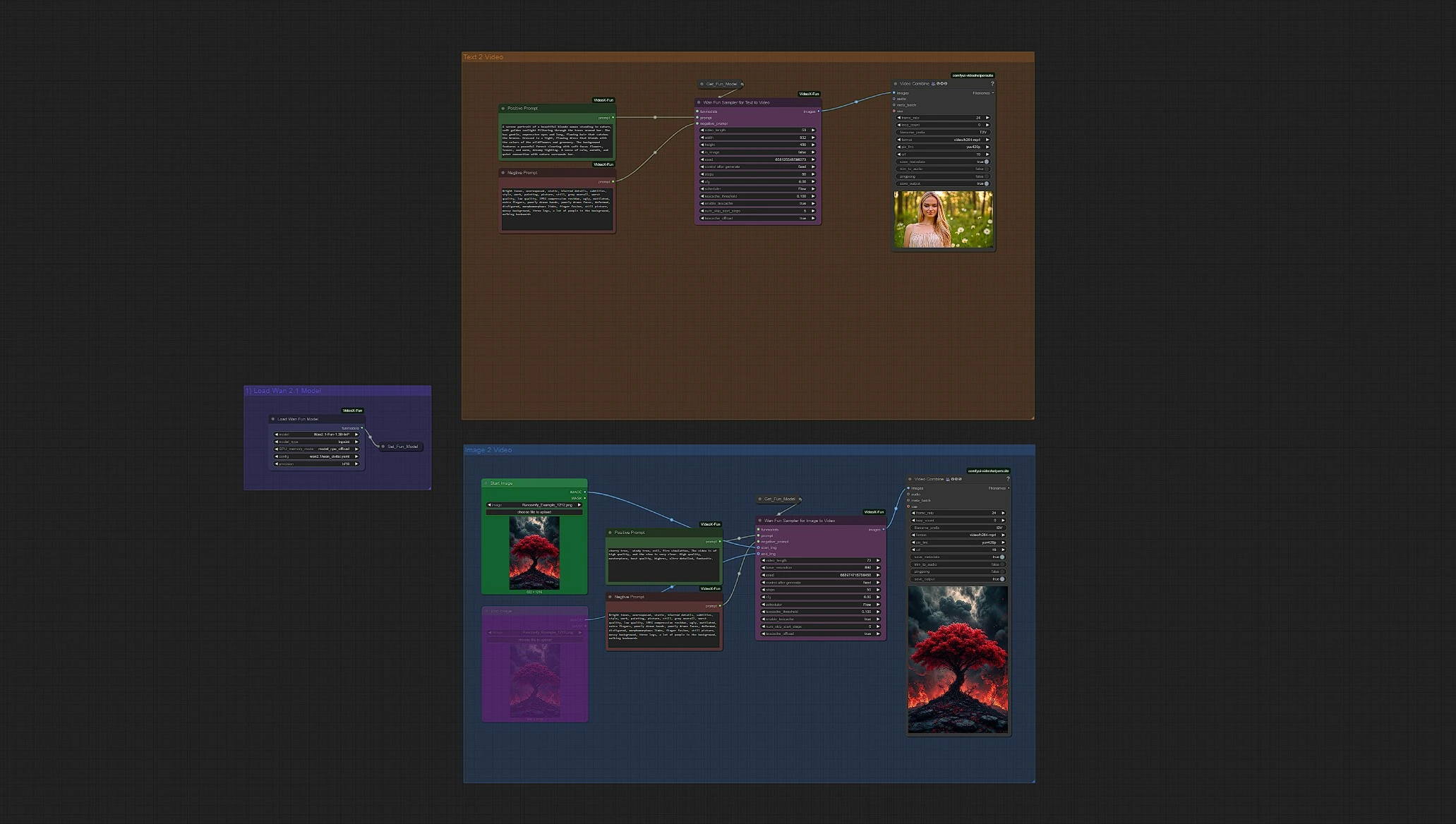

Wan 2.1 Fun | Bild-zu-Video und Text-zu-Video KI-Generierung#

Wan 2.1 Fun Bild-zu-Video und Text-zu-Video bietet einen hochgradig vielseitigen KI-Video-Generierungs-Workflow, der sowohl statische Visuals als auch reine Vorstellungskraft zum Leben erweckt. Angetrieben von der Wan 2.1 Fun-Modellfamilie ermöglicht dieser Workflow den Nutzern, ein einzelnes Bild in ein vollständiges Video zu animieren oder ganze Bewegungssequenzen direkt aus Text-Prompts zu generieren – kein Ausgangsmaterial erforderlich.

Ob Sie surreale Traumlandschaften aus wenigen Worten erschaffen oder ein Konzeptkunstwerk in einen lebendigen Moment verwandeln, dieses Wan 2.1 Fun-Setup macht es einfach, kohärente, stilisierte Videoausgaben zu produzieren. Mit Unterstützung für sanfte Übergänge, flexible Dauer-Einstellungen und mehrsprachige Prompts ist Wan 2.1 Fun perfekt für Geschichtenerzähler, digitale Künstler und Kreative, die visuelle Grenzen mit minimalem Aufwand erweitern möchten.

Warum Wan 2.1 Fun Bild-zu-Video + Text-zu-Video verwenden?#

Der Wan 2.1 Fun Bild-zu-Video und Text-zu-Video-Workflow bietet eine einfache und ausdrucksstarke Möglichkeit, hochwertige Videos entweder aus einem Bild oder einem einfachen Text-Prompt zu generieren:

- Wandeln Sie ein einzelnes Bild in Bewegung um mit automatischen Übergängen und Effekten

- Generieren Sie Videos direkt aus Text-Prompts, mit intelligenter Frame-Vorhersage

- Enthält InP (Start/End-Frame-Vorhersage) für kontrollierte visuelle Erzählungen

- Funktioniert mit 1.3B und 14B Modellvarianten für skalierbare Qualität und Geschwindigkeit

- Großartig für kreative Ideenfindung, Geschichtenerzählen, animierte Szenen und filmische Sequenzen

Ob Sie eine Szene von Grund auf visualisieren oder ein Standbild animieren, dieser Wan 2.1 Fun-Workflow bietet schnelle, zugängliche und visuell beeindruckende Ergebnisse mit Wan 2.1 Fun-Modellen.

Wie verwendet man Wan 2.1 Fun Bild-zu-Video + Text-zu-Video?#

Überblick über Wan 2.1 Fun Bild-zu-Video + Text-zu-Video#

Load WanFun Model: Laden Sie die entsprechende Wan 2.1 Fun-Modellvariante (1.3B oder 14B)Enter Prompts or Upload Image: Unterstützt sowohl Text-Prompts als auch Bild-Eingaben mit ihrer separaten GruppeSet Inference Settings: Passen Sie Frames, Dauer, Auflösung und Bewegungsoptionen anWan Fun Sampler: Verwendet WanFun für Start/End-Vorhersage und zeitliche KohärenzSave Video: Das Ausgabevideo wird nach dem Sampling automatisch gerendert und gespeichert

Schnellstart-Schritte:#

- Wählen Sie Ihr

Wan 2.1 Fun-Modell in der Lade-Modell-Gruppe - Geben Sie positive und negative Prompts ein, um die Generierung zu leiten

- Wählen Sie Ihren Eingabemodus:

- Laden Sie ein Bild für die Image-to-Video-Gruppe hoch

- Oder verlassen Sie sich allein auf Text-Prompts für die Text-to-Video-Gruppe

- Passen Sie die Einstellungen im

Wan Fun Sampler-Knoten an (Frames, Auflösung, Bewegungsoptionen) - Führen Sie den Workflow aus, indem Sie die

Queue Prompt-Schaltfläche klicken - Sehen Sie sich Ihr endgültiges Wan 2.1 Fun-Video aus dem Video Save-Knoten (

Outputs-Ordner) an und laden Sie es herunter

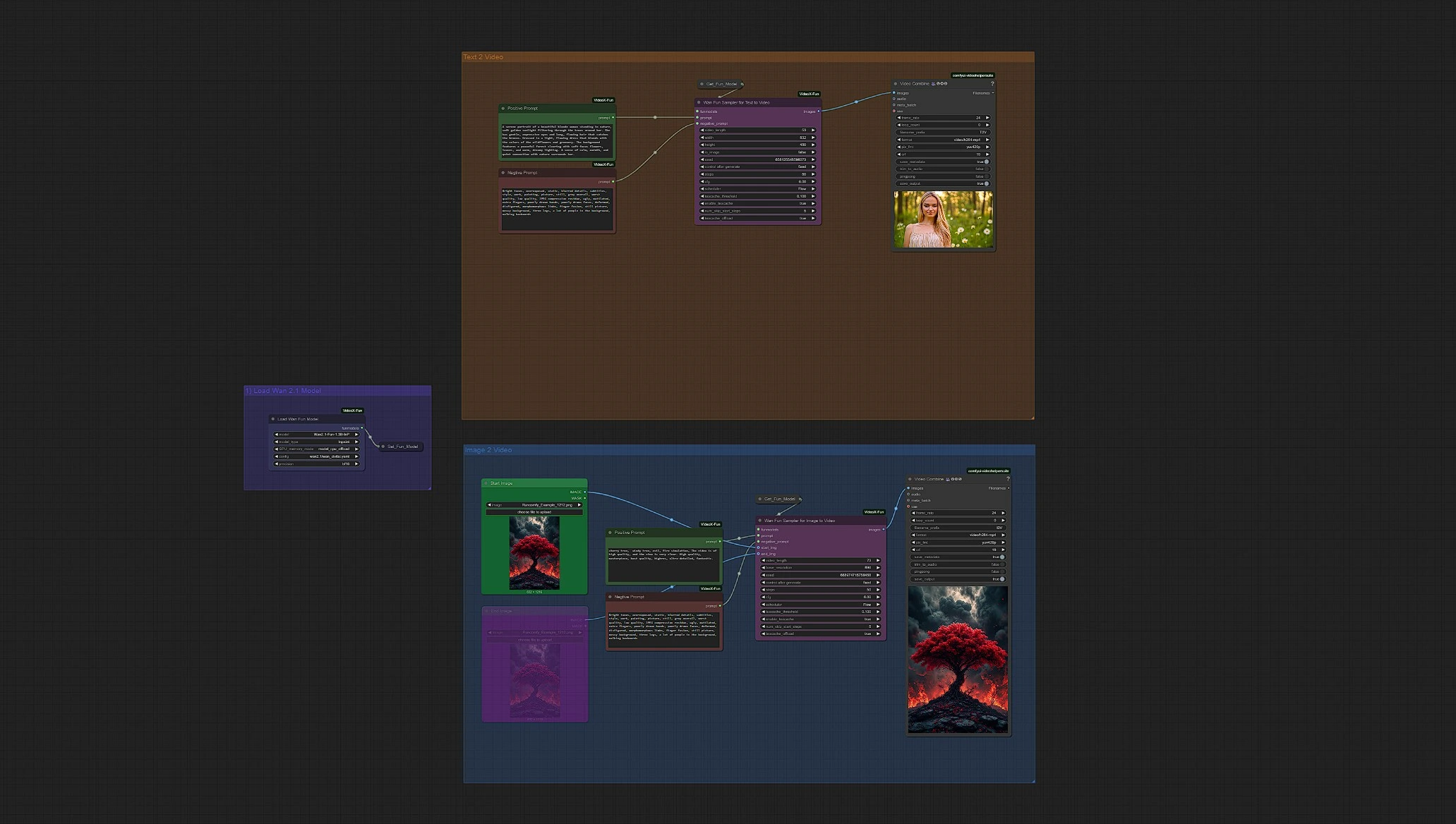

1 - Laden des WanFun-Modells#

Wählen Sie die richtige Modellvariante für Ihre Aufgabe:

Wan2.1-Fun-Control (1.3B / 14B): Für geführte Videogenerierung mit Tiefen, Canny, OpenPose und TrajektorienkontrolleWan2.1-Fun-InP (1.3B / 14B): Für Text-zu-Video mit Start- und End-Frame-Vorhersage

Speichertipps für Wan 2.1 Fun:

- Verwenden Sie

model_cpu_offloadfür schnellere Generierung mit 1.3B Wan 2.1 Fun - Verwenden Sie

sequential_cpu_offload, um den GPU-Speicherverbrauch mit 14B Wan 2.1 Fun zu reduzieren

2 - Eingabe der Prompts#

In der von Ihnen gewählten Gruppe, Image-2-Video oder Text-2-Video, geben Sie Ihre positiven und negativen Prompts ein.

- Positive Prompt:

- Treibt die Bewegung, Detailierung und Tiefe Ihres Video-Restyles an

- Mit beschreibender und künstlerischer Sprache kann Ihr endgültiger Wan 2.1 Fun-Output verbessert werden

- Negative Prompt:

- Längere negative Prompts wie "Blurring, mutation, deformation, distortion, dark and solid, comics." können die Stabilität von Wan 2.1 Fun erhöhen

- Das Hinzufügen von Wörtern wie "quiet, solid" kann die Dynamik in Wan 2.1 Fun-Videos erhöhen

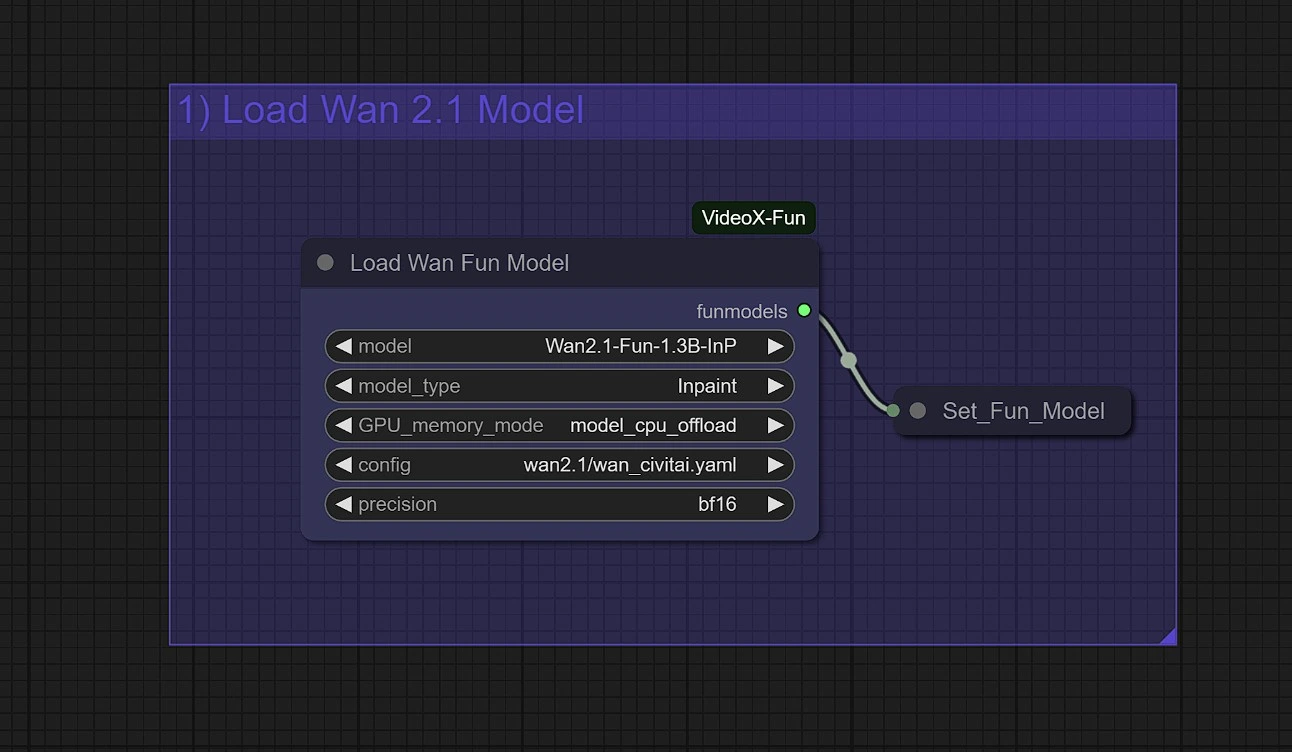

3 - Bild-zu-Video-Gruppe mit Wan 2.1 Fun#

Laden Sie Ihr Startbild hoch, um die Wan 2.1 Fun-Generierung zu starten. Sie können die Auflösung und Dauer im Wan Fun Sampler-Knoten anpassen.

[Optional] Schalten Sie den Endbild-Knoten stumm; dieses Bild wird als Endbild dienen, wobei die Zwischenbilder durch den Wan 2.1 Sampler gerendert werden.

Ihr endgültiges Wan 2.1 Fun-Video befindet sich im Outputs-Ordner des Video Save-Knotens.

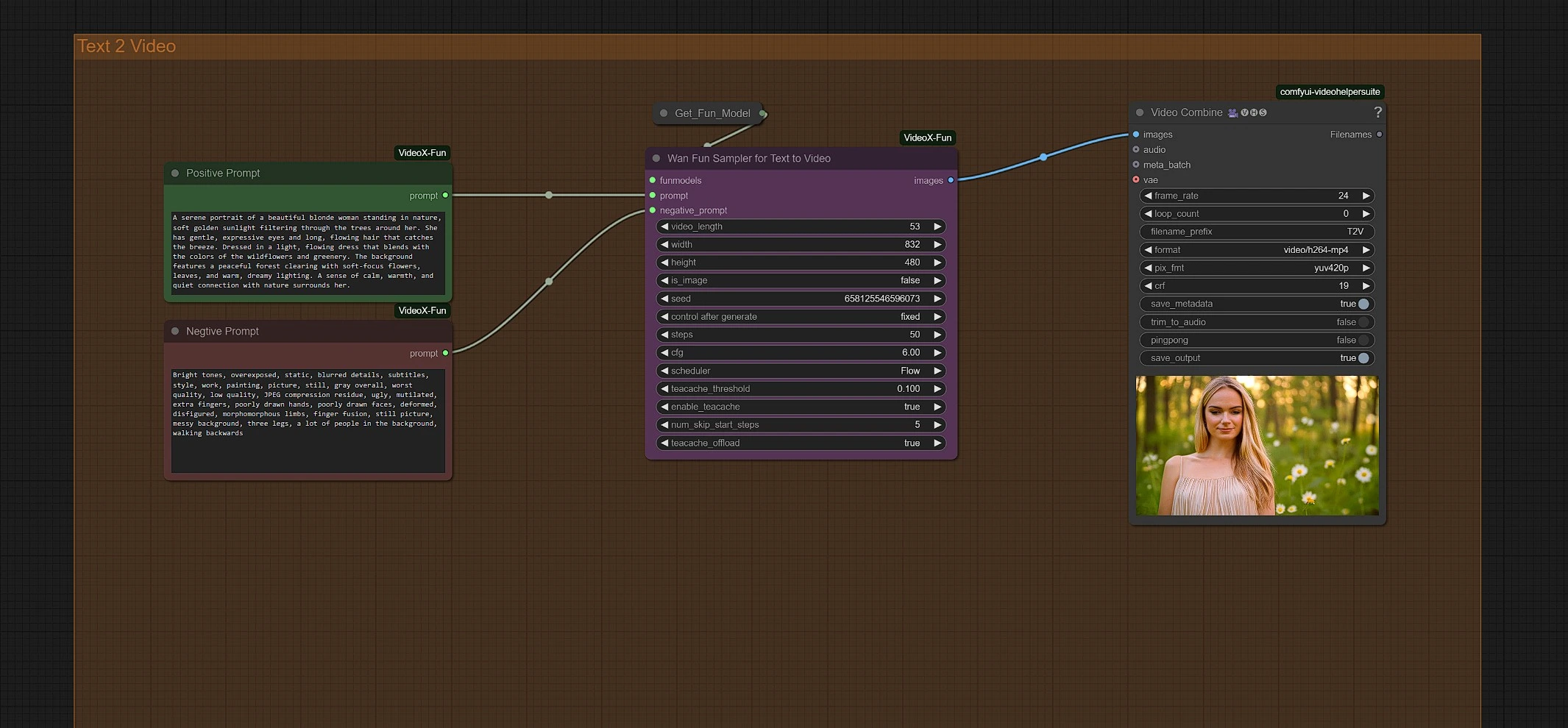

4 - Text-zu-Video-Gruppe mit Wan 2.1 Fun#

Geben Sie Ihre Prompts ein, um die Generierung zu starten. Sie können die Auflösung und Dauer im Wan Fun Sampler-Knoten anpassen.

Ihr endgültiges Wan 2.1 Fun-Video befindet sich im Outputs-Ordner des Video Save-Knotens.

Anerkennung#

Der Wan 2.1 Fun Bild-zu-Video und Text-zu-Video-Workflow wurde von bubbliiiing und hkunzhe entwickelt, deren Arbeit an der Wan 2.1 Fun-Modellfamilie die promptbasierte Videogenerierung zugänglicher und flexibler gemacht hat. Ihre Beiträge ermöglichen es Nutzern, sowohl Standbilder als auch reinen Text in dynamische, stilisierte Videos mit minimalem Aufwand und maximaler kreativer Freiheit zu verwandeln. Wir schätzen ihre Innovation und ihren anhaltenden Einfluss im Bereich der KI-Videogenerierung zutiefst.