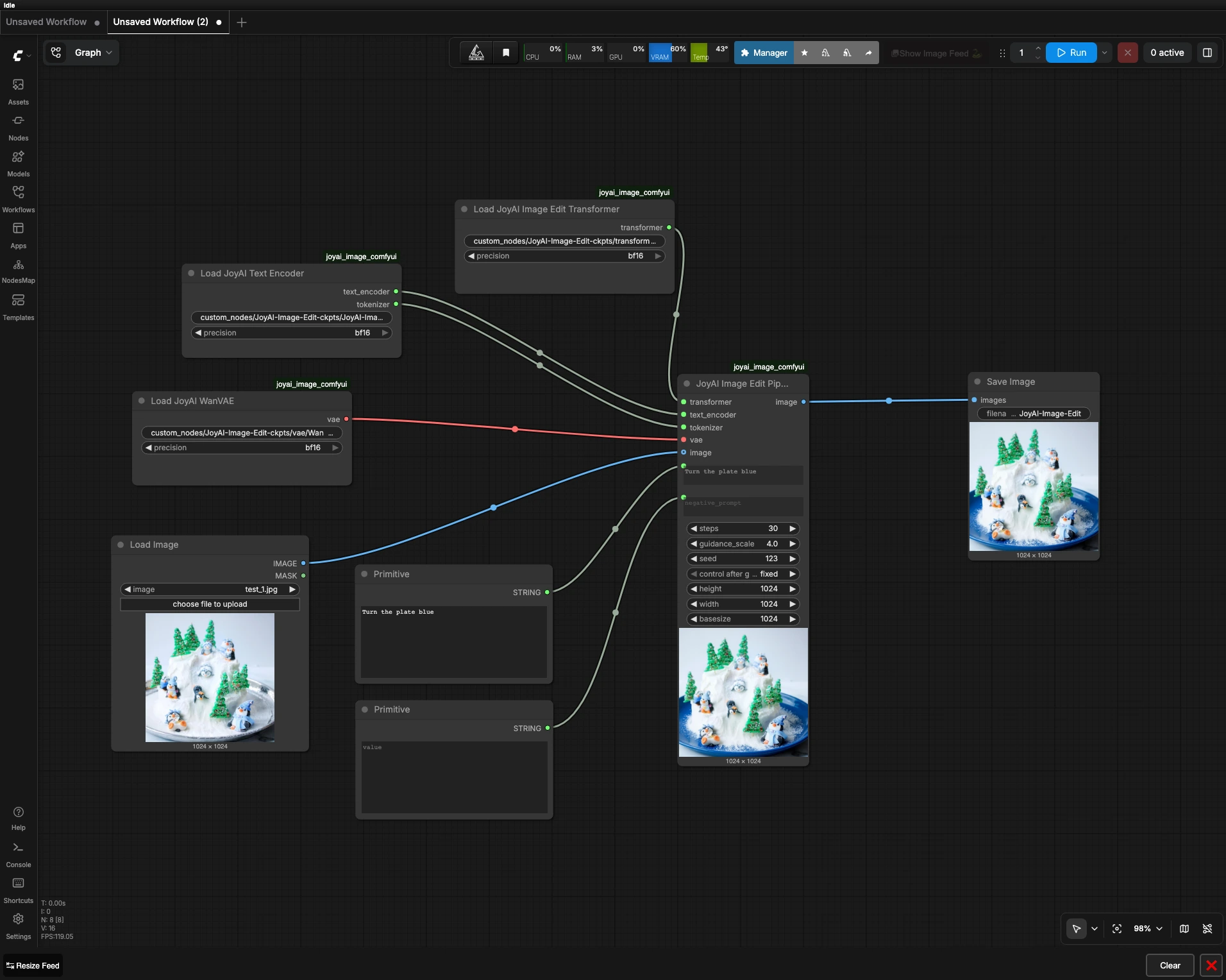

JoyAI Bildbearbeitung ComfyUI: anweisungsgeführte Bildbearbeitung, die die Struktur bewahrt#

Dieser Workflow liefert schnelle, anweisungsgeführte Bearbeitungen eines einzelnen Referenzbildes direkt in ComfyUI. Basierend auf dem JoyAI-Image-Edit-Stack führt er promptgesteuerte Änderungen wie Objekt- und Farbänderungen, räumliche Anpassungen und saubere Textrendering durch, während die ursprüngliche Komposition intakt bleibt. JoyAI Bildbearbeitung ComfyUI ist ideal für Designer, Produktteams und Kreative, die kontrollierte Bearbeitungen ohne manuelles Maskieren benötigen.

Sie geben ein Bild und eine kurze Anweisung wie „Mache den Teller blau." an. Der Workflow leitet diese Anfrage durch den JoyAI Bildbearbeitung Transformer, Text-Encoder und VAE, und gibt dann ein bearbeitetes Bild zurück, das Layout- und Inhaltsgrenzen respektiert. Es handelt sich um ein kompaktes, modellspezifisches ComfyUI-Setup, das auf vorhersehbare Ergebnisse und Reproduzierbarkeit fokussiert ist.

Wichtige Modelle im ComfyUI JoyAI Bildbearbeitung ComfyUI Workflow#

- JoyAI-Image-Edit Transformer. Kernbearbeitungsmodell, das auf Ihre Anweisung und das Referenzbild konditioniert, um strukturwahrende Änderungen vorzunehmen. Modellkarte: jdopensource/JoyAI-Image-Edit.

- JoyAI-Image-Edit Text-Encoder und Tokenizer. Kodiert die Bearbeitungsanweisung in Einbettungen, die der Transformer befolgen kann. Implementierung und Nutzung sind im JoyAI-Image-Codebasis zu finden: jd-opensource/JoyAI-Image.

- VAE für JoyAI Bildbearbeitung. Komprimiert und rekonstruiert Bilder zur Bearbeitung und Dekodierung, was zur Farbtiefe und Detailtreue beiträgt. Der Workflow bezieht sich auf einen Wan 2.1 VAE-Checkpoint, der mit dem JoyAI-Stack gebündelt ist.

So verwenden Sie den ComfyUI JoyAI Bildbearbeitung ComfyUI Workflow#

Der Ablauf verläuft von links nach rechts: Laden Sie ein Quellbild, schreiben Sie eine Anweisung, laden Sie den JoyAI-Stack, führen Sie die Bearbeitung durch und speichern Sie dann. Für typische Bearbeitungen benötigen Sie keine Maske, und der Workflow ist auf reproduzierbare Ergebnisse ausgelegt.

- Bereiten Sie das Quellbild vor

- Laden Sie Ihr Referenzbild mit

LoadImage(#6). Verwenden Sie ein sauberes, gut beleuchtetes Bild für beste Ergebnisse und halten Sie das Motiv möglichst zentriert. Wenn Sie den Rahmen genau beibehalten möchten, schneiden Sie die Quelle vorher zu, anstatt die Leinwandgröße später zu ändern. Der Workflow übergibt dieses Bild direkt an die Bearbeitungsstufe, sodass seine Struktur das Ergebnis verankert.

- Laden Sie Ihr Referenzbild mit

- Schreiben Sie die Bearbeitungsanweisung

- Geben Sie Ihre Anfrage in

Prompt(#4) ein und definieren Sie optional Ausschlüsse inNegative Prompt(#5). Halten Sie die Anweisungen kurz, spezifisch und umsetzbar, zum Beispiel „Mache die Tasse rot," „Ersetze den Himmel durch Sonnenuntergang," oder „Füge den Text JOYAI auf dem Notizbuch hinzu." Negative Prompts helfen, unerwünschte Farben, Objekte oder Stile zu vermeiden. JoyAI Bildbearbeitung ComfyUI beachtet die Anweisung, während die Layoutkonsistenz mit dem Original beibehalten wird.

- Geben Sie Ihre Anfrage in

- Laden Sie den JoyAI-Stack

- Die Modellkomponenten werden von

JoyAIImageEditTransformerLoader(#1),JoyAIImageEditTextEncoderLoader(#2) undJoyAIImageEditVAELoader(#3) geladen. Diese Knoten laden die Transformer-Gewichte, den Text-Encoder plus Tokenizer und die VAE, die die Bildkodierung und -dekodierung steuern. Normalerweise müssen Sie diese nicht ändern, es sei denn, Sie tauschen Checkpoints für ein anderes Aussehen oder Verhalten aus. Wenn Sie dieses Trio konsistent halten, bleiben die Anweisungssemantik, Geometrie und der Farbraum stabil.

- Die Modellkomponenten werden von

- Führen Sie die Bearbeitung durch

JoyAIImageEditPipeline(#7) verbindet Ihr Quellbild mit den Anweisungseinbettungen, um das bearbeitete Ergebnis zu erzeugen. Die Pipeline balanciert die Anweisungsstärke gegen die strukturelle Treue, sodass Objekte dort bleiben, wo sie hingehören, während sich ihre Eigenschaften wie gewünscht ändern. Verwenden Sie einen festen Seed für Reproduzierbarkeit oder wechseln Sie die Seeds, um Variationen zu erkunden. Wenn Sie schärfere Buchstaben oder feine Kanten benötigen, erhöhen Sie die Qualitätseinstellungen im Sampler, während Sie die Bildgröße im Verhältnis zu Ihrer Quelle vernünftig halten.

- Speichern und überprüfen

SaveImage(#8) speichert die bearbeitete Ausgabe. Verwenden Sie versionierte Namen, um Läufe nebeneinander zu vergleichen, und behalten Sie den Seed in Ihrem Dateinamen oder Ihren Notizen, damit Sie ein bevorzugtes Ergebnis reproduzieren können. Beim Iterieren ändern Sie jeweils nur eine Steuerung, um klare Ursache-Wirkungs-Beziehungen zu sehen.

Wichtige Knoten im ComfyUI JoyAI Bildbearbeitung ComfyUI Workflow#

JoyAIImageEditPipeline(#7)- Zentraler Orchestrator, der die Anweisung auf das Referenzbild mit dem JoyAI Transformer, Text-Encoder und VAE anwendet. Passen Sie zuerst

promptundnegative_promptan. Verwenden Sie einen festenseedfür deterministische Wiederholungen, dann variieren Sie ihn, um Alternativen zu erkunden. Balancieren Sie die Anweisungsstärke und die Abtastqualität, um Geschwindigkeit gegen Treue zu tauschen, und halten Sie die Ausgabedimensionen nahe am Seitenverhältnis der Quelle, um das Layout zu bewahren.

- Zentraler Orchestrator, der die Anweisung auf das Referenzbild mit dem JoyAI Transformer, Text-Encoder und VAE anwendet. Passen Sie zuerst

JoyAIImageEditTransformerLoader(#1)- Lädt den JoyAI-Image-Edit Transformer-Checkpoint, der bestimmt, wie stark und sauber die Bearbeitungen Ihrem Text folgen. Der Austausch dieses Gewichts kann den Stil und die Reaktionsfähigkeit erheblich verändern. Paaren Sie Transformer und Text-Encoder aus derselben Release-Familie, um Einbettungsfehler zu vermeiden.

JoyAIImageEditTextEncoderLoader(#2)- Stellt den Text-Encoder und Tokenizer bereit, der Ihre Anweisung in modellesbare Einbettungen übersetzt. Klare, prägnante Formulierungen verbessern die Einbettungsqualität. Präzisionseinstellungen können den VRAM-Verbrauch und die Geschwindigkeit beeinflussen, wählen Sie also den Modus, der zu Ihrer Hardware und Stapelgröße passt.

JoyAIImageEditVAELoader(#3)- Lädt die VAE, die bestimmt, wie Bilder um die Bearbeitung herum kodiert und dekodiert werden. Verschiedene VAEs können Farbe und Kontrast subtil verschieben, halten Sie dies also konsistent über Experimente hinweg, wenn Sie Prompts bewerten. Wenn Sie die VAE ändern, überprüfen Sie Ihre Prompts, um die Farbgebung neu auszubalancieren.

Optionale Extras#

- Prompt Craft

- Bevorzugen Sie einzelne, klare Aktionen wie „Mache den Teller blau" über mehrstufige Absätze. Benennen Sie sichtbare Objekte genau und verwenden Sie Singular, wenn Sie Attribute bearbeiten. Für räumliche Bearbeitungen verankern Sie die Anfrage mit Präpositionen wie „auf dem Tisch," „im Hintergrund," oder „an der Wand."

- Auflösung und Komposition

- Bewahren Sie das Seitenverhältnis der Quelle, um die Geometrie zu erhalten. Vergrößern Sie nach der Bearbeitung, wenn Sie größere Ergebnisse benötigen, anstatt extreme Bearbeitungsauflösungen zu verwenden.

- Reproduzierbarkeit

- Behalten Sie einen festen Seed bei, wenn Sie Prompt-Variationen vergleichen, und entsperren Sie den Seed, um Alternativen zu probieren, sobald Sie zufrieden sind.

- Referenzen und Quellen

- Modellkarte und Gewichte: jdopensource/JoyAI-Image-Edit

- Implementierungsdetails und Updates: jd-opensource/JoyAI-Image

- ComfyUI-Grafikvorlage, die in diesem Projekt verwendet wird: joyai_image_comfyui

Danksagungen#

Dieser Workflow implementiert und baut auf den folgenden Arbeiten und Ressourcen auf. Wir danken jd-opensource für das JoyAI-Image-Repository, jd-opensource für den JoyAI-Image ComfyUI Workflow und jdopensource für das JoyAI-Image-Edit Modell für ihre Beiträge und Wartung. Für autoritative Details verweisen wir auf die Originaldokumentation und -repositories, die unten verlinkt sind.

Ressourcen#

- jd-opensource/JoyAI-Image

- GitHub: jd-opensource/JoyAI-Image

- jd-opensource/joyai_image_comfyui

- GitHub: jd-opensource/JoyAI-Image

- jdopensource/JoyAI-Image-Edit

- Hugging Face: jdopensource/JoyAI-Image-Edit

Hinweis: Die Nutzung der referenzierten Modelle, Datensätze und Codes unterliegt den jeweiligen Lizenzen und Bedingungen, die von ihren Autoren und Wartenden bereitgestellt werden.