Generate ENTIRE AI WORLDS (Vace Wan 2.1):具有真實攝影機追蹤的電影級影片-影片世界建構#

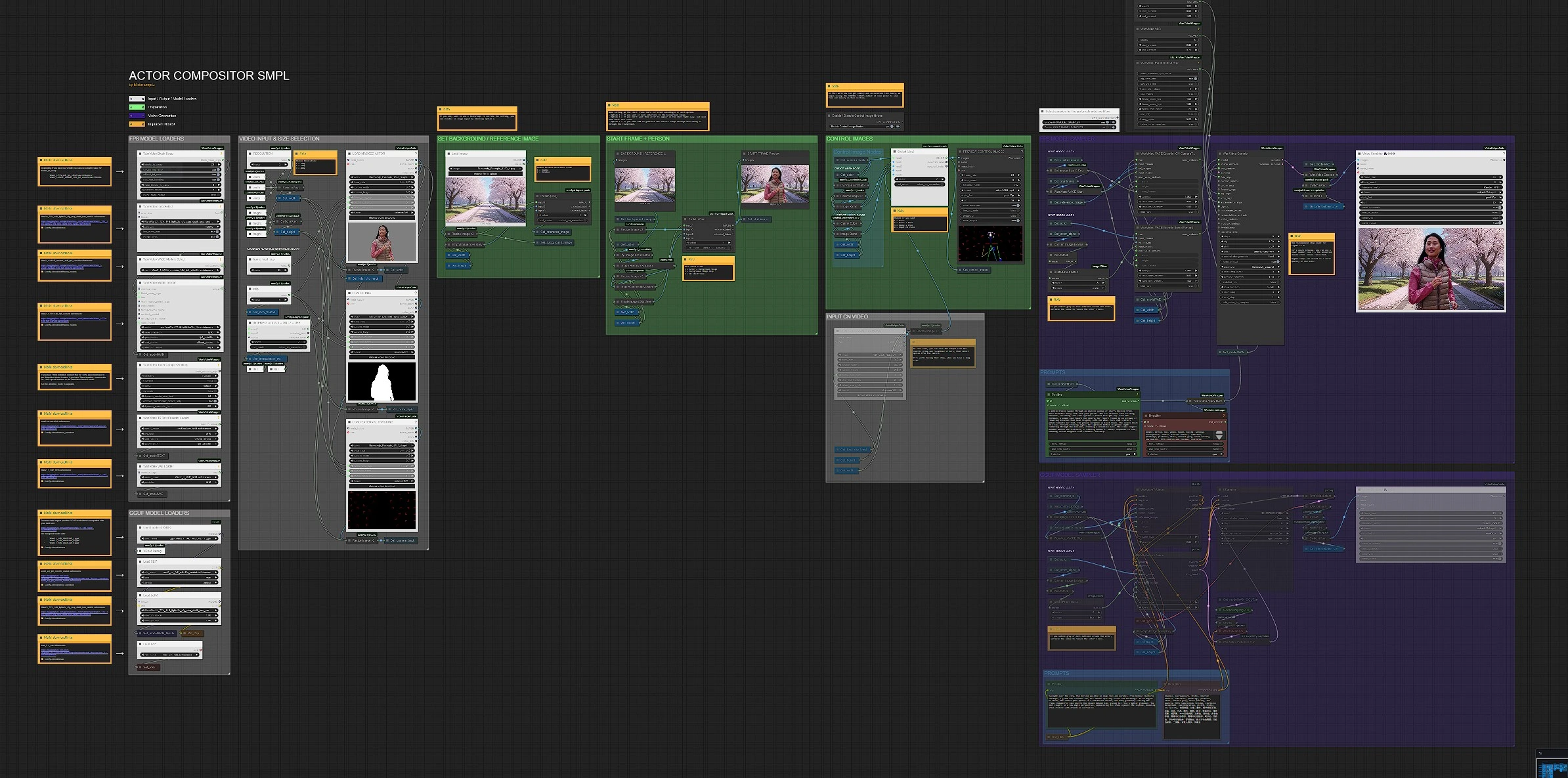

Generate ENTIRE AI WORLDS (Vace Wan 2.1) 是一個由 Mickmumpitz 創建的生產就緒 ComfyUI 工作流程,用於將實拍素材轉換為全新環境,同時保持原始的攝影機運動。它替換背景、保持透視和比例,並將遮罩的演員合成到完全由文字和參考圖像驅動的重新生成的世界中。

建立在 Wan 2.1 VACE 堆疊之上,這個工作流程非常適合電影製作人、特效藝術家和需要快速預覽或精緻鏡頭的創作者。你可以用提示詞指導場景,從可選的參考圖像開始,並在高速 FP8 管線或低顯存 GGUF 管線之間選擇。結果是無縫的世界建構,讓你真正從日常片段中 Generate ENTIRE AI WORLDS (Vace Wan 2.1)。

ComfyUI Generate ENTIRE AI WORLDS (Vace Wan 2.1) 工作流程的關鍵模型#

- Wan 2.1 14B 文字-影片擴散模型。用於以時間一致的方式合成新世界的核心生成器。ComfyUI 的重新打包權重可在 Comfy-Org 的 Hugging Face 發布中獲得。 Comfy‑Org/Wan_2.1_ComfyUI_repackaged

- Wan 2.1 VACE 模組 14B。提供 VACE 嵌入,將生成與場景結構綁定,實現精確的背景替換和攝影機追蹤。 Kijai/WanVideo_comfy

- Wan 2.1 VAE。處理影片幀的潛在空間編碼/解碼。 Comfy‑Org/Wan_2.1_ComfyUI_repackaged (VAE split)

- uMT5‑XXL 文字編碼器。將提示詞編碼到 Wan 2.1 的條件空間中。與此工作流程兼容的打包編碼器隨 Wan 2.1 分割包一起提供。 Comfy‑Org/Wan_2.1_ComfyUI_repackaged (text_encoders)

- Wan 2.1 14B VACE GGUF(量化 UNet)。用於低顯存 GPU 的量化替代方案,無需完整 FP8 模型即可驅動 GGUF 路徑。 QuantStack/Wan2.1_14B_VACE‑GGUF

- FILM:大幅度運動的幀插值。可選的後處理,通過插值額外幀來提升運動流暢度。 google‑research/frame‑interpolation

- Wan 2.1 可選的 LightX 步驟蒸餾 LoRA。速度導向的 LoRA,在低步數下保持結構和身份的同時與短步數良好配合。 Kijai/WanVideo_comfy (LoRA)

如何使用 ComfyUI Generate ENTIRE AI WORLDS (Vace Wan 2.1) 工作流程#

這個工作流程採用兩階段 VACE 策略:首先,它從控制圖像編碼場景運動以鎖定攝影機移動;其次,它編碼演員插入並將其融合到重新生成的環境中。你可以執行 FP8 路徑以獲得最大速度,或使用 GGUF 路徑以降低顯存需求。以下各節對應圖表上的群組,以便你能夠自信地操作整個 Generate ENTIRE AI WORLDS (Vace Wan 2.1) 管線。

影片輸入與尺寸選擇#

輸入區域讓你選擇工作解析度和基本剪輯控制。使用解析度開關選擇預設(720p、576p 或 480p),它會饋入 Set_width (#370) 和 Set_height (#369),使每個階段保持同步。你可以限制幀數以保持快速周轉,如果你想要偏移入點可以設置一個小的跳過值。為了穩定性和記憶體,將序列保持在推薦範圍內;圖表標籤指出 81 幀是大多數 GPU 的合理上限。這些選擇全局應用於控制圖像、VACE 編碼和最終渲染。

注意:輸入影片也可以通過另一個工作流程 MASK_AND_TRACK 生成。你可以在這裡下載其工作流程文件:workflow.json。下載後,將文件拖入新的工作流程標籤頁並執行以獲得輸入影片。

設置背景/參考圖像#

背景板和可選的參考圖像引導視覺風格。載入一張背景靜態圖,然後圖表將其調整大小以匹配你的工作尺寸。如果你想要一個風格錨而不是硬背板,通過選擇器啟用 reference_image;這張圖像引導色彩、構圖和色調,而不會指定幾何形狀。當你想要模型 Generate ENTIRE AI WORLDS (Vace Wan 2.1) 呼應特定外觀時,參考路線很有幫助,而文字提示詞處理其餘部分。當你偏好純文字控制時,將其關閉。

起始幀 + 人物#

使用此部分決定生成如何開始。使用準備好的演員靜態圖,Image Remove Background Rembg (mtb) (#1433) 拉出乾淨的遮罩,ImageCompositeMasked (#1441) 將演員放置在你選擇的背景上形成起始幀。Start Frame 開關(ImpactSwitch, #1760)提供三種模式:演員加背景的合成、僅背景、或無起始幀。起始幀有助於錨定身份和佈局;僅背景讓角色隨時間「進入」;無起始幀要求模型從文字和參考建立主體和世界。即時預覽區塊在你提交下游之前顯示起始幀的效果。

控制圖像#

控制圖像鎖定攝影機的運動,使透視和視差感覺真實。將攝影機追蹤影片饋入該群組;圖表可以導出 OpenPose 和 Canny 圖層,然後將它們混合以創建強結構信號。Control Image Nodes 開關(ImpactSwitch, #1032)讓你選擇僅追蹤、追蹤+姿勢、Canny+姿勢或外部準備的控制影片。通過預覽合成審查堆疊,確保輪廓和邊緣清晰可讀。對於長序列,你可以保存並稍後重新載入此控制影片以避免重新計算;這在你迭代提示詞或遮罩同時繼續 Generate ENTIRE AI WORLDS (Vace Wan 2.1) 時特別有用。

輸入 CN 影片#

如果你已經匯出了「控制圖像」影片,在此處放入以繞過預處理。在控制圖像開關中選擇相應選項,使管線的其餘部分使用你的快取結構。這保持攝影機追蹤在各次執行中一致,並大幅減少長鏡頭的迭代時間。

FP8 模型載入器#

FP8 分支載入完整的 Wan 2.1 模型堆疊。WanVideoModelLoader (#4) 帶入 T2V 14B 骨幹和 VACE 模組,加上可選的 LightX LoRA 用於快速、一致的取樣。WanVideoVAELoader (#26) 提供 VAE,WanVideoBlockSwap (#5) 暴露一種通過根據需要將區塊交換到裝置記憶體來節省顯存的策略。當你有顯存餘裕時,這個分支是最快的 Generate ENTIRE AI WORLDS (Vace Wan 2.1) 方式。

FP8 模型取樣器#

提示詞由 WanVideoTextEncodeSingle 編碼為正面和負面文字,然後通過 WanVideoApplyNAG 精煉以保持措辭一致。第一階段 WanVideo VACE Encode (CN‑CameraTrack) (#948) 讀取控制圖像以產生運動感知嵌入。第二階段 WanVideo VACE Encode (InsertPerson) (#1425) 使用乾淨的 alpha 和遮罩注入演員,你可以輕輕增大或縮小以避免光暈。WanVideoSampler (#2) 然後渲染序列,WanVideoDecode (#1) 將潛在空間轉換為幀,一個簡單的開關在原始幀率或 FILM 插值流之間選擇,然後進行最終影片合成。

GGUF 模型載入器#

GGUF 分支設計用於低顯存工作流程。UnetLoaderGGUF (#1677) 載入量化的 Wan 2.1 VACE UNet,CLIPLoader (#1680) 提供文字編碼器,可以使用 LoraLoader (#2420) 應用 LoRA。標準 ComfyUI VAELoader (#1676) 處理解碼。這條路徑以速度換取佔用空間,同時保留相同的兩階段 VACE 邏輯,因此你仍然可以在適度的硬體上 Generate ENTIRE AI WORLDS (Vace Wan 2.1)。

GGUF 模型取樣器#

在量化路徑中,WanVaceToVideo (#1724) 將 VACE 嵌入、文字條件和你的參考轉換為引導的潛在空間。WanVideoNAG 和 WanVideoEnhanceAVideoKJ 幫助保持身份和局部細節,之後 KSampler (#1726) 生成最終的潛在序列。VAEDecode (#1742) 產生幀,可選的 FILM 步驟增加時間平滑度,影片合成器將結果寫入磁碟。當顯存緊張或需要長而穩定的鏡頭時使用此路徑。

提示詞#

有兩個提示詞面板。FP8 端使用 Wan T5 文字編碼器,而 GGUF 端使用 CLIP 條件路徑;兩者都接收正面和負面文字。保持正面提示詞電影化並針對你想要的世界,負面提示詞保留給壓縮偽影、過度飽和和不需要的前景雜物。你可以將提示詞與柔和的參考圖像混合來引導色彩和光線,同時仍然讓模型 Generate ENTIRE AI WORLDS (Vace Wan 2.1) 以匹配你的意圖。

ComfyUI Generate ENTIRE AI WORLDS (Vace Wan 2.1) 工作流程的關鍵節點#

WanVideo VACE Encode (CN-CameraTrack)(#948) 第一階段 VACE 傳遞,分析你的控制圖像以鎖定攝影機運動。將寬度、高度和長度與你選擇的工作尺寸和剪輯持續時間匹配,使嵌入與下游取樣對齊。如果你依賴外部控制影片,保持其幀數一致以避免時序漂移。參考實現和節點行為遵循 WanVideo wrapper。 來源:kijai/ComfyUI‑WanVideoWrapperWanVideo VACE Encode (InsertPerson)(#1425) 第二階段 VACE 傳遞,使用 alpha 遮罩和清理過的遮罩注入演員。如果你看到模糊的邊緣,調整上游遮罩收縮/擴展(DilateErodeMask, #2391)以稍微拉入遮罩。這一傳遞將插入與場景運動綁定,使比例和視差保持自然。 來源:kijai/ComfyUI‑WanVideoWrapperWanVaceToVideo(#1724 和 #1729) 將 VACE 條件橋接到取樣器。將輸出尺寸設置為相同的工作尺寸,並使用控制剪輯的幀數,以便之後不需要修剪。當你想要在整個鏡頭中獲得一致的外觀而不過度約束佈局時,與單個參考圖像配對。 來源:kijai/ComfyUI‑WanVideoWrapperWanVideoSampler(#2) FP8 取樣器,使用你的文字嵌入和 VACE 圖像嵌入從 Wan 2.1 渲染最終序列。它支持節省顯存的區塊交換,並與 LightX 步驟蒸餾 LoRA 良好配合,在低步數下實現快速、保持身份的結果。 來源:kijai/ComfyUI‑WanVideoWrapper,Kijai/WanVideo_comfy (LoRA)KSampler(#1726) GGUF 分支取樣器。從少量步驟開始以保護演員並減少過度銳化;LightX LoRA 針對此區間進行了調整。如果細節消失,適度增加步驟或依靠Enhance A Video區塊來恢復微紋理而不漂移運動。 來源:ComfyUI coreFILM VFI(#2019 和 #1757) 由插值開關控制的可選幀插值。用它來平滑快速運動或延長持續時間而不重新渲染。如果你注意到細結構上的時間抖動,對這些鏡頭禁用它或降低插值因子。 來源:google‑research/frame‑interpolation

可選額外功能#

- 保持剪輯長度可管理;圖表的指導建議每次執行最多大約 81 幀,在常見 GPU 上平衡穩定性和記憶體。

- 如果你正在迭代提示詞,保存一次「控制圖像」影片並切換到 Input CN Video 路徑以避免重新計算結構。

- 要移除主體周圍的模糊邊緣,在插入路徑中用

DilateErodeMask微調演員遮罩直到光暈消失。 - 低顯存或長鏡頭:選擇 GGUF 分支;高顯存和快速迭代:選擇 FP8 分支。

- 對於起始幀,當你想要主體稍後進入時使用「僅背景」,或當你想要模型完全從文字和參考建立場景時使用「無起始幀」。

通過這些步驟,你可以自信地端到端運行工作流程,並 Generate ENTIRE AI WORLDS (Vace Wan 2.1),在真實攝影機運動下保持穩定。

致謝#

這個工作流程實現並建立在 @mickmumpitz 的作品和資源之上。我們衷心感謝 Mickmumpitz 的工作流程教程的指導性工作流程,感謝他的貢獻和維護。有關權威詳細信息,請參閱下方連結的原始文檔和存儲庫。

資源#

- YouTube/Workflow Tutorial

- 來自 Mickmumpitz Youtube 的文檔/發佈說明:Workflow Tutorial

注意:參考的模型、數據集和代碼的使用受 Mickmumpitz 提供的各自許可證和條款約束。