FLUX.2 LoRA ComfyUI 推論:使用 FLUX.2 Dev 管道的訓練匹配 AI Toolkit LoRA 輸出#

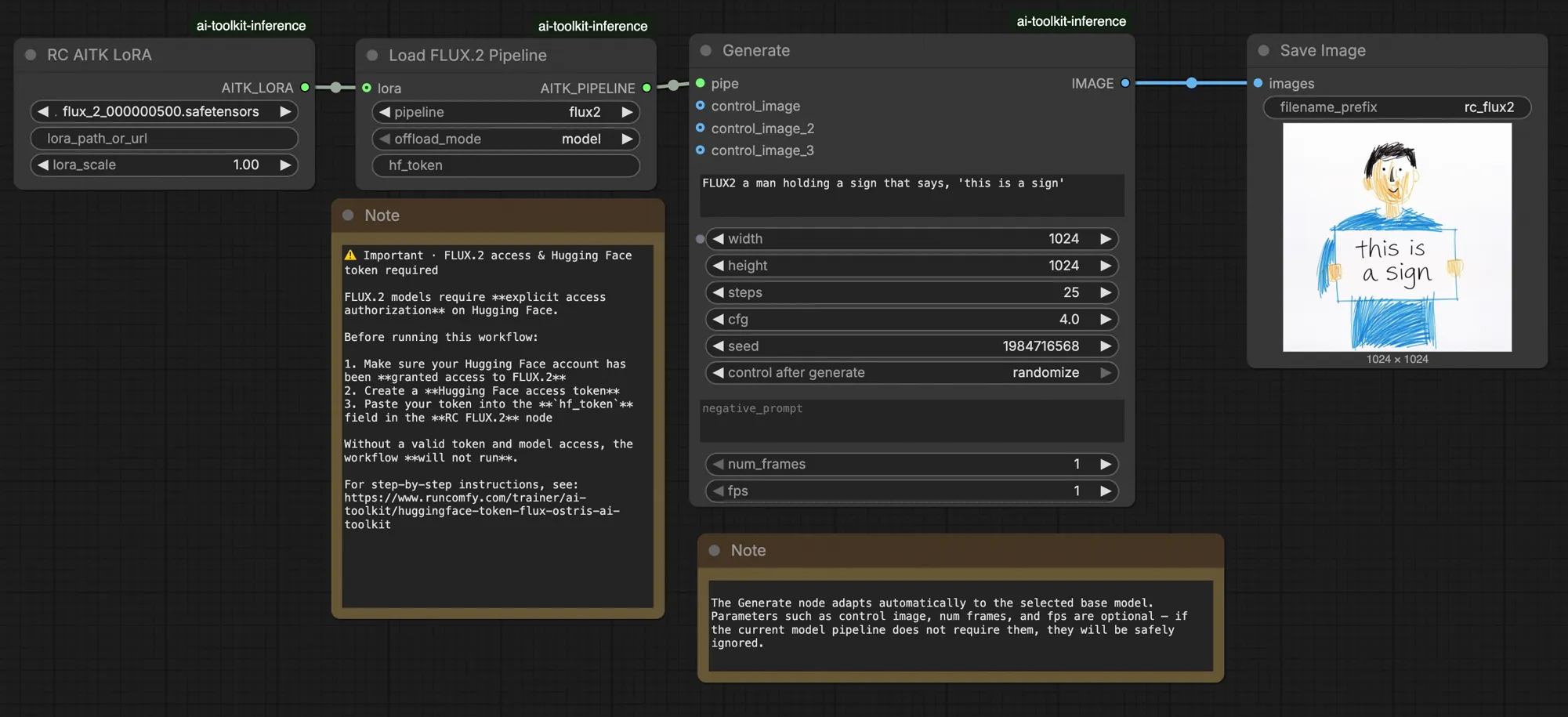

這個生產就緒的 RunComfy 工作流程通過 RC FLUX.2 Dev (Flux2Pipeline) 在 ComfyUI 中運行 FLUX.2 Dev LoRA 推論 (管道級別對齊,而不是通用取樣器圖)。RunComfy 構建並開源了這個自定義節點——請參見 runcomfy-com repositories——您可以使用 lora_path 和 lora_scale 控制適配器應用。

注意:此工作流程需要 3XL 機器運行。

為什麼 FLUX.2 LoRA ComfyUI 推論在 ComfyUI 中看起來經常不同#

AI Toolkit 訓練預覽通過模型專用的 FLUX.2 管道渲染,其中文本編碼、調度和 LoRA 注入設計為協同工作。在 ComfyUI 中,使用不同的圖形重建 FLUX.2(或不同的 LoRA 加載路徑)可以改變這些交互,因此即使複製相同的提示、步驟、CFG 和種子,仍然會產生可見的漂移。RunComfy RC 管道節點通過在 Flux2Pipeline 中端到端執行 FLUX.2 並在該管道內應用您的 LoRA,縮小了這一差距,保持推論與預覽行為對齊。來源:RunComfy 開源庫。

如何使用 FLUX.2 LoRA ComfyUI 推論工作流程#

步驟 1:獲取 LoRA 路徑並將其加載到工作流程中(2 種選擇)#

⚠️ 重要 · 需要 FLUX.2 訪問和 Hugging Face 令牌#

FLUX.2 Dev 模型需要在 Hugging Face 上的 明確訪問授權。

運行此工作流程之前:

- 確保您的 Hugging Face 帳戶已被 授予 FLUX.2 (Dev) 訪問權限

- 創建一個 Hugging Face 訪問令牌

- 將您的令牌粘貼到 Load Pipeline 節點上的

hf_token欄位中

沒有有效的令牌和適當的模型訪問,工作流程 將無法運行。有關逐步說明,請參見 Hugging Face token for FLUX.2。

選擇 A — RunComfy 訓練結果 → 下載到本地 ComfyUI:

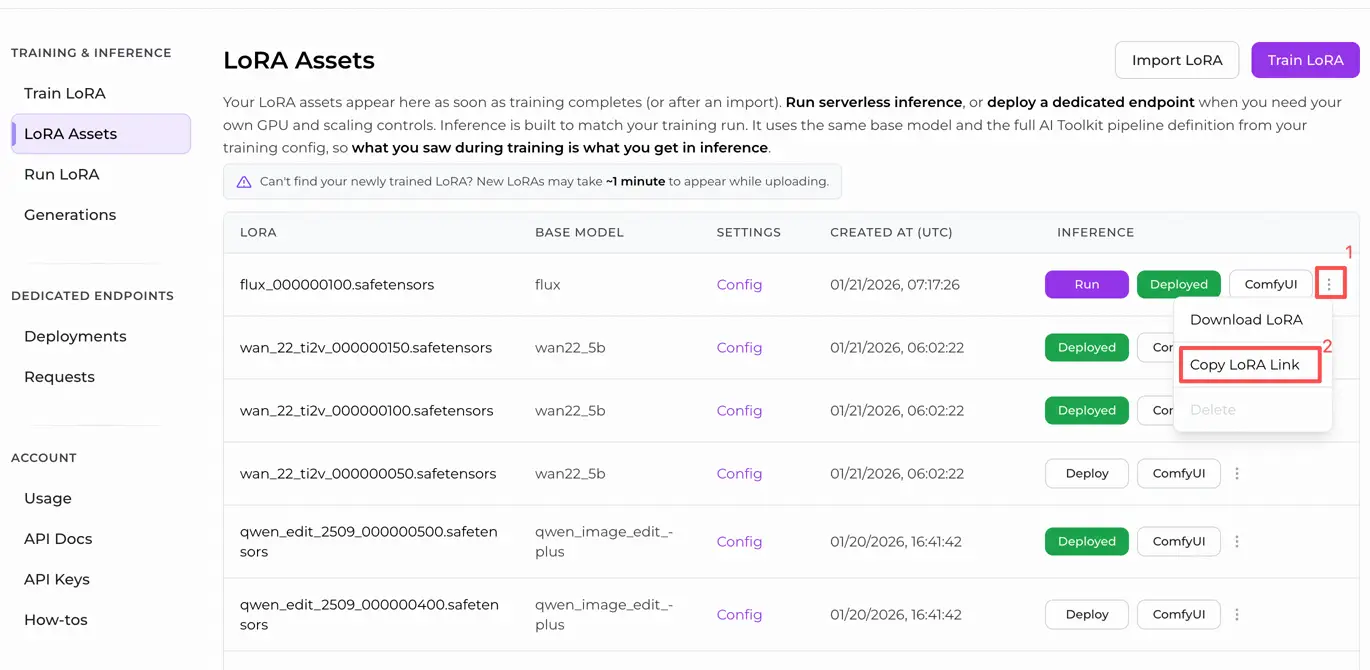

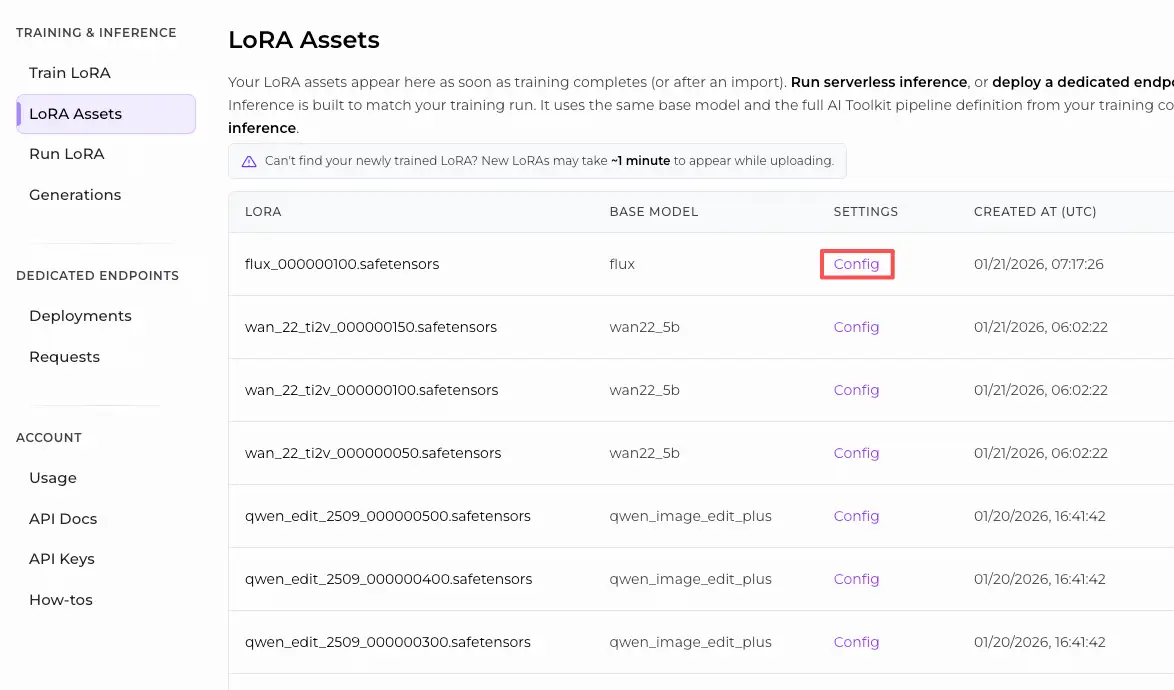

- 前往 Trainer → LoRA Assets

- 找到您想使用的 LoRA

- 點擊右側的 ⋮ (三點) 菜單 → 選擇 Copy LoRA Link

- 在 ComfyUI 工作流程頁面,將複製的鏈接粘貼到 UI 右上角的 Download 輸入欄中

- 在點擊下載之前,確保目標文件夾設置為 ComfyUI > models > loras (此文件夾必須選為下載目標)

- 點擊 Download — 這確保 LoRA 文件被保存到正確的

models/loras目錄中 - 下載完成後,刷新頁面

- 現在 LoRA 出現在工作流程的 LoRA 選擇下拉菜單中 — 選擇它

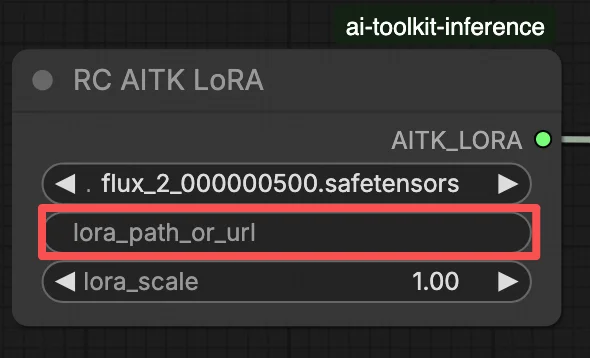

選擇 B — 直接 LoRA URL (覆蓋選擇 A):

- 將 直接

.safetensors下載 URL 粘貼到 LoRA 節點的path / url輸入欄中 - 當此處提供 URL 時,它會 覆蓋選擇 A — 工作流程在運行時直接從 URL 加載 LoRA

- 不需要本地下載或文件放置

提示:確認 URL 解析為實際的 .safetensors 文件(而不是登陸頁或重定向)。

步驟 2:將推論參數與您的訓練樣本設置匹配#

在 LoRA 節點中,選擇您的適配器在 lora_path (選擇 A),或將直接 .safetensors 鏈接粘貼到 path / url (選擇 B 覆蓋下拉菜單)。然後將 lora_scale 設置為您在訓練預覽期間使用的相同強度,並從此處進行調整。

其餘參數位於 Generate 節點(以及,根據圖形,Load Pipeline 節點)上:

prompt:您的文本提示(如果您在訓練時使用了觸發詞,請包括它們)width/height:輸出分辨率;匹配您的訓練預覽尺寸以獲得最干淨的比較(建議使用 FLUX.2 的 16 的倍數)sample_steps:推論步驟數(25 是常見默認值)guidance_scale:CFG/指導值(4.0 是常見默認值)seed:固定種子以重現;更改它以探索變化seed_mode(僅在存在時):選擇fixed或randomizenegative_prompt(僅在存在時):在此工作流程中,FLUX.2 是指導蒸餾的,因此忽略負提示hf_token:Hugging Face 訪問令牌;需要用於 FLUX.2 Dev 模型下載(粘貼到 Load Pipeline 節點上)

訓練對齊提示:如果您在訓練期間自定義了取樣值(seed、guidance_scale、sample_steps、觸發詞、分辨率),請在此處鏡像這些精確值。如果您在 RunComfy 上訓練,請打開 Trainer → LoRA Assets > Config 查看解析的 YAML 並將預覽/樣本設置複製到工作流程節點中。

步驟 3:運行 FLUX.2 LoRA ComfyUI 推論#

點擊 Queue/Run — SaveImage 節點將結果寫入您的 ComfyUI 輸出文件夾。

快速檢查清單:

- ✓ LoRA 是:下載到

ComfyUI/models/loras(選擇 A),或通過直接.safetensorsURL 加載 (選擇 B) - ✓ 本地下載後刷新頁面(僅限選擇 A)

- ✓ 推論參數與訓練

sample配置匹配(如果自定義)

如果以上所有內容均正確,此處的推論結果應該與您的訓練預覽緊密匹配。

FLUX.2 LoRA ComfyUI 推論故障排除#

大多數 FLUX.2 “訓練預覽與 ComfyUI 推論”差距源自於 管道級別的差異(模型的加載、調度方式以及 LoRA 的合併方式),而不是單一錯誤旋鈕。 此 RunComfy 工作流程通過端到端運行 RC FLUX.2 Dev (Flux2Pipeline) 並通過 lora_path / lora_scale 在該管道內應用您的 LoRA,恢復了最接近的“訓練匹配”基線,而不是堆疊通用加載器/取樣器節點。

(1) Flux.2 與 Lora 錯誤:"mul_cuda" 未為 'Float8_e4m3fn' 實現#

為什麼會發生這種情況 這通常發生在 FLUX.2 使用 Float8/FP8 權重(或混合精度量化)加載並且 LoRA 通過 通用 ComfyUI LoRA 路徑 應用時。LoRA 合併可能會強制不支持的 Float8 操作(或混合 Float8 + BF16 提升),從而導致 mul_cuda Float8 運行時錯誤。

如何修復(推薦)

- 通過 RC FLUX.2 Dev (Flux2Pipeline) 運行推論並僅通過

lora_path/lora_scale加載適配器,以便 LoRA 合併在 AI Toolkit 對齊的管道中發生,而不是通過堆疊的通用 LoRA 加載器進行。 - 如果您正在非 RC 圖形中調試:避免在 Float8/FP8 擴散權重上應用 LoRA。 在添加 LoRA 之前,使用 BF16/FP16 兼容的 FLUX.2 加載路徑。

(2) LoRA 形狀不匹配應快速失敗,而不是損壞 GPU 狀態並導致 OOM/系統不穩定#

為什麼會發生這種情況 這幾乎總是一個 基礎不匹配:LoRA 是為不同的模型家族訓練的(例如 FLUX.1),但應用於 FLUX.2 Dev。您通常會看到許多 lora key not loaded 行,然後是形狀不匹配;在最壞的情況下,會話可能會變得不穩定並以 OOM 結束。

如何修復(推薦)

- 確保 LoRA 是專門為

black-forest-labs/FLUX.2-dev使用 AI Toolkit 訓練的(FLUX.1 / FLUX.2 / Klein 變體不可互換)。 - 保持圖形“單一路徑”以適應 LoRA:僅通過工作流程的

lora_path輸入加載適配器,讓 Flux2Pipeline 處理合併。不要在並行中堆疊額外的通用 LoRA 加載器。 - 如果您已經遇到不匹配並且 ComfyUI 之後開始產生不相關的 CUDA/OOM 錯誤,請 重新啟動 ComfyUI 進程 以完全重置 GPU + 模型狀態,然後使用兼容的 LoRA 重試。

(3) Flux.2 Dev - 使用 LoRAs 使推論時間增加一倍以上#

為什麼會發生這種情況 當 LoRA 路徑強制額外的修補/去量化工作或在比基礎模型更慢的代碼路徑中應用權重時,LoRA 可能會使 FLUX.2 Dev 變得更慢。

如何修復(推薦)

- 使用此工作流程的 RC FLUX.2 Dev (Flux2Pipeline) 路徑並通過

lora_path/lora_scale傳遞您的適配器。在此設置中,LoRA 在 管道加載期間合併一次(AI Toolkit 風格),因此 每步取樣成本 接近於基礎模型。 - 當您追求與預覽匹配的行為時,避免堆疊多個 LoRA 加載器或混合加載路徑。保持為 一個

lora_path+ 一個lora_scale直到基線匹配。

注意 在此 FLUX.2 Dev 工作流程中,FLUX.2 是指導蒸餾的,因此即使存在 UI 欄位,管道也可能忽略 negative_prompt — 使用提示詞 + guidance_scale + lora_scale 首先匹配預覽。

現在運行 FLUX.2 LoRA ComfyUI 推論#

打開工作流程,設置 lora_path,然後點擊 Queue/Run 以獲取接近您的 AI Toolkit 訓練預覽的 FLUX.2 Dev LoRA 結果。