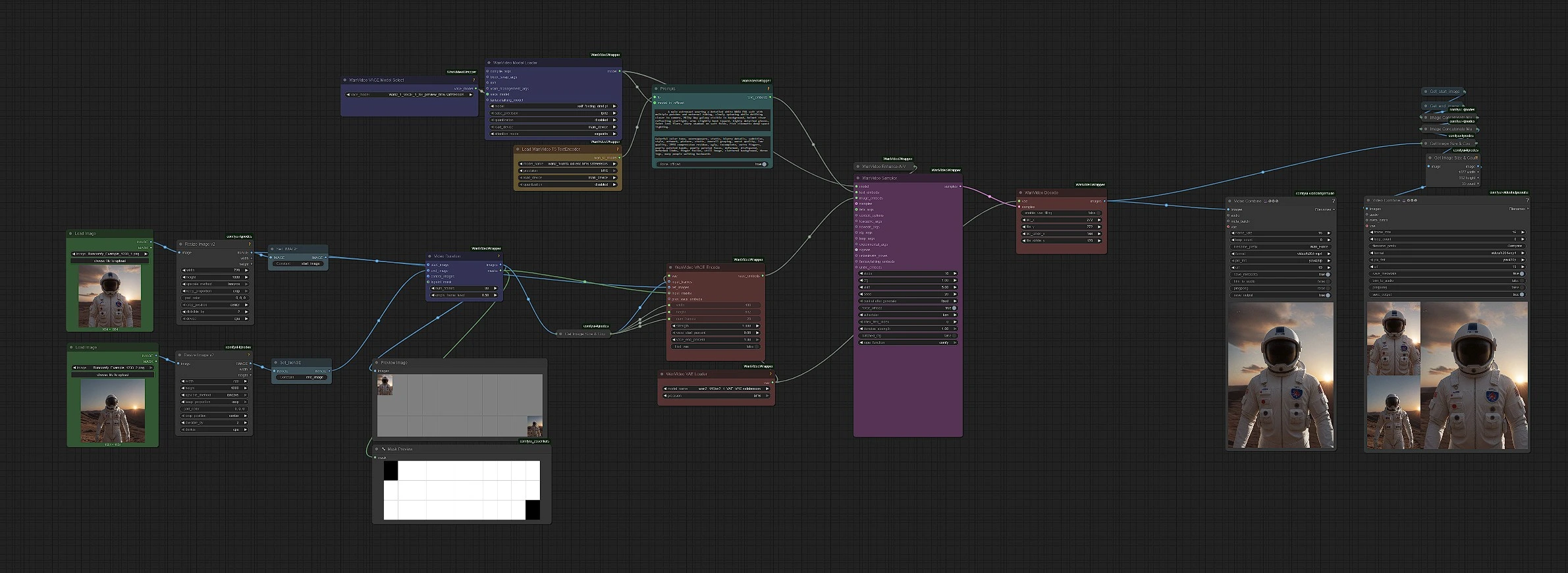

Self Forcing:自回归关键帧到视频生成#

Self Forcing 是一个高级的关键帧驱动视频生成模型。Self Forcing 通过在描述性文本提示的引导下,在起始和结束关键帧之间生成运动,实现流畅、高质量的视频合成。

基于带有 KV 缓存的自回归视频扩散架构,Self Forcing 擅长在帧之间生成时间一致、身份保持的运动。Self Forcing 的关键帧-文本联合方法能够在保持生成视频全程主体结构和风格的同时,实现流畅的过渡。

为什么使用 Self Forcing?#

Self Forcing 提供:

- 关键帧驱动生成:Self Forcing 使用起始和结束参考图像来控制外观和运动

- 提示 + 关键帧控制:Self Forcing 将创意文本描述与参考结构相结合

- 自回归运动:Self Forcing 提供帧间平滑、时间一致的过渡

- 身份保持:Self Forcing 在生成的序列中保持主体忠实度

- 高效视频创作的理想选择:Self Forcing 非常适合角色驱动的故事叙述、电影动画和概念视频合成

无论您是生成动画、电影序列还是身份一致的 AI 视频,Self Forcing 都能通过 Self Forcing 技术在确保流畅逼真运动的同时,为您提供完整的创作控制。

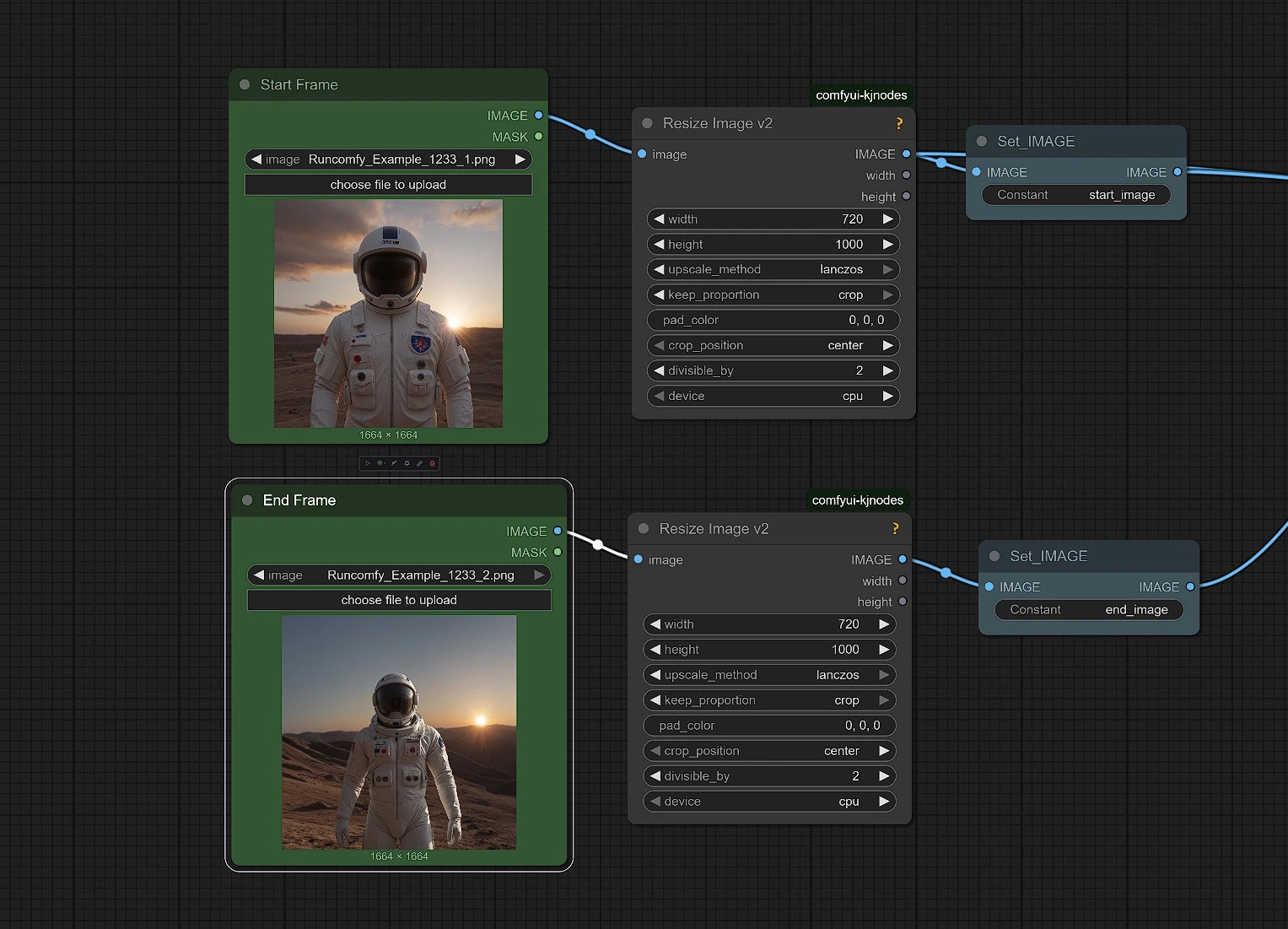

输入图像#

在本节中,您将上传用于 Self Forcing 的起始关键帧和结束关键帧图像。这两张图像定义了 Self Forcing 生成视频的开始和结束外观。

- 使用提供的 Load Image 节点为 Self Forcing 上传两张参考图像。

- 使用可选的调整大小和裁剪节点来调整图像,以实现最佳的 Self Forcing 对齐和宽高比。

- 正确对齐和良好裁剪的关键帧可以提高生成序列中的 Self Forcing 运动一致性。

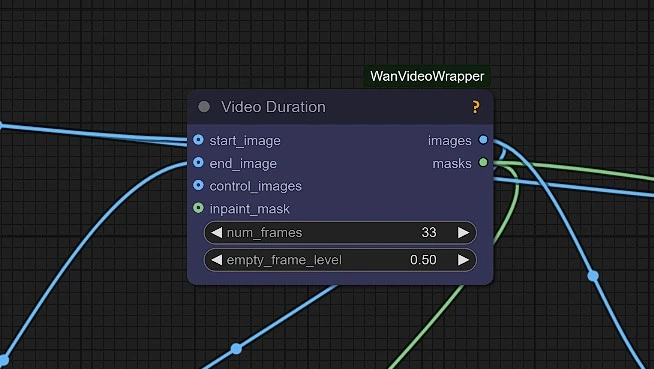

视频时长#

设置 Self Forcing 视频将生成的总帧数。

- 更长的帧数允许在 Self Forcing 中关键帧之间进行更渐进、更流畅的过渡。

- 更短的帧数产生更快的 Self Forcing 过渡。

- 典型的 Self Forcing 范围:根据所需长度和运动复杂度,16-48 帧。

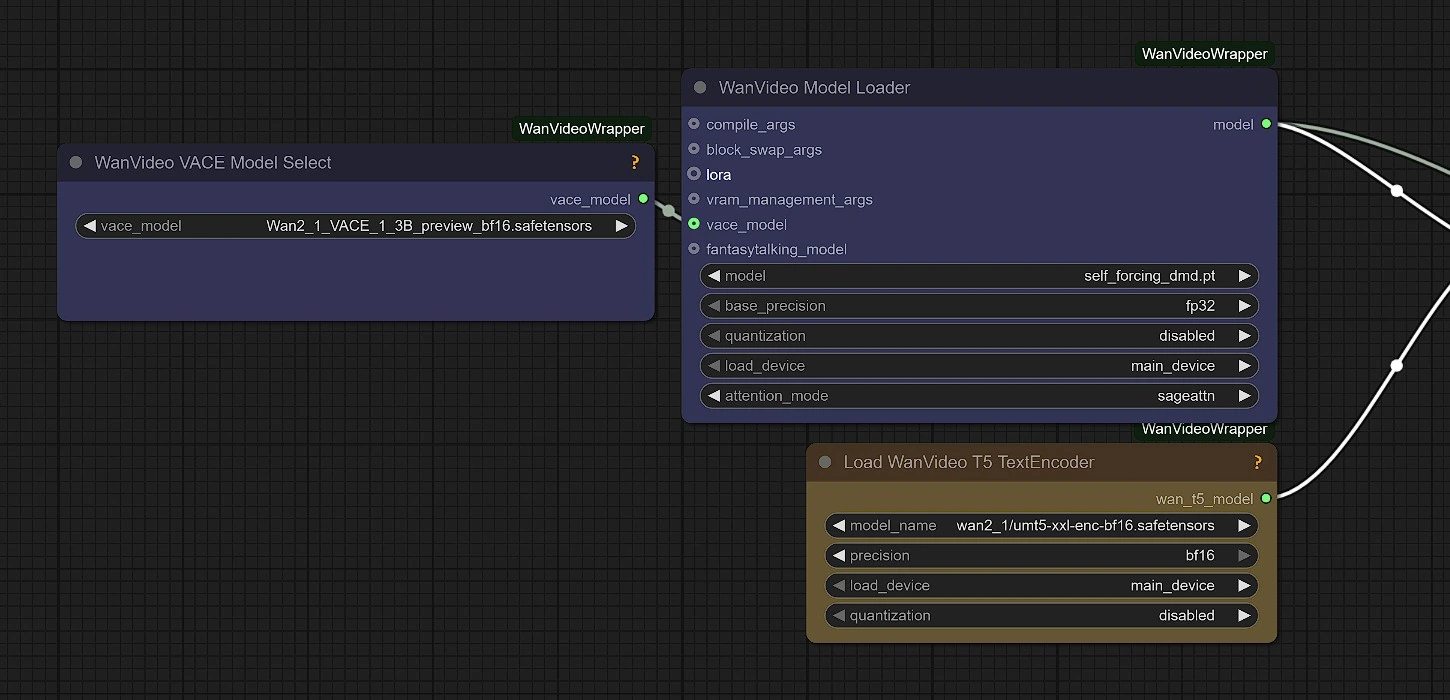

模型#

此组加载 Self Forcing 自回归视频扩散模型。Self Forcing 工作流程会自动为您选择正确的模型版本。

- Self Forcing 基于带有 KV 缓存的自回归展开构建。

- Self Forcing 确保稳定、时间一致的运动生成。

- Self Forcing 允许在 RTX 4090 等高端 GPU 上进行实时推理。

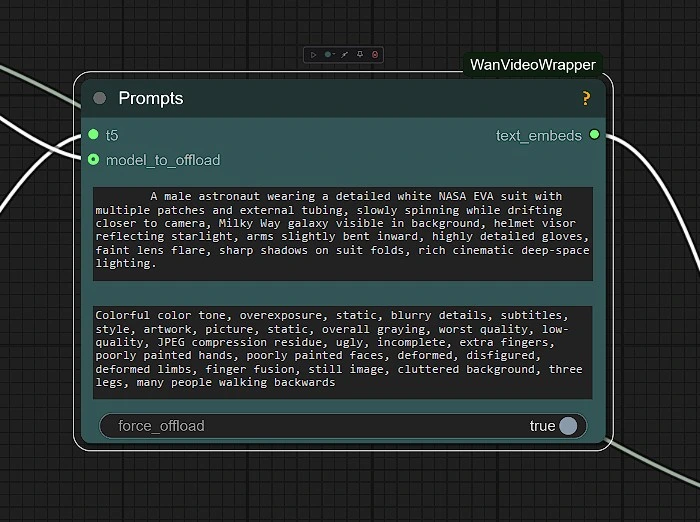

提示词#

在本节中,您可以输入文本提示来引导 Self Forcing 生成。

- 将提示与关键帧相结合,以影响 Self Forcing 的风格、背景或运动语境。

- 使用描述性和清晰的语言来最大化 Self Forcing 的创作控制。

- 也可以使用负面提示来抑制 Self Forcing 中不需要的元素。

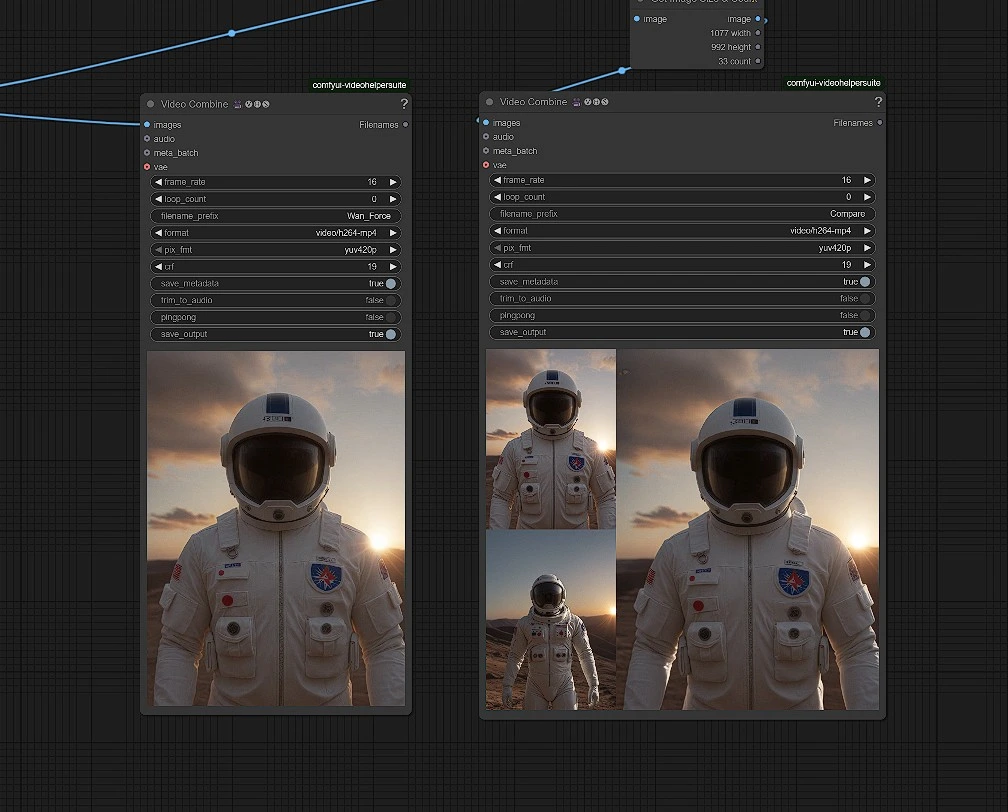

输出#

Self Forcing 生成完成后:

- Self Forcing 视频将自动保存在 ComfyUI 目录中的

Comfyui > output文件夹中。 - Self Forcing 文件以视频片段(MP4 或图像序列,取决于配置)形式存储。

致谢#

此工作流程使用由 guandeh 开发的 Self Forcing 模型。 Self Forcing 工作流程集成了 kijai 的 Wan Video Wrapper 节点,以实现 ComfyUI 内的无缝 Self Forcing 视频生成。 感谢两位作者在原始 Self Forcing 模型开发和集成工作方面的贡献。

GitHub Repository: https://github.com/guandeh17/Self-Forcing