LTX 2.3 Sulphur 图像到视频工作流程:可控运动的电影级图像到视频#

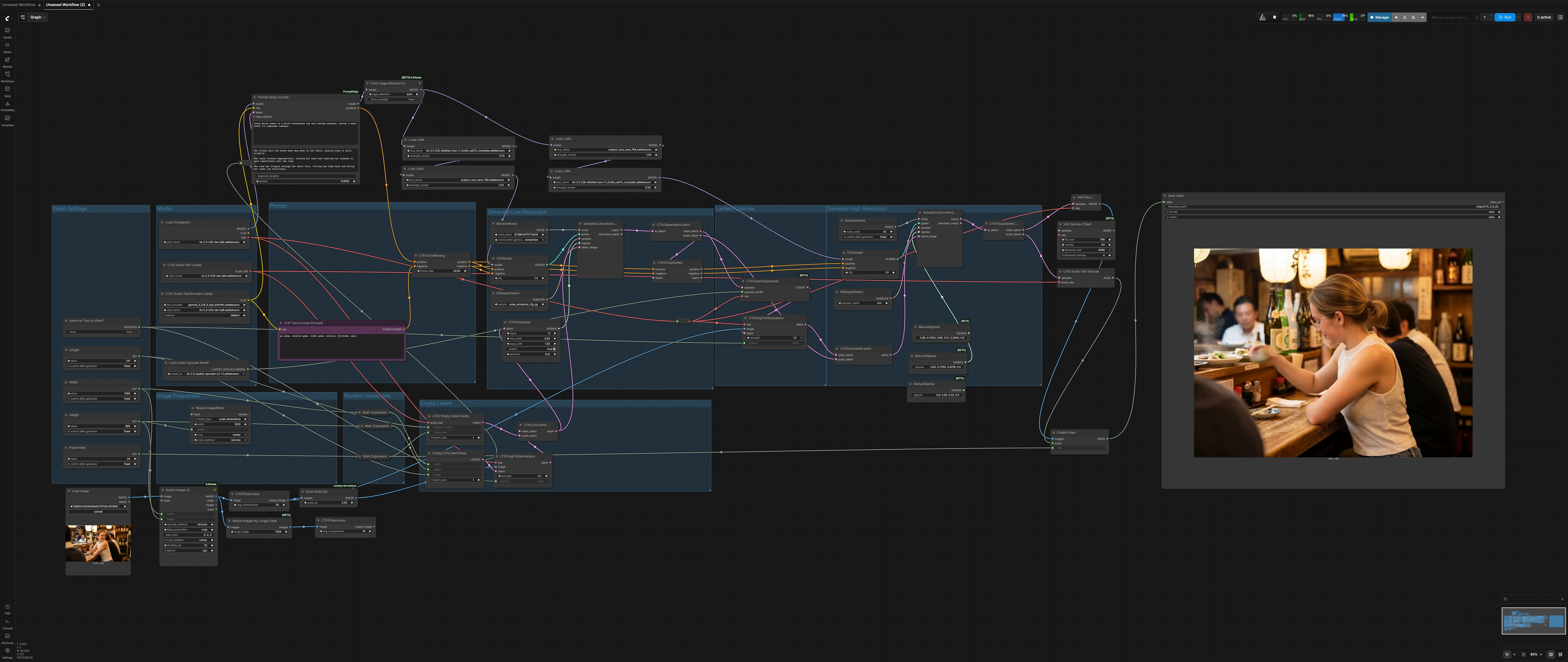

此 LTX 2.3 Sulphur 图像到视频工作流程将单个静态图像转化为可发布的电影级镜头,具有自然的微表情、可信的人物运动和稳定的大气连续性。它专为需要控制相机感觉、情绪和场景动态的叙事镜头而设计,而无需迷失在设置细节中。

该工作流程围绕 LTX-2.3 运行一个两阶段的扩散管道:一个低分辨率通过建立运动和时间安排,接着是潜在的放大和高分辨率精细化通过以实现最终细节。Sulphur 风格的 LoRA 引导外观和肤色,而提示分割支持镜头中的节奏演变。切换一个开关即可根据需要运行经典的图像到视频或纯文本到视频。

Comfyui LTX 2.3 Sulphur 图像到视频工作流程中的关键模型#

- Lightricks LTX-2.3-22B dev FP8。驱动生成和解码的基础视频扩散检查点,同时保持内存使用实用。模型卡

- LTX-2.3 空间放大器 x2。用于通过之间的潜在超分辨率模型,以保持运动同时增加空间保真度。模型页面

- Gemma 3 12B 指令调优文本编码器,包装用于 LTX-2。为全局和分段提示启用丰富的、扎实的条件。库

- Sulphur 风格 LoRA 和 LTX-2.3 蒸馏 LoRA 1.1。配对的 LoRA 稳定面部真实性和电影色调,同时保留提示控制。

如何使用 Comfyui LTX 2.3 Sulphur 图像到视频工作流程#

整体流程:设置镜头尺寸和长度,准备您的静态图像,定义一个全局提示加上可选的局部提示节奏,然后渲染。低分辨率阶段构建运动和时间安排,潜在放大器提升细节,高分辨率阶段在解码为 MP4 之前完成纹理和光照。

视频设置#

选择您的目标 宽度、高度、长度(帧数)和 帧率。尺寸设置为可以被常见的扩散网格大小整除以避免伪影。一个布尔值,切换到文本到视频?(#28),控制是否注入或绕过静态图像。保持与输入图像一致的纵横比以获得最干净的构图,特别是对于面部和手部。

图像预处理#

您的源静态图像被加载、调整大小,并通过 ImageResizeKJv2(#75)和 LTXVPreprocess(#76)轻微压缩以准备扩散。一个缩放版本被馈送到低分辨率通过以稳定运动播种,而更高细节版本可用于高分辨率通过。在生成之前使用此部分对齐构图和留白。这里的微妙预裁剪调整在更一致的视线和背景连续性上会有回报。

空潜在#

EmptyLTXVLatentVideo(#21)和 LTXVEmptyLatentAudio(#33)使用您的镜头设置构建同步的视频和音频潜在。它们由 LTXVConcatAVLatent(#32)合并以建立一个时间线框架,供下游节点精细化。音频分支创建一个静音的有效轨道,因此最终的 MP4 可以在任何地方可靠播放。这些潜在还锚定提示段,以便运动变化落在您期望的位置。

提示#

在 PromptRelayEncode(#80)中编写您的镜头描述。使用简洁的全局提示来设定整体外观,然后添加节拍特定的行作为局部提示,用 | 字符分隔,以在剪辑中演变微动作。来自 LTXAVTextEncoderLoader(#5)的 LTX 文本编码器处理语义,而 CLIPTextEncode(#41)提供一个强大的面向现实的负提示。LTXVConditioning(#31)混合正负条件并与帧速率同步。

模型#

CheckpointLoaderSimple(#44)加载 LTX-2.3 基础。PathchSageAttentionKJ(#67)优化大图像的注意力。一个简短的 LoRA 链在每个采样阶段应用 Sulphur 风格和蒸馏稳定性 LoRA。此设计在外观一致性和提示响应性之间取得了平衡,因此角色身份和光照在通过之间保持一致。

生成低分辨率#

此首次扩散通过建立运动。LTXVImgToVideoInplace(#22)将您的预处理静态图像注入时间线;如果启用了 切换到文本到视频?,其 绕过 输入干净地禁用图像注入以实现纯 T2V。LTXVScheduler(#47)形状化西格玛时间表以控制运动幅度和时间平滑度。由 CFGGuider(#42)和 KSamplerSelect(#17)驱动的 SamplerCustomAdvanced(#9)合成一个连贯的低分辨率 A/V 潜在。LTXVSeparateAVLatent(#35)然后分离视频和音频路径,并将构图信息转发给 LTXVCropGuides(#10)以进行指导感知的构图。

潜在放大#

LTXVLatentUpsampler(#13)使用 LTX-2.3 空间放大器在潜在空间中提升空间细节,同时保持从第一通过学到的运动。这里的放大避免了重新发明时间安排,并减少了通常在第二次通过再生中看到的闪烁。它将一个更清晰的、运动一致的潜在传递给最终的精细化阶段。

生成高分辨率#

精细化阶段通过 LTXVConcatAVLatent(#3)重新组合放大的视频潜在和音频潜在。CFGGuider(#8)和 KSamplerSelect(#6)在 SamplerCustomAdvanced(#36)中使用调整后的西格玛时间表来引导快速、细节导向的采样器进行完成。如果您保持图像注入启用,第二个 LTXVImgToVideoInplace(#14)帮助模型在高分辨率下尊重静态图像而不失去已建立的运动。结果是一个稳定的电影级序列,具有自然的眼睛和嘴巴动态。

输出#

VAEDecode(#68)将最终视频潜在转化为帧,而 LTXVAudioVAEDecode(#23)重建静音音轨。CreateVideo(#38)以您选择的帧速率将帧和音频混合,SaveVideo(#45)写入 H.264 MP4 以便立即审阅和共享。使用每个镜头的描述性文件名前缀来保持迭代的组织。

数字转换#

一个小型实用模块计算半比例尺寸以管理 VRAM 和速度。通常您不需要触及这些,但它们确保上游的宽度和高度驱动一切一致。如果您更改基础分辨率,这些会自动调整。

Comfyui LTX 2.3 Sulphur 图像到视频工作流程中的关键节点#

PromptRelayEncode(#80)。集中全局提示和与时间线对齐的逐节拍局部提示。用它来编写镜头中的微表情和小相机揭示。保持局部提示简短且具体,以便它们补充而不是对抗全局外观。LTXVImgToVideoInplace(#22, #14)。将静态图像注入低分辨率和高分辨率潜在。增加强度当您希望最终紧贴参考帧时;减少它以获得更多自由。绕过输入连接到文本到视频开关,因此您可以干净地禁用图像注入以进行 T2V 运行。LTXVScheduler(#47)。控制噪声水平在低分辨率通过中的演变,直接影响运动强度和平滑度。用它来驯服过于活跃的镜头或在感觉静止时添加微妙的推动。此处的调整在面部、头发和手持类似相机能量上最为显著。LTXVLatentUpsampler(#13)。使用 LTX 的空间放大器执行 x2 潜在放大,保留在第一次通过中学习的运动提示。在高分辨率精细化之前使用它来添加清晰的纹理和边缘定义,而不重新滚动时间。CFGGuider(#42, #8)。平衡模型对您的提示的遵循强度与其学习的先验。如果面部漂移或风格减弱,微调指导;如果细节看起来过于强迫或塑料,放松它。与快速查看负提示配对变化以保持现实感。KSamplerSelect(#17, #6)。让您为每个阶段选择采样算法。为低分辨率通过选择一个强大、富有表现力的采样器,为完成通过选择一个快速、细节友好的选项。在比较外观时保持选择一致。

可选附加项#

- 为了有意的相机行为,您可以在需要一致的横向推动时向您的 LoRA 加载器链中添加一个相机控制 LoRA,如 LTX 家族中的 Dolly-Left。模型页面

- 保持宽度和高度可被 32 整除以避免潜在操作中的错位并保持 VRAM 效率。

- 在局部提示中使用简短、主动的动词来编排节拍,例如收紧握力、移开视线、柔化微笑。

- 如果您目标非常高的输出尺寸,请考虑用

VAEDecodeTiled(#43)替换VAEDecode以更高效地解码帧。 - 当面部最重要时,通过仅调整提示文本和

CFGGuider来迭代,而不是更改采样器或分辨率。这保持比较有意义,并突出最佳的 LTX 2.3 Sulphur 图像到视频工作流程的措辞。

致谢#

此工作流程实现并构建在以下作品和资源之上。我们感谢 RunningHub 提供的工作流程参考,Lightricks 提供的 LTX 2.3 家族(模型、空间放大器和相机控制 LoRA),以及 Comfy-Org 提供的 LTX 文本编码器,感谢他们的贡献和维护。有关权威详细信息,请参阅以下链接的原始文档和库。

资源#

- RunningHub/RunningHub 工作流程参考

- 文档 / 发布说明: runninghub.ai post

- Lightricks/LTX 2.3 模型来源

- Hugging Face: Lightricks/LTX-2.3-fp8

- Lightricks/LTX 2.3 空间放大器来源

- Hugging Face: Lightricks/LTX-2.3

- Lightricks/LTX 相机控制 LoRA 来源

- Hugging Face: Lightricks/LTX-2-19b-LoRA-Camera-Control-Dolly-Left

- Comfy-Org/LTX 文本编码器来源

- Hugging Face: Comfy-Org/ltx-2

注意:使用参考的模型、数据集和代码需遵循其作者和维护者提供的相应许可和条款。