ComfyUI Vid2Vid 舞蹈传输是一个强大的 ComfyUI Vid2Vid 工作流程,允许用户将真实视频风格化并转化为各种对象或元素。通过这个工作流程,您可以通过将源视频的动作和风格传输到目标图像或对象上,创造惊艳的视频动画。本教程将指导您完成所需的关键组件和设置,以实现最佳效果。

致谢

感谢 MDMZ 和 DP 在创建此工作流程中做出的杰出贡献!MDMZ 通过他的 YouTube 教程 Transform Videos with AI: Dancing Noodles Step-by-Step Tutorial 分享了他的 ComfyUI Vid2Vid 舞蹈传输工作流程,该教程基于 DP 的原始 DP's - Vid2Vid AniamteDiff LCM dance transfer 工作流程。

1. ComfyUI Vid2Vid 舞蹈传输工作流程的功能是什么?#

ComfyUI Vid2Vid 舞蹈传输工作流程可以将真实视频转化为风格化动画。它将源视频中的动作和舞蹈动作传输到您选择的目标图像或对象上。

2. ComfyUI Vid2Vid 工作流程的关键组件#

2.1 上传视频和创建遮罩#

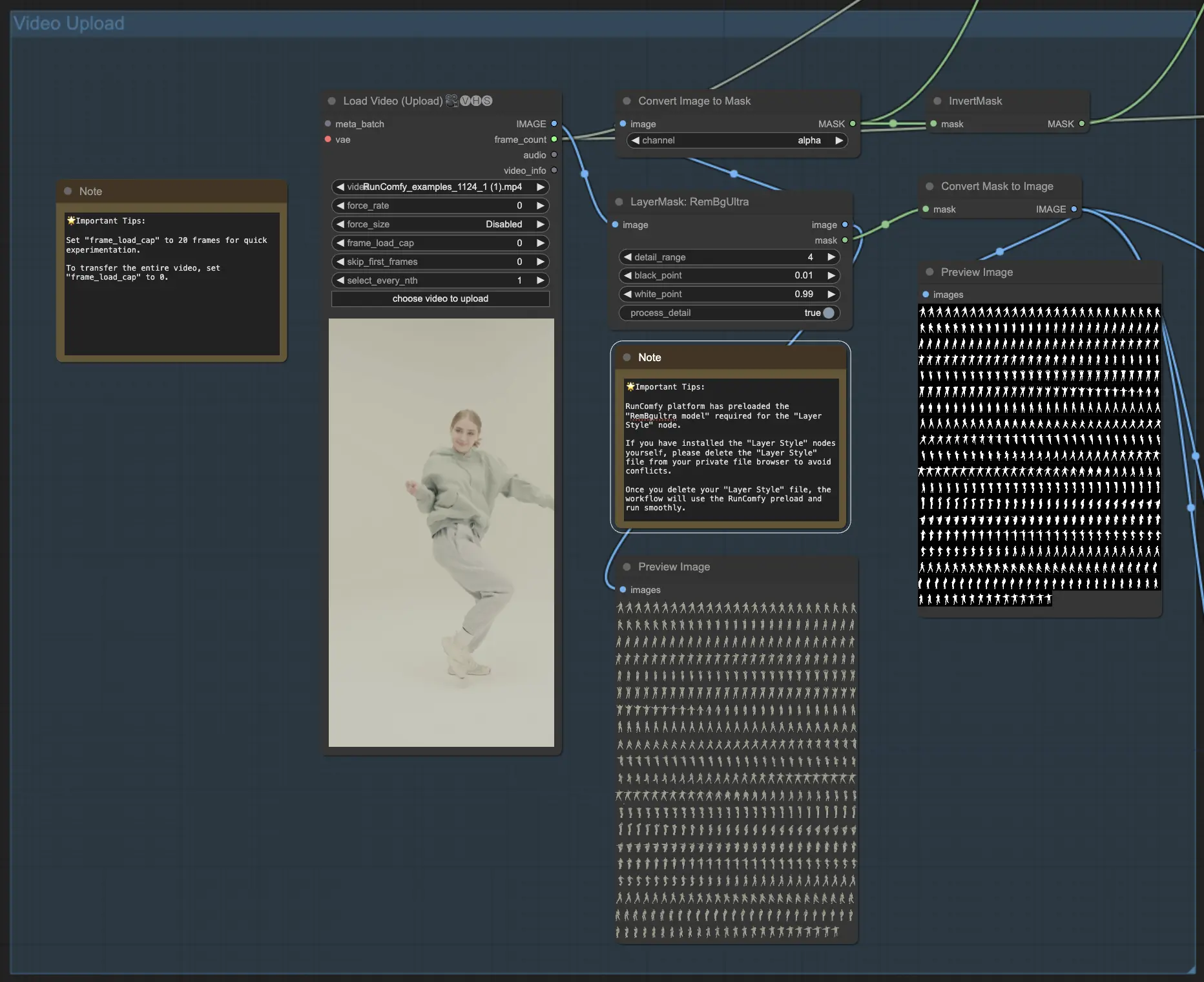

- ComfyUI Vid2Vid 工作流程从 VHS_LoadVideo 组件开始,您可以在此上传包含您希望传输的舞蹈动作的源视频。

- LayerMask: RemBgUltra 组件用于从视频帧中移除背景并创建主体的黑白遮罩。此遮罩对于正确识别和传输动作至关重要。

- ImageToMask 和 MaskToImage 组件在 ComfyUI Vid2Vid 工作流程中根据需要在图像和遮罩格式之间转换。

- 🌟 重要提示:RunComfy 平台已预加载 "RemBgultra model" 以供 "Layer Style" 节点使用。如果您自行安装了 "Layer Style" 节点,请从您的私人文件浏览器中删除 "Layer Style" 文件以避免冲突。一旦删除了您的 "Layer Style" 文件,工作流程将使用 RunComfy 预加载并顺利运行。

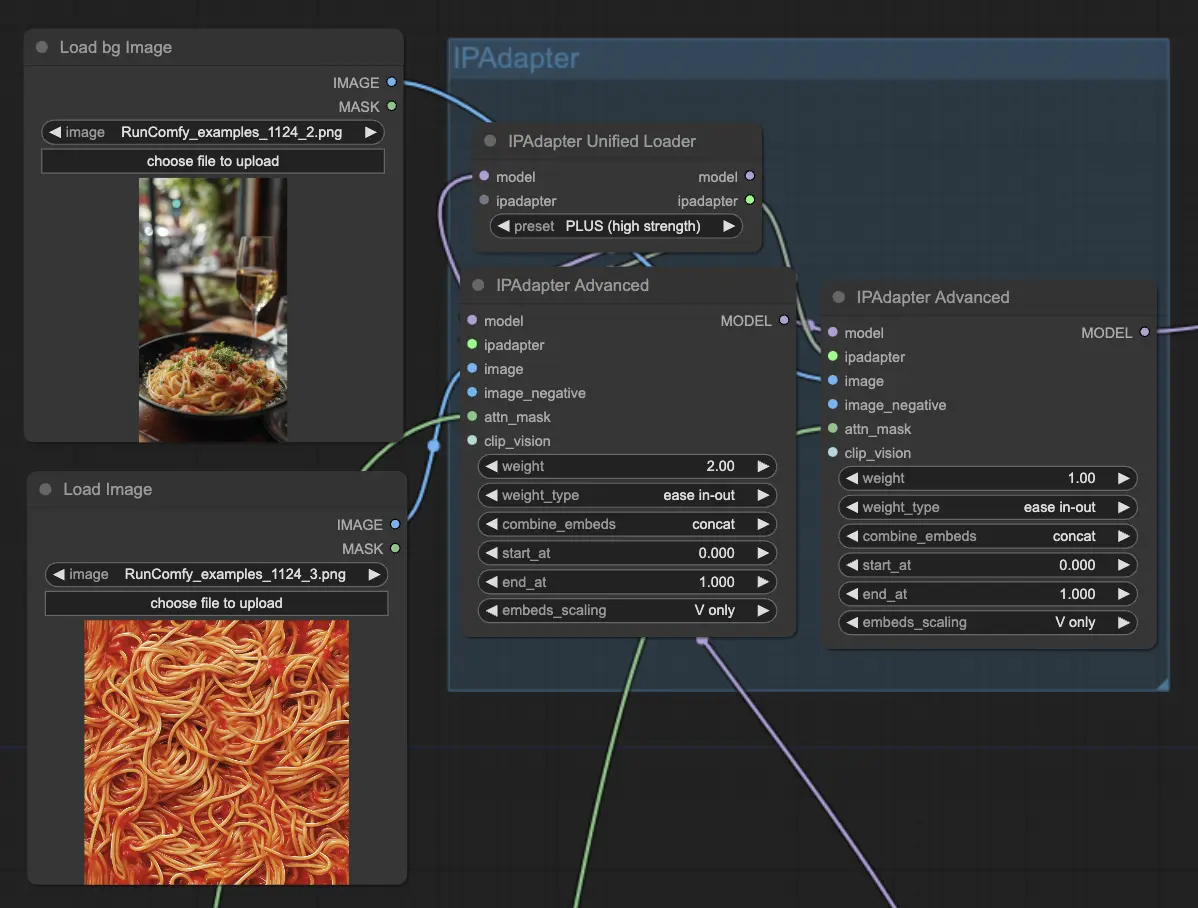

2.2 使用 IPAdapter 配置目标图像#

- IPAdapterAdvanced 组件用于加载和配置将接收 ComfyUI Vid2Vid 舞蹈传输的目标图像或对象。您可以使用 LoadImage 节点上传目标图像,并使用 LoadBgImage 节点上传目标背景图像。

- IPAdapterUnifiedLoader 用于加载 IPAdapter,确定目标图像对输出的影响强度。

2.3 使用 AnimateDiff 进行动作传输#

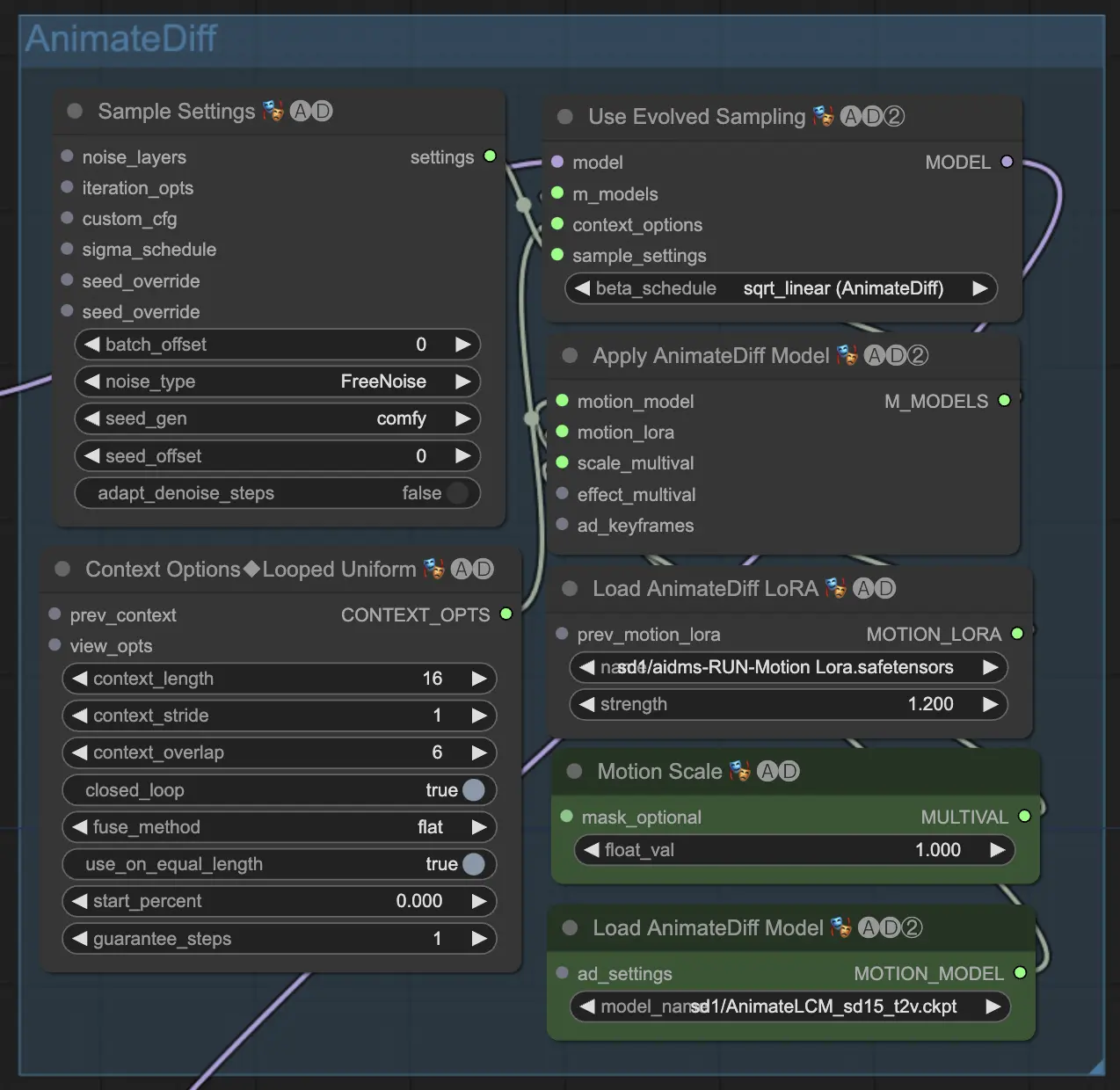

- ComfyUI Vid2Vid 舞蹈传输的核心由 AnimateDiff Latent Condition Model (LCM) 驱动。它通过 ADE_LoadAnimateDiffModel 组件在 ComfyUI Vid2Vid 中加载。

- 其他组件如 ADE_AnimateDiffSamplingSettings、ADE_LoopedUniformContextOptions 和 ADE_ApplyAnimateDiffModelSimple 分别用于在 ComfyUI Vid2Vid 中配置采样设置、上下文选项并应用 AnimateDiff 模型。

- ADE_UseEvolvedSampling 组件用于选择 AnimateDiff 模型在 ComfyUI Vid2Vid 中的适当采样方法。

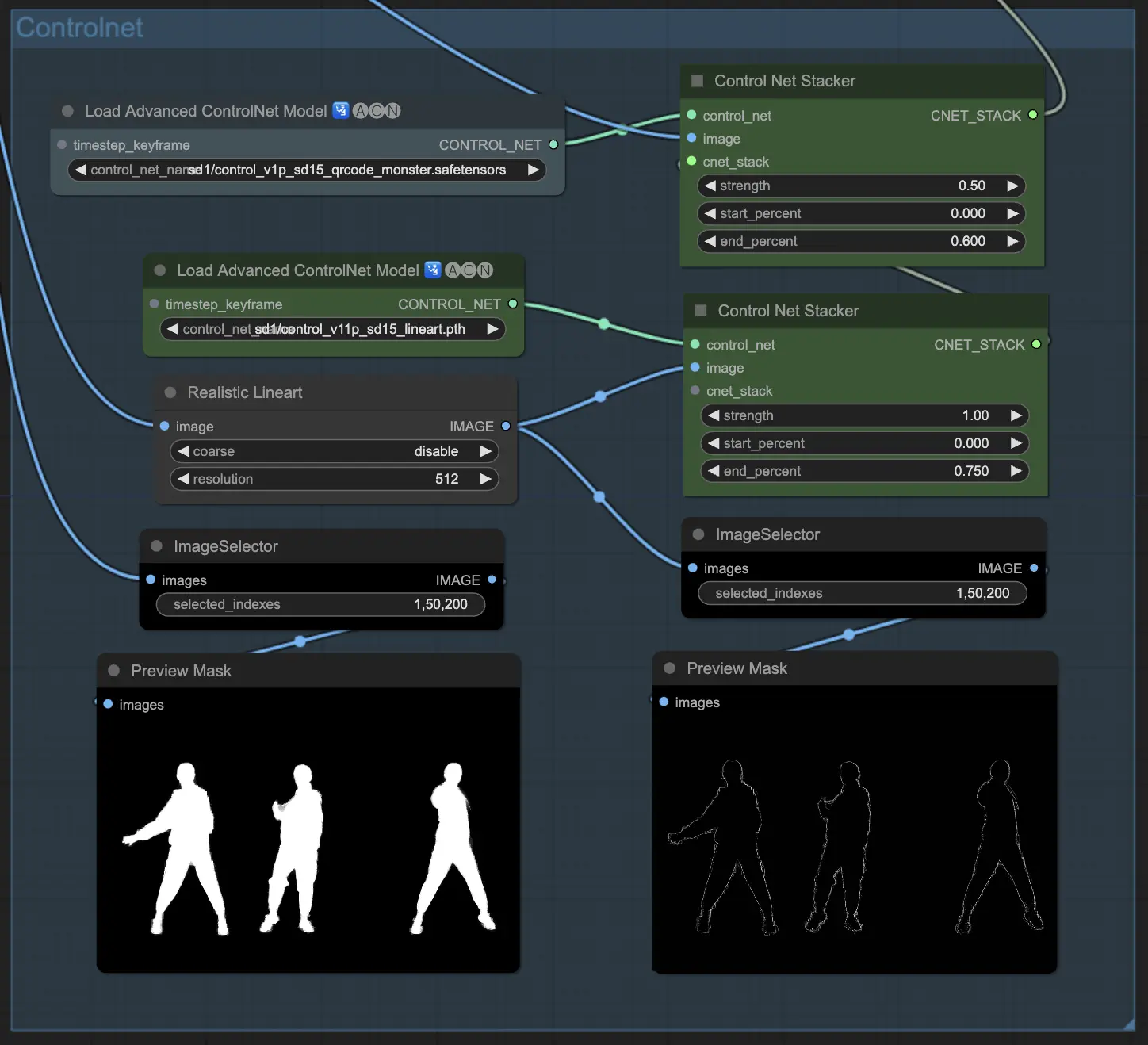

2.4 使用 ControlNet 指导输出#

- ControlNet 用于在输出动画中指导和定义主体的形状和轮廓。

- ControlNetLoaderAdvanced 组件用于加载 ControlNet 模型。此工作流程使用了两个 ControlNet 模型:QR Code Monster 和 Lineart。

- ControlNet Stacker 组件用于在 ComfyUI Vid2Vid 传输中以可调整的强度堆叠和组合 ControlNet 输出。

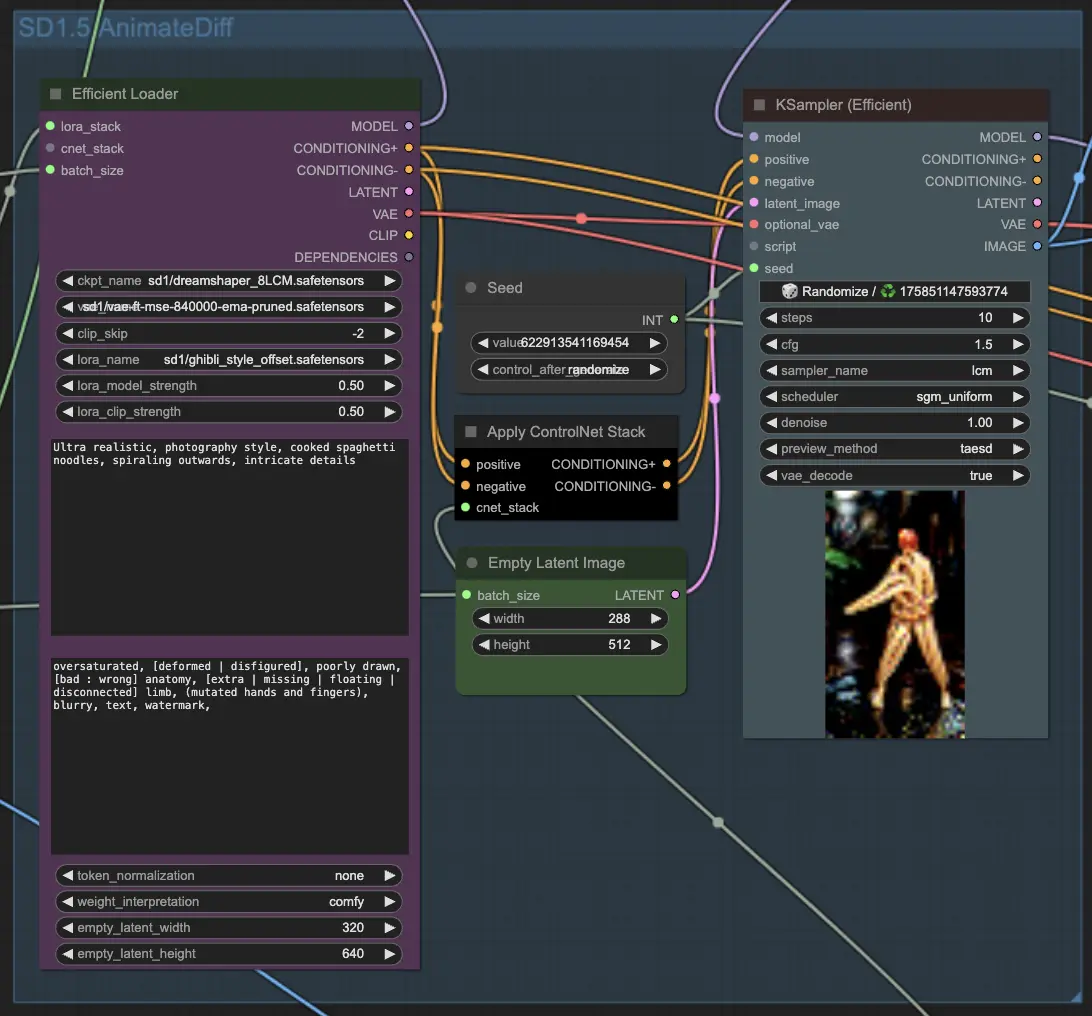

2.5 使用 KSampler 生成输出帧#

- ComfyUI Vid2Vid 中的 KSampler (Efficient) 组件负责根据所有提供的配置和输入生成输出帧。

- 主要的 KSampler 组件处理视频帧以创建动画预览。它将 AnimateDiff 模型、IPAdapter 输出、ControlNet 堆栈和其他设置作为输入。

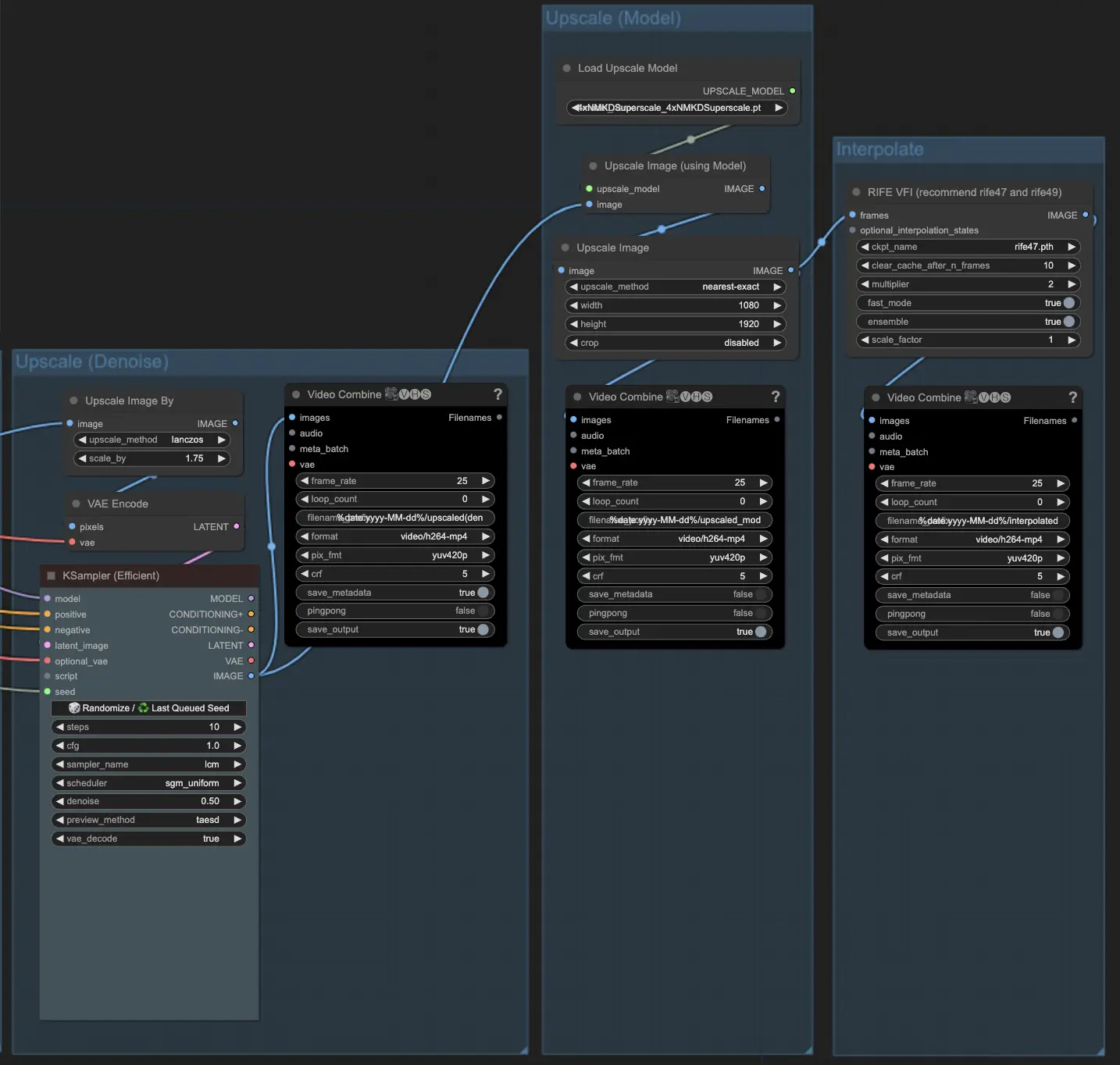

- 第二个 KSampler 组件用于对 ComfyUI Vid2Vid 输出帧进行放大和去噪。

2.6 如有需要进行放大#

- ImageScaleBy 组件用于放大输出帧的分辨率。ImageUpscaleWithModel 组件用于使用选定的放大模型进一步放大帧。工作流程默认禁用放大组件。如果需要,可以启用这些组件以获得更好的结果。