LTX 2.3 LoRA ComfyUI Inferência: saída LoRA do AI Toolkit compatível com treinamento com o pipeline LTX 2.3#

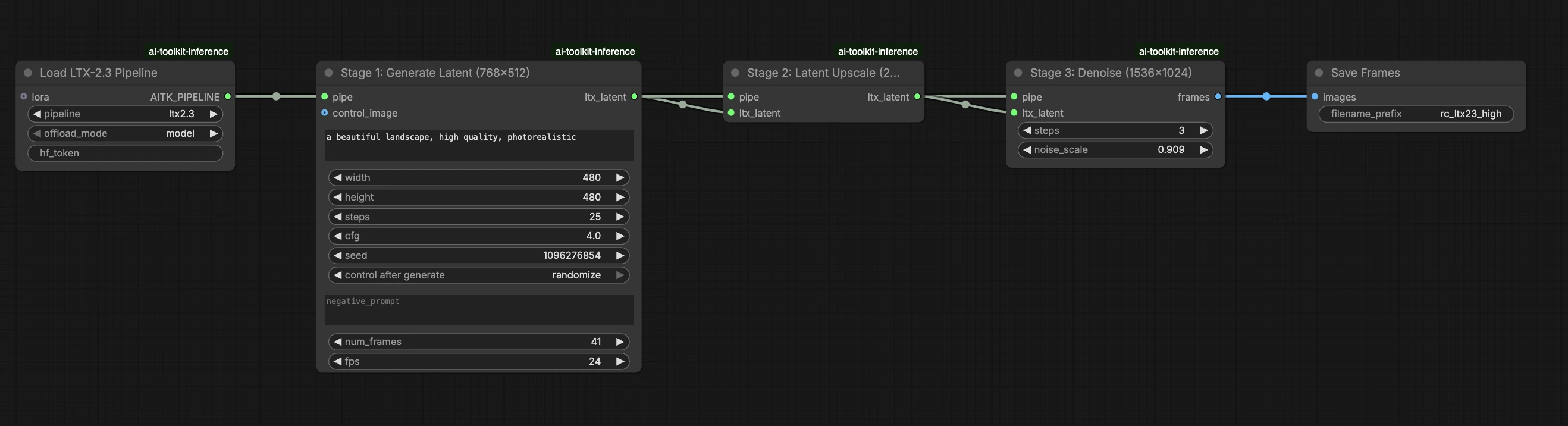

Este workflow RunComfy pronto para produção executa a inferência LTX 2.3 LoRA no ComfyUI através de RC LTX 2.3 (LTX2Pipeline) (alinhamento a nível de pipeline, não um gráfico de amostragem genérico). O RunComfy construiu e disponibilizou este nó personalizado em código aberto—veja os repositórios runcomfy-com—e você controla a aplicação do adaptador com lora_path e lora_scale.

Nota: Este workflow requer uma máquina 2X Large ou maior para rodar.

Por que a inferência LTX 2.3 LoRA ComfyUI muitas vezes parece diferente no ComfyUI#

As pré-visualizações de treinamento do AI Toolkit são renderizadas através de um pipeline específico do modelo LTX 2.3, onde a codificação de texto, o agendamento e a injeção LoRA são projetados para funcionar juntos. No ComfyUI, reconstruir o LTX 2.3 com um gráfico diferente (ou um caminho de carregador LoRA diferente) pode mudar essas interações, então copiar o mesmo prompt, passos, CFG e seed ainda produz desvios visíveis. Os nós do pipeline RC RunComfy fecham essa lacuna executando o LTX 2.3 de ponta a ponta no LTX2Pipeline e aplicando seu LoRA dentro desse pipeline, mantendo a inferência alinhada com o comportamento de pré-visualização. Fonte: Repositórios de código aberto do RunComfy.

Como usar o workflow de inferência LTX 2.3 LoRA ComfyUI#

Passo 1: Obtenha o caminho LoRA e carregue-o no workflow (2 opções)#

Opção A — Resultado de treinamento RunComfy → download para ComfyUI local:

- Vá para Treinador → Ativos LoRA

- Encontre o LoRA que você deseja usar

- Clique no menu ⋮ (três pontos) à direita → selecione Copiar Link LoRA

- Na página de workflow do ComfyUI, cole o link copiado no campo de entrada Download no canto superior direito da interface

- Antes de clicar em Download, certifique-se de que a pasta de destino está definida como ComfyUI > models > loras (esta pasta deve ser selecionada como destino de download)

- Clique em Download — isso garante que o arquivo LoRA seja salvo no diretório correto

models/loras - Após o término do download, atualize a página

- O LoRA agora aparece no dropdown de seleção LoRA no workflow — selecione-o

Opção B — URL direto LoRA (sobrepõe a Opção A):

- Cole o URL direto de download

.safetensorsno campo de entradapath / urldo nó LoRA - Quando um URL é fornecido aqui, ele sobrepõe a Opção A — o workflow carrega o LoRA diretamente do URL em tempo de execução

- Nenhum download local ou colocação de arquivo é necessário

Dica: confirme que o URL resolve para o arquivo .safetensors real (não uma página de destino ou redirecionamento).

Passo 2: Combine os parâmetros de inferência com suas configurações de exemplo de treinamento#

No nó LoRA, selecione seu adaptador em lora_path (Opção A), ou cole um link direto .safetensors em path / url (Opção B sobrepõe o dropdown). Em seguida, defina lora_scale para a mesma força que você usou durante as pré-visualizações de treinamento e ajuste a partir daí.

Os parâmetros restantes estão no nó Generate (e, dependendo do gráfico, o nó Load Pipeline):

prompt: seu prompt de texto (inclua palavras de ativação se você treinou com elas)width/height: resolução de saída; combine com o tamanho da pré-visualização de treinamento para a comparação mais limpa (múltiplos de 32 são recomendados para LTX 2.3)num_frames: número de quadros de vídeo de saídasample_steps: número de passos de inferência (30 é um padrão comum)guidance_scale: valor de CFG/orientação (5.5 é um padrão comum; não exceda 7)seed: seed fixa para reproduzir; mude para explorar variaçõesseed_mode(somente se presente): escolhafixedourandomizeframe_rate: FPS de saída; mantenha consistente com as configurações de treinamento para alinhamento de movimento

Dica de alinhamento de treinamento: se você personalizou os valores de amostragem durante o treinamento (seed, guidance_scale, sample_steps, palavras de ativação, resolução), espelhe esses valores exatos aqui. Se você treinou no RunComfy, abra Treinador → Ativos LoRA > Config para ver o YAML resolvido e copie as configurações de pré-visualização/exemplo nos nós do workflow.

Passo 3: Execute a inferência LTX 2.3 LoRA ComfyUI#

Clique em Queue/Run — o nó SaveVideo grava os resultados na sua pasta de saída do ComfyUI.

Lista de verificação rápida:

- ✓ LoRA está: baixado em

ComfyUI/models/loras(Opção A), ou carregado via um URL direto.safetensors(Opção B) - ✓ Página atualizada após o download local (somente Opção A)

- ✓ Parâmetros de inferência compatíveis com a configuração de

samplede treinamento (se personalizado)

Se tudo acima estiver correto, os resultados de inferência aqui devem corresponder de perto às suas pré-visualizações de treinamento.

Solução de problemas de inferência LTX 2.3 LoRA ComfyUI#

A maioria das diferenças "pré-visualização de treinamento vs inferência ComfyUI" do LTX 2.3 vem de diferenças a nível de pipeline (como o modelo é carregado, agendado e como o LoRA é mesclado), não de um único botão errado. Este workflow RunComfy restaura a base "compatível com treinamento" mais próxima ao executar inferência através de RC LTX 2.3 (LTX2Pipeline) de ponta a ponta e aplicar seu LoRA dentro desse pipeline via lora_path / lora_scale (em vez de empilhar nós de carregador/amostrador genéricos).

(1) Mismatches de forma LoRA ou avisos "chave não carregada"#

Por que isso acontece O LoRA foi treinado para uma família de modelos diferente ou uma variante LTX diferente. Você verá muitas linhas lora key not loaded e potencialmente erros de incompatibilidade de forma.

Como corrigir (recomendado)

- Certifique-se de que o LoRA foi treinado especificamente para LTX 2.3 com AI Toolkit (LoRAs LTX 2.0 / 2.1 / 2.2 não são intercambiáveis).

- Mantenha o gráfico "caminho único" para LoRA: carregue o adaptador somente através da entrada

lora_pathdo workflow e deixe LTX2Pipeline lidar com a mesclagem. Não empilhe um carregador genérico LoRA adicional em paralelo. - Se você já encontrou uma incompatibilidade e o ComfyUI começou a produzir erros CUDA/OOM não relacionados, reinicie o processo ComfyUI para redefinir completamente o estado do GPU + modelo, então tente novamente com um LoRA compatível.

(2) Resultados de inferência não correspondem às pré-visualizações de treinamento#

Por que isso acontece Mesmo quando o LoRA é carregado, os resultados ainda podem desviar se seu gráfico ComfyUI não corresponder ao pipeline de pré-visualização de treinamento (diferentes padrões, diferente caminho de injeção LoRA, diferente agendamento).

Como corrigir (recomendado)

- Use este workflow e cole seu link direto

.safetensorsemlora_path. - Copie os valores de amostragem da sua configuração de treinamento do AI Toolkit (ou RunComfy Treinador → Ativos LoRA Config):

width,height,num_frames,sample_steps,guidance_scale,seed,frame_rate. - Mantenha "pilhas de velocidade extra" fora da comparação, a menos que você tenha treinado/amostrado com elas.

(3) Usar LoRAs aumenta significativamente o tempo de inferência#

Por que isso acontece Um LoRA pode tornar o LTX 2.3 muito mais lento quando o caminho LoRA força trabalho extra de patching/dequantization ou aplica pesos em um caminho de código mais lento do que o modelo base sozinho.

Como corrigir (recomendado)

- Use o caminho RC LTX 2.3 (LTX2Pipeline) deste workflow e passe seu adaptador através de

lora_path/lora_scale. Nesta configuração, o LoRA é mesclado uma vez durante o carregamento do pipeline (estilo AI Toolkit), então o custo de amostragem por passo permanece próximo ao modelo base. - Quando você está buscando comportamento compatível com a pré-visualização, evite empilhar vários carregadores LoRA ou misturar caminhos de carregador. Mantenha para um

lora_path+ umlora_scaleaté que a base corresponda.

(4) Erros de OOM em resoluções grandes ou vídeos longos#

Por que isso acontece LTX 2.3 é um modelo de 22B parâmetros e a geração de vídeo é intensiva em VRAM. Altas resoluções ou muitos quadros podem exceder a memória da GPU, especialmente com sobrecarga LoRA.

Como corrigir (recomendado)

- Use uma máquina 2X Large (80 GB VRAM) ou maior. Este workflow não é compatível com máquinas Medium, Large ou X Large.

- Reduza a resolução ou a contagem de quadros se você precisar iterar rapidamente, então aumente para renderizações finais.

- Ative o VAE tiling se disponível — pode economizar ~3 GB VRAM com perda mínima de qualidade.

Execute a inferência LTX 2.3 LoRA ComfyUI agora#

Abra o workflow, defina lora_path e clique em Queue/Run para obter resultados LTX 2.3 LoRA que ficam próximos às suas pré-visualizações de treinamento do AI Toolkit.