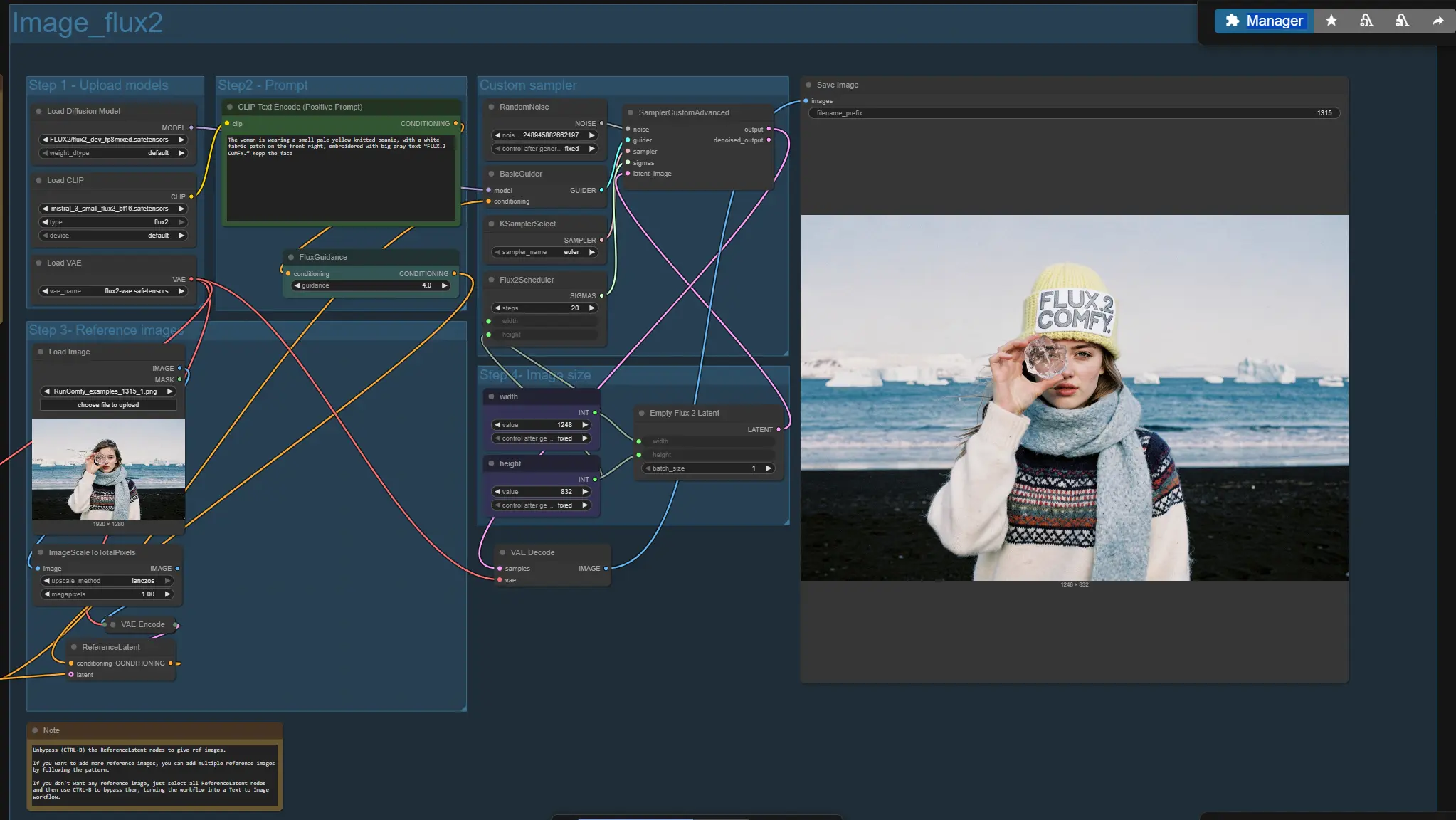

Flux 2 Dev workflow di generazione e modifica multi-riferimento per ComfyUI#

Questo workflow porta la potenza di FLUX.2 Dev a ComfyUI per la generazione di immagini da testo ad alta fedeltà e la modifica di immagini multi-riferimento. È progettato per i creatori che necessitano di dettagli fotorealistici, identità coerente e forte aderenza ai prompt per scatti di prodotto, rendering di personaggi, visual pubblicitari e arte concettuale. Puoi eseguire un branch standard o un branch più leggero FP8, mantenere coerenti layout e materiali e scalare fino a output multi-megapixel.

Flux 2 Dev combina prompt precisi con controllo basato su riferimenti, così puoi mantenere continuità stilistica e di design tra le variazioni. Il grafico include slot di riferimento pronti all'uso, dimensionamento flessibile delle immagini e un percorso di campionamento personalizzato che bilancia qualità e velocità. Funziona bene per ideazione iterativa, coerenza a livello di scena e risultati di qualità di produzione su GPU consumer.

Modelli chiave nel workflow ComfyUI Flux 2 Dev#

- Modello di diffusione FLUX.2 Dev. Lo scheletro di generazione visiva a peso aperto utilizzato per entrambe le modifiche guidate e da testo a immagine. Fonte: black-forest-labs/FLUX.2-dev.

- Codificatore di testo Mistral 3 Small Flux2 (build bf16 e fp8). Converte il tuo prompt in token embedding ottimizzati per Flux 2 Dev; la variante FP8 riduce la VRAM per il branch leggero. Pesi di esempio: Comfy-Org/flux2-dev/text_encoders.

- FLUX.2 VAE. Comprimi e ricostruisci immagini dallo spazio latente con alta qualità percettiva. Pesi: Comfy-Org/flux2-dev/vae.

Come usare il workflow ComfyUI Flux 2 Dev#

Il grafico contiene due branch paralleli. "Image_flux2" è il percorso standard; "Image_flux2_fp8" è una variante più leggera che sostituisce un codificatore di testo FP8 per risparmiare memoria. Usa un branch alla volta dal prompt al salvataggio. Entrambi i branch condividono la stessa logica complessiva: carica i modelli, crea un prompt, opzionalmente aggiungi una o più immagini di riferimento, scegli la dimensione dell'immagine, campiona e salva.

Passo 1 - Carica i modelli#

Il workflow carica automaticamente il modello di diffusione Flux 2 Dev, un codificatore di testo compatibile con Flux 2 Dev e il Flux 2 VAE. Nel branch standard questi sono gestiti da UNETLoader (#12), CLIPLoader (#38) e VAELoader (#10). Nel branch FP8 sono rispecchiati da UNETLoader (#86), CLIPLoader (#90) e VAELoader (#70). Di solito non hai bisogno di toccarli a meno che tu non voglia cambiare i pesi.

Passo 2 - Prompt#

Scrivi la tua descrizione in CLIP Text Encode (Positive Prompt) (#6) o (#85). Buoni prompt nominano il soggetto, la composizione, i materiali, l'illuminazione e lo stile desiderato (per esempio, luce chiave da studio, ombre morbide, plastica lucida, ampia apertura). Flux 2 Dev risponde bene a sostantivi chiari e tag stilistici concisi e può preservare istruzioni di layout e tipografia quando dichiarati in modo inequivocabile. Mantieni il prompt semplice quando vuoi che le immagini di riferimento dominino; diventa più descrittivo quando vuoi una guida creativa più forte.

Passo 3 - Immagini di riferimento#

Il supporto di riferimento è integrato in modo che tu possa guidare l'identità, lo stile o la continuità del design. Inserisci le immagini nei nodi LoadImage, che sono preprocessate per dimensione, codificate in latenti e fuse nel condizionamento tramite nodi ReferenceLatent concatenati. Usa il modello mostrato per aggiungere più riferimenti nel branch FP8 (il layout scala a molti riferimenti). Per disabilitare completamente i riferimenti, bypassa tutti i nodi ReferenceLatent e ottieni un comportamento puro da testo a immagine.

Campionatore personalizzato#

Il campionamento è orchestrato da SamplerCustomAdvanced con un campionatore selezionabile (KSamplerSelect) e il programmatore Flux 2. Un nodo RandomNoise fornisce semi deterministici per la riproducibilità. Il programmatore guida la traiettoria di denoising mentre il guida condiziona il modello con il tuo prompt e latenti di riferimento. Questo percorso è ottimizzato per fornire dettagli nitidi e struttura coerente rimanendo interattivo per iterazioni rapide.

Dimensione dell'immagine#

I controlli di larghezza e altezza alimentano sia il programmatore che la tela latente, così il modello denoisa alla risoluzione prevista. Flux 2 Dev mira comodamente a 1–4 megapixel; inizia più piccolo per lo sviluppo del look e scala quando ti piace l'inquadratura. Mantieni l'aspetto proporzionato al tuo soggetto e alle immagini di riferimento per preservare composizione e indizi di identità.

Risultati#

Dopo il campionamento, i latenti sono decodificati dal VAE e scritti da SaveImage. Esegui di nuovo con lo stesso seme per continuità tra i take, o cambia il seme per nuove variazioni mantenendo lo stesso prompt e riferimenti.

Nodi chiave nel workflow ComfyUI Flux 2 Dev#

CLIP Text Encode (Positive Prompt) (#6, #85)#

Codifica il tuo testo in embedding usando il codificatore di testo compatibile con Flux 2 Dev. Sostantivi forti e termini chiari di materiale e illuminazione forniscono la guida più affidabile. Se i riferimenti sono molto utilizzati, mantieni i prompt concisi in modo che completino piuttosto che contrastare i riferimenti.

FluxGuidance (#26, #75)#

Applica la forza di condizionamento specifica di Flux che bilancia l'influenza del prompt rispetto ai priori del modello e ai riferimenti. Aumenta la guida per un'aderenza più stretta al prompt; riducila quando le immagini di riferimento dovrebbero dominare. Regola a piccoli passi e ri-esegui un paio di semi per confermare la stabilità tra gli output.

ReferenceLatent (#39, #43, #83, #84)#

Inietta latenti di riferimento codificati nel flusso di condizionamento per preservare indizi di identità, stile o layout. Usa più riferimenti concatenando i nodi seguendo il modello esistente. Bypassa nodi individuali per testare il contributo di ciascun riferimento o per passare tra modalità solo testo e multi-riferimento.

Flux2Scheduler (#48, #67)#

Crea il programma sigma su misura per Flux 2 Dev e la risoluzione scelta. Più passaggi generalmente scambiano velocità per dettaglio e stabilità. Cambia programma e campionatore con parsimonia in modo che tu possa attribuire miglioramenti a una variabile alla volta.

KSamplerSelect (#16, #81)#

Seleziona l'algoritmo del campionatore usato dal campionatore personalizzato. Euler è un solido predefinito per una vasta gamma di soggetti. Cambia campionatori solo quando stai cercando un look o un comportamento specifico; mantieni costanti altre impostazioni quando confronti.

SamplerCustomAdvanced (#13, #80)#

Esegue il ciclo di denoising con il campionatore, il programma, il guida e la tela latente. Le leve chiave che rivisiterai qui sono steps, sampler e il seed proveniente dal nodo del rumore. Quando esplori una scena, cambia solo uno di questi alla volta per capire il suo effetto.

EmptyFlux2LatentImage (#47, #79)#

Definisce la tela latente usata per il denoising alla tua larghezza e altezza target. Tele più grandi aumentano il dettaglio ma aumentano anche l'uso della VRAM e il tempo per immagine. Abbina il rapporto d'aspetto della tela al tuo soggetto per composizioni più naturali.

Extra opzionali#

- Scegli il branch FP8 quando la VRAM è stretta, poi passa al branch standard per i render finali.

- Per compiti pesanti sull'identità, mantieni i prompt brevi e fornisci immagini di riferimento pulite e ben illuminate.

- Blocca il seme per mantenere la consistenza tra le variazioni; cambia il seme per esplorare alternative.

- Inizia a una risoluzione più piccola per trovare l'inquadratura, poi scala fino a output multi-megapixel per la qualità finale.

- Se più riferimenti confliggono, prova a riordinare o bypassare temporaneamente alcuni per vedere quale porta l'aspetto che desideri.

- Salva semi, prompt e set di riferimenti di successo come preset riutilizzabili per progetti futuri.

Link ai pesi ufficiali e risorse:

- Modello FLUX.2 Dev di Black Forest Labs: black-forest-labs/FLUX.2-dev

- Pesi suddivisi per ComfyUI (codificatori di testo, VAE, modello di diffusione): Comfy-Org/flux2-dev

Ringraziamenti#

Questo workflow implementa e si basa sui seguenti lavori e risorse. Ringraziamo Comfy Org per FLUX.2 Day-0 Support in ComfyUI: Frontier Visual Intelligence per i loro contributi e manutenzione. Per dettagli autorevoli, si prega di fare riferimento alla documentazione originale e ai repository collegati di seguito.

Risorse#

- Comfy Org/FLUX.2 Day-0 Support in ComfyUI: Frontier Visual Intelligence

- GitHub: Comfy-Org/workflow_templates

- Hugging Face: black-forest-labs/FLUX.2-dev

- Docs / Note di rilascio: FLUX.2 Day-0 Support in ComfyUI: Frontier Visual Intelligence

Nota: L'uso dei modelli, dataset e codice di riferimento è soggetto alle rispettive licenze e termini forniti dai loro autori e manutentori.