Wan Alpha : texte-à-vidéo transparent pour le compositing professionnel#

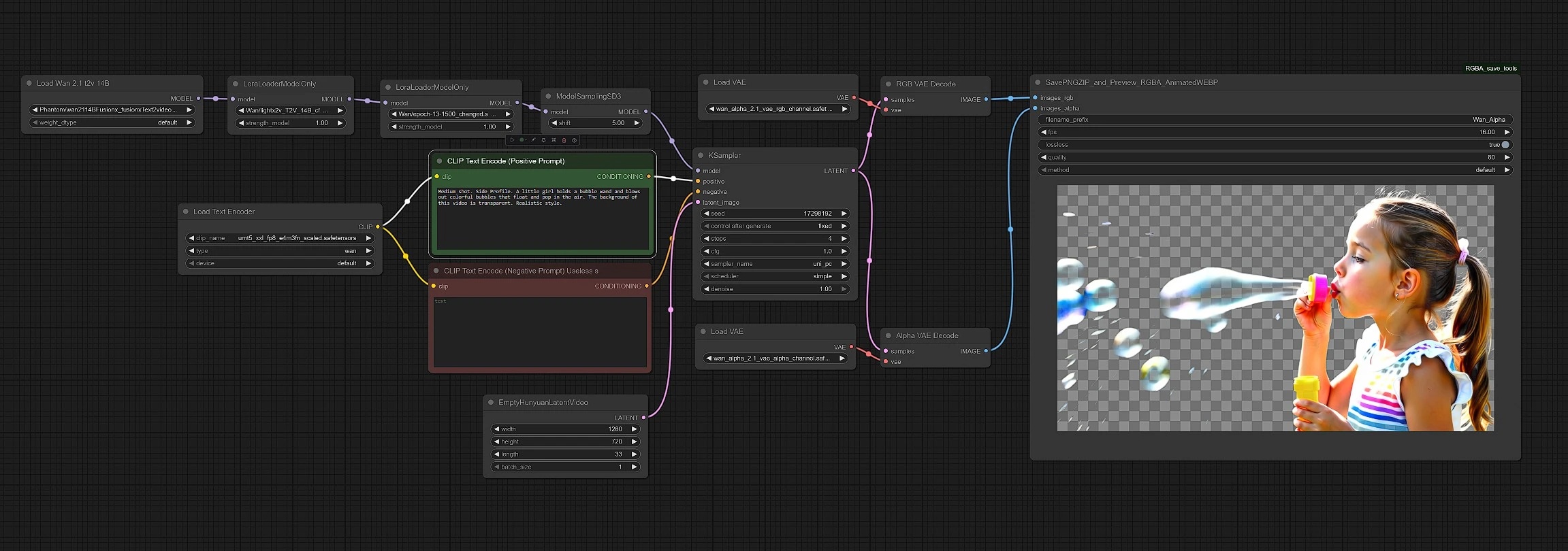

Wan Alpha est un workflow ComfyUI conçu pour générer des vidéos avec un canal alpha natif en utilisant la famille Wan 2.1. Il produit conjointement RGB et alpha pour que les personnages, accessoires et effets s'insèrent directement dans les timelines sans nécessiter de keying ou de rotoscopie. Pour les VFX, les graphismes animés et les applications interactives, Wan Alpha offre des bords nets, des effets semi-transparents et des masques précis prêts pour la production.

Construit autour de Wan2.1‑T2V‑14B et d'une paire VAE consciente de l'alpha, Wan Alpha équilibre fidélité et rapidité. L'accélération optionnelle LightX2V LoRA raccourcit l'échantillonnage tout en préservant les détails, et le workflow exporte des séquences de trames RGBA ainsi qu'un aperçu animé WebP pour une revue rapide.

Modèles clés dans le workflow Comfyui Wan Alpha#

- Wan2.1‑T2V‑14B. Modèle fondamental de texte-à-vidéo qui pilote la structure de la scène, le mouvement et la qualité de rendu. Les poids et le code officiels sont maintenus dans l'organisation Wan-Video sur GitHub. Wan-Video/Wan2.1

- UMT5‑XXL encodeur de texte. Encodeur multilingue utilisé pour tokeniser et intégrer des invites pour les modèles Wan, permettant une formulation riche des invites en plusieurs langues. google/umt5-xxl et UMT5 docs

- Wan‑Alpha paire VAE. Une conception VAE qui apprend conjointement le RGB et l'alpha pour que l'alpha décodé s'aligne pixel par pixel avec le RGB, supportant les bords fins et la semi-transparence. Voir le rapport technique Wan‑Alpha pour plus de détails. Wan‑Alpha (arXiv)

- LightX2V LoRA. Accélération LoRA optionnelle qui distille de longs échantillonneurs en quelques étapes pour un texte-à-vidéo plus rapide tout en maintenant la qualité perceptuelle. ModelTC/LightX2V

Comment utiliser le workflow Comfyui Wan Alpha#

Ce graphe ComfyUI suit un chemin simple de l'invite aux trames RGBA : charger les modèles, encoder le texte, allouer un latent vidéo, échantillonner, décoder RGB et alpha en synchronisation, puis enregistrer.

Chargement des modèles et de LoRA

- Commencez par

Load Wan 2.1 t2v 14B(#37) pour charger le modèle de base. Si vous utilisez l'accélération ou des raffinements de style, appliquez-les avecLoraLoaderModelOnly(#59) etLoraLoaderModelOnly(#65) en séquence. Le modèle passe ensuite parModelSamplingSD3(#48), qui configure un échantillonneur compatible avec le checkpoint chargé. Cet ensemble définit le mouvement préalable et le style de rendu que Wan Alpha affinera dans les étapes ultérieures.

Encodage de l'invite

Load Text Encoder(#38) charge l'encodeur de texte UMT5‑XXL. Entrez votre description dansCLIP Text Encode (Positive Prompt)(#6); gardez votre sujet, action, cadrage de caméra, et la phrase "transparent background" concis. UtilisezCLIP Text Encode (Negative Prompt) Useless s(#7) pour éviter les halos ou les encombrements de fond si nécessaire. Ces encodages conditionnent à la fois la génération RGB et alpha pour que les bords et les indices de transparence suivent votre intention.

Configuration de la toile vidéo

- Utilisez

EmptyHunyuanLatentVideo(#40) pour définir la toile vidéo latente. Réglezwidth,height,frames, etfpspour s'adapter à votre prise de vue; des résolutions plus élevées ou des clips plus longs nécessitent plus de mémoire. Ce nœud alloue un volume latent temporellement cohérent que Wan Alpha remplira de mouvement et d'apparence. Envisagez d'harmoniser la durée et la fréquence d'images avec votre montage pour éviter le rééchantillonnage plus tard.

Génération

- Le

KSampler(#3) effectue la diffusion sur le latent vidéo en utilisant votre pile de modèles et le conditionnement de l'invite. Ajustezseedpour des variations, et sélectionnez unsampleret unschedulerqui équilibrent rapidité et détail. Lorsque le LightX2V LoRA est actif, vous pouvez utiliser moins d'étapes pour des rendus plus rapides tout en maintenant la stabilité. La sortie est un flux latent unique partagé par l'étape de décodage suivante pour garantir un alignement parfait RGBA.

Décodage RGB et alpha

RGB VAE Decode(#8) s'associe àVAELoader(#39) pour reconstruire les trames RGB. En parallèle,Alpha VAE Decode(#52) s'associe àVAELoader(#51) pour reconstruire le canal alpha. Les deux décodeurs lisent le même latent pour que le matte s'aligne exactement avec les pixels de couleur, une idée centrale dans la conception de Wan‑Alpha pour une transparence cohérente. Ce double chemin de décodage est ce qui rend Wan Alpha prêt pour un compositing direct.

Enregistrement et aperçu

SavePNGZIP_and_Preview_RGBA_AnimatedWEBP(#73) écrit deux livrables : une archive zip de trames PNG RGBA et un aperçu animé WebP compact. La séquence de trames est conviviale pour les NLEs et les compositeurs, tandis que l'aperçu accélère les revues. Nommez votre ensemble de sortie, choisissez une longueur et une qualité d'aperçu, et exécutez le nœud pour emballer votre résultat.

Nœuds clés dans le workflow Comfyui Wan Alpha#

EmptyHunyuanLatentVideo (#40)

- Rôle : définit la résolution spatiale et temporelle du clip généré. Ajustez

width,height,frames, etfpspour correspondre à la livraison. Les toiles plus grandes et les durées plus longues augmentent les besoins en VRAM ; envisagez des brouillons plus courts pour le développement de look, puis augmentez pour les finales.

KSampler (#3)

- Rôle : le principal débruiteur pour Wan Alpha. Ajustez

seedpour les explorations,stepspour échanger rapidité et détail,sampleretschedulerpour la stabilité, etcfgpour équilibrer l'adhésion à l'invite avec le mouvement naturel. Avec LightX2V LoRA actif, vous pouvez réduire significativementstepstout en préservant la qualité grâce à la distillation par étapes. Voir LightX2V pour le contexte sur l'échantillonnage rapide. ModelTC/LightX2V

LoraLoaderModelOnly (#59)

- Rôle : charge le LightX2V LoRA qui accélère l'échantillonnage Wan2.1. Utilisez le contrôle

strengthpour mélanger son effet si vous voyez des suraffûtages ou des artefacts de tempo. Gardez ce LoRA le plus proche du modèle de base dans la chaîne pour que les LoRAs en aval héritent de ses avantages de vitesse.

LoraLoaderModelOnly (#65)

- Rôle : charge un LoRA supplémentaire pour le raffinement de style ou de domaine. Modérez

strengthpour éviter de dominer la cohérence du mouvement ; combinez avec votre invite plutôt que de la remplacer. Si des artefacts apparaissent, baissez ce LoRA avant de changer l'échantillonneur.

VAELoader (#39) RGB

- Rôle : fournit le VAE RGB utilisé par

RGB VAE Decode(#8). Gardez cela associé au VAE alpha Wan‑Alpha pour s'assurer que les deux décodeurs interprètent les latents de manière cohérente. Passer à des VAEs non liés peut désaligner les bords ou adoucir la transparence. Le contexte sur la conception conjointe RGB–alpha est dans le rapport Wan‑Alpha. Wan‑Alpha (arXiv)

VAELoader (#51) Alpha

- Rôle : fournit le VAE alpha utilisé par

Alpha VAE Decode(#52). Il reconstruit le matte à partir du même espace latent que le RGB pour que la transparence corresponde au mouvement et aux détails. Si vous personnalisez les VAEs, testez que le RGB et l'alpha s'alignent toujours sur les bords subpixel comme les cheveux.

SavePNGZIP_and_Preview_RGBA_AnimatedWEBP (#73)

- Rôle : exporte des actifs. Définissez un

output_nameclair pour la versioning, choisissez une qualité d'aperçu et une fréquence d'images qui reflètent le clip généré, et gardez l'export PNG comme votre maître pour un compositing sans perte. Évitez de redimensionner entre le décodage et l'enregistrement pour préserver la fidélité des bords.

Extras optionnels#

- Des invites fortes pour Wan Alpha décrivent explicitement le sujet, l'action, la caméra, l'éclairage, et "transparent background". Ajoutez des matériaux subtils comme "cheveux vaporeux" ou "verre" pour exercer le détail de l'alpha.

- Pour une itération rapide, utilisez des durées plus courtes ou des taux de trame plus bas, puis augmentez les paramètres une fois le look et le mouvement verrouillés.

- Si vous voyez des halos, ajoutez des négatifs comme "background, outline, green screen, white fringe" et gardez l'éclairage constant dans l'invite.

- Lors de la combinaison de plusieurs LoRAs, placez les LoRAs d'accélération plus tôt et les LoRAs stylistiques plus tard, et gardez des forces modestes pour conserver le réalisme du mouvement.

- Importez la séquence PNG RGBA directement dans votre compositeur ; utilisez le WebP animé uniquement pour les aperçus, pas comme maître.

Ressources utilisées dans Wan Alpha

- Famille de modèles Wan2.1 et code : Wan-Video/Wan2.1

- Encodeur de texte UMT5 : google/umt5-xxl et UMT5 docs

- Aperçu de la méthode Wan‑Alpha : Wan‑Alpha (arXiv)

- Accélération LightX2V : ModelTC/LightX2V

Remerciements#

Ce workflow implémente et s'appuie sur les travaux et ressources suivants. Nous remercions sincèrement WeChatCV pour Wan-Alpha pour leurs contributions et leur maintenance. Pour des détails autoritaires, veuillez vous référer à la documentation originale et aux dépôts répertoriés ci-dessous.

Ressources#

- WeChatCV/Wan-Alpha

- GitHub: WeChatCV/Wan-Alpha

Note : L'utilisation des modèles, ensembles de données et codes référencés est soumise aux licences et conditions respectives fournies par leurs auteurs et mainteneurs.