Inférence Qwen Edit 2511 LoRA : éditions AI Toolkit cohérentes avec l'entraînement dans ComfyUI#

L'inférence Qwen Edit 2511 LoRA est un workflow RunComfy prêt à l'emploi pour appliquer une LoRA formée par AI Toolkit sur Qwen Image Edit Plus 2511 dans ComfyUI avec un comportement correspondant à l'entraînement. Il est construit autour de RC Qwen Image Edit Plus 2511 (RCQwenImageEditPlus2511)—un nœud personnalisé open-source construit par RunComfy (source) qui dirige l'édition à travers un pipeline d'inférence spécifique à Qwen (au lieu d'un graphe d'échantillonneur générique), tout en chargeant votre adaptateur via lora_path et lora_scale.

Pourquoi l'inférence Qwen Edit 2511 LoRA semble souvent différente dans ComfyUI#

Les images de prévisualisation AI Toolkit proviennent d'un pipeline d'édition spécifique à Qwen Image Edit Plus 2511, y compris comment l'invite est encodée par rapport à l'image de contrôle et comment l'orientation est appliquée. Si vous reconstruisez la même tâche en tant que graphe d'échantillonneur ComfyUI générique, les valeurs par défaut peuvent changer et la LoRA peut finir par corriger une autre partie de la pile—donc faire correspondre l'invite/les étapes/la graine ne garantit toujours pas des éditions correspondantes. Lorsque les résultats s'écartent, c'est généralement un désalignement au niveau du pipeline plutôt qu'un seul paramètre que vous avez manqué.

Ce que fait le nœud personnalisé RCQwenImageEditPlus2511#

RCQwenImageEditPlus2511 dirige l'édition Qwen Image Edit Plus 2511 à travers un pipeline d'inférence aligné sur la prévisualisation et applique votre adaptateur AI Toolkit via lora_path / lora_scale à l'intérieur de ce pipeline pour garder l'inférence cohérente avec les prévisualisations d'entraînement. Implémentation de référence : `src/pipelines/qwen_image.py`.

Comment utiliser le workflow d'inférence Qwen Edit 2511 LoRA#

Étape 1 : Importer votre LoRA (2 options)#

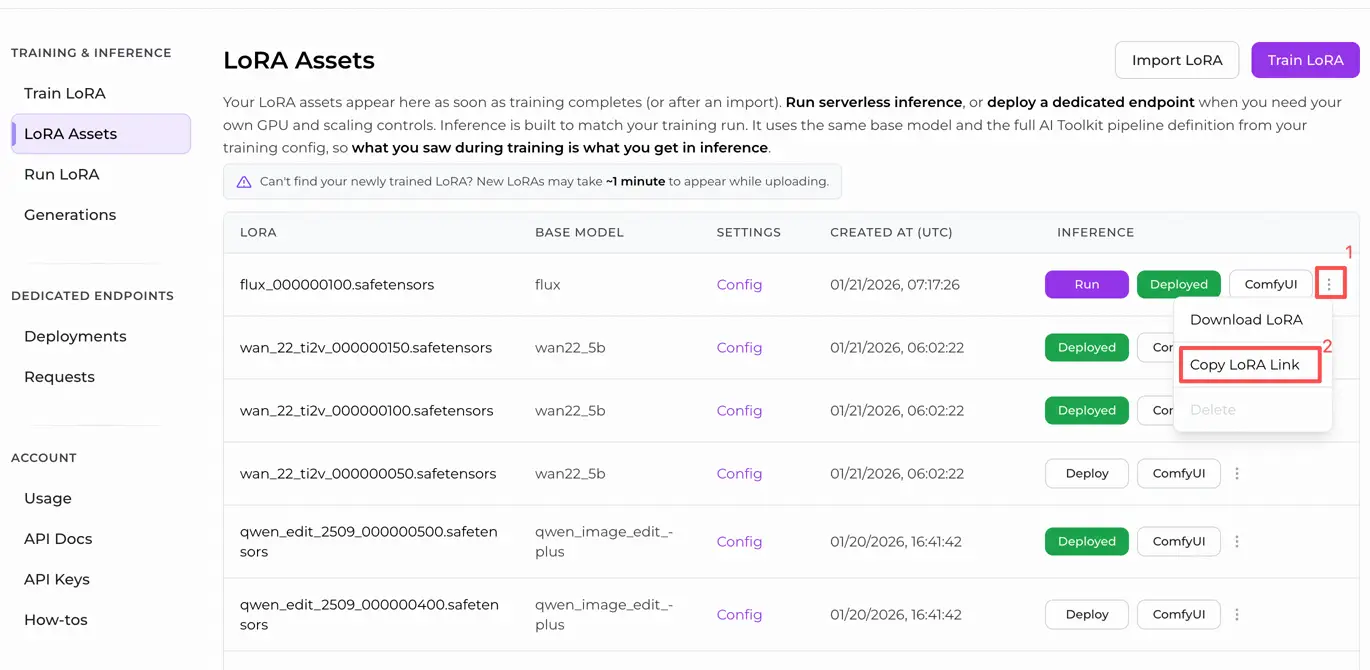

- Option A (résultat d'entraînement RunComfy) : RunComfy → Trainer → LoRA Assets → trouvez votre LoRA → ⋮ → Copier le lien LoRA

- Option B (LoRA AI Toolkit formé en dehors de RunComfy) : Copiez un lien de téléchargement direct

.safetensorspour votre LoRA et collez ce URL danslora_path(pas besoin de télécharger dansComfyUI/models/loras).

Étape 2 : Configurer le nœud personnalisé RCQwenImageEditPlus2511 pour l'inférence Qwen Edit 2511 LoRA#

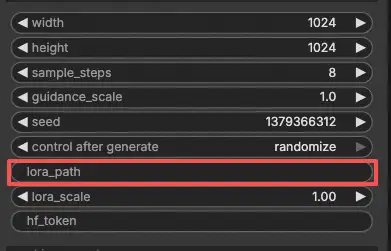

Collez votre lien LoRA dans lora_path sur RCQwenImageEditPlus2511 (soit le lien LoRA RunComfy de l'Option A, soit un URL direct .safetensors de l'Option B).

Ensuite, réglez les autres paramètres du nœud (faites correspondre vos valeurs de prévisualisation/échantillon AI Toolkit lorsque vous comparez les résultats) :

prompt: l'instruction d'édition (incluez vos tokens de déclenchement de formation si votre LoRA les utilise)negative_prompt: optionnel ; laissez vide si vous n'avez pas utilisé de négatifs dans les prévisualisationswidth/height: taille de sortie (les multiples de 32 sont recommandés pour ce pipeline)sample_steps: étapes d'inférence (commencez par refléter votre nombre d'étapes de prévisualisation ; 25 est une base commune)guidance_scale: force de l'orientation (Qwen utilise une échelle "CFG vraie" ; validez la valeur de correspondance de prévisualisation avant de la régler)seed: graine fixe pour des éditions répétables pendant que vous diagnostiquez l'alignement en réglant le control_after_generate à 'fixed'lora_scale: force de la LoRA (commencez à votre force de prévisualisation, puis ajustez progressivement)

Ce workflow est une configuration d'édition d'image, il nécessite donc également une image d'entrée :

control_image(entrée requise) : connectez un nœud LoadImage àcontrol_image, et remplacez l'image d'échantillon par la photo que vous souhaitez éditer.

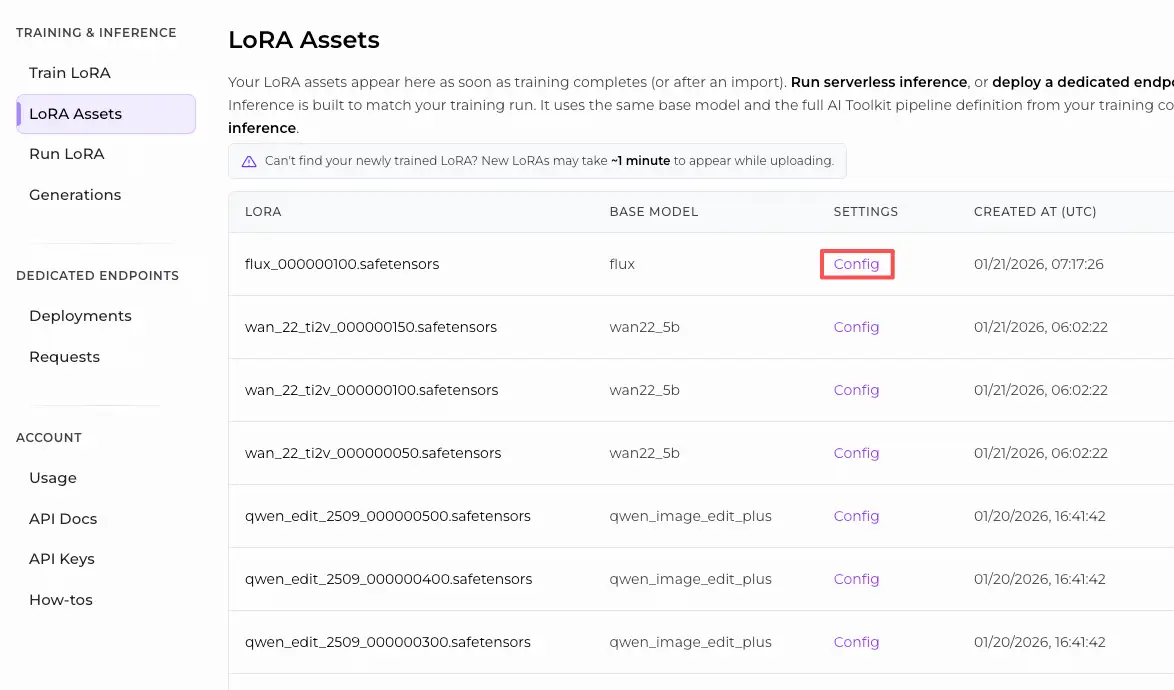

Note d'alignement de l'entraînement : si vous avez changé les paramètres d'échantillonnage pendant l'entraînement, ouvrez votre YAML d'entraînement AI Toolkit et reflétez width, height, sample_steps, guidance_scale, seed, et lora_scale. Si vous vous êtes entraîné sur RunComfy, allez à Trainer → LoRA Assets → Config et copiez les valeurs de prévisualisation dans RCQwenImageEditPlus2511.

Étape 3 : Exécutez l'inférence Qwen Edit 2511 LoRA#

Cliquez sur Queue/Run. Le nœud SaveImage écrit le résultat édité dans votre répertoire de sortie ComfyUI standard.

Dépannage de l'inférence Qwen Edit 2511 LoRA#

La plupart des problèmes rencontrés après avoir formé une Qwen-Image-Edit-2511 LoRA dans Ostris AI Toolkit apparaissent au moment de l'inférence en raison d'un désalignement du pipeline—le prévisualisateur AI Toolkit est spécifique au modèle/pipeline, tandis que de nombreux graphiques ComfyUI (ou backends accélérés) ne le sont pas.

Le nœud personnalisé RC Qwen Image Edit Plus 2511 (RCQwenImageEditPlus2511) de RunComfy est conçu pour garder l'inférence alignée sur le pipeline avec l'échantillonnage de prévisualisation de style AI Toolkit.

(1)qwen image edit ne supporte pas le chargement de Lora#

Pourquoi cela se produit

Certains chemins accélérés d'édition d'image Qwen (par exemple, la route d'édition d'image Qwen de Nunchaku) ne patchent pas actuellement les poids LoRA de la même manière que le pipeline d'édition Qwen officiel l'attend. Le symptôme habituel est échec de chargement des poids / clé lora non chargée et l'adaptateur ayant peu ou pas d'effet visible.

Comment réparer (approche cohérente avec l'entraînement)

- Si vous utilisez Qwen Image Edit via Nunchaku, passez à un workflow Qwen Image Edit 2511 non-Nunchaku pour la validation LoRA (cela a été signalé comme non supporté pour le chargement LoRA dans le problème).

- Dans RunComfy, validez votre adaptateur via RCQwenImageEditPlus2511 d'abord et injectez la LoRA uniquement via

lora_path+lora_scale(évitez d'empiler un chemin de chargeur LoRA supplémentaire sur le nœud RC). - Gardez la même image de contrôle,

seed,sample_steps,guidance_scale, etwidth/heightfixes pendant que vous comparez avec les prévisualisations AI Toolkit.

(2)Question sur l'avertissement de chargement qwen-image-edit-2511#

Pourquoi cela se produit

Qwen-Image-Edit-2511 introduit de nouveaux champs de configuration (notamment zero_cond_t). Si votre runtime local est en retard par rapport à la prise en charge de la bibliothèque attendue par le modèle, vous pouvez voir des avertissements tels que : l'attribut de configuration zero_cond_t a été passé ... mais est ignoré C'est un signal fort que vos valeurs par défaut du pipeline peuvent ne pas correspondre à l'échantillonneur de prévisualisation contre lequel vous vous êtes entraîné/validé.

Comment réparer (chemin de mise à niveau connu-fonctionnel)

- Mettez à niveau vers une version Diffusers/stack qui inclut la prise en charge de Qwen-Image-Edit-2511. Une correction couramment partagée dans l'écosystème AI Toolkit est l'installation de Diffusers depuis la branche principale de GitHub pour la compatibilité Qwen Edit 2511 (voir le PR de support) : https://github.com/ostris/ai-toolkit/pull/611

- Ensuite, retestez via RCQwenImageEditPlus2511 (aligné sur le pipeline) tout en reflétant vos valeurs de prévisualisation (

sample_steps,guidance_scale,seed,lora_scale,width/height).

(3)--zero_cond_t # Ceci est un paramètre spécial introduit par Qwen-Image-Edit-2511. Veuillez l'activer pour ce modèle.#

Pourquoi cela se produit

Certains piles d'entraînement/inférence Qwen Edit 2511 nécessitent que zero_cond_t soit activé pour correspondre au comportement de conditionnement/orientation prévu. Si vos prévisualisations d'entraînement ont été produites avec une configuration et que votre inférence ComfyUI fonctionne avec une autre, les éditions peuvent sembler "décalées" même si l'invite/la graine/les étapes correspondent.

Comment réparer (comportement correspondant à l'entraînement)

- Assurez-vous que votre échantillonneur de prévisualisation d'entraînement et votre pipeline d'inférence utilisent la même configuration Qwen Edit 2511 (y compris

zero_cond_tlorsque votre pile l'expose). - Pour l'inférence ComfyUI, préférez RCQwenImageEditPlus2511 pour que le pipeline d'édition reste aligné sur le pipeline, et la LoRA est injectée là où le pipeline de style prévisualisation l'attend (via

lora_path/lora_scale).

(4)Qwen Image Edit 2511 - Dégradation de la sortie carrée sur l'édition d'une seule image#

Pourquoi cela se produit

Les utilisateurs rapportent que Qwen-Image-Edit-2511 peut perdre sa cohérence sur les sorties carrées (par exemple, 1024×1024) pour certaines éditions, tandis que les ratios d'aspect non carrés produisent des résultats nettement plus propres et plus fidèles—même avec la même graine/invite/réglages.

Comment réparer (solution signalée par les utilisateurs)

- Lors de la validation de votre LoRA, testez une sortie non carrée (par exemple, 832×1216 ou 1216×832) tout en gardant la même

seed,sample_steps,guidance_scale, et l'image de contrôle. - Une fois que vous trouvez un ratio d'aspect qui correspond à vos attentes de prévisualisation, gardez ce ratio fixe et commencez seulement alors à ajuster

lora_scale.

Exécutez maintenant l'inférence Qwen Edit 2511 LoRA#

Ouvrez le workflow, réglez lora_path, connectez votre control_image, et exécutez RCQwenImageEditPlus2511 pour garder les éditions ComfyUI alignées avec vos prévisualisations d'entraînement AI Toolkit.